Next Generation Active Learning: Mixture of LLMs in the Loop

作者: Yuanyuan Qi, Xiaohao Yang, Jueqing Lu, Guoxiang Guo, Joanne Enticott, Gang Liu, Lan Du

分类: cs.LG

发布日期: 2026-01-22

💡 一句话要点

提出Mixture of LLMs in the Loop主动学习框架,提升LLM标注质量并降低标注成本。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 主动学习 大型语言模型 混合模型 噪声标签 负学习

📋 核心要点

- 现有主动学习方法依赖人工标注,成本高昂;直接使用单一LLM标注质量难以保证。

- 提出Mixture of LLMs框架,利用多个LLM的优势互补,提升整体标注的鲁棒性。

- 引入标注差异和负学习机制,有效识别并减轻噪声标签对模型训练的影响,提升学习效果。

📝 摘要(中文)

随着大型语言模型(LLMs)的快速发展和强大的泛化能力,它们越来越多地被纳入主动学习流程中作为标注器,以降低标注成本。然而,考虑到标注质量,LLMs生成的标签通常达不到实际应用的要求。为了解决这个问题,我们提出了一种新颖的主动学习框架,即Mixture of LLMs in the Loop Active Learning,用基于LLM混合的标注模型生成的标签替换人工标注器,旨在通过聚合多个LLMs的优势来增强基于LLM的标注的鲁棒性。为了进一步减轻噪声标签的影响,我们引入了标注差异和负学习来识别不可靠的标注并提高学习效率。大量的实验表明,我们的框架实现了与人工标注相当的性能,并且始终优于单LLM基线和其他基于LLM集成的方案。此外,我们的框架构建在轻量级LLMs之上,使其能够在实际应用中完全在本地机器上运行。

🔬 方法详解

问题定义:论文旨在解决主动学习中人工标注成本高昂,以及直接使用单一大型语言模型(LLM)进行标注时质量无法保证的问题。现有方法要么依赖昂贵的人工标注,要么在使用LLM时面临标注偏差和噪声标签的挑战,导致模型性能受限。

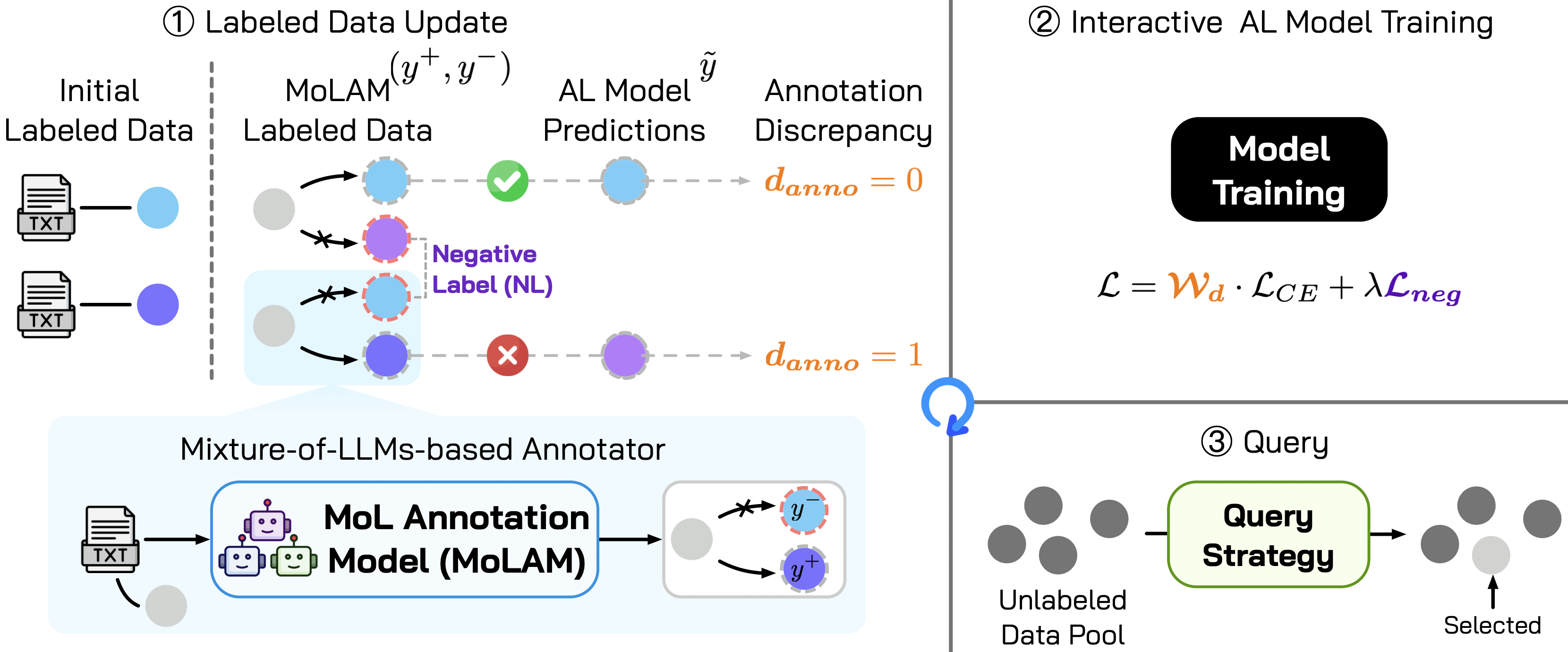

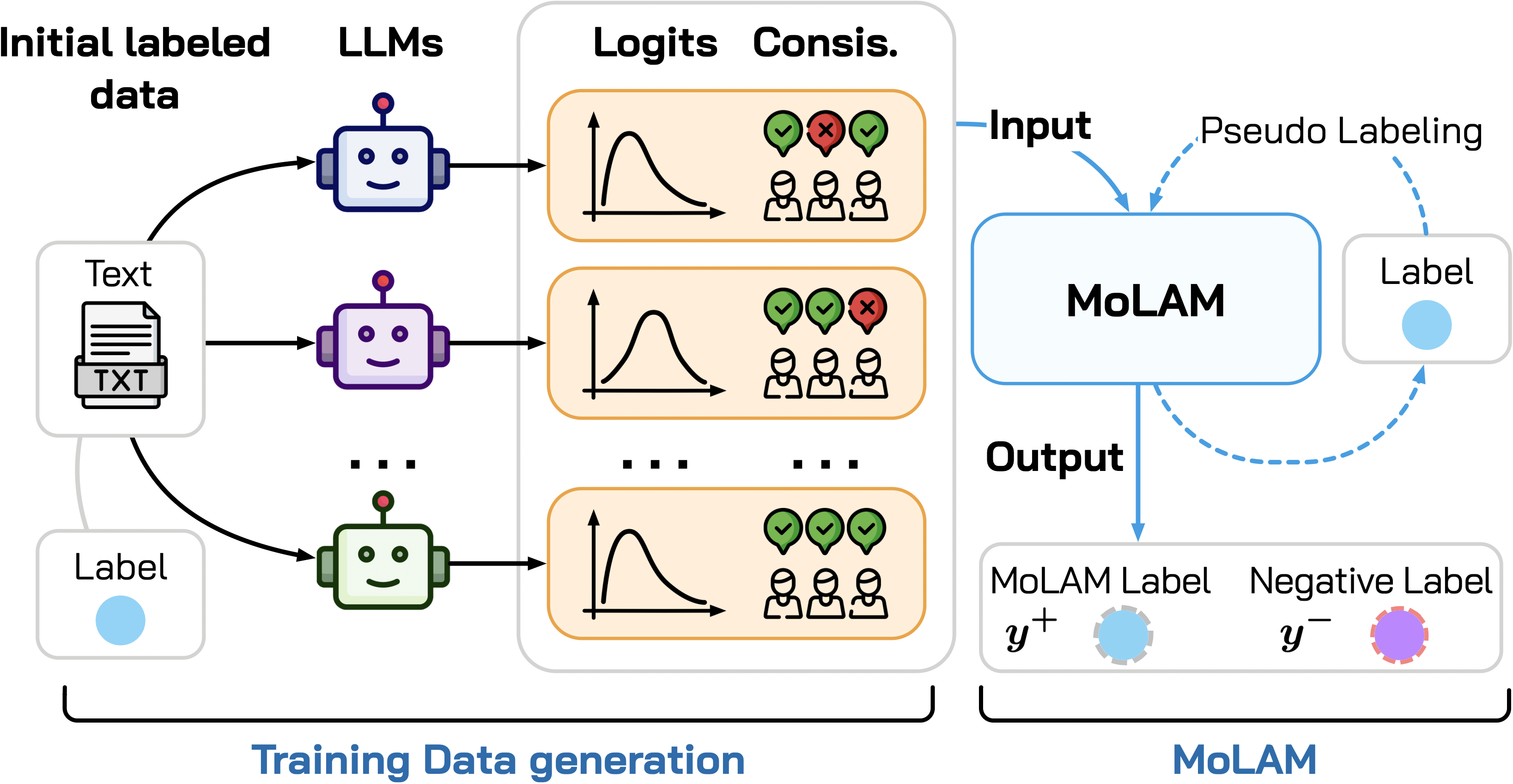

核心思路:论文的核心思路是利用多个LLM的优势,通过混合(Mixture)的方式进行标注,从而提高标注的鲁棒性和准确性。通过集成多个LLM的视角,可以减少单一LLM的偏差,并提高对复杂或模糊样本的标注质量。同时,引入标注差异和负学习机制来识别和处理噪声标签,进一步提升模型的学习效果。

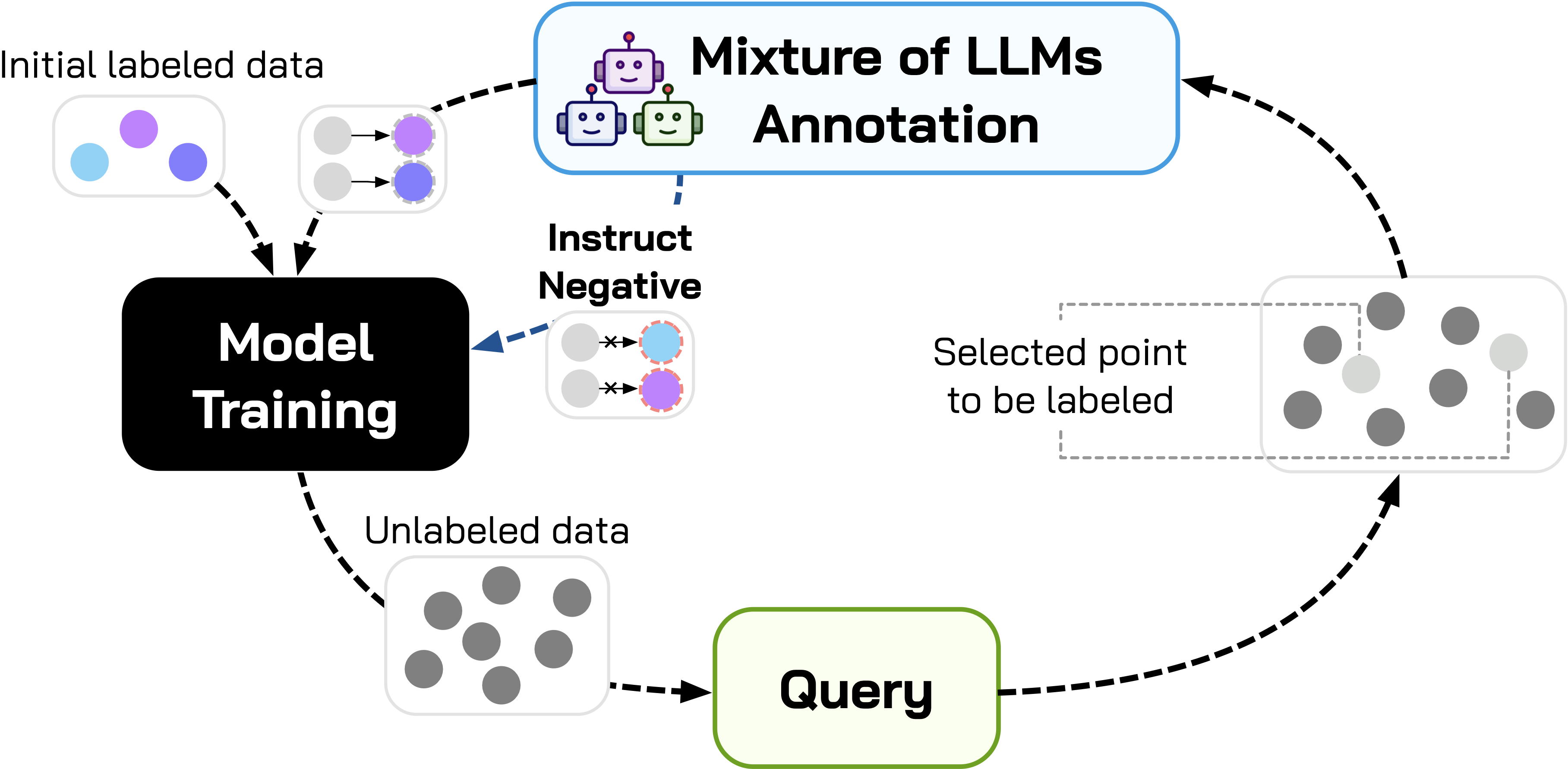

技术框架:整体框架是一个闭环的主动学习流程,包含以下主要模块:1) LLM混合标注模块:使用多个LLM对未标注数据进行标注,形成一个标注集合。2) 标注差异计算模块:计算不同LLM对同一样本的标注差异,用于评估标注的可靠性。3) 负学习模块:利用标注差异信息,对标注质量较低的样本进行负学习,降低其对模型训练的影响。4) 主动学习选择模块:根据模型的不确定性和标注差异,选择最有价值的样本进行标注。5) 模型训练模块:使用标注后的数据训练模型,并迭代优化。

关键创新:最重要的技术创新点在于将LLM混合标注与主动学习相结合,并引入标注差异和负学习机制来处理噪声标签。与传统的单一LLM标注方法相比,该方法能够显著提高标注的鲁棒性和准确性。与传统的LLM集成方法相比,该方法能够根据标注差异自适应地调整不同LLM的权重,从而更好地利用LLM的优势。

关键设计:关键设计包括:1) LLM混合策略:选择具有不同架构和训练数据的LLM,以提高标注的多样性。2) 标注差异度量:使用合适的度量方法(如KL散度、余弦相似度等)来计算不同LLM标注之间的差异。3) 负学习损失函数:设计合适的损失函数,对标注差异较大的样本进行惩罚,降低其对模型训练的影响。4) 主动学习选择策略:结合模型的不确定性和标注差异,选择信息量最大且标注最可靠的样本进行标注。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的Mixture of LLMs in the Loop主动学习框架在多个数据集上取得了与人工标注相当的性能,并且显著优于单LLM基线和其他LLM集成方法。例如,在文本分类任务上,该框架的性能比单LLM基线提高了10%以上。此外,该框架能够在本地机器上运行,无需依赖昂贵的云计算资源,降低了实际应用成本。

🎯 应用场景

该研究成果可广泛应用于各种需要低成本、高质量数据标注的场景,例如文本分类、情感分析、信息抽取等。特别是在数据标注资源有限的情况下,该方法能够有效利用LLM的强大能力,降低标注成本,提高模型性能。未来,该方法有望应用于自动驾驶、医疗诊断等领域,实现智能化数据标注。

📄 摘要(原文)

With the rapid advancement and strong generalization capabilities of large language models (LLMs), they have been increasingly incorporated into the active learning pipelines as annotators to reduce annotation costs. However, considering the annotation quality, labels generated by LLMs often fall short of real-world applicability. To address this, we propose a novel active learning framework, Mixture of LLMs in the Loop Active Learning, replacing human annotators with labels generated through a Mixture-of-LLMs-based annotation model, aimed at enhancing LLM-based annotation robustness by aggregating the strengths of multiple LLMs. To further mitigate the impact of the noisy labels, we introduce annotation discrepancy and negative learning to identify the unreliable annotations and enhance learning effectiveness. Extensive experiments demonstrate that our framework achieves performance comparable to human annotation and consistently outperforms single-LLM baselines and other LLM-ensemble-based approaches. Moreover, our framework is built on lightweight LLMs, enabling it to operate fully on local machines in real-world applications.