Towards Automated Kernel Generation in the Era of LLMs

作者: Yang Yu, Peiyu Zang, Chi Hsu Tsai, Haiming Wu, Yixin Shen, Jialing Zhang, Haoyu Wang, Zhiyou Xiao, Jingze Shi, Yuyu Luo, Wentao Zhang, Chunlei Men, Guang Liu, Yonghua Lin

分类: cs.LG, cs.CL

发布日期: 2026-01-22

备注: 10 pages, 1 figure

🔗 代码/项目: GITHUB

💡 一句话要点

综述:利用大语言模型实现自动化内核生成与优化

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 内核生成 自动化优化 代理系统 AI系统性能

📋 核心要点

- 现有内核优化依赖专家知识,过程耗时且难以扩展,成为AI系统性能瓶颈。

- 利用LLM压缩专家知识,结合代理系统迭代优化,有望实现自动化内核生成。

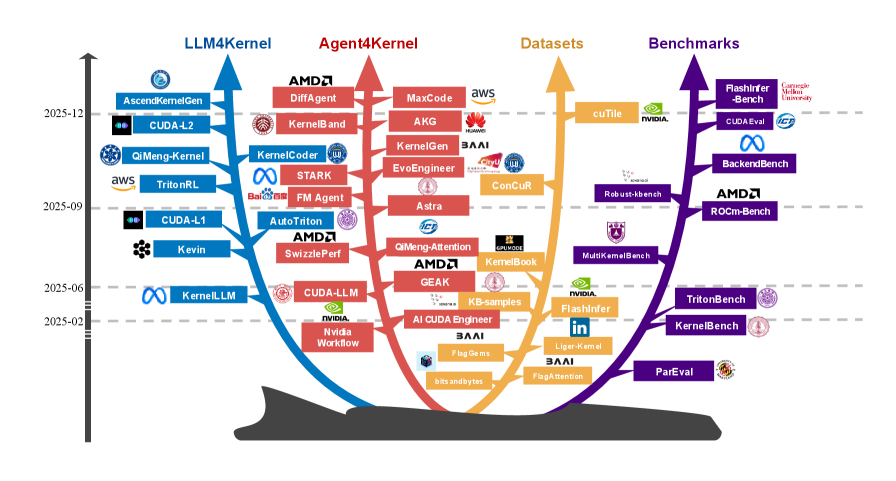

- 该综述系统性地整理了LLM驱动内核生成的方法、数据集和基准,并展望未来方向。

📝 摘要(中文)

现代人工智能系统的性能从根本上受到底层内核质量的限制,内核将高级算法语义转换为低级硬件操作。实现接近最优的内核需要专家级地理解硬件架构和编程模型,这使得内核工程成为一项关键但耗时且不可扩展的过程。大语言模型(LLM)和基于LLM的代理的最新进展为自动化内核生成和优化开辟了新的可能性。LLM非常适合压缩难以形式化的专家级内核知识,而代理系统通过将内核开发视为迭代的、反馈驱动的循环,进一步实现了可扩展的优化。该领域已经取得了快速进展。然而,该领域仍然是分散的,缺乏LLM驱动的内核生成的系统视角。本综述通过提供现有方法的结构化概述来弥补这一差距,涵盖基于LLM的方法和代理优化工作流程,并系统地汇编了支持该领域学习和评估的数据集和基准。此外,还进一步概述了关键的开放挑战和未来的研究方向,旨在为下一代自动化内核优化建立一个全面的参考。为了跟踪该领域,我们在https://github.com/flagos-ai/awesome-LLM-driven-kernel-generation维护一个开源GitHub存储库。

🔬 方法详解

问题定义:论文旨在解决现代AI系统性能受限于底层内核质量的问题。现有内核优化方法依赖于人工专家,需要深入理解硬件架构和编程模型,导致开发过程耗时、成本高昂且难以扩展,无法满足快速发展的AI应用需求。

核心思路:论文的核心思路是利用大语言模型(LLM)来自动化内核生成和优化过程。LLM能够学习和压缩专家级的内核知识,并结合代理系统进行迭代优化,从而降低对人工专家的依赖,提高内核开发的效率和可扩展性。

技术框架:论文对LLM驱动的内核生成技术进行了系统性的综述,主要包括两个方面:一是基于LLM的内核生成方法,利用LLM直接生成或优化内核代码;二是基于代理的优化工作流程,将内核开发视为一个迭代的、反馈驱动的循环,通过代理与环境交互,不断优化内核性能。

关键创新:论文的关键创新在于提出了一个LLM驱动的自动化内核生成和优化框架,并对现有方法进行了系统性的分类和总结。该框架利用LLM强大的学习和生成能力,以及代理系统的迭代优化能力,有望实现高效、可扩展的内核开发。

关键设计:论文对现有方法进行了详细的分析,并总结了常用的数据集和基准。此外,论文还指出了该领域面临的挑战和未来的研究方向,例如如何提高LLM生成内核代码的质量、如何设计更有效的代理优化策略等。具体的技术细节取决于被综述的各个方法,论文本身没有提出新的参数设置、损失函数或网络结构。

🖼️ 关键图片

📊 实验亮点

该论文是一篇综述性文章,主要贡献在于对现有LLM驱动的内核生成方法进行了系统性的整理和分析,并指出了该领域面临的挑战和未来的研究方向。论文系统地汇编了支持该领域学习和评估的数据集和基准,为后续研究提供了重要的参考。

🎯 应用场景

该研究成果可广泛应用于各种AI系统的内核优化,例如深度学习框架、高性能计算库等。通过自动化内核生成和优化,可以显著提高AI系统的性能和效率,降低开发成本,加速AI技术的普及和应用。未来,该技术有望应用于嵌入式系统、移动设备等资源受限的平台,实现更高效的AI计算。

📄 摘要(原文)

The performance of modern AI systems is fundamentally constrained by the quality of their underlying kernels, which translate high-level algorithmic semantics into low-level hardware operations. Achieving near-optimal kernels requires expert-level understanding of hardware architectures and programming models, making kernel engineering a critical but notoriously time-consuming and non-scalable process. Recent advances in large language models (LLMs) and LLM-based agents have opened new possibilities for automating kernel generation and optimization. LLMs are well-suited to compress expert-level kernel knowledge that is difficult to formalize, while agentic systems further enable scalable optimization by casting kernel development as an iterative, feedback-driven loop. Rapid progress has been made in this area. However, the field remains fragmented, lacking a systematic perspective for LLM-driven kernel generation. This survey addresses this gap by providing a structured overview of existing approaches, spanning LLM-based approaches and agentic optimization workflows, and systematically compiling the datasets and benchmarks that underpin learning and evaluation in this domain. Moreover, key open challenges and future research directions are further outlined, aiming to establish a comprehensive reference for the next generation of automated kernel optimization. To keep track of this field, we maintain an open-source GitHub repository at https://github.com/flagos-ai/awesome-LLM-driven-kernel-generation.