Outcome-Based RL Provably Leads Transformers to Reason, but Only With the Right Data

作者: Yuval Ran-Milo, Yotam Alexander, Shahar Mendel, Nadav Cohen

分类: cs.LG, cs.AI

发布日期: 2026-01-21

备注: 80 pages, 4 figures

💡 一句话要点

基于结果的强化学习能使Transformer推理,但需合适数据

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习 Transformer 思维链 梯度流 简单示例

📋 核心要点

- 现有方法难以解释稀疏奖励如何驱动Transformer学习复杂的推理过程。

- 论文分析梯度流动态,揭示了简单样本在驱动模型学习推理中的关键作用。

- 实验验证了理论结果,表明合适的训练数据分布能提升模型推理能力。

📝 摘要(中文)

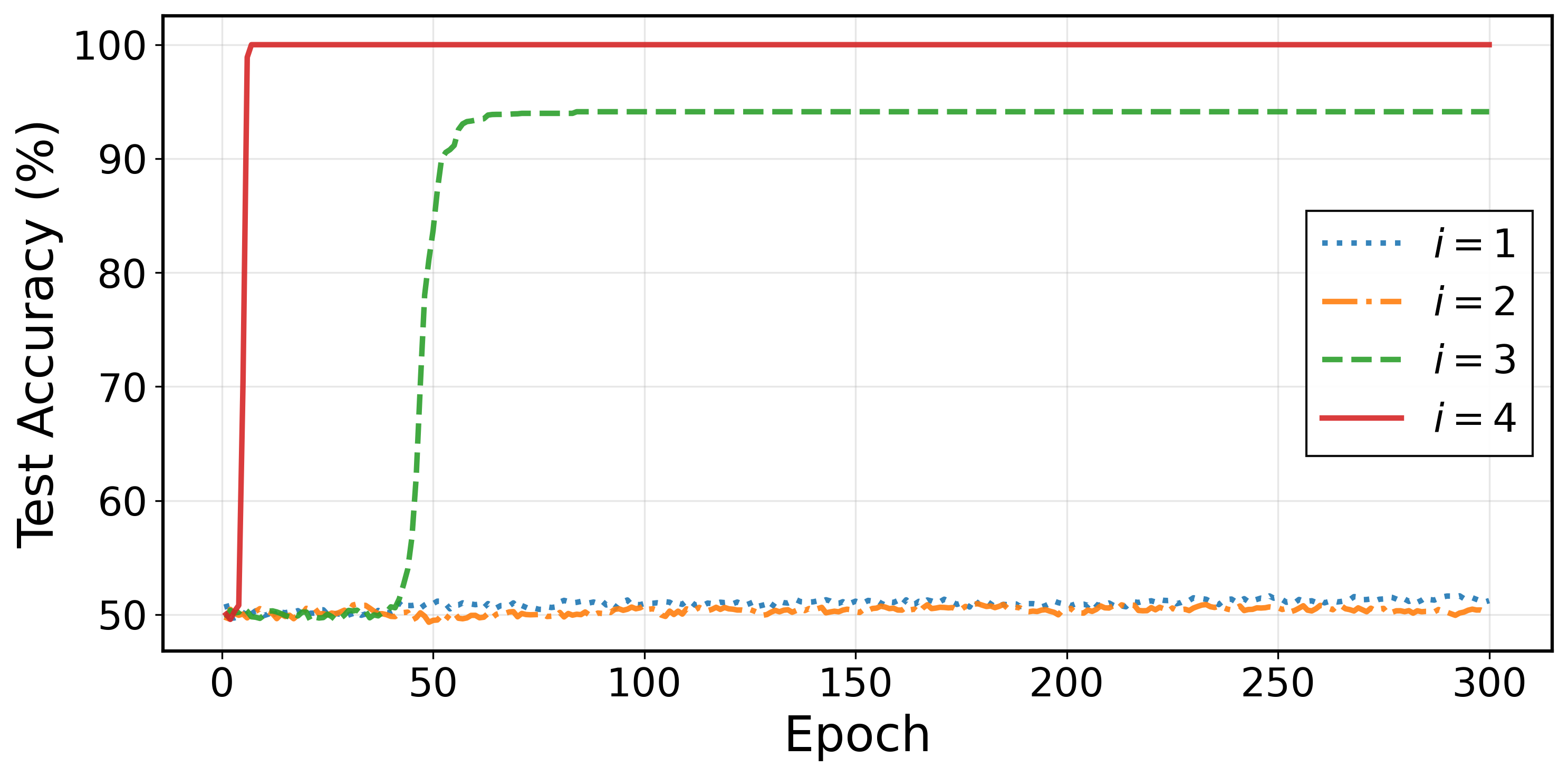

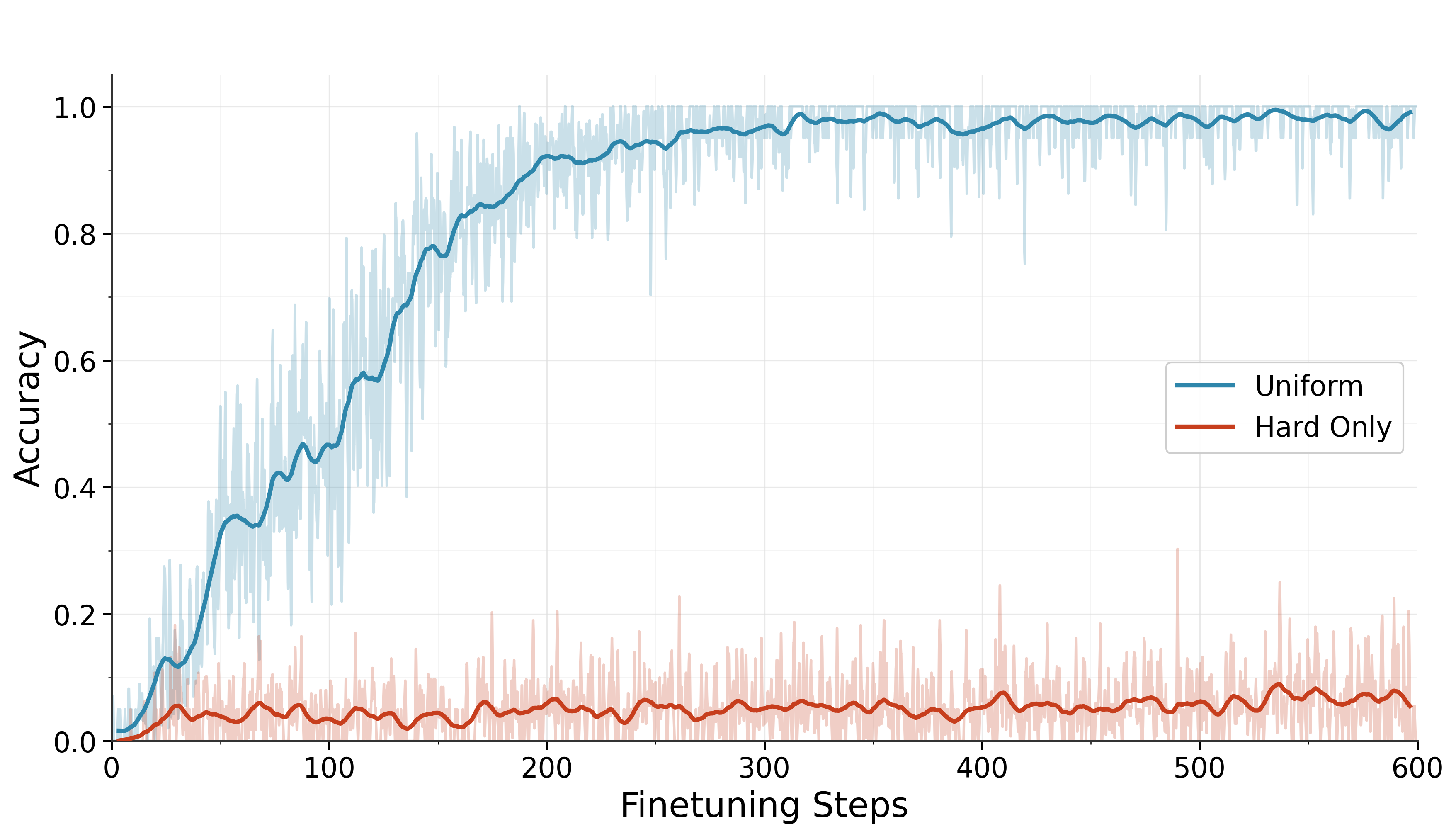

本文研究了基于结果的强化学习(RL)训练的Transformer自发产生中间推理步骤(思维链,Chain-of-Thought)的能力。尽管仅基于最终答案的正确性进行训练,但梯度下降如何驱动模型发现这种系统性推理的机制仍然不清楚。本文通过分析单层Transformer在合成图遍历任务上的梯度流动态来解决这个问题,该任务在没有CoT的情况下无法解决,但允许一个简单的迭代解决方案。证明了梯度流驱动模型收敛到一个结构化的、可解释的算法,该算法逐顶点迭代地遍历图。本文描述了这种涌现所需的分布特性,确定了“简单示例”的关键作用:需要较少推理步骤的实例。当训练分布将足够的质量放在这些更简单的实例上时,模型学习到一种可推广的遍历策略,该策略可以外推到更长的链;当这种质量消失时,基于梯度的学习变得不可行。通过在合成数据和真实世界的数学推理任务上使用真实语言模型进行的实验证实了理论结果,验证了理论发现可以推广到实际设置。

🔬 方法详解

问题定义:论文旨在理解为何以及何时基于结果的强化学习能够使Transformer模型涌现出链式思考(Chain-of-Thought, CoT)的推理能力。现有方法缺乏对这种涌现机制的深入理解,特别是稀疏奖励如何引导梯度下降发现系统性推理过程。

核心思路:核心思路是通过分析梯度流动态,揭示训练数据分布对模型学习推理能力的影响。特别关注“简单示例”(即需要较少推理步骤的实例)在训练中的作用,并证明了当训练数据中包含足够多的简单示例时,模型更容易学习到通用的推理策略。

技术框架:论文主要研究单层Transformer在合成图遍历任务上的表现。该任务被设计成必须通过CoT才能解决,但同时存在一个简单的迭代解决方案。通过分析梯度流,研究模型参数如何随着训练迭代而变化,以及如何收敛到一种可解释的算法。

关键创新:最重要的创新在于发现了“简单示例”在驱动模型学习推理能力中的关键作用。论文证明了,如果训练数据中缺乏足够多的简单示例,基于梯度的学习将变得不可行。这种发现为理解和改进基于强化学习的Transformer推理能力提供了新的视角。

关键设计:论文使用合成图遍历任务,允许精确控制训练数据的分布。通过调整训练数据中简单示例的比例,研究其对模型学习推理能力的影响。此外,论文还分析了梯度流的动态,以理解模型参数如何随着训练迭代而变化。损失函数主要基于最终答案的正确性,没有显式地对中间推理步骤进行监督。

🖼️ 关键图片

📊 实验亮点

论文通过合成数据和真实世界数学推理任务的实验,验证了理论结果。实验表明,当训练数据包含足够多的简单示例时,模型能够学习到通用的推理策略,并在更复杂的任务中表现出更好的性能。这为实际应用中如何设计训练数据提供了指导。

🎯 应用场景

该研究成果可应用于提升语言模型在数学推理、逻辑推理等复杂任务中的能力。通过合理设计训练数据,可以使模型在无需显式监督的情况下,自发地学习到链式思考的推理过程。这对于开发更智能、更可靠的AI系统具有重要意义。

📄 摘要(原文)

Transformers trained via Reinforcement Learning (RL) with outcome-based supervision can spontaneously develop the ability to generate intermediate reasoning steps (Chain-of-Thought). Yet the mechanism by which sparse rewards drive gradient descent to discover such systematic reasoning remains poorly understood. We address this by analyzing the gradient flow dynamics of single-layer Transformers on a synthetic graph traversal task that cannot be solved without Chain-of-Thought (CoT) but admits a simple iterative solution. We prove that despite training solely on final-answer correctness, gradient flow drives the model to converge to a structured, interpretable algorithm that iteratively traverses the graph vertex-by-vertex. We characterize the distributional properties required for this emergence, identifying the critical role of "simple examples": instances requiring fewer reasoning steps. When the training distribution places sufficient mass on these simpler instances, the model learns a generalizable traversal strategy that extrapolates to longer chains; when this mass vanishes, gradient-based learning becomes infeasible. We corroborate our theoretical results through experiments on synthetic data and with real-world language models on mathematical reasoning tasks, validating that our theoretical findings carry over to practical settings.