Memory Retention Is Not Enough to Master Memory Tasks in Reinforcement Learning

作者: Oleg Shchendrigin, Egor Cherepanov, Alexey K. Kovalev, Aleksandr I. Panov

分类: cs.LG, cs.AI

发布日期: 2026-01-21

备注: 11 pages, 6 figures, 7 tables

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出记忆重写基准测试,揭示现有强化学习记忆模型的局限性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 记忆重写 部分可观察性 循环神经网络 Transformer 结构化记忆 基准测试

📋 核心要点

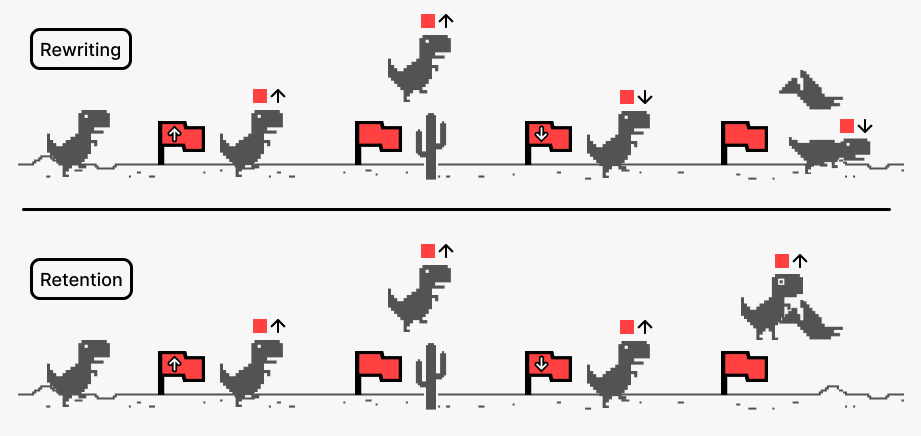

- 现有强化学习记忆模型侧重于记忆保持,忽略了记忆重写能力,无法适应动态变化的环境。

- 论文提出一个基准测试,用于评估智能体在部分可观察环境下的持续记忆更新能力,关注记忆重写。

- 实验表明,经典循环模型在记忆重写任务中优于现代结构化记忆和Transformer模型,揭示了现有方法的局限性。

📝 摘要(中文)

现实世界中有效的决策依赖于既稳定又具适应性的记忆。环境随时间变化,智能体必须在长时间内保留相关信息,并在情况变化时更新或覆盖过时的内容。现有的强化学习(RL)基准和记忆增强型智能体主要关注记忆的保持,而对同样重要的记忆重写能力却鲜有探索。为了弥补这一差距,我们引入了一个基准,该基准明确测试了部分可观察性下的持续记忆更新,即智能体必须依赖记忆而非当前观察的自然环境,并使用它来比较循环、基于Transformer和结构化记忆架构。实验表明,经典的循环模型尽管简单,但在记忆重写任务中表现出比现代结构化记忆更大的灵活性和鲁棒性,后者仅在狭窄的条件下成功,而基于Transformer的智能体通常在简单的保持案例之外失败。这些发现揭示了当前方法的一个根本局限性,并强调了平衡稳定保持和自适应更新的记忆机制的必要性。我们的工作突出了这一被忽视的挑战,引入了评估它的基准,并为设计具有显式和可训练遗忘机制的未来RL智能体提供了见解。

🔬 方法详解

问题定义:现有强化学习方法在处理需要长期记忆的任务时,往往侧重于如何稳定地保持记忆,而忽略了在环境变化时如何有效地更新或重写记忆。这导致智能体难以适应动态变化的环境,尤其是在部分可观察的环境中,智能体必须依赖不完整的历史信息进行决策。现有方法的痛点在于缺乏对记忆重写能力的有效评估和优化。

核心思路:论文的核心思路是设计一个基准测试,该测试能够明确地评估智能体在部分可观察环境下的持续记忆更新能力。通过该基准,可以比较不同记忆架构(如循环神经网络、Transformer和结构化记忆)在记忆重写任务中的表现,从而揭示现有方法的优缺点,并为未来设计更有效的记忆机制提供指导。这种设计思路强调了记忆的适应性,即智能体不仅要能够记住过去的信息,还要能够根据当前环境的变化来更新或重写记忆。

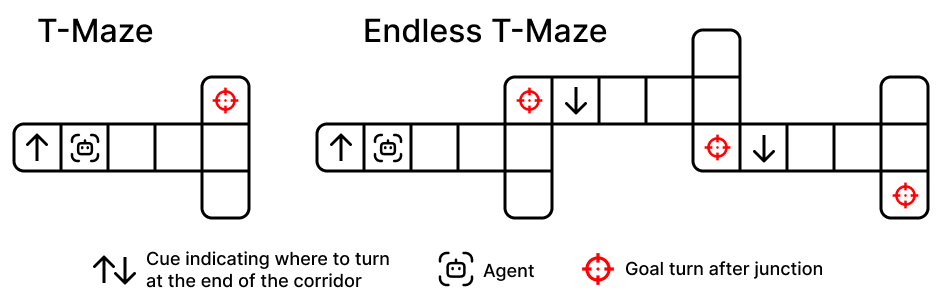

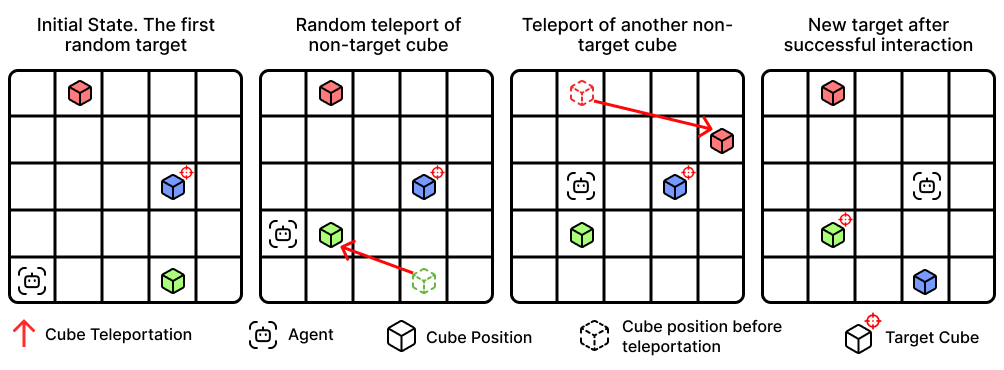

技术框架:论文提出的基准测试包含一系列部分可观察的环境,在这些环境中,智能体需要根据历史信息和当前观察来做出决策。智能体的整体架构包括一个记忆模块(可以是循环神经网络、Transformer或结构化记忆)和一个决策模块。智能体通过与环境交互,不断更新记忆,并根据记忆做出决策。评估指标主要关注智能体在记忆重写任务中的表现,例如,智能体是否能够正确地更新记忆,以及更新后的记忆是否能够帮助智能体做出更好的决策。

关键创新:论文最重要的技术创新点在于提出了一个专门用于评估记忆重写能力的基准测试。与现有的强化学习基准测试不同,该基准测试明确地关注智能体在部分可观察环境下的持续记忆更新能力。这种关注点的转变使得研究人员能够更深入地了解现有记忆模型的局限性,并为未来设计更有效的记忆机制提供指导。与现有方法的本质区别在于,该基准测试不仅关注记忆的保持,更关注记忆的适应性。

关键设计:基准测试的关键设计包括:1) 部分可观察的环境,使得智能体必须依赖记忆而非当前观察;2) 持续的记忆更新,使得智能体需要不断地更新或重写记忆;3) 多种记忆架构的比较,包括循环神经网络、Transformer和结构化记忆;4) 明确的评估指标,用于评估智能体在记忆重写任务中的表现。具体的参数设置、损失函数和网络结构取决于所使用的记忆架构。例如,对于循环神经网络,可以使用LSTM或GRU单元;对于Transformer,可以使用多头注意力机制;对于结构化记忆,可以使用神经图灵机或可微神经计算机。

🖼️ 关键图片

📊 实验亮点

实验结果表明,经典的循环模型(如LSTM)在记忆重写任务中表现出比现代结构化记忆和Transformer模型更大的灵活性和鲁棒性。结构化记忆仅在狭窄的条件下成功,而Transformer模型通常在简单的保持案例之外失败。这些结果揭示了现有记忆模型的局限性,并强调了平衡稳定保持和自适应更新的记忆机制的必要性。

🎯 应用场景

该研究成果可应用于需要智能体具备长期记忆和适应性学习能力的领域,如机器人导航、对话系统、游戏AI等。通过提升智能体的记忆重写能力,可以使其更好地适应动态变化的环境,从而做出更明智的决策。未来,该研究有望推动开发更智能、更灵活的AI系统。

📄 摘要(原文)

Effective decision-making in the real world depends on memory that is both stable and adaptive: environments change over time, and agents must retain relevant information over long horizons while also updating or overwriting outdated content when circumstances shift. Existing Reinforcement Learning (RL) benchmarks and memory-augmented agents focus primarily on retention, leaving the equally critical ability of memory rewriting largely unexplored. To address this gap, we introduce a benchmark that explicitly tests continual memory updating under partial observability, i.e. the natural setting where an agent must rely on memory rather than current observations, and use it to compare recurrent, transformer-based, and structured memory architectures. Our experiments reveal that classic recurrent models, despite their simplicity, demonstrate greater flexibility and robustness in memory rewriting tasks than modern structured memories, which succeed only under narrow conditions, and transformer-based agents, which often fail beyond trivial retention cases. These findings expose a fundamental limitation of current approaches and emphasize the necessity of memory mechanisms that balance stable retention with adaptive updating. Our work highlights this overlooked challenge, introduces benchmarks to evaluate it, and offers insights for designing future RL agents with explicit and trainable forgetting mechanisms. Code: https://quartz-admirer.github.io/Memory-Rewriting/