HyperNet-Adaptation for Diffusion-Based Test Case Generation

作者: Oliver Weißl, Vincenzo Riccio, Severin Kacianka, Andrea Stocco

分类: cs.LG, cs.SE

发布日期: 2026-01-21

💡 一句话要点

提出HyNeA,通过超网络自适应扩散模型,高效生成深度学习测试用例

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 扩散模型 超网络 测试用例生成 深度学习测试 对抗样本 生成式模型 无监督学习

📋 核心要点

- 现有对抗攻击主要评估鲁棒性,生成式方法受限于简单数据集或高计算成本,难以有效评估深度学习系统的可靠性。

- HyNeA利用超网络实现对扩散模型生成过程的直接控制,无需微调或特定架构的调节,从而实现无数据集的可控性。

- HyNeA通过实例级调整策略,能够以较低的计算成本生成真实的故障用例,并在缺乏故障标记数据时仍能有效工作。

📝 摘要(中文)

深度学习系统日益广泛的应用需要对其在真实场景中的可靠性进行系统评估。传统的基于梯度的对抗攻击引入的微小扰动很少对应于真实的故障,主要评估的是鲁棒性而非功能行为。生成式测试用例生成方法提供了一种替代方案,但通常仅限于简单的数据集或受限的输入域。虽然扩散模型能够实现高保真图像合成,但其计算成本和有限的可控性限制了它们在大规模测试中的应用。我们提出了一种生成式测试方法HyNeA,它能够直接有效地控制基于扩散的生成过程。HyNeA通过超网络提供无数据集的可控性,允许对生成过程进行有针对性的操作,而无需依赖于特定于架构的调节机制或数据集驱动的自适应,例如微调。HyNeA采用了一种独特的训练策略,支持实例级别的调整,以识别诱导故障的测试用例,而无需数据集显式包含类似故障的示例。与基于搜索的方法相比,这种方法能够以显著更低的计算成本有针对性地生成真实的故障用例。实验结果表明,与现有的生成式测试生成器相比,HyNeA提高了可控性和测试多样性,并且可以推广到缺乏故障标记训练数据的领域。

🔬 方法详解

问题定义:论文旨在解决深度学习系统测试中,现有方法(如对抗攻击和传统生成式测试)无法有效生成真实、多样且可控的测试用例的问题。对抗攻击产生的扰动通常不真实,而传统生成式方法受限于数据集或计算资源,难以进行大规模测试。

核心思路:论文的核心思路是利用超网络(HyperNetwork)来控制扩散模型的生成过程,从而实现对生成结果的精细化控制。通过训练超网络,可以根据目标需求调整扩散模型的参数,生成特定的测试用例,而无需对原始扩散模型进行微调或依赖大量标注数据。

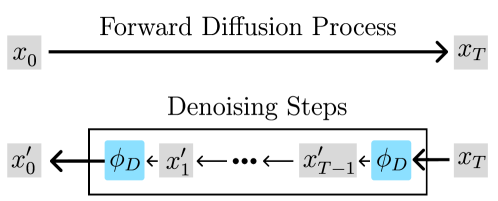

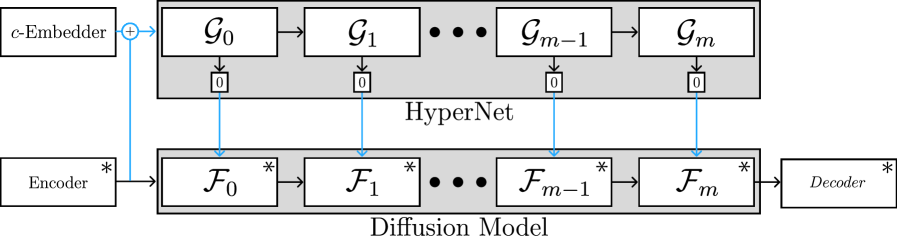

技术框架:HyNeA包含两个主要模块:预训练的扩散模型和一个超网络。首先,使用标准方法训练一个扩散模型,使其能够生成高质量的图像。然后,训练一个超网络,该超网络以目标条件(例如,期望的故障类型)作为输入,并输出扩散模型的参数。在生成测试用例时,将目标条件输入超网络,超网络生成相应的扩散模型参数,然后使用这些参数运行扩散模型,生成符合目标条件的测试用例。

关键创新:HyNeA的关键创新在于使用超网络来实现对扩散模型生成过程的解耦控制。与直接微调扩散模型或使用条件生成对抗网络(GAN)相比,超网络方法具有更高的灵活性和可控性,并且不需要大量标注数据。此外,HyNeA的训练策略支持实例级别的调整,能够针对特定故障进行优化。

关键设计:超网络的设计至关重要,需要能够有效地将目标条件映射到扩散模型的参数空间。论文中可能使用了特定的网络结构(例如,卷积神经网络或Transformer)来实现超网络。损失函数的设计也需要仔细考虑,以确保生成的测试用例能够有效地诱导目标系统的故障。具体的参数设置、损失函数和网络结构等细节在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HyNeA在可控性和测试多样性方面优于现有的生成式测试生成器。HyNeA能够生成更真实的故障用例,并且可以推广到缺乏故障标记训练数据的领域。具体的性能数据和对比基线在论文中应该有更详细的描述(未知)。

🎯 应用场景

HyNeA可应用于各种深度学习系统的测试和验证,例如自动驾驶、医疗诊断和安全监控等领域。通过生成具有挑战性的测试用例,可以发现系统潜在的缺陷和漏洞,提高系统的可靠性和安全性。该方法尤其适用于缺乏故障标注数据的场景,具有重要的实际应用价值。

📄 摘要(原文)

The increasing deployment of deep learning systems requires systematic evaluation of their reliability in real-world scenarios. Traditional gradient-based adversarial attacks introduce small perturbations that rarely correspond to realistic failures and mainly assess robustness rather than functional behavior. Generative test generation methods offer an alternative but are often limited to simple datasets or constrained input domains. Although diffusion models enable high-fidelity image synthesis, their computational cost and limited controllability restrict their applicability to large-scale testing. We present HyNeA, a generative testing method that enables direct and efficient control over diffusion-based generation. HyNeA provides dataset-free controllability through hypernetworks, allowing targeted manipulation of the generative process without relying on architecture-specific conditioning mechanisms or dataset-driven adaptations such as fine-tuning. HyNeA employs a distinct training strategy that supports instance-level tuning to identify failure-inducing test cases without requiring datasets that explicitly contain examples of similar failures. This approach enables the targeted generation of realistic failure cases at substantially lower computational cost than search-based methods. Experimental results show that HyNeA improves controllability and test diversity compared to existing generative test generators and generalizes to domains where failure-labeled training data is unavailable.