Attention-Based Offline Reinforcement Learning and Clustering for Interpretable Sepsis Treatment

作者: Punit Kumar, Vaibhav Saran, Divyesh Patel, Nitin Kulkarni, Alina Vereshchaka

分类: cs.LG

发布日期: 2026-01-20

备注: 8 pages, 6 figures, Conference: IEEE International Conference on Machine Learning and Applications 2025 (ICMLA 2025): https://www.icmla-conference.org/icmla25/

💡 一句话要点

提出基于注意力机制的离线强化学习与聚类方法,用于可解释的脓毒症治疗决策支持。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 脓毒症治疗 离线强化学习 聚类分析 数据增强 可解释性AI 临床决策支持 注意力机制

📋 核心要点

- 脓毒症是ICU死亡的主要原因之一,现有方法缺乏对治疗决策的精准性和可解释性。

- 该方法结合聚类、数据增强、离线强化学习和大型语言模型,提供个性化且可解释的治疗方案。

- 在MIMIC-III和eICU数据集上验证,该方法提高了治疗准确性,并提供了可解释的治疗建议。

📝 摘要(中文)

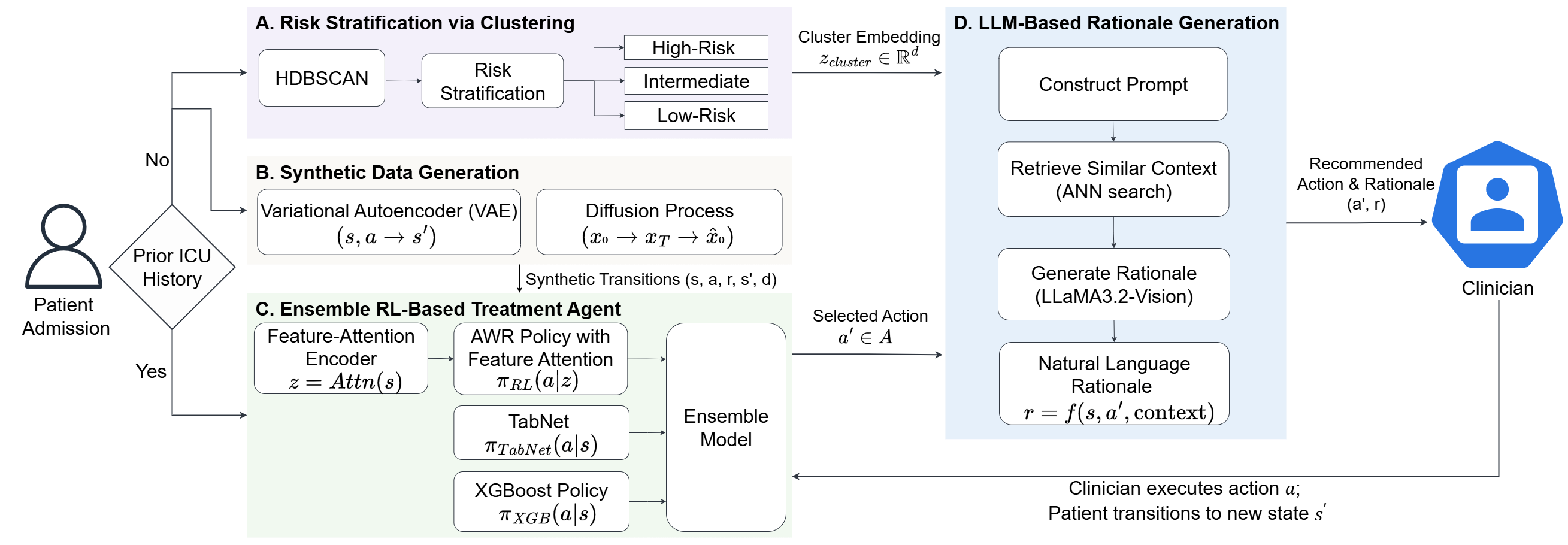

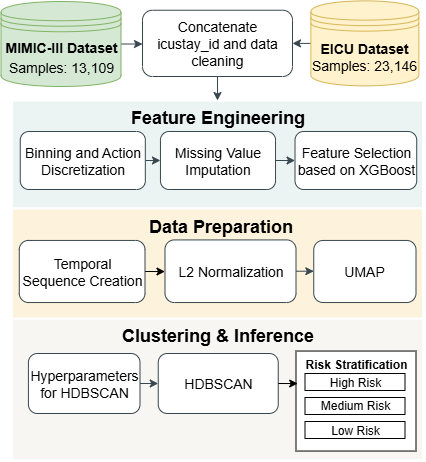

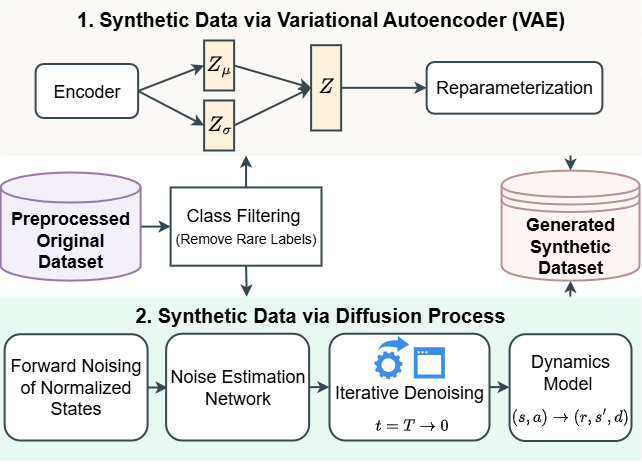

本研究提出了一种可解释的决策支持框架,用于脓毒症治疗。该系统包含四个核心模块:(1) 基于聚类的分层模块,利用统计验证将患者分为低、中、高风险组;(2) 合成数据增强管道,利用变分自编码器(VAE)和扩散模型来丰富流体或血管加压药管理等代表性不足的轨迹;(3) 离线强化学习(RL)智能体,使用带有轻量级注意力编码器的优势加权回归(AWR)进行训练,并由集成模型支持,以提供保守、安全意识的治疗建议;(4) 理由生成模块,由多模态大型语言模型(LLM)驱动,生成基于临床背景和检索到的专家知识的自然语言解释。在MIMIC-III和eICU数据集上的评估表明,该方法实现了较高的治疗准确率,同时为临床医生提供了可解释且稳健的策略建议。

🔬 方法详解

问题定义:脓毒症治疗决策需要快速、准确且可解释。现有方法在处理数据稀疏性、提供个性化治疗方案以及解释决策依据方面存在不足,导致临床医生难以信任和采纳。

核心思路:通过聚类将患者分层,利用数据增强解决数据稀疏问题,使用离线强化学习学习治疗策略,并借助大型语言模型生成可解释的治疗理由。这种多模块协同的方式旨在提高治疗准确性,并增强临床医生的信任度。

技术框架:该框架包含四个主要模块:1) 基于聚类的患者分层模块;2) 基于VAE和扩散模型的合成数据增强模块;3) 基于AWR的离线强化学习智能体,使用注意力编码器;4) 基于多模态LLM的理由生成模块。整体流程是从患者数据输入开始,经过分层、数据增强,训练强化学习智能体,最终生成治疗建议和解释。

关键创新:该方法将聚类、数据增强、离线强化学习和大型语言模型相结合,形成一个完整的可解释决策支持系统。特别地,使用注意力机制的AWR和多模态LLM的理由生成模块是关键创新点,前者提高了策略学习的效率,后者提供了可信的决策解释。

关键设计:聚类模块使用统计验证方法确定最佳聚类数量。数据增强模块使用VAE和扩散模型生成高质量的合成数据。AWR智能体使用轻量级注意力编码器来关注重要的临床变量。LLM使用临床背景和检索到的专家知识来生成自然语言解释。

🖼️ 关键图片

📊 实验亮点

该方法在MIMIC-III和eICU数据集上取得了显著的治疗准确率,并提供了可解释的治疗建议。通过合成数据增强,有效解决了数据稀疏问题,提高了强化学习智能体的性能。LLM生成的理由为临床医生提供了决策依据,增强了治疗方案的可信度。

🎯 应用场景

该研究成果可应用于临床决策支持系统,辅助医生进行脓毒症的早期诊断和治疗方案制定。通过提供个性化、可解释的治疗建议,有望提高脓毒症患者的生存率,并降低医疗成本。未来可扩展到其他危重疾病的治疗决策支持。

📄 摘要(原文)

Sepsis remains one of the leading causes of mortality in intensive care units, where timely and accurate treatment decisions can significantly impact patient outcomes. In this work, we propose an interpretable decision support framework. Our system integrates four core components: (1) a clustering-based stratification module that categorizes patients into low, intermediate, and high-risk groups upon ICU admission, using clustering with statistical validation; (2) a synthetic data augmentation pipeline leveraging variational autoencoders (VAE) and diffusion models to enrich underrepresented trajectories such as fluid or vasopressor administration; (3) an offline reinforcement learning (RL) agent trained using Advantage Weighted Regression (AWR) with a lightweight attention encoder and supported by an ensemble models for conservative, safety-aware treatment recommendations; and (4) a rationale generation module powered by a multi-modal large language model (LLM), which produces natural-language justifications grounded in clinical context and retrieved expert knowledge. Evaluated on the MIMIC-III and eICU datasets, our approach achieves high treatment accuracy while providing clinicians with interpretable and robust policy recommendations.