Multi-Objective Hierarchical Optimization with Large Language Models

作者: Andrej Schwanke, Lyubomir Ivanov, David Salinas, Frank Hutter, Arber Zela

分类: cs.LG

发布日期: 2026-01-20

备注: 23 pages, 21 figures, 9 tables

💡 一句话要点

提出基于大语言模型的多目标分层优化方法,提升复杂问题求解效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多目标优化 大语言模型 分层搜索 代理模型 帕累托前沿

📋 核心要点

- 现有方法在多目标优化中依赖数值输入和全局建模,大语言模型难以直接应用。

- 论文提出分层搜索策略,利用大语言模型在局部子空间生成候选解,降低问题复杂度。

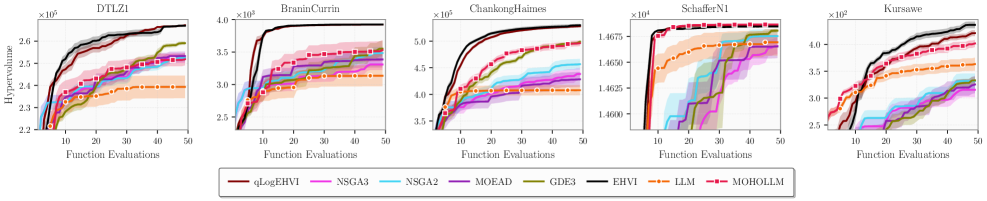

- 实验结果表明,该方法在合成和真实数据集上优于全局LLM优化器,与传统方法相当。

📝 摘要(中文)

尽管大语言模型(LLM)在各个领域得到广泛应用,尤其是在推理能力方面,但它们并非多目标优化的首选。传统策略在基准测试中表现出色,这归功于它们处理数值输入的能力,以及平衡探索和帕累托前沿利用的建模选择,以及处理多个(冲突)目标的能力。本文通过利用LLM作为代理模型和候选采样器,构建了一种结构化的分层搜索策略,从而弥补了这一差距。通过自适应地将输入空间划分为不相交的超矩形区域,并使用复合评分函数对它们进行排序,我们将LLM的生成过程限制在特定的、高潜力子空间中,从而使问题更容易解决,因为LLM不必推理问题的全局结构,而只需在局部进行推理。我们证明,在标准正则性假设下,我们的算法生成的候选解在Hausdorff距离上收敛到真实的帕累托集。在合成和真实世界的基准测试中,经验表明,它始终优于基于全局LLM的多目标优化器,并且与标准进化和贝叶斯优化算法相当。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)在多目标优化问题中的应用难题。传统多目标优化方法擅长处理数值输入,并具备良好的探索-利用平衡机制,而LLM通常难以直接应用于此类问题,尤其是在处理具有多个冲突目标的情况下。现有的基于LLM的全局优化方法难以有效探索整个解空间,效率较低。

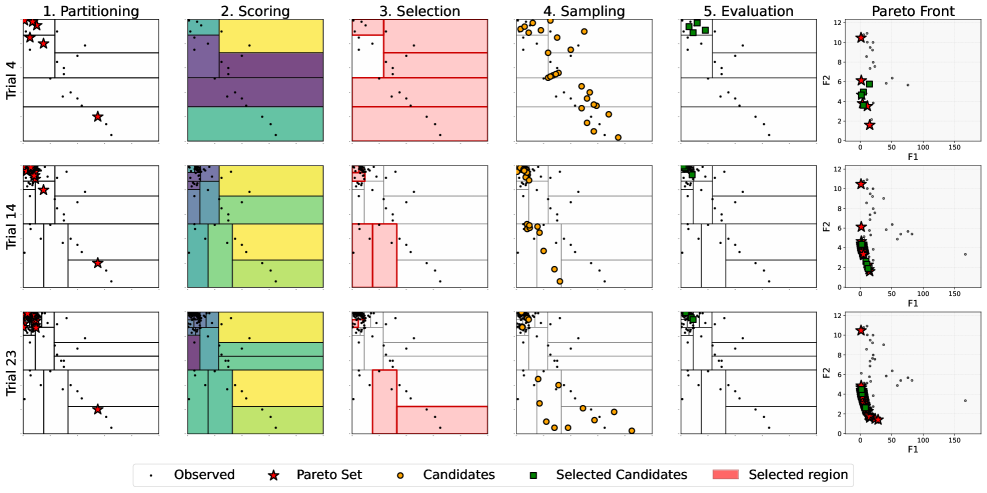

核心思路:论文的核心思路是将多目标优化问题分解为一系列局部子问题,利用LLM在这些局部子空间中生成候选解。通过分层搜索策略,自适应地将输入空间划分为多个超矩形区域,并利用复合评分函数对这些区域进行排序,从而引导LLM关注高潜力区域。这种局部优化的方式降低了LLM需要推理的复杂性,使其能够更有效地生成高质量的候选解。

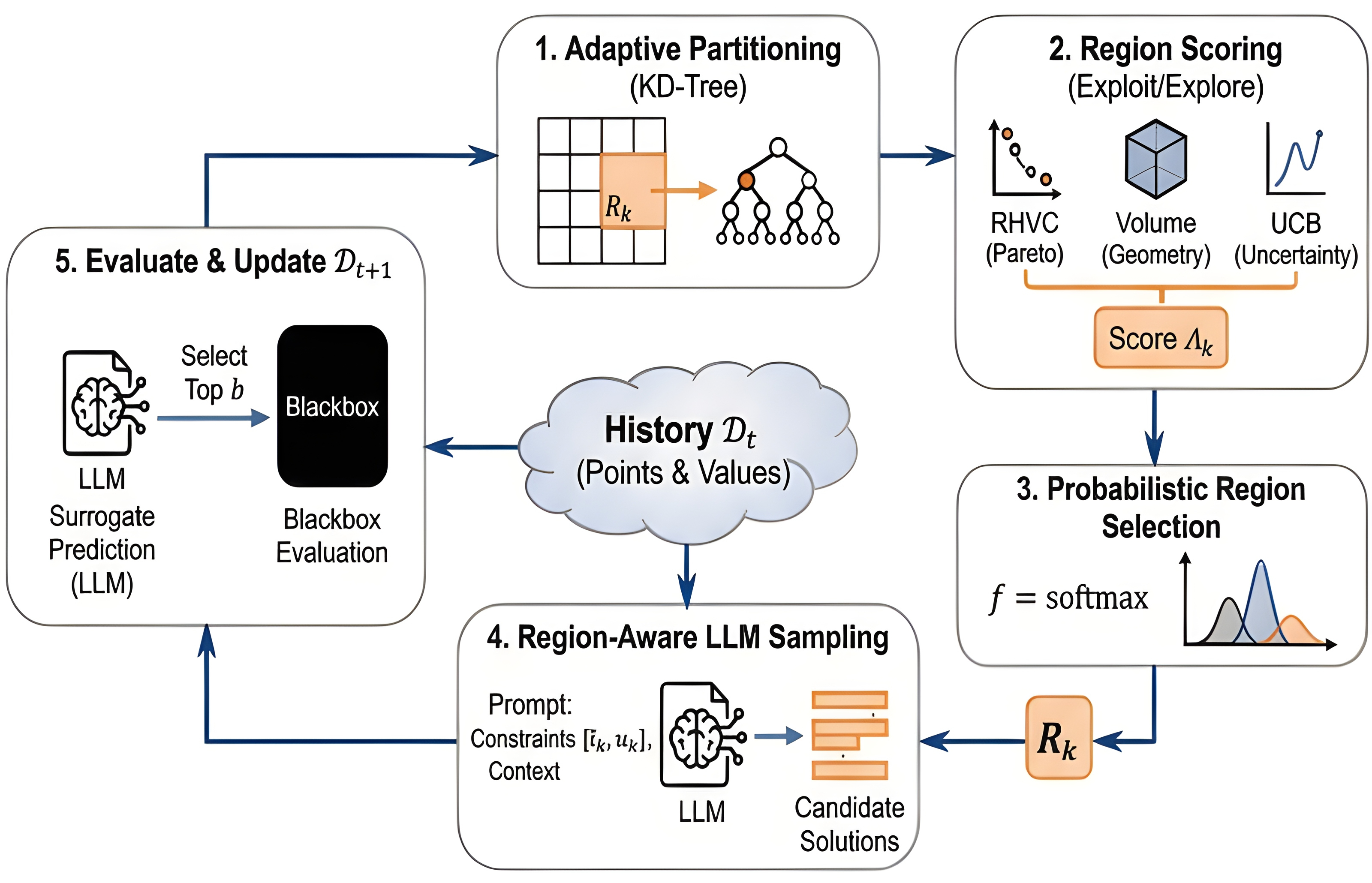

技术框架:整体框架包含以下几个主要阶段:1) 空间划分:将输入空间划分为多个不相交的超矩形区域。2) 区域排序:使用复合评分函数对这些区域进行排序,评估其潜力。3) LLM采样:在选定的高潜力区域内,利用LLM生成候选解。4) 解评估:评估生成的候选解的目标函数值。5) 迭代优化:重复上述步骤,不断优化解空间,最终逼近帕累托前沿。

关键创新:最重要的创新点在于将分层搜索策略与LLM相结合,实现了局部优化。与全局LLM优化方法相比,该方法能够更有效地探索解空间,避免了LLM在全局范围内进行推理的困难。此外,自适应的空间划分和区域排序机制能够引导LLM关注高潜力区域,提高了采样效率。

关键设计:论文中关键的设计包括:1) 复合评分函数:用于评估每个超矩形区域的潜力,综合考虑了区域内的目标函数值、不确定性等因素。2) 自适应空间划分策略:根据优化过程中的信息,动态调整超矩形区域的大小和位置。3) LLM采样策略:在选定的区域内,利用LLM生成候选解,可以采用不同的采样方法,如基于提示的生成、基于约束的生成等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在合成和真实数据集上均取得了显著的性能提升。与基于全局LLM的多目标优化器相比,该方法表现更优。在某些基准测试中,该方法甚至可以与传统的进化算法和贝叶斯优化算法相媲美,证明了其有效性和竞争力。

🎯 应用场景

该研究成果可应用于各种需要多目标优化的领域,例如:自动机器学习(AutoML)中的超参数优化、药物发现中的分子设计、机器人控制中的轨迹规划等。通过利用LLM的强大生成能力和分层搜索策略的效率,可以更有效地解决复杂的优化问题,提升相关领域的研发效率。

📄 摘要(原文)

Despite their widespread adoption in various domains, especially due to their powerful reasoning capabilities, Large Language Models (LLMs) are not the off-the-shelf choice to drive multi-objective optimization yet. Conventional strategies rank high in benchmarks due to their intrinsic capabilities to handle numerical inputs and careful modelling choices that balance exploration and Pareto-front exploitation, as well as handle multiple (conflicting) objectives. In this paper, we close this gap by leveraging LLMs as surrogate models and candidate samplers inside a structured hierarchical search strategy. By adaptively partitioning the input space into disjoint hyperrectangular regions and ranking them with a composite score function, we restrict the generative process of the LLM to specific, high-potential sub-spaces, hence making the problem easier to solve as the LLM doesn't have to reason about the global structure of the problem, but only locally instead. We show that under standard regularity assumptions, our algorithm generates candidate solutions that converge to the true Pareto set in Hausdorff distance. Empirically, it consistently outperforms the global LLM-based multi-objective optimizer and is on par with standard evolutionary and Bayesian optimization algorithm on synthetic and real-world benchmarks.