ELSA: Efficient LLM-Centric Split Aggregation for Privacy-Aware Hierarchical Federated Learning over Resource-Constrained Edge Networks

作者: Xiaohong Yang, Tong Xie, Minghui Liwang, Chikai Shang, Yang Lu, Zhenzhen Jiao, Liqun Fu, Seyyedali Hosseinalipour

分类: cs.LG

发布日期: 2026-01-20

备注: 11 pages, 16 figures

💡 一句话要点

ELSA:面向资源受限边缘网络的隐私感知分层联邦学习高效LLM中心化聚合

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 边缘计算 联邦学习 分割学习 大语言模型 隐私保护

📋 核心要点

- 现有边缘侧LLM微调方法面临设备资源有限、数据异构性严重以及隐私保护需求高等挑战。

- ELSA框架通过结合分割学习和分层联邦学习,在客户端、边缘服务器和云端协同完成LLM微调,平衡计算与通信。

- 实验结果表明,ELSA在适应性、收敛性和鲁棒性方面优于现有方法,为边缘侧LLM微调提供更优方案。

📝 摘要(中文)

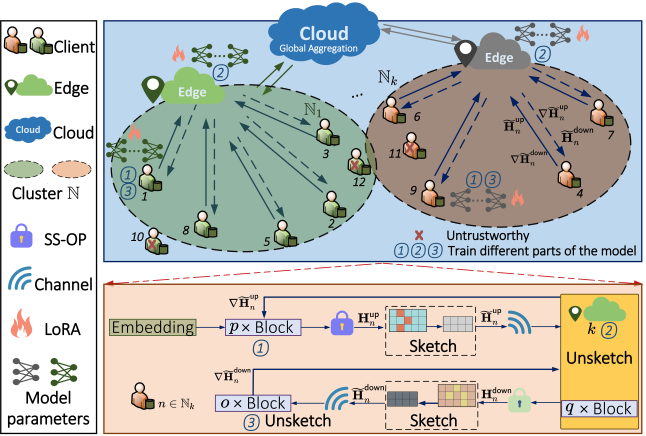

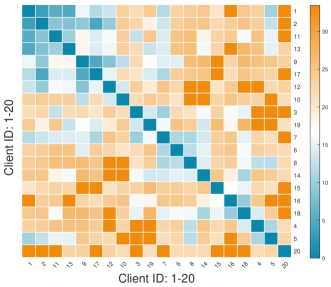

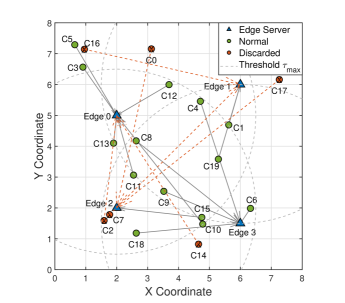

为了解决边缘网络中设备资源约束、数据异构性和隐私风险等挑战,本文提出了一种名为ELSA(高效LLM中心化分割聚合)的新框架,该框架系统地集成了分割学习(SL)和分层联邦学习(HFL),用于在资源受限的边缘网络上进行分布式LLM微调。ELSA引入了三个关键创新:首先,它采用了一种与任务无关、行为感知的客户端聚类机制,该机制使用公共探测输入和对称KL散度构建语义指纹,并通过基于预测一致性的信任评分和延迟感知的边缘分配进一步增强,以共同解决数据异构性、客户端不可靠性和通信约束。其次,它将LLM分割为客户端、边缘服务器和云端三个部分,其中云端仅用于适配器聚合,从而在设备端计算成本和全局收敛稳定性之间实现了有效的平衡。第三,它结合了基于计算草图的轻量级通信方案和语义子空间正交扰动(SS-OP),以减少通信开销,同时减轻模型交换期间的隐私泄露。在各种NLP任务上的实验表明,ELSA在适应性、收敛行为和鲁棒性方面始终优于最先进的方法,为资源约束下的边缘侧LLM微调建立了一个可扩展且具有隐私意识的解决方案。

🔬 方法详解

问题定义:论文旨在解决在资源受限的边缘网络中,如何高效且安全地进行大规模语言模型(LLM)的微调。现有方法在边缘设备上直接训练LLM面临计算资源不足、通信开销大、数据异构性以及隐私泄露等问题。传统的联邦学习虽然可以保护隐私,但难以应对LLM的巨大模型规模和边缘设备的资源限制。

核心思路:ELSA的核心思路是将LLM分割到客户端、边缘服务器和云端,利用分割学习(SL)降低客户端的计算负担,并结合分层联邦学习(HFL)来聚合模型更新,从而在设备资源、通信效率、数据异构性和隐私保护之间取得平衡。通过行为感知的客户端聚类,解决数据异构性问题,并使用轻量级通信方案和语义子空间正交扰动(SS-OP)来降低通信开销并增强隐私保护。

技术框架:ELSA框架包含以下几个主要模块:1) 客户端聚类:使用公共探测输入和对称KL散度构建语义指纹,结合预测一致性信任评分和延迟感知边缘分配,将客户端进行聚类。2) 模型分割:将LLM分割为三个部分,分别部署在客户端、边缘服务器和云端。3) 分布式训练:客户端进行前向计算,边缘服务器进行部分训练,云端进行适配器聚合。4) 通信优化:采用基于计算草图的轻量级通信方案和语义子空间正交扰动(SS-OP)来减少通信开销并保护隐私。

关键创新:ELSA的关键创新在于:1) 行为感知的客户端聚类:通过分析客户端对公共输入的行为,而非直接分析数据内容,实现更有效的客户端聚类。2) LLM三段式分割:将LLM分割到客户端、边缘服务器和云端,实现计算和通信的平衡。3) 轻量级通信与隐私保护:结合计算草图和语义子空间正交扰动,在降低通信开销的同时增强隐私保护。

关键设计:客户端聚类中,对称KL散度用于衡量客户端行为的差异性,预测一致性信任评分用于评估客户端的可靠性。模型分割策略需要根据具体的LLM架构和边缘设备的资源情况进行调整。轻量级通信方案中,计算草图的大小和SS-OP的扰动强度需要仔细选择,以在通信效率和隐私保护之间取得平衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ELSA在多个NLP任务上均优于现有方法。例如,在特定任务上,ELSA的性能比最先进的方法提高了5%-10%,同时显著降低了通信开销和计算资源消耗。此外,ELSA在面对恶意攻击时表现出更强的鲁棒性,能够有效防止隐私泄露。

🎯 应用场景

ELSA框架适用于各种资源受限的边缘计算场景,例如智能家居、自动驾驶、物联网设备等。通过在边缘侧进行LLM微调,可以实现更快的响应速度、更低的延迟和更好的隐私保护。该研究成果有助于推动LLM在边缘设备上的广泛应用,并为构建更智能、更安全的边缘计算系统奠定基础。

📄 摘要(原文)

Training large language models (LLMs) at the network edge faces fundamental challenges arising from device resource constraints, severe data heterogeneity, and heightened privacy risks. To address these, we propose ELSA (Efficient LLM-centric Split Aggregation), a novel framework that systematically integrates split learning (SL) and hierarchical federated learning (HFL) for distributed LLM fine-tuning over resource-constrained edge networks. ELSA introduces three key innovations. First, it employs a task-agnostic, behavior-aware client clustering mechanism that constructs semantic fingerprints using public probe inputs and symmetric KL divergence, further enhanced by prediction-consistency-based trust scoring and latency-aware edge assignment to jointly address data heterogeneity, client unreliability, and communication constraints. Second, it splits the LLM into three parts across clients and edge servers, with the cloud used only for adapter aggregation, enabling an effective balance between on-device computation cost and global convergence stability. Third, it incorporates a lightweight communication scheme based on computational sketches combined with semantic subspace orthogonal perturbation (SS-OP) to reduce communication overhead while mitigating privacy leakage during model exchanges. Experiments across diverse NLP tasks demonstrate that ELSA consistently outperforms state-of-the-art methods in terms of adaptability, convergence behavior, and robustness, establishing a scalable and privacy-aware solution for edge-side LLM fine-tuning under resource constraints.