On the Relation of State Space Models and Hidden Markov Models

作者: Aydin Ghojogh, M. Hadi Sepanj, Benyamin Ghojogh

分类: cs.LG, cs.CL, eess.AS, eess.SY

发布日期: 2026-01-19

💡 一句话要点

统一框架对比隐马尔可夫模型与状态空间模型,桥接控制理论、概率建模与深度学习。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 状态空间模型 隐马尔可夫模型 卡尔曼滤波 序列建模 概率图模型

📋 核心要点

- 现有序列数据建模方法如HMM和传统SSM,在处理复杂依赖和高维数据时存在局限性,而新兴的NLP SSM模型关系尚不明确。

- 论文通过概率图模型视角,系统比较HMM、线性高斯SSM、卡尔曼滤波及现代NLP SSM,揭示其结构相似性和语义差异。

- 论文分析了不同模型的推理算法和学习过程,阐明了模型等价性、差异性以及现代NLP SSM与经典概率模型的关系。

📝 摘要(中文)

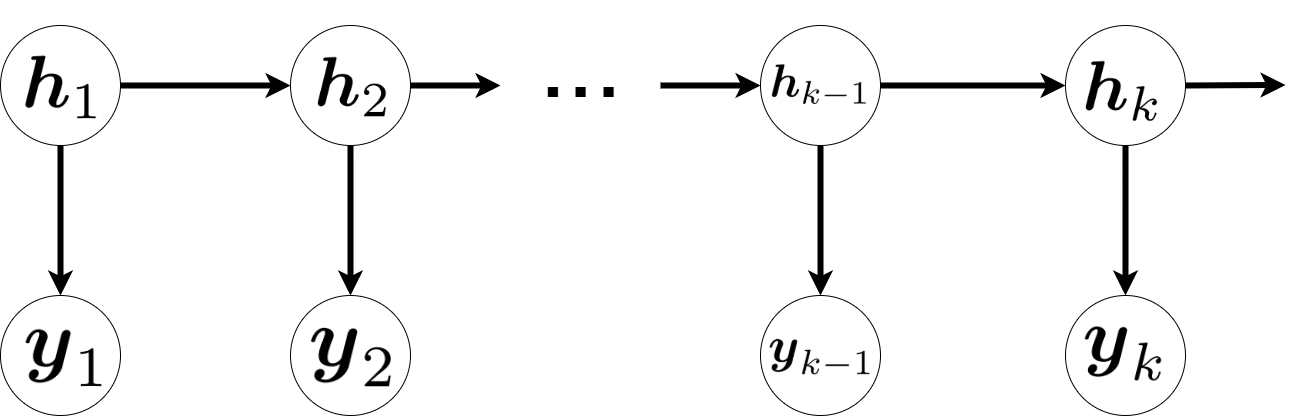

状态空间模型(SSMs)和隐马尔可夫模型(HMMs)是建模具有潜在变量的序列数据的基本框架,广泛应用于信号处理、控制理论和机器学习。尽管它们具有共享的时间结构,但它们在潜在状态的性质、概率假设、推理过程和训练范式上存在根本差异。最近,确定性状态空间模型通过S4和Mamba等架构在自然语言处理中重新出现,引发了关于经典概率SSM、HMM和现代神经序列模型之间关系的新问题。本文对HMM、线性高斯状态空间模型、卡尔曼滤波和现代NLP状态空间模型进行了统一和系统的比较。我们通过概率图模型的视角分析了它们的公式,检查了它们的推理算法(包括前向-后向推理和卡尔曼滤波),并通过期望最大化和基于梯度的优化对比了它们的学习过程。通过强调结构上的相似性和语义上的差异,我们阐明了这些模型何时等价,何时根本不同,以及现代NLP SSM与经典概率模型的关系。我们的分析桥接了控制理论、概率建模和现代深度学习的视角。

🔬 方法详解

问题定义:论文旨在解决对隐马尔可夫模型(HMMs)、经典状态空间模型(SSMs)以及近年来在自然语言处理(NLP)领域兴起的基于深度学习的状态空间模型(如S4和Mamba)之间的关系缺乏系统性理解的问题。现有方法通常孤立地研究这些模型,未能充分揭示它们之间的内在联系和差异,阻碍了研究人员在不同应用场景下选择和改进模型的效率。

核心思路:论文的核心思路是通过统一的概率图模型视角,对HMMs、线性高斯SSMs、卡尔曼滤波以及现代NLP SSMs进行系统性的比较分析。通过这种比较,论文旨在揭示这些模型在结构、推理算法和学习过程上的相似性和差异性,从而为理解和应用这些模型提供更全面的视角。

技术框架:论文的技术框架主要包括以下几个方面:1) 使用概率图模型来表示不同模型的结构;2) 分析不同模型的推理算法,包括前向-后向算法和卡尔曼滤波;3) 比较不同模型的学习过程,包括期望最大化(EM)算法和基于梯度的优化方法。通过对这些方面的分析,论文旨在建立一个统一的框架,用于理解和比较不同类型的序列模型。

关键创新:论文的关键创新在于其系统性地比较了经典概率模型(HMMs和SSMs)与现代深度学习模型(如S4和Mamba),并揭示了它们之间的联系和差异。这种比较有助于研究人员更好地理解这些模型的优缺点,并为未来的模型设计提供指导。此外,论文还强调了概率图模型在理解和比较不同模型中的作用。

关键设计:论文的关键设计在于选择了概率图模型作为统一的表示框架,并针对不同模型的推理算法和学习过程进行了详细的分析。此外,论文还关注了现代NLP SSMs中的一些关键技术细节,例如状态转移矩阵的设计和优化方法。这些设计使得论文能够对不同模型进行更深入的比较和分析。

🖼️ 关键图片

📊 实验亮点

论文通过统一的框架,对比了HMM、线性高斯SSM、卡尔曼滤波和现代NLP SSM,揭示了它们在结构、推理和学习上的异同。该研究为理解和应用这些模型提供了更全面的视角,并为未来的模型设计提供了指导。

🎯 应用场景

该研究成果可应用于序列数据建模的各个领域,例如语音识别、自然语言处理、时间序列分析和控制系统。通过理解不同模型的优缺点,研究人员可以根据具体应用场景选择合适的模型,并进行针对性的改进。此外,该研究还有助于开发新的序列建模方法,例如结合经典概率模型和深度学习模型的优势。

📄 摘要(原文)

State Space Models (SSMs) and Hidden Markov Models (HMMs) are foundational frameworks for modeling sequential data with latent variables and are widely used in signal processing, control theory, and machine learning. Despite their shared temporal structure, they differ fundamentally in the nature of their latent states, probabilistic assumptions, inference procedures, and training paradigms. Recently, deterministic state space models have re-emerged in natural language processing through architectures such as S4 and Mamba, raising new questions about the relationship between classical probabilistic SSMs, HMMs, and modern neural sequence models. In this paper, we present a unified and systematic comparison of HMMs, linear Gaussian state space models, Kalman filtering, and contemporary NLP state space models. We analyze their formulations through the lens of probabilistic graphical models, examine their inference algorithms -- including forward-backward inference and Kalman filtering -- and contrast their learning procedures via Expectation-Maximization and gradient-based optimization. By highlighting both structural similarities and semantic differences, we clarify when these models are equivalent, when they fundamentally diverge, and how modern NLP SSMs relate to classical probabilistic models. Our analysis bridges perspectives from control theory, probabilistic modeling, and modern deep learning.