Training instability in deep learning follows low-dimensional dynamical principles

作者: Zhipeng Zhang, Zhenjie Yao, Kai Li, Lei Yang

分类: cs.LG, cs.AI

发布日期: 2026-01-19

💡 一句话要点

提出统一的动态视角,研究深度学习训练过程中的不稳定性问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 深度学习 训练稳定性 动态系统 扰动审计 强化学习

📋 核心要点

- 深度学习训练过程的稳定性是一个重要但未被充分理解的问题,现有方法难以解释训练崩溃的原因。

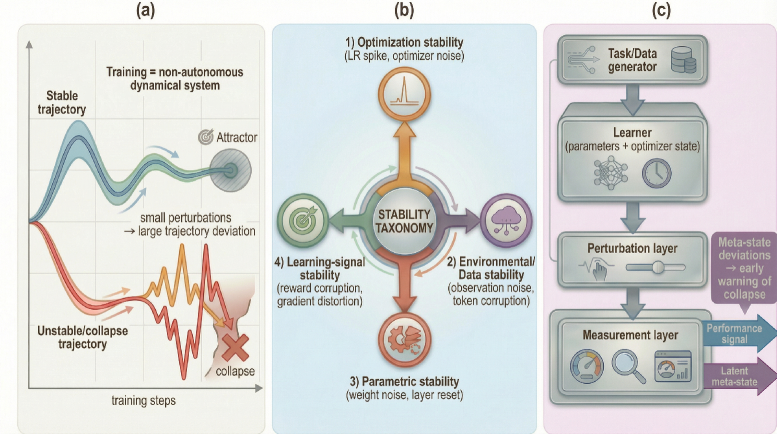

- 论文提出了一种统一的动态视角,将训练稳定性视为学习系统的内在属性,并从优化、数据、参数和学习信号四个维度进行分析。

- 通过对强化学习和大型语言模型训练的扰动审计,揭示了训练稳定性与最终性能、随机性和低维元状态之间的关系。

📝 摘要(中文)

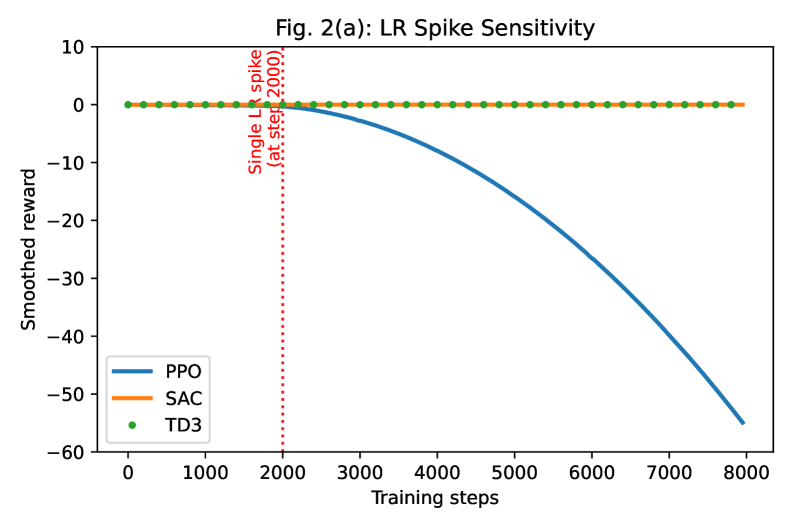

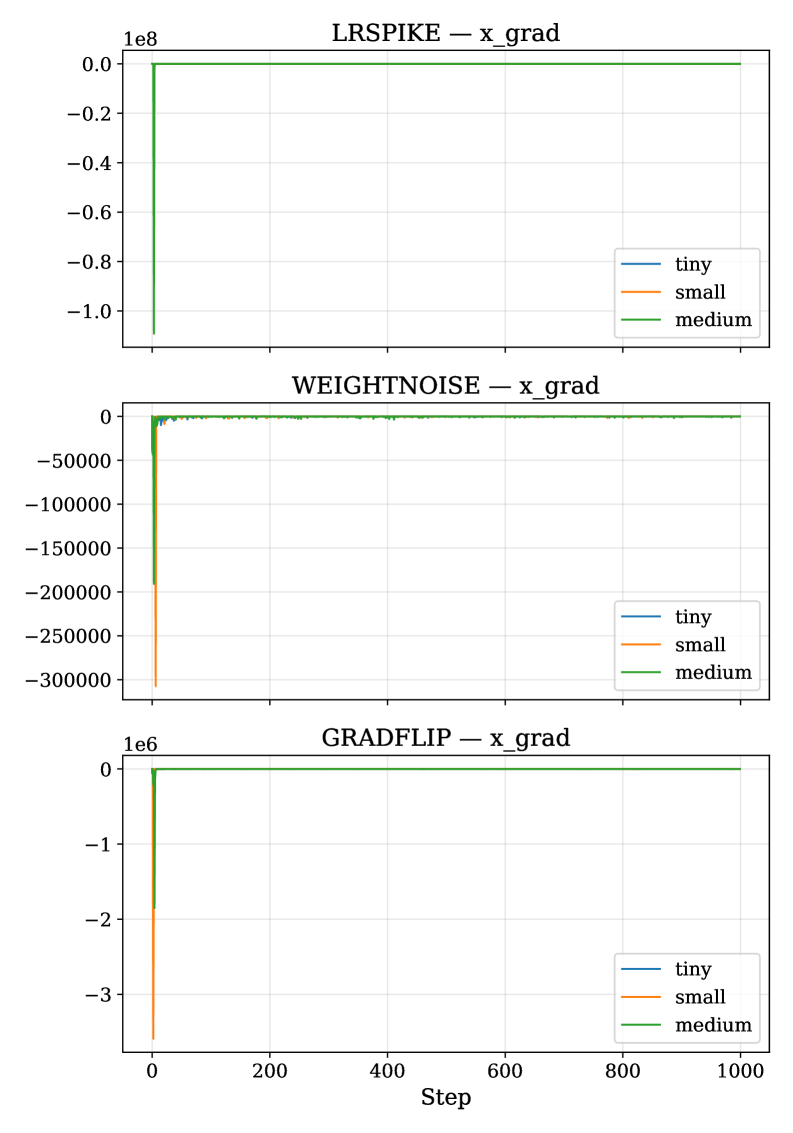

深度学习系统在经验性能上表现出色,但训练过程本身的稳定性仍然知之甚少。训练在高维动态系统中展开,优化、数据、参数或学习信号的微小扰动都可能导致突然且不可逆的崩溃,从而损害可重复性和可扩展性。我们提出了一个统一的动态视角,将训练稳定性描述为学习系统的一个内在属性,该属性沿着四个相互作用的维度组织:优化、环境/数据、参数和学习信号稳定性。我们通过对训练轨迹进行受控扰动审计来实施这种视角,探测学习动态如何响应结构化干扰而不修改学习算法。在强化学习和大型语言模型训练中,我们发现了三个反复出现的规律:高最终性能经常与训练稳定性脱钩;受控随机性始终缓冲跨范式的学习动态;低维潜在元状态的偏差系统地先于可观察的性能崩溃。总之,这些发现将训练稳定性确立为学习系统的一种可测量和可比较的动态属性,为研究超出最终性能结果的学习动态提供了一个描述性基础。

🔬 方法详解

问题定义:深度学习模型的训练过程常常面临不稳定性问题,表现为训练过程中性能突然崩溃,难以复现,并且对超参数和数据分布的变化非常敏感。现有的方法通常关注于优化算法的改进或者正则化策略的设计,但缺乏对训练过程内在动态特性的深入理解,无法有效预测和避免训练崩溃的发生。

核心思路:论文的核心思路是将深度学习的训练过程视为一个高维动态系统,并从动态系统的角度来研究训练的稳定性。通过引入扰动审计的方法,探测训练轨迹对不同类型扰动的响应,从而揭示训练过程中的不稳定因素。这种方法不依赖于特定的学习算法,而是关注学习系统本身的动态特性。

技术框架:论文提出的技术框架主要包含以下几个阶段:1) 定义训练稳定性的四个维度:优化稳定性、环境/数据稳定性、参数稳定性和学习信号稳定性。2) 设计受控扰动审计实验,对训练过程中的不同维度施加结构化的扰动。3) 监测训练轨迹对扰动的响应,例如性能变化、参数变化等。4) 分析扰动与性能崩溃之间的关系,识别导致训练不稳定的关键因素。5) 提取低维潜在元状态,并研究其与训练稳定性的关系。

关键创新:论文最重要的技术创新点在于提出了一个统一的动态视角来研究深度学习的训练稳定性。与以往关注优化算法或正则化策略的方法不同,该方法关注学习系统本身的动态特性,通过扰动审计来揭示训练过程中的不稳定因素。此外,论文还发现低维潜在元状态的偏差可以预测性能崩溃,为提前干预训练过程提供了可能。

关键设计:论文的关键设计包括:1) 精心设计的扰动类型,覆盖了优化、数据、参数和学习信号四个维度。2) 扰动强度的控制,避免过度扰动导致训练过程完全崩溃。3) 性能指标的选取,能够准确反映训练过程的稳定性和性能。4) 低维元状态的提取方法,例如使用自编码器或主成分分析等降维技术。

🖼️ 关键图片

📊 实验亮点

论文通过在强化学习和大型语言模型上的实验,验证了所提出的动态视角的有效性。实验结果表明,高最终性能并不总是与训练稳定性相关,受控随机性可以提高训练的鲁棒性,并且低维潜在元状态的偏差可以预测性能崩溃。这些发现为理解和改善深度学习的训练过程提供了新的思路。

🎯 应用场景

该研究成果可应用于提升深度学习模型训练的稳定性和可重复性,尤其是在资源受限或对模型性能要求极高的场景下。通过提前识别潜在的训练不稳定因素,可以采取相应的干预措施,例如调整超参数、增加数据增强或使用更鲁棒的优化算法,从而降低训练成本,加速模型开发周期,并提高模型的可靠性。

📄 摘要(原文)

Deep learning systems achieve remarkable empirical performance, yet the stability of the training process itself remains poorly understood. Training unfolds as a high-dimensional dynamical system in which small perturbations to optimization, data, parameters, or learning signals can induce abrupt and irreversible collapse, undermining reproducibility and scalability. We propose a unified dynamical perspective that characterizes training stability as an intrinsic property of learning systems, organized along four interacting dimensions: optimization, environmental/data, parametric, and learning-signal stability. We operationalize this perspective through controlled perturbation auditing of training trajectories, probing how learning dynamics respond to structured disturbances without modifying learning algorithms. Across reinforcement learning and large language model training, we identify three recurring regularities: high final performance is frequently decoupled from training stability; controlled stochasticity consistently buffers learning dynamics across paradigms; and deviations in low-dimensional latent meta-states systematically precede observable performance collapse. Together, these findings establish training stability as a measurable and comparable dynamical property of learning systems, providing a descriptive foundation for studying learning dynamics beyond final performance outcomes.