CooperLLM: Cloud-Edge-End Cooperative Federated Fine-tuning for LLMs via ZOO-based Gradient Correction

作者: He Sun, Jinrui Zhou, Li Li, Mingjun Xiao

分类: cs.LG, cs.DC

发布日期: 2026-01-19

备注: 14 pages, 9 figures, under review

💡 一句话要点

CooperLLM:基于ZOO梯度校正的云边端协同联邦微调LLM

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 大型语言模型 零阶优化 梯度校正 云边协同

📋 核心要点

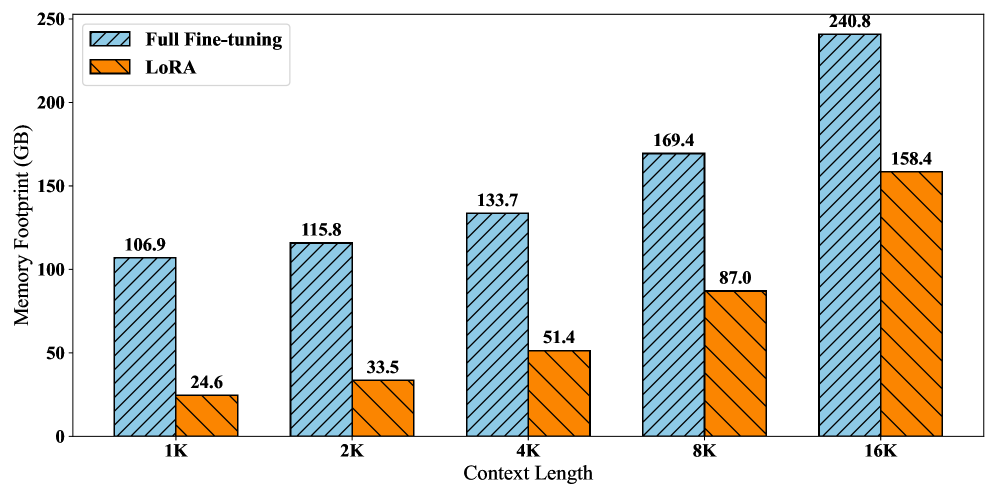

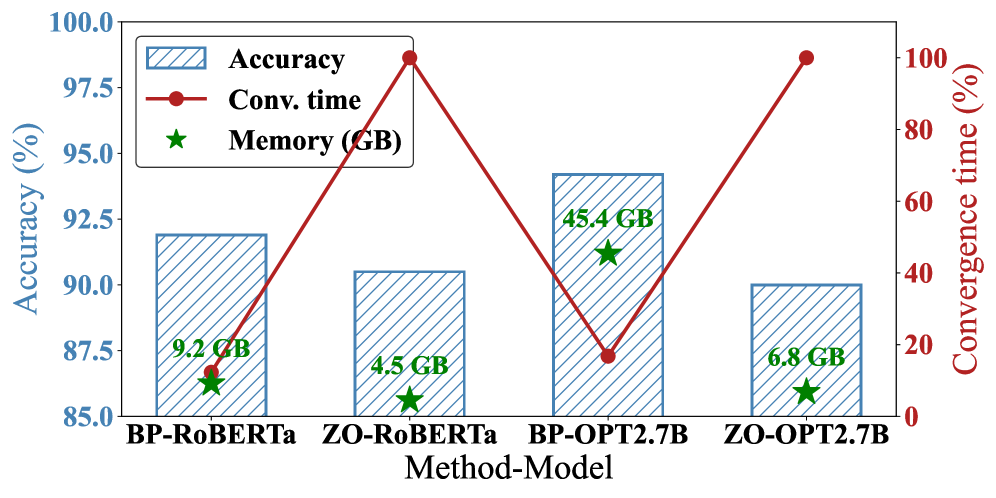

- 现有联邦学习方法在移动设备上微调LLM时,面临内存和计算资源的挑战,且ZOO优化收敛慢、精度低。

- CooperLLM提出云边端协同框架,利用云端辅助梯度校正,在移动端进行轻量级ZOO更新,云端进行梯度修正。

- 实验表明,CooperLLM显著降低了设备内存占用,加速了收敛速度,并提高了模型精度,优于现有ZOO方法。

📝 摘要(中文)

大型语言模型(LLM)在许多NLP任务中表现出色,但由于内存和计算成本高昂,在资源受限的移动设备上对其进行微调具有挑战性,尽管对保护隐私的个性化需求日益增长。联邦学习(FL)支持本地数据训练,但现有方法要么依赖于内存密集型反向传播,要么使用零阶优化(ZOO),后者避免了反向传播,但收敛速度慢且精度降低。我们提出了CooperLLM,一个云辅助的边缘端协同联邦微调框架,它结合了移动设备上的ZOO和云引导的梯度校正。移动客户端对私有数据执行轻量级的ZOO更新,而云端使用反向传播在辅助公共数据上进行微调,并注入引导扰动以校正本地更新,从而在不违反隐私的情况下提高收敛速度和精度。为了解决系统瓶颈,CooperLLM引入了流水线调度和自适应压缩,以重叠计算和通信并减少内存使用。在多个Transformer模型和数据集上的实验表明,与最先进的基于ZOO的基线相比,CooperLLM将设备上的内存减少高达86.4%,加速收敛8.8倍,并将精度提高高达10个百分点。

🔬 方法详解

问题定义:论文旨在解决在资源受限的移动设备上对大型语言模型进行联邦微调的问题。现有方法,如直接在设备上进行反向传播,需要大量的内存和计算资源,不适用于移动设备。而基于零阶优化(ZOO)的方法虽然避免了反向传播,但收敛速度慢,精度也较低。

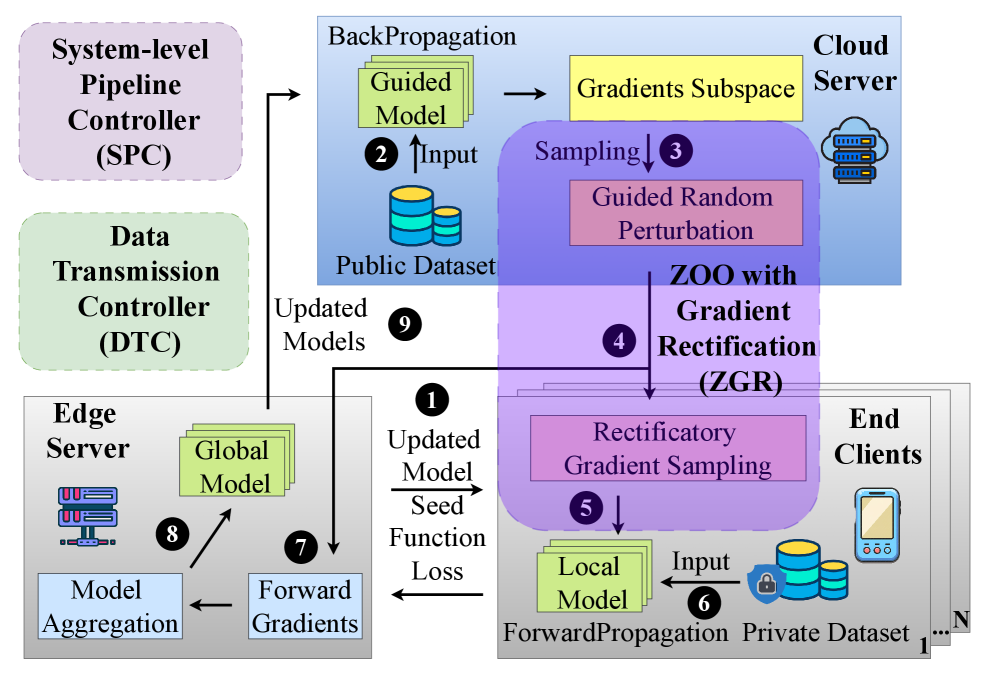

核心思路:论文的核心思路是利用云端资源来辅助移动端进行联邦微调。移动端使用ZOO进行轻量级更新,云端利用公共数据进行微调,并生成梯度校正信息,反馈给移动端,从而提高收敛速度和精度,同时保护用户隐私。

技术框架:CooperLLM框架包含三个主要部分:移动端、边缘端(可选)和云端。移动端负责在本地私有数据上进行ZOO更新,并将更新后的模型参数发送到云端。云端使用公共数据进行微调,并计算梯度校正信息。然后,云端将校正信息发送回移动端,移动端应用这些信息来更新本地模型。为了提高效率,框架还引入了流水线调度和自适应压缩技术。

关键创新:CooperLLM的关键创新在于云端辅助的梯度校正机制。通过在云端使用公共数据进行微调,并生成梯度校正信息,可以有效地提高移动端模型的收敛速度和精度,同时避免了直接在移动端进行反向传播带来的资源消耗。此外,流水线调度和自适应压缩技术也提高了系统的整体效率。

关键设计:ZOO优化器的具体参数设置(例如,扰动幅度、采样策略)会影响收敛速度和精度。云端梯度校正信息的生成方式,例如,使用何种损失函数来衡量公共数据和私有数据之间的差异,也是一个关键设计。此外,自适应压缩算法的选择和参数设置,需要在通信效率和模型精度之间进行权衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CooperLLM在多个Transformer模型和数据集上均取得了显著的性能提升。与最先进的基于ZOO的基线相比,CooperLLM将设备上的内存减少高达86.4%,加速收敛8.8倍,并将精度提高高达10个百分点。这些结果表明,CooperLLM是一种高效且有效的联邦微调方法。

🎯 应用场景

CooperLLM适用于需要保护用户隐私的个性化LLM应用场景,例如:个性化推荐系统、移动设备上的智能助手、医疗健康领域的隐私保护数据分析等。该研究成果可以促进LLM在资源受限设备上的广泛应用,并为联邦学习领域提供新的思路。

📄 摘要(原文)

Large Language Models (LLMs) perform well on many NLP tasks, but fine-tuning them on resource-constrained mobile devices is challenging due to high memory and computation costs, despite growing demands for privacy-preserving personalization. Federated Learning (FL) enables local-data training, yet existing methods either rely on memory-intensive backpropagation or use zeroth-order optimization (ZOO), which avoids backward passes but suffers from slow convergence and degraded accuracy. We propose CooperLLM, a cloud-assisted edge-end cooperative federated fine-tuning framework that combines ZOO on mobile devices with cloud-guided gradient rectification. Mobile clients perform lightweight ZOO updates on private data, while the cloud fine-tunes on auxiliary public data using backpropagation and injects guided perturbations to rectify local updates, improving convergence and accuracy without violating privacy. To address system bottlenecks, CooperLLM introduces pipeline scheduling and adaptive compression to overlap computation and communication and reduce memory usage. Experiments on multiple Transformer models and datasets show that CooperLLM reduces on-device memory by up to $86.4\%$, accelerates convergence by $8.8 \times$, and improves accuracy by up to 10 percentage points over state-of-the-art ZOO-based baselines.