Offline Reinforcement-Learning-Based Power Control for Application-Agnostic Energy Efficiency

作者: Akhilesh Raj, Swann Perarnau, Aniruddha Gokhale, Solomon Bekele Abera

分类: cs.LG, cs.PF, eess.SY

发布日期: 2026-01-16

备注: 11 pages, 5 figures, 3 tables and unpublished

💡 一句话要点

提出基于离线强化学习的CPU功耗控制方法,提升并行应用能效。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 离线强化学习 CPU功耗控制 能源效率 并行应用 硬件性能计数器

📋 核心要点

- 在线强化学习在功耗控制方面面临缺乏环境模型和在线训练扰动等挑战。

- 采用离线强化学习,利用预先收集的数据集训练功耗控制器,避免在线训练问题。

- 实验表明,该方法能在可接受的性能损失下显著降低能耗,提升能源效率。

📝 摘要(中文)

本文探讨了使用离线强化学习来设计自主CPU功耗控制器,旨在提高并行应用程序在运行时的能源效率,同时避免过度影响其性能。离线强化学习通过利用在训练前从任意策略收集的状态转换数据集,规避了在线强化学习训练所带来的问题,例如缺乏适当的模拟环境模型,以及在实际系统上部署训练时可能出现的扰动(噪声)和可靠性问题。该方法将离线强化学习应用于能源效率的灰盒方法,结合在线的、与应用无关的性能数据(例如,心跳信号)和硬件性能计数器,以确保在有限的性能下降情况下满足科学目标。通过在各种计算密集型和内存密集型基准测试中评估该方法,并通过Intel的运行平均功率限制在实际系统上控制功耗,证明了这种离线训练的代理可以在可容忍的性能下降成本下显著降低能耗。

🔬 方法详解

问题定义:现有在线强化学习方法在CPU功耗控制中面临挑战,主要体现在难以建立精确的模拟环境模型,以及在真实系统上进行在线训练时会引入噪声和可靠性问题。这些问题使得在线强化学习难以直接应用于实际的CPU功耗控制。

核心思路:本文的核心思路是利用离线强化学习,通过预先收集的大量状态转移数据来训练功耗控制策略。这种方法避免了在线探索带来的风险,并且可以利用任意策略产生的数据,从而降低了数据收集的成本。核心在于学习一个能够根据系统状态(如硬件性能计数器和应用心跳)调整CPU功耗的策略,以在性能和能耗之间取得平衡。

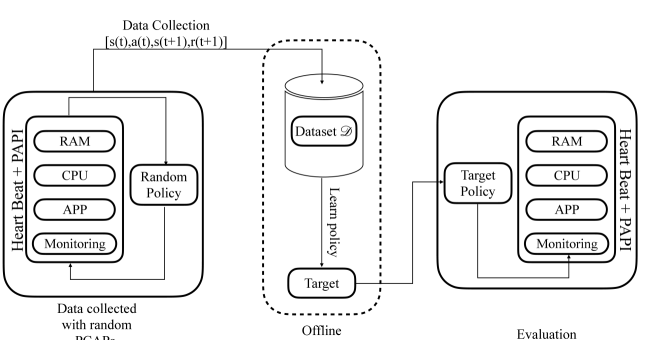

技术框架:整体框架包含数据收集和策略训练两个主要阶段。首先,通过运行各种应用程序,收集CPU的状态信息(如硬件性能计数器)和应用程序的性能数据(如心跳信号),以及对应的功耗数据,形成离线数据集。然后,使用离线强化学习算法(具体算法未知,论文未明确说明)对该数据集进行训练,得到一个功耗控制策略。该策略部署在实际系统中,根据当前系统状态动态调整CPU的运行平均功率限制(RAPL)。

关键创新:关键创新在于将离线强化学习应用于CPU功耗控制领域,并结合了在线应用无关的性能数据和硬件性能计数器,形成了一种灰盒方法。这种方法既避免了完全依赖模型带来的不准确性,又避免了完全依赖在线探索带来的风险,从而实现了更好的能效控制。

关键设计:论文中未明确说明具体的离线强化学习算法、损失函数、网络结构等技术细节。但是,可以推测,状态空间可能包括硬件性能计数器(如CPU利用率、缓存命中率等)和应用程序心跳信号,动作空间可能包括不同的RAPL功率限制级别。损失函数的设计目标是在降低能耗的同时,尽量减少应用程序的性能损失。具体的网络结构未知。

🖼️ 关键图片

📊 实验亮点

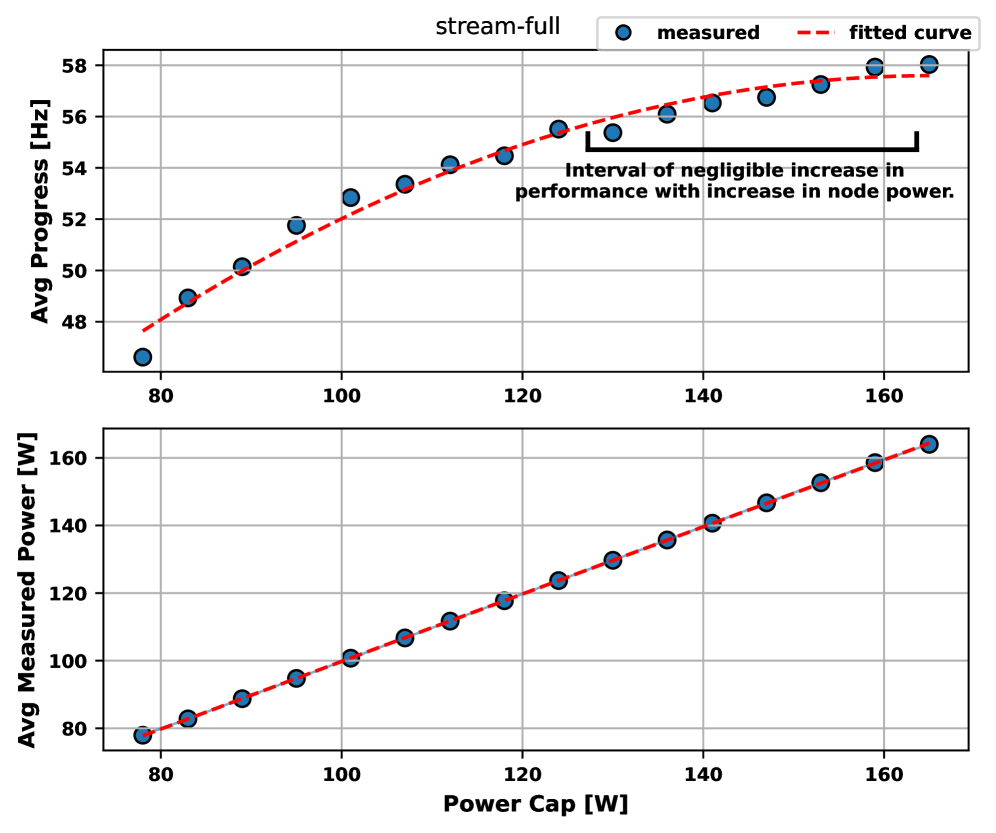

实验结果表明,该离线训练的代理可以在可容忍的性能下降成本下显著降低能耗。具体而言,该方法在多种计算密集型和内存密集型基准测试中都取得了良好的效果,通过控制Intel的运行平均功率限制(RAPL),实现了能源消耗的降低,但具体的性能提升百分比和对比基线未在摘要中明确给出。

🎯 应用场景

该研究成果可应用于各种计算平台,包括服务器、数据中心和高性能计算系统,以提高能源效率并降低运营成本。通过智能地控制CPU功耗,可以在不显著影响应用程序性能的前提下,减少能源消耗,从而实现绿色计算。未来的研究可以探索更复杂的功耗控制策略,并将其应用于更广泛的硬件平台。

📄 摘要(原文)

Energy efficiency has become an integral aspect of modern computing infrastructure design, impacting the performance, cost, scalability, and durability of production systems. The incorporation of power actuation and sensing capabilities in CPU designs is indicative of this, enabling the deployment of system software that can actively monitor and adjust energy consumption and performance at runtime. While reinforcement learning (RL) would seem ideal for the design of such energy efficiency control systems, online training presents challenges ranging from the lack of proper models for setting up an adequate simulated environment, to perturbation (noise) and reliability issues, if training is deployed on a live system. In this paper we discuss the use of offline reinforcement learning as an alternative approach for the design of an autonomous CPU power controller, with the goal of improving the energy efficiency of parallel applications at runtime without unduly impacting their performance. Offline RL sidesteps the issues incurred by online RL training by leveraging a dataset of state transitions collected from arbitrary policies prior to training. Our methodology applies offline RL to a gray-box approach to energy efficiency, combining online application-agnostic performance data (e.g., heartbeats) and hardware performance counters to ensure that the scientific objectives are met with limited performance degradation. Evaluating our method on a variety of compute-bound and memory-bound benchmarks and controlling power on a live system through Intel's Running Average Power Limit, we demonstrate that such an offline-trained agent can substantially reduce energy consumption at a tolerable performance degradation cost.