Information Theoretic Perspective on Representation Learning

作者: Deborah Pereg

分类: cs.IT, cs.LG

发布日期: 2026-01-16

💡 一句话要点

提出信息论框架,分析回归任务中最后一层嵌入表示的学习。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 表示学习 信息论 回归任务 表示率 表示容量 互信息 率失真理论

📋 核心要点

- 现有表示学习方法缺乏对信息瓶颈的理论分析,难以保证表示的有效性和可靠性。

- 论文提出基于信息论的表示率和表示容量概念,用于度量和优化表示学习过程中的信息传递效率。

- 通过理论推导,论文给出了表示率和表示容量的上下界,为表示学习的优化提供了理论指导。

📝 摘要(中文)

本文引入了一个信息论框架来分析最后一层嵌入表示,重点关注回归任务中学习到的表示。我们定义了表示率,并推导了输入-输出信息能够被可靠表示的极限,这本质上由输入源熵决定。我们进一步定义了扰动环境下的表示容量,以及压缩输出的表示率-失真。我们推导了可达到的容量、可达到的表示率及其逆。最后,我们将结果整合到一个统一的设置中。

🔬 方法详解

问题定义:论文旨在解决回归任务中,如何学习到既能保留输入信息,又能有效预测输出的最后一层嵌入表示的问题。现有方法通常缺乏对表示的信息论分析,难以保证表示的有效性和可靠性,可能导致信息丢失或冗余。

核心思路:论文的核心思路是利用信息论中的表示率和表示容量来刻画表示学习过程中的信息传递效率。表示率衡量了表示中包含的输入信息量,表示容量衡量了在扰动环境下表示能够可靠传递的最大信息量。通过优化表示率和表示容量,可以学习到更有效和鲁棒的表示。

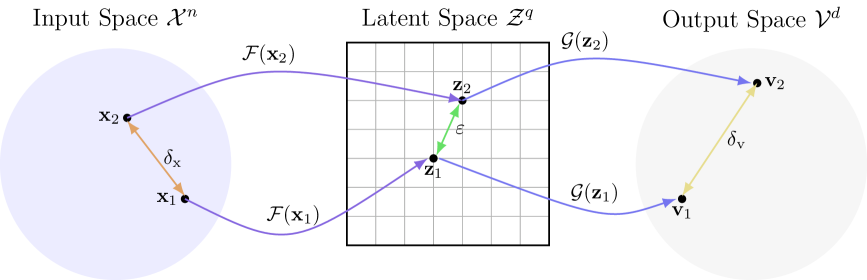

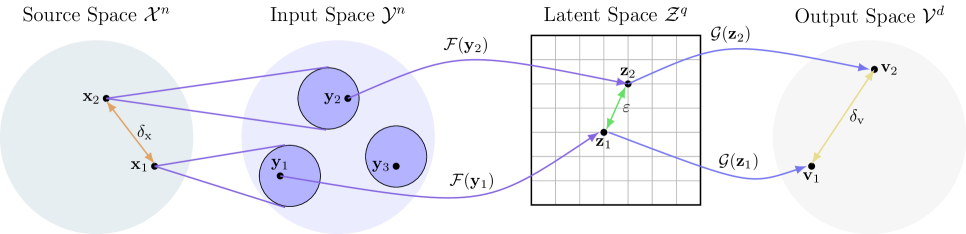

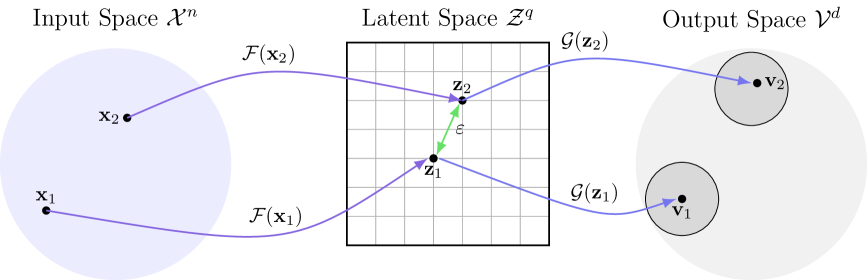

技术框架:论文构建了一个信息论框架,主要包含以下几个阶段:1) 定义表示率,用于衡量表示中包含的输入信息量;2) 定义扰动环境下的表示容量,用于衡量表示的鲁棒性;3) 推导表示率和表示容量的上下界,为表示学习的优化提供理论指导;4) 结合表示率和表示容量,构建统一的优化目标。

关键创新:论文的关键创新在于将信息论的概念引入到表示学习中,提出了表示率和表示容量的概念,并推导了相应的理论结果。这为表示学习提供了一个新的视角,可以更好地理解和优化表示学习过程。与现有方法相比,该方法能够更好地控制表示的信息量和鲁棒性。

关键设计:论文的关键设计包括:1) 使用互信息来衡量表示中包含的输入信息量;2) 引入扰动模型来模拟实际应用中的噪声;3) 使用率失真理论来分析压缩表示的性能;4) 通过优化表示率和表示容量的加权和来平衡表示的信息量和鲁棒性。具体的参数设置和网络结构取决于具体的回归任务。

🖼️ 关键图片

📊 实验亮点

论文推导了表示率和表示容量的上下界,为表示学习的优化提供了理论指导。虽然摘要中没有明确提及具体的实验结果,但这些理论结果本身就是重要的贡献,可以指导实际应用中的表示学习算法设计。

🎯 应用场景

该研究成果可应用于各种回归任务,例如图像回归、语音回归、时间序列预测等。通过优化表示率和表示容量,可以学习到更有效和鲁棒的表示,从而提高回归模型的性能。此外,该研究还可以为表示学习的理论研究提供新的思路和方法。

📄 摘要(原文)

An information-theoretic framework is introduced to analyze last-layer embedding, focusing on learned representations for regression tasks. We define representation-rate and derive limits on the reliability with which input-output information can be represented as is inherently determined by the input-source entropy. We further define representation capacity in a perturbed setting, and representation rate-distortion for a compressed output. We derive the achievable capacity, the achievable representation-rate, and their converse. Finally, we combine the results in a unified setting.