Latent Dynamics Graph Convolutional Networks for model order reduction of parameterized time-dependent PDEs

作者: Lorenzo Tomada, Federico Pichi, Gianluigi Rozza

分类: cs.LG, math.NA

发布日期: 2026-01-16

🔗 代码/项目: GITHUB

💡 一句话要点

提出LD-GCN用于参数化时变偏微分方程的降阶模型,提升可解释性和时间外推能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图神经网络 降阶模型 偏微分方程 动力系统 时间序列预测

📋 核心要点

- 现有GNN方法在偏微分方程降阶模型中,难以兼顾几何信息和可解释的潜在动态行为。

- LD-GCN通过学习低维潜在空间中的动力学表示,并使用GNN解码到参数化几何域,实现了高效降阶。

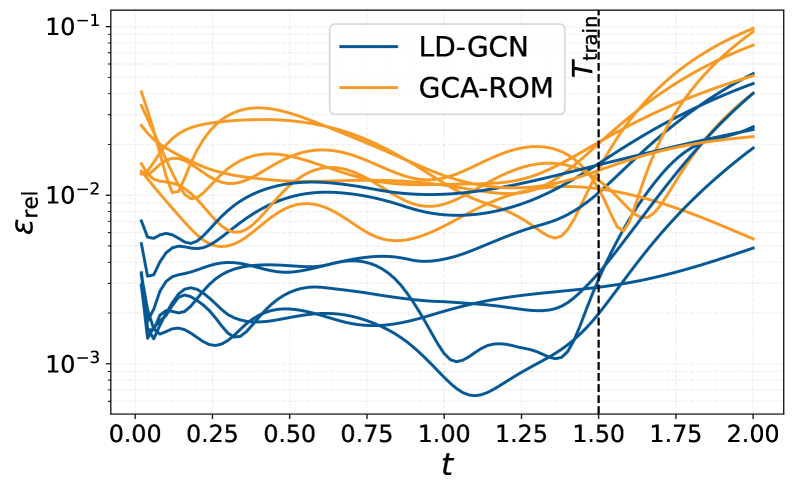

- 实验表明,LD-GCN在复杂力学问题上表现出色,并能检测Navier-Stokes方程的分岔现象。

📝 摘要(中文)

本文提出了一种用于时变参数化偏微分方程(PDEs)非线性降阶模型(MOR)的潜在动力学图卷积网络(LD-GCN)。现有方法难以将几何归纳偏置与可解释的潜在行为相结合,忽略了动态驱动的特征或忽视了空间信息。LD-GCN是一种纯数据驱动、无编码器的架构,它学习依赖于外部输入和参数的动力系统的全局低维表示。时间演化在潜在空间中建模,并通过时间步进推进,从而实现时间外推。轨迹使用GNN一致地解码到几何参数化域上。该框架通过分析降阶动力学并支持潜在插值实现零样本预测,从而增强了可解释性。该方法通过无编码器架构的通用逼近定理进行了数学验证,并在涉及物理和几何参数的复杂计算力学问题上进行了数值测试,包括Navier-Stokes方程的分岔现象检测。

🔬 方法详解

问题定义:论文旨在解决参数化时变偏微分方程(PDEs)的降阶模型(MOR)问题。现有的基于图神经网络(GNNs)的MOR方法通常难以兼顾几何归纳偏置和可解释的潜在行为,要么忽略了动态驱动的特征,要么忽视了空间信息,导致模型泛化能力和可解释性不足。

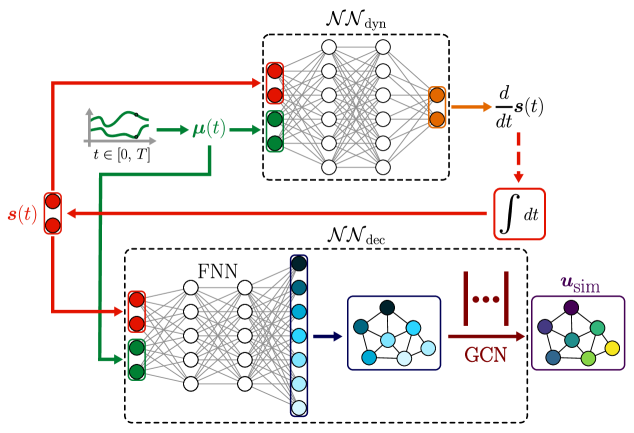

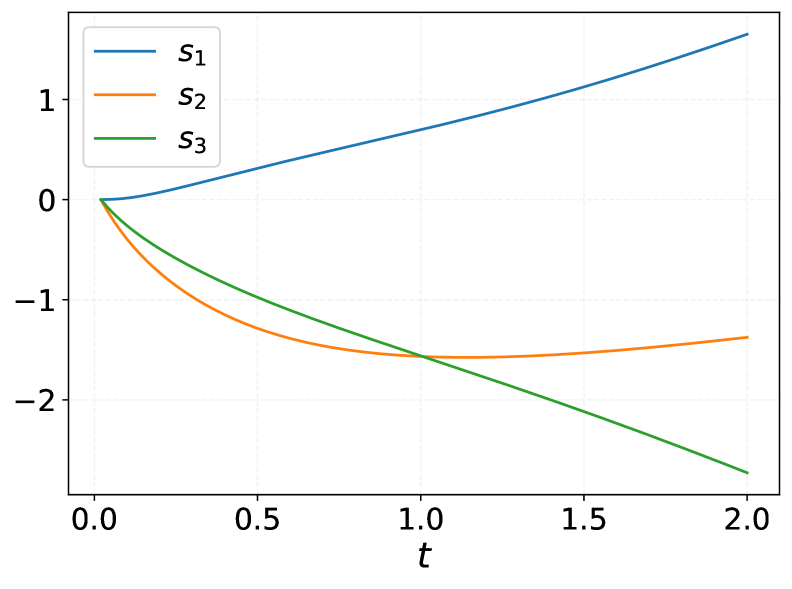

核心思路:论文的核心思路是学习一个低维的、全局的潜在空间来表示动力系统,并在该潜在空间中进行时间演化建模。通过将时间演化过程限制在低维空间中,可以提高计算效率并增强模型的可解释性。同时,利用图神经网络(GNN)将潜在空间中的表示解码到几何参数化的物理域,从而实现对原始PDEs的近似求解。

技术框架:LD-GCN的整体架构包含以下几个主要模块:1) 数据编码:将高维的PDE解编码到图结构数据;2) 潜在动力学学习:使用图卷积网络(GCN)学习一个低维的潜在空间表示,并建模该空间中的动力学演化;3) 时间步进:在潜在空间中进行时间步进,预测未来的状态;4) 数据解码:使用GNN将潜在空间中的状态解码回原始的物理域。整个框架是encoder-free的,直接学习潜在空间的动力学。

关键创新:LD-GCN的关键创新在于其无编码器(encoder-free)的架构和对潜在空间动力学的显式建模。与传统的encoder-decoder结构不同,LD-GCN直接学习潜在空间中的动力学,避免了编码器带来的信息损失和计算负担。此外,通过在潜在空间中进行时间步进,LD-GCN能够进行时间外推,预测未来的状态。

关键设计:LD-GCN的关键设计包括:1) 图结构的构建:根据PDE的离散化网格构建图结构,节点表示网格点,边表示网格点之间的连接关系;2) GCN的选择:可以使用不同的GCN变体,如Graph Convolutional Network (GCN), GraphSAGE等,来学习潜在空间表示;3) 潜在空间维度:潜在空间的维度需要根据具体问题进行调整,通常选择一个远小于原始空间维度的值;4) 损失函数:损失函数通常包括重构损失和动力学损失,重构损失用于保证解码后的解与原始解的相似性,动力学损失用于约束潜在空间中的动力学演化。

🖼️ 关键图片

📊 实验亮点

论文在包含物理和几何参数的复杂计算力学问题上进行了数值实验,包括Navier-Stokes方程的分岔现象检测。实验结果表明,LD-GCN能够有效地学习潜在空间中的动力学,并准确地预测未来的状态。此外,LD-GCN还能够通过潜在插值实现零样本预测,进一步验证了其泛化能力。

🎯 应用场景

LD-GCN可应用于各种参数化时变偏微分方程的降阶模型,例如流体力学、固体力学、热传导等领域。其潜在价值在于能够显著降低计算成本,实现对复杂物理现象的快速预测和仿真,并可用于优化设计、控制和不确定性量化等任务。未来,该方法有望推广到更广泛的科学和工程领域。

📄 摘要(原文)

Graph Neural Networks (GNNs) are emerging as powerful tools for nonlinear Model Order Reduction (MOR) of time-dependent parameterized Partial Differential Equations (PDEs). However, existing methodologies struggle to combine geometric inductive biases with interpretable latent behavior, overlooking dynamics-driven features or disregarding spatial information. In this work, we address this gap by introducing Latent Dynamics Graph Convolutional Network (LD-GCN), a purely data-driven, encoder-free architecture that learns a global, low-dimensional representation of dynamical systems conditioned on external inputs and parameters. The temporal evolution is modeled in the latent space and advanced through time-stepping, allowing for time-extrapolation, and the trajectories are consistently decoded onto geometrically parameterized domains using a GNN. Our framework enhances interpretability by enabling the analysis of the reduced dynamics and supporting zero-shot prediction through latent interpolation. The methodology is mathematically validated via a universal approximation theorem for encoder-free architectures, and numerically tested on complex computational mechanics problems involving physical and geometric parameters, including the detection of bifurcating phenomena for Navier-Stokes equations. Code availability: https://github.com/lorenzotomada/ld-gcn-rom