DInf-Grid: A Neural Differential Equation Solver with Differentiable Feature Grids

作者: Navami Kairanda, Shanthika Naik, Marc Habermann, Avinash Sharma, Christian Theobalt, Vladislav Golyanik

分类: cs.LG

发布日期: 2026-01-15

备注: 25 pages; 16 figures; project page: https://4dqv.mpi-inf.mpg.de/DInf-Grid/

💡 一句话要点

提出DInf-Grid,一种基于可微特征网格的神经微分方程求解器,显著提升求解速度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经微分方程求解器 可微特征网格 径向基函数插值 多分辨率分解 物理仿真 图像重建 偏微分方程

📋 核心要点

- 现有基于坐标的MLP神经求解器计算量大、训练慢,而基于网格的方法难以计算高阶导数,限制了其在微分方程求解中的应用。

- DInf-Grid结合了特征网格的效率和径向基函数插值的可微性,并引入多分辨率分解以捕获高频解,从而实现高效准确的微分方程求解。

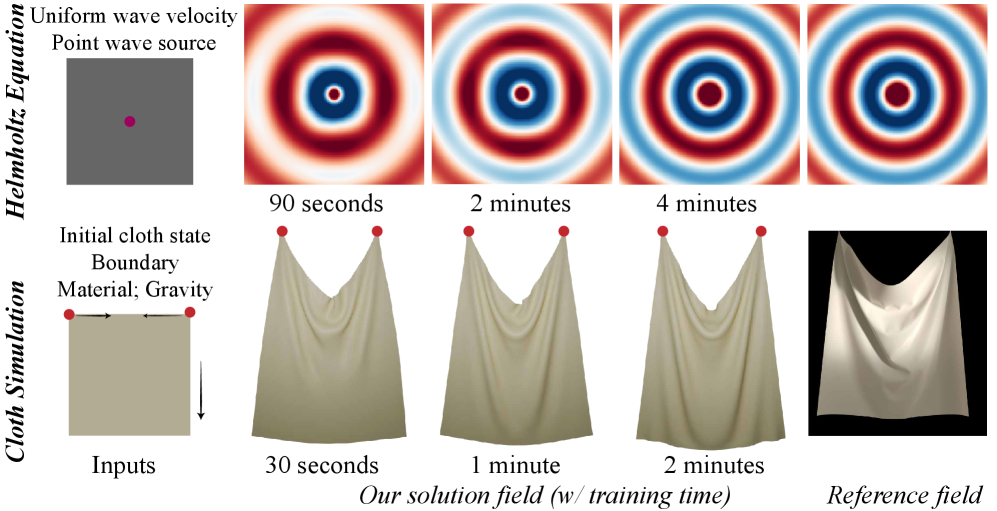

- 实验表明,DInf-Grid在图像重建、波场模拟和布料模拟等任务中,相比于MLP方法,求解速度提升5-20倍,同时保持了相当的精度。

📝 摘要(中文)

本文提出了一种新颖的基于可微网格的表示方法,用于高效求解微分方程(DEs)。现有的神经求解器架构,如正弦神经网络,是基于坐标的MLP,计算密集且训练缓慢。虽然基于网格的隐式表示替代方案(如Instant-NGP和K-Planes)通过利用信号结构可以更快地训练,但它们对线性插值的依赖限制了它们计算高阶导数的能力,使其不适合求解DEs。我们的方法通过结合特征网格的效率和径向基函数插值来克服这些限制,径向基函数是无限可微的。为了有效地捕获高频解并实现全局梯度的稳定和快速计算,我们引入了具有共址网格的多分辨率分解。我们提出的表示方法DInf-Grid,使用微分方程作为损失函数进行隐式训练,从而能够准确地建模物理场。我们在各种任务上验证了DInf-Grid,包括用于图像重建的泊松方程、用于波场的亥姆霍兹方程以及用于布料模拟的基尔霍夫-洛夫边界值问题。我们的结果表明,与基于坐标的MLP方法相比,速度提高了5-20倍,可以在几秒或几分钟内求解微分方程,同时保持相当的精度和紧凑性。

🔬 方法详解

问题定义:论文旨在解决使用神经网络高效求解微分方程的问题。现有方法,特别是基于坐标的MLP,计算成本高昂且训练速度慢。虽然基于网格的方法(如Instant-NGP)训练速度更快,但由于依赖线性插值,无法计算高阶导数,因此不适用于求解微分方程。

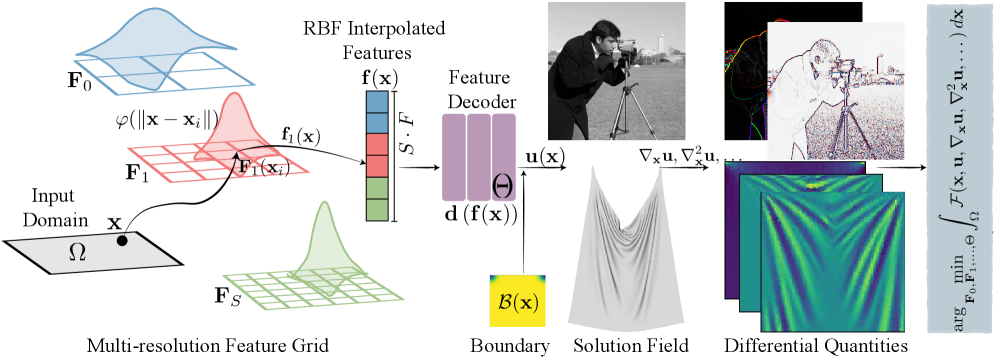

核心思路:论文的核心思路是将特征网格的效率与径向基函数(RBF)插值的无限可微性相结合。特征网格提供了一种紧凑的表示,可以快速访问局部信息,而RBF插值保证了高阶导数的计算能力,从而克服了现有方法的局限性。此外,多分辨率分解用于捕获高频解,并稳定全局梯度的计算。

技术框架:DInf-Grid的整体框架包括以下几个关键部分:1) 多分辨率特征网格:使用多个分辨率的特征网格来表示解空间。2) 径向基函数插值:使用RBF插值从特征网格中获取任意位置的值及其导数。3) 损失函数:使用微分方程本身作为损失函数,通过最小化残差来训练网络。4) 优化器:使用优化器(如Adam)来更新特征网格中的参数。

关键创新:DInf-Grid的关键创新在于将可微的径向基函数插值应用于特征网格,从而在保持计算效率的同时,实现了高阶导数的精确计算。此外,多分辨率分解的使用进一步提高了模型捕获高频细节的能力,并稳定了训练过程。与现有方法相比,DInf-Grid避免了MLP的计算瓶颈,并克服了传统网格方法无法计算高阶导数的限制。

关键设计:DInf-Grid的关键设计包括:1) 特征网格的分辨率设置:根据具体问题调整不同分辨率网格的数量和大小。2) 径向基函数的选择:选择合适的RBF函数(如高斯函数或多项式函数)及其参数(如带宽)。3) 损失函数的构建:根据微分方程的具体形式,构建合适的损失函数,例如,可以使用L2损失来最小化残差。4) 多分辨率网格的共址设计:确保不同分辨率的网格在空间上对齐,以便进行有效的梯度传递。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DInf-Grid在泊松方程、亥姆霍兹方程和基尔霍夫-洛夫边界值问题等任务上,相比于基于坐标的MLP方法,求解速度提升了5-20倍,同时保持了相当的精度和模型大小。例如,在图像重建任务中,DInf-Grid可以在几秒钟内完成高质量的重建,而MLP方法则需要几分钟甚至更长时间。

🎯 应用场景

DInf-Grid在物理仿真、图像处理、科学计算等领域具有广泛的应用前景。例如,可以用于快速求解流体力学、电磁学等领域的偏微分方程,加速物理引擎的开发,或者用于图像重建、超分辨率等任务。该方法有望推动相关领域的发展,并为解决复杂的科学和工程问题提供新的工具。

📄 摘要(原文)

We present a novel differentiable grid-based representation for efficiently solving differential equations (DEs). Widely used architectures for neural solvers, such as sinusoidal neural networks, are coordinate-based MLPs that are both computationally intensive and slow to train. Although grid-based alternatives for implicit representations (e.g., Instant-NGP and K-Planes) train faster by exploiting signal structure, their reliance on linear interpolation restricts their ability to compute higher-order derivatives, rendering them unsuitable for solving DEs. Our approach overcomes these limitations by combining the efficiency of feature grids with radial basis function interpolation, which is infinitely differentiable. To effectively capture high-frequency solutions and enable stable and faster computation of global gradients, we introduce a multi-resolution decomposition with co-located grids. Our proposed representation, DInf-Grid, is trained implicitly using the differential equations as loss functions, enabling accurate modelling of physical fields. We validate DInf-Grid on a variety of tasks, including the Poisson equation for image reconstruction, the Helmholtz equation for wave fields, and the Kirchhoff-Love boundary value problem for cloth simulation. Our results demonstrate a 5-20x speed-up over coordinate-based MLP-based methods, solving differential equations in seconds or minutes while maintaining comparable accuracy and compactness.