LeMoF: Level-guided Multimodal Fusion for Heterogeneous Clinical Data

作者: Jongseok Kim, Seongae Kang, Jonghwan Shin, Yuhan Lee, Ohyun Jo

分类: cs.LG, cs.AI

发布日期: 2026-01-15

💡 一句话要点

提出LeMoF,通过层级引导的多模态融合提升异构临床数据预测精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 临床预测 异构数据 层级表征 电子健康记录

📋 核心要点

- 现有临床多模态融合方法依赖静态集成和简单融合,无法充分利用模态特有信息。

- LeMoF通过层级引导,选择性融合模态内不同层级的表征,平衡预测稳定性和判别能力。

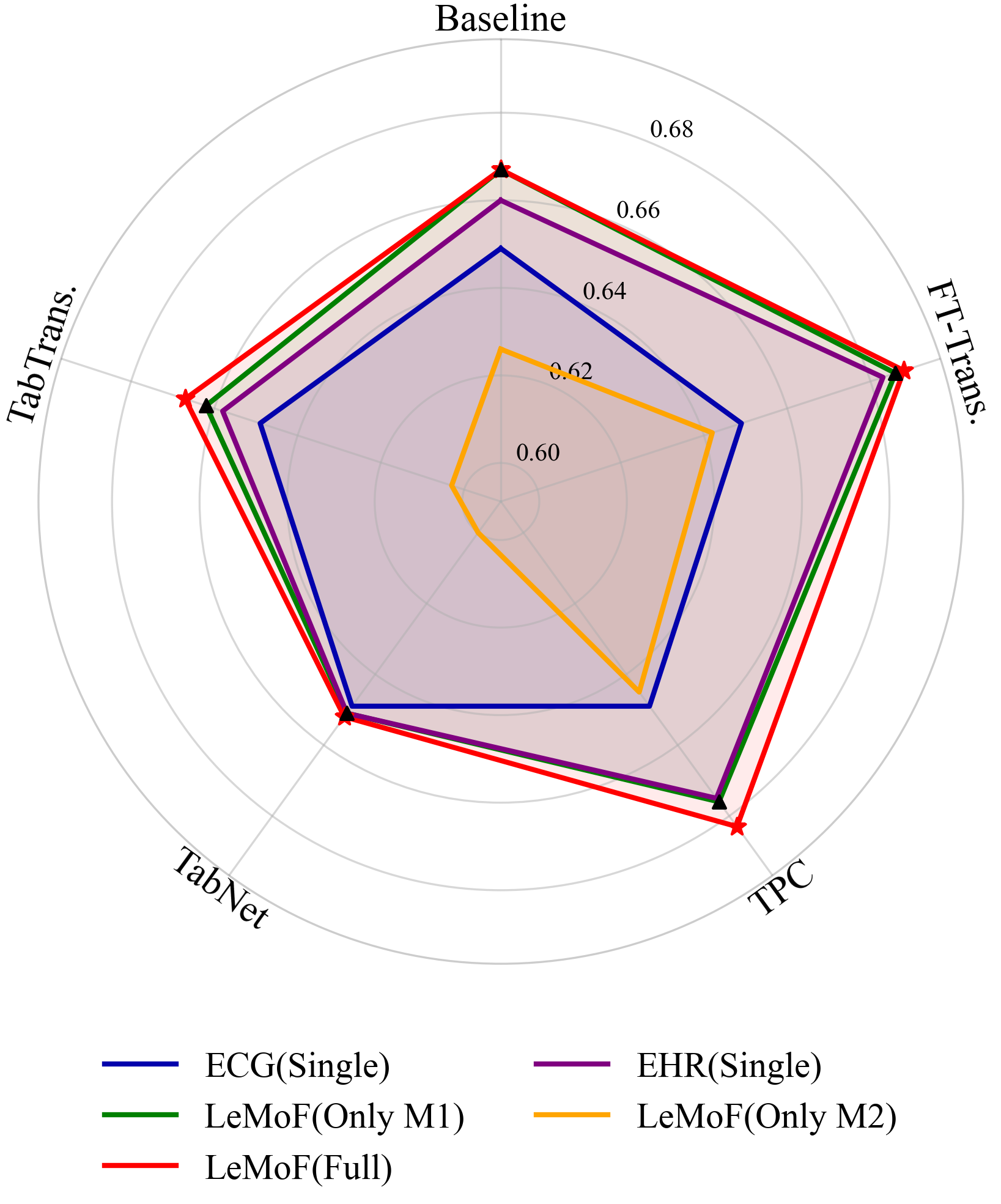

- ICU住院时长预测实验表明,LeMoF优于现有方法,证明层级集成对稳健预测至关重要。

📝 摘要(中文)

多模态临床预测广泛应用于整合电子健康记录(EHR)和生物信号等异构数据。然而,现有方法通常依赖于静态模态集成方案和简单的融合策略,未能充分利用模态特定的表征。本文提出了一种层级引导的模态融合(LeMoF)框架,该框架选择性地整合每个模态内层级引导的表征。每个层级指的是从编码器不同层提取的表征。LeMoF显式地分离和学习全局模态级别的预测,以及层级特定的判别性表征。这种设计使LeMoF能够在异构临床环境中实现预测稳定性和判别能力之间的平衡。在重症监护病房(ICU)数据上进行的住院时长预测实验表明,LeMoF在各种编码器配置下始终优于现有的最先进的多模态融合技术。我们还证实,层级集成是实现各种临床条件下稳健预测性能的关键因素。

🔬 方法详解

问题定义:现有临床多模态预测方法,如基于EHR和生物信号的预测,通常采用静态的模态融合策略,无法有效捕捉不同模态在不同抽象层次上的信息。这些方法未能充分利用模态特有的表征,导致预测性能受限,尤其是在异构临床数据环境下。

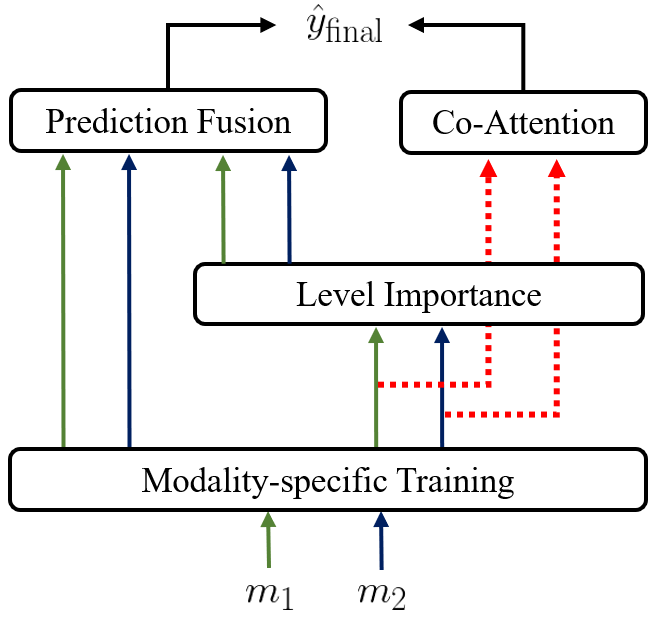

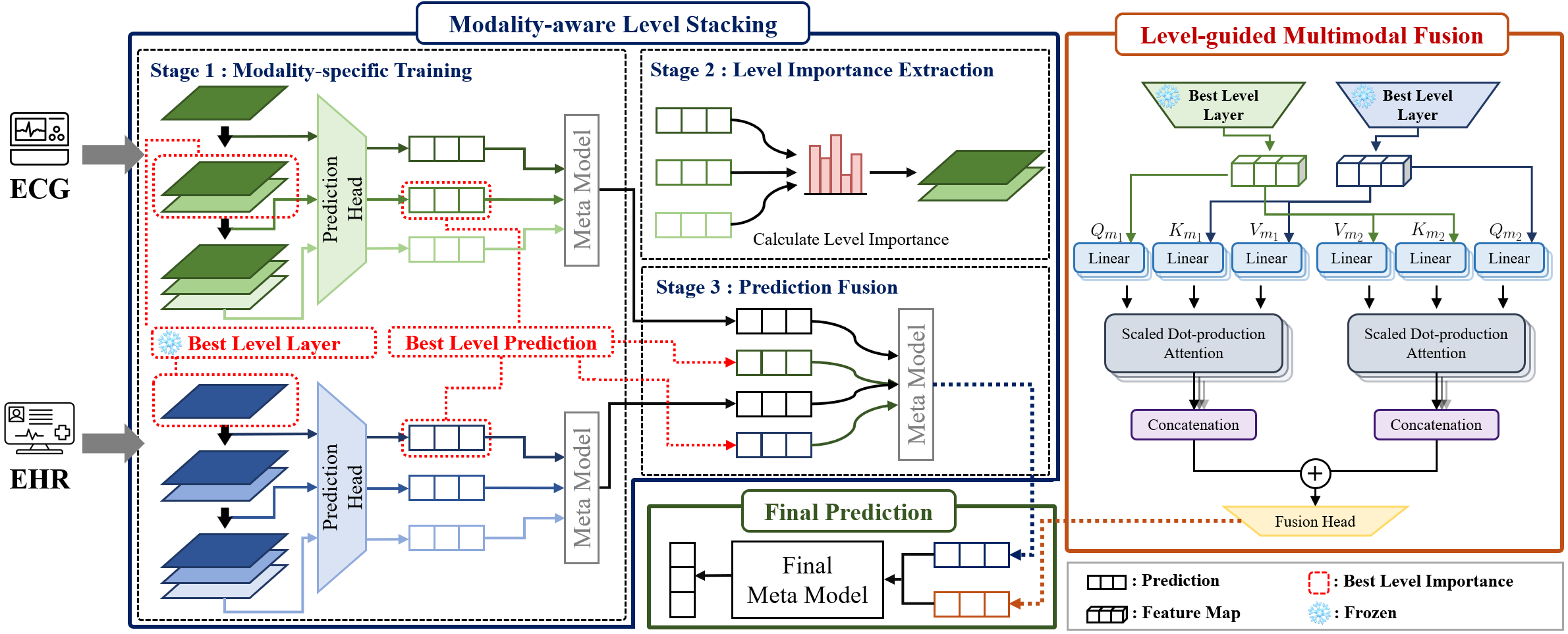

核心思路:LeMoF的核心思路是利用编码器不同层级的表征,这些层级代表了不同抽象程度的信息。通过选择性地融合这些层级表征,LeMoF能够更好地捕捉模态特有的信息,并平衡预测的稳定性和判别能力。该方法显式地分离和学习全局模态级别的预测,以及层级特定的判别性表征。

技术框架:LeMoF框架包含以下主要模块:1) 模态编码器:用于提取每个模态的层级表征;2) 层级引导模块:用于选择性地融合不同层级的表征;3) 全局预测模块:用于学习全局模态级别的预测;4) 层级特定预测模块:用于学习层级特定的判别性表征;5) 融合模块:用于融合全局预测和层级特定预测,得到最终的预测结果。整体流程是,首先使用模态编码器提取每个模态的层级表征,然后通过层级引导模块选择性地融合这些表征,接着分别使用全局预测模块和层级特定预测模块学习全局预测和层级特定预测,最后通过融合模块得到最终的预测结果。

关键创新:LeMoF的关键创新在于层级引导的模态融合策略。与现有方法不同,LeMoF不是简单地将所有模态的表征进行融合,而是根据每个模态的特点,选择性地融合不同层级的表征。这种策略能够更好地捕捉模态特有的信息,并提高预测的准确性。此外,LeMoF显式地分离和学习全局模态级别的预测,以及层级特定的判别性表征,进一步提高了预测的稳定性和判别能力。

关键设计:LeMoF的关键设计包括:1) 使用不同的编码器结构来提取不同模态的层级表征,例如,可以使用Transformer或LSTM等;2) 设计层级引导模块,用于选择性地融合不同层级的表征,例如,可以使用注意力机制或门控机制;3) 设计全局预测模块和层级特定预测模块,用于学习全局预测和层级特定预测,例如,可以使用多层感知机或卷积神经网络;4) 设计融合模块,用于融合全局预测和层级特定预测,例如,可以使用加权平均或拼接操作。损失函数的设计需要考虑全局预测和层级特定预测的贡献,可以使用交叉熵损失或均方误差损失。

🖼️ 关键图片

📊 实验亮点

在ICU住院时长预测实验中,LeMoF在各种编码器配置下始终优于现有的最先进的多模态融合技术。实验结果表明,层级集成是实现各种临床条件下稳健预测性能的关键因素。具体性能提升数据在论文中未明确给出,但强调了LeMoF在不同编码器配置下的稳定优越性。

🎯 应用场景

LeMoF可应用于多种临床预测任务,例如疾病诊断、预后预测、药物反应预测等。通过整合EHR、生物信号、影像数据等多模态信息,LeMoF能够提高预测的准确性和可靠性,辅助医生进行临床决策,改善患者的治疗效果。未来,LeMoF有望应用于个性化医疗和精准医疗领域,为患者提供更有效的治疗方案。

📄 摘要(原文)

Multimodal clinical prediction is widely used to integrate heterogeneous data such as Electronic Health Records (EHR) and biosignals. However, existing methods tend to rely on static modality integration schemes and simple fusion strategies. As a result, they fail to fully exploit modality-specific representations. In this paper, we propose Level-guided Modal Fusion (LeMoF), a novel framework that selectively integrates level-guided representations within each modality. Each level refers to a representation extracted from a different layer of the encoder. LeMoF explicitly separates and learns global modality-level predictions from level-specific discriminative representations. This design enables LeMoF to achieve a balanced performance between prediction stability and discriminative capability even in heterogeneous clinical environments. Experiments on length of stay prediction using Intensive Care Unit (ICU) data demonstrate that LeMoF consistently outperforms existing state-of-the-art multimodal fusion techniques across various encoder configurations. We also confirmed that level-wise integration is a key factor in achieving robust predictive performance across various clinical conditions.