PID-Guided Partial Alignment for Multimodal Decentralized Federated Learning

作者: Yanhang Shi, Xiaoyu Wang, Houwei Cao, Jian Li, Yong Liu

分类: cs.LG

发布日期: 2026-01-15

💡 一句话要点

PARSE:一种PID引导的局部对齐多模态去中心化联邦学习框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 去中心化联邦学习 局部信息分解 特征对齐 异构数据 知识共享 梯度对齐

📋 核心要点

- 传统多模态联邦学习依赖中心服务器,且忽略了不同模态智能体间的异构性,导致梯度冲突和性能下降。

- PARSE框架通过局部信息分解(PID)将特征分解为冗余、独特和协同切片,实现切片级别的知识共享。

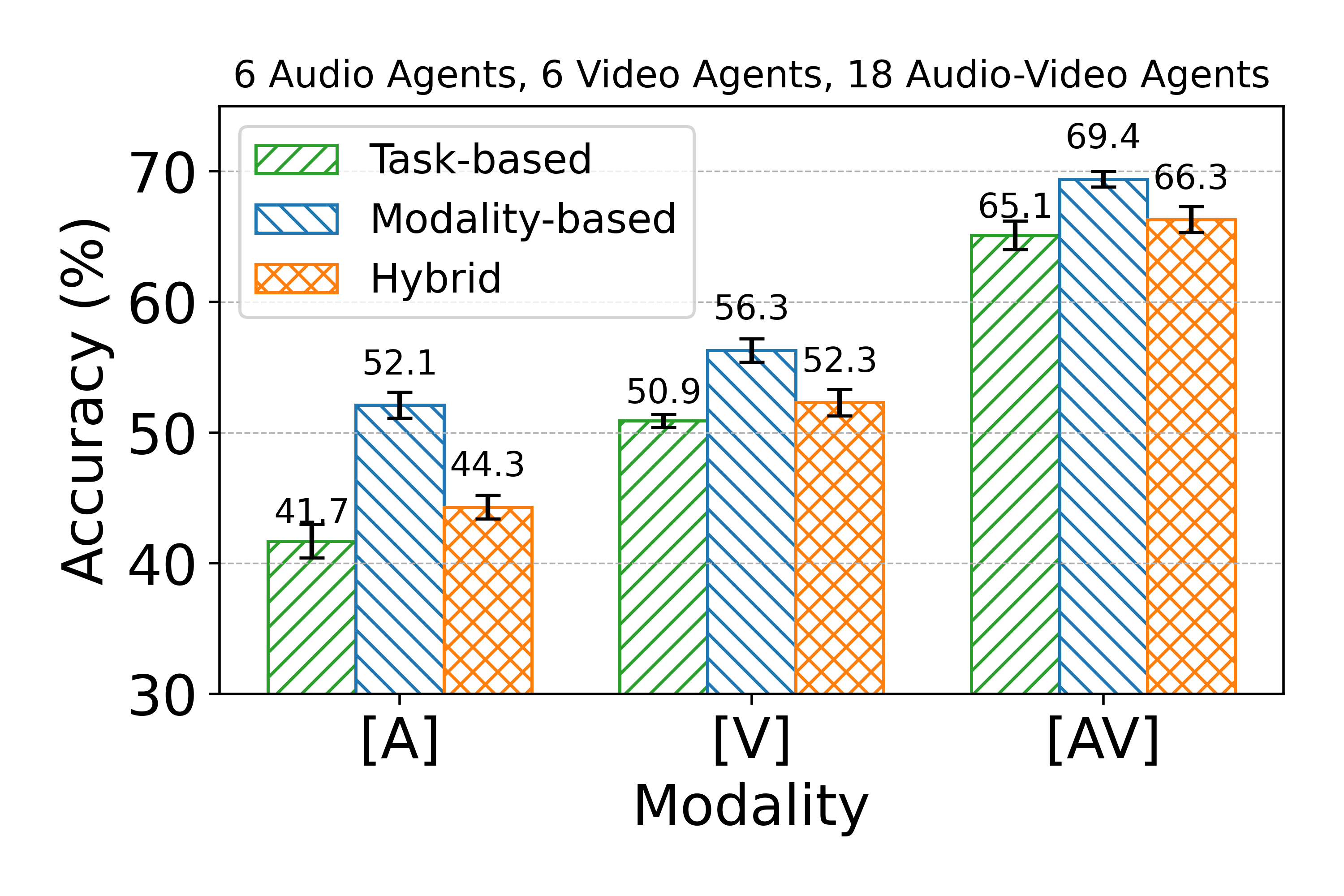

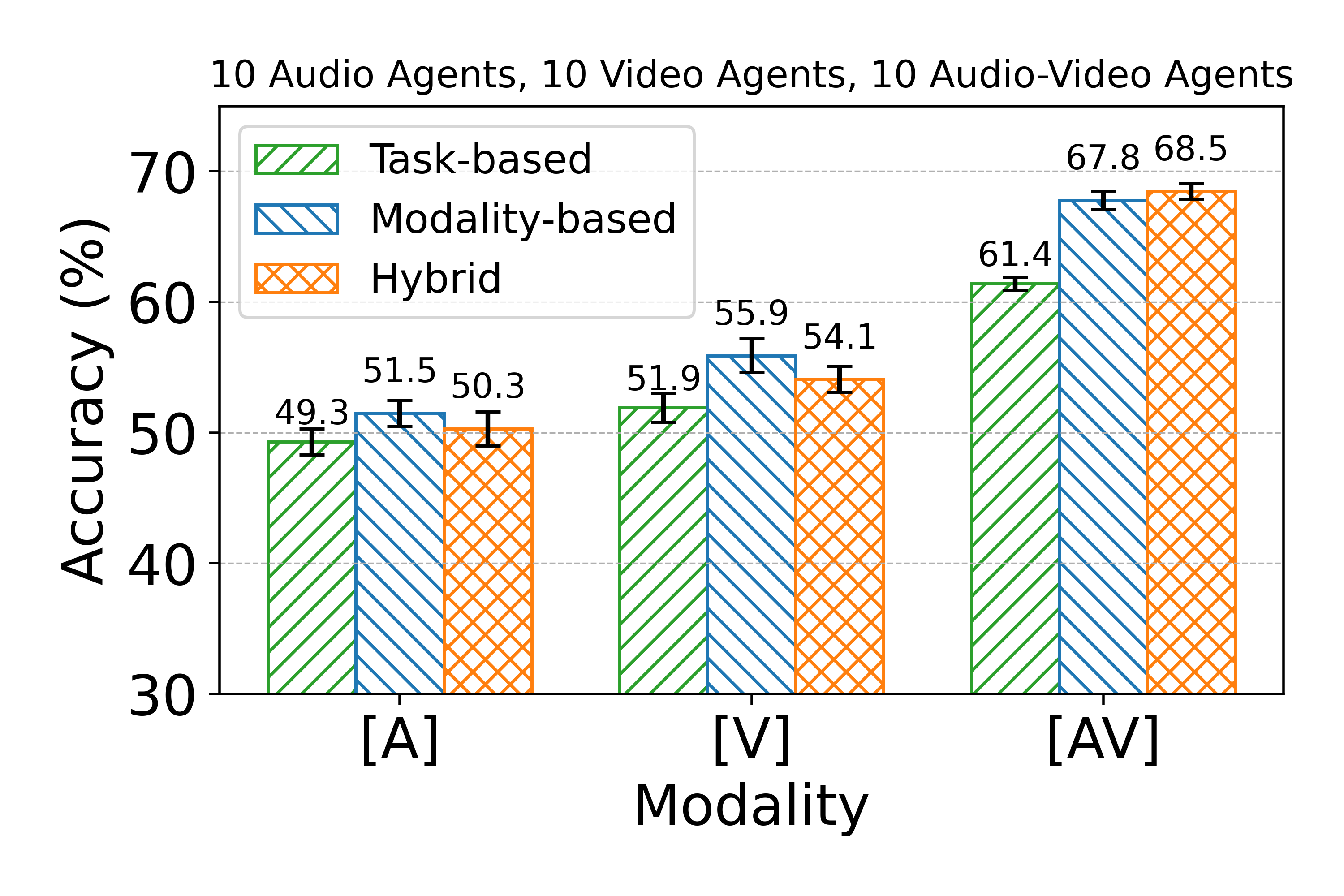

- 实验表明,PARSE在各种基准测试和智能体组合中,始终优于现有的任务、模态和混合共享DFL基线。

📝 摘要(中文)

多模态去中心化联邦学习(DFL)面临挑战,因为各智能体在可用模态和模型架构上存在差异,且必须在没有中央协调器的点对点(P2P)网络上进行协作。标准的多模态流程学习跨所有模态的单一共享嵌入。在DFL中,这种单体表示会导致单模态和多模态智能体之间的梯度不对齐;因此,它抑制了异构共享和跨模态交互。我们提出了PARSE,一个多模态DFL框架,在无服务器环境中实现局部信息分解(PID)。每个智能体执行特征分裂,将其潜在表示分解为冗余、独特和协同切片。通过切片级别的局部对齐,实现了异构智能体之间的P2P知识共享:只有语义上可共享的分支在拥有相应模态的智能体之间进行交换。通过消除对中央协调和梯度手术的需求,PARSE解决了单/多模态梯度冲突,从而克服了多模态DFL困境,同时保持与标准DFL约束的兼容性。在跨基准和智能体组合中,PARSE相对于任务、模态和混合共享DFL基线产生了持续的收益。对融合算子和分割比例的消融研究,以及定性可视化,进一步证明了所提出设计的效率和鲁棒性。

🔬 方法详解

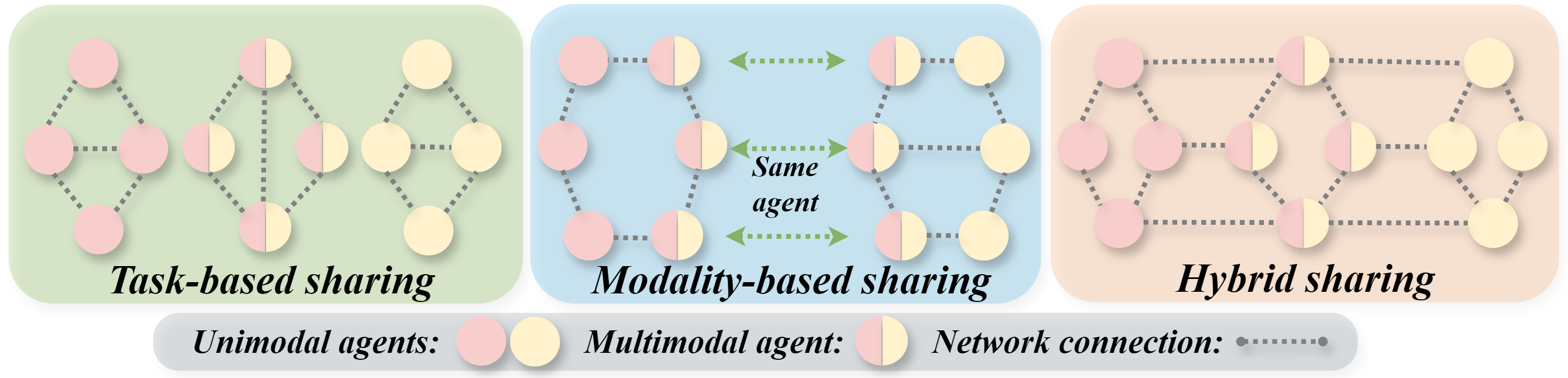

问题定义:多模态去中心化联邦学习(DFL)旨在解决不同智能体拥有不同模态数据和模型架构,且无法依赖中央服务器进行协调的问题。现有方法,如学习单一共享嵌入,在异构模态场景下会导致梯度不对齐,阻碍知识共享和跨模态交互,降低模型性能。

核心思路:PARSE的核心思路是利用局部信息分解(PID)将每个智能体的特征表示分解为多个切片,包括冗余、独特和协同信息。然后,通过切片级别的局部对齐,只在拥有对应模态的智能体之间共享语义上可共享的分支,从而避免梯度冲突,促进异构智能体之间的知识迁移。

技术框架:PARSE框架主要包含以下几个阶段:1) 特征提取:每个智能体使用自己的模型提取特征。2) 特征分解:使用PID将特征分解为冗余、独特和协同切片。3) 局部对齐:智能体之间通过P2P网络交换切片,只共享语义上可共享的分支。4) 模型更新:每个智能体使用接收到的切片更新自己的模型。

关键创新:PARSE的关键创新在于引入了PID到多模态DFL中,实现了切片级别的知识共享。与传统的共享单一嵌入的方法相比,PARSE能够更好地处理异构模态数据,避免梯度冲突,提高模型性能。此外,PARSE无需中央协调器和梯度手术,更符合去中心化联邦学习的原则。

关键设计:PARSE的关键设计包括:1) 特征分解的PID方法选择,可以使用不同的PID变体。2) 切片共享策略,需要定义哪些切片是语义上可共享的。3) 融合算子的选择,用于将接收到的切片与本地特征进行融合。4) 损失函数的设计,需要考虑如何平衡不同切片的贡献。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PARSE在多个基准数据集和智能体组合中,均优于现有的任务、模态和混合共享DFL基线。例如,在某个数据集上,PARSE相比最佳基线提升了5%的准确率。消融实验验证了特征分解和局部对齐的有效性,以及融合算子和分割比例对性能的影响。

🎯 应用场景

PARSE框架可应用于各种多模态数据融合场景,例如自动驾驶(图像、激光雷达、雷达)、医疗诊断(图像、文本、基因数据)和情感分析(文本、语音、视频)。该框架能够有效利用异构数据,提高模型性能,并保护用户隐私,具有广阔的应用前景。

📄 摘要(原文)

Multimodal decentralized federated learning (DFL) is challenging because agents differ in available modalities and model architectures, yet must collaborate over peer-to-peer (P2P) networks without a central coordinator. Standard multimodal pipelines learn a single shared embedding across all modalities. In DFL, such a monolithic representation induces gradient misalignment between uni- and multimodal agents; as a result, it suppresses heterogeneous sharing and cross-modal interaction. We present PARSE, a multimodal DFL framework that operationalizes partial information decomposition (PID) in a server-free setting. Each agent performs feature fission to factorize its latent representation into redundant, unique, and synergistic slices. P2P knowledge sharing among heterogeneous agents is enabled by slice-level partial alignment: only semantically shareable branches are exchanged among agents that possess the corresponding modality. By removing the need for central coordination and gradient surgery, PARSE resolves uni-/multimodal gradient conflicts, thereby overcoming the multimodal DFL dilemma while remaining compatible with standard DFL constraints. Across benchmarks and agent mixes, PARSE yields consistent gains over task-, modality-, and hybrid-sharing DFL baselines. Ablations on fusion operators and split ratios, together with qualitative visualizations, further demonstrate the efficiency and robustness of the proposed design.