Exploring Fine-Tuning for Tabular Foundation Models

作者: Aditya Tanna, Pratinav Seth, Mohamed Bouadi, Vinay Kumar Sankarapu

分类: cs.LG

发布日期: 2026-01-14

💡 一句话要点

针对表格基础模型,研究微调策略对性能、校准和公平性的影响

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 表格基础模型 微调策略 零样本学习 元学习 参数高效微调 监督微调 数据集特征 校准质量

📋 核心要点

- 现有表格基础模型虽有零样本能力,但微调策略的效果尚不明确,存在性能退化风险。

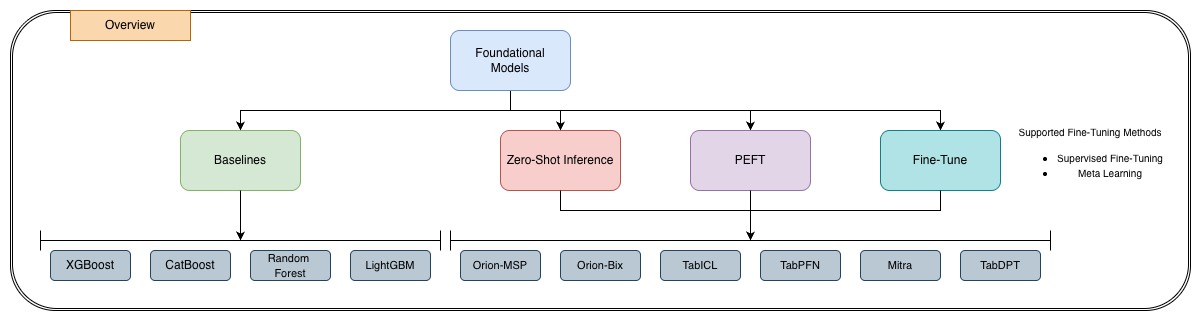

- 论文系统研究了零样本、元学习、监督微调和参数高效微调等策略对表格基础模型的影响。

- 实验表明,微调收益与数据集特性密切相关,并提供了微调策略选择的实用指导。

📝 摘要(中文)

表格基础模型(TFMs)最近在结构化数据上展现出强大的上下文学习能力,实现了与传统机器学习方法相当的零样本性能。我们发现零样本TFMs已经取得了不错的性能,而微调的益处高度依赖于模型和数据。元学习和参数高效微调(PEFT)在特定条件下提供了适度的增益,而完全监督微调(SFT)通常会降低准确性或校准质量。本研究首次对TFMs的微调进行了全面研究,涵盖了TALENT、OpenML-CC18和TabZilla等基准。我们比较了零样本、元学习、监督(SFT)和参数高效(PEFT)方法,分析了数据集因素(如不平衡、大小和维度)如何影响结果。我们的发现涵盖了性能、校准和公平性,为微调何时最有利以及其局限性提供了实用的指导。

🔬 方法详解

问题定义:论文旨在研究表格基础模型(TFMs)在各种微调策略下的表现,包括零样本学习、元学习、完全监督微调(SFT)和参数高效微调(PEFT)。现有方法,特别是完全监督微调,在表格数据上常常导致性能下降或校准质量变差,这与在自然语言处理等领域的经验不同。因此,需要系统地研究不同微调策略在表格数据上的适用性,并分析数据集特性对微调效果的影响。

核心思路:论文的核心思路是通过对比不同微调策略在多个表格数据集上的表现,分析数据集的特征(如不平衡性、大小、维度)与微调效果之间的关系。通过这种方式,可以为用户提供关于何时以及如何微调表格基础模型的实用指导,从而避免盲目微调导致的性能下降。

技术框架:论文的整体框架包括以下几个步骤:1)选择多个具有代表性的表格数据集,涵盖不同的领域和特征;2)选择几种常用的微调策略,包括零样本学习、元学习、完全监督微调和参数高效微调;3)在每个数据集上,使用不同的微调策略训练表格基础模型;4)评估模型的性能、校准质量和公平性;5)分析数据集特征与微调效果之间的关系,总结出微调策略选择的指导原则。

关键创新:论文的关键创新在于首次对表格基础模型的微调进行了全面的研究,并揭示了数据集特征对微调效果的重要影响。之前的研究主要集中在零样本学习或特定微调策略上,缺乏对不同策略的系统比较和对数据集特征的深入分析。此外,论文还关注了模型的校准质量和公平性,这在表格数据领域的研究中相对较少。

关键设计:论文的关键设计包括:1)选择了TALENT、OpenML-CC18和TabZilla等多个具有代表性的表格数据集;2)使用了多种常用的微调策略,包括LoRA等参数高效微调方法;3)使用了多种评估指标,包括准确率、校准误差和公平性指标;4)对数据集特征进行了量化分析,如使用信息熵来衡量数据集的不平衡性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,零样本TFMs已经具有较强的性能,而完全监督微调(SFT)往往会降低准确性或校准质量。元学习和参数高效微调(PEFT)在特定条件下可以提供适度的增益。论文还分析了数据集的不平衡性、大小和维度等因素对微调效果的影响,并提供了微调策略选择的实用指导。

🎯 应用场景

该研究成果可应用于金融风控、医疗诊断、客户关系管理等领域,帮助从业者更好地利用表格基础模型解决实际问题。通过选择合适的微调策略,可以提高模型的准确性、可靠性和公平性,从而做出更明智的决策,并降低潜在的风险。未来的研究可以探索更有效的微调方法,并将其应用于更广泛的表格数据场景。

📄 摘要(原文)

Tabular Foundation Models (TFMs) have recently shown strong in-context learning capabilities on structured data, achieving zero-shot performance comparable to traditional machine learning methods. We find that zero-shot TFMs already achieve strong performance, while the benefits of fine-tuning are highly model and data-dependent. Meta-learning and PEFT provide moderate gains under specific conditions, whereas full supervised fine-tuning (SFT) often reduces accuracy or calibration quality. This work presents the first comprehensive study of fine-tuning in TFMs across benchmarks including TALENT, OpenML-CC18, and TabZilla. We compare Zero-Shot, Meta-Learning, Supervised (SFT), and parameter-efficient (PEFT) approaches, analyzing how dataset factors such as imbalance, size, and dimensionality affect outcomes. Our findings cover performance, calibration, and fairness, offering practical guidelines on when fine-tuning is most beneficial and its limitations.