From Prompt to Protocol: Fast Charging Batteries with Large Language Models

作者: Ge Lei, Ferran Brosa Planella, Sterling G. Baird, Samuel J. Cooper

分类: cs.LG, cs.AI, eess.SY

发布日期: 2026-01-14

💡 一句话要点

利用大语言模型快速优化电池充电协议,提升电池健康状态。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 电池充电优化 大语言模型 无梯度优化 快速充电 电池健康状态

📋 核心要点

- 电池充电协议优化面临评估成本高、耗时且不可微的难题,限制了探索更优协议的范围。

- 论文提出Prompt-to-Optimizer (P2O) 和 Prompt-to-Protocol (P2P) 两种基于LLM的无梯度优化方法。

- 实验表明,P2O优于传统优化方法,P2O和P2P在快速充电场景下均能显著提升电池健康状态。

📝 摘要(中文)

优化电池充电协议极具挑战,因为每次评估都耗时、昂贵且不可微。现有方法通常通过大幅约束协议搜索空间来解决此问题,但这限制了可探索协议的多样性,阻碍了更高性能解决方案的发现。本文提出了两种基于大语言模型(LLM)驱动的无梯度闭环方法:Prompt-to-Optimizer (P2O),它使用LLM来生成小型神经网络协议的代码,然后通过内部循环进行训练;以及Prompt-to-Protocol (P2P),它直接编写电流及其标量参数的显式函数。在案例研究中,LLM引导的P2O优于通过贝叶斯优化、进化算法和随机搜索设计的神经网络。在实际的快速充电场景中,P2O和P2P在健康状态(快速充电循环下的容量保持率)方面比最先进的多步恒流(CC)基线提高了约4.2%,其中P2P在匹配的评估预算下(相同数量的协议评估)实现了这一目标。这些结果表明,LLM可以扩展协议函数形式的空间,结合基于语言的约束,并在高成本实验环境中实现高效优化。

🔬 方法详解

问题定义:论文旨在解决电池快速充电协议优化问题。现有方法,如贝叶斯优化、进化算法等,通常需要大量的实验评估,且搜索空间受限,难以发现高性能的充电协议。此外,电池充电过程的评估成本高昂,使得传统的梯度优化方法难以应用。

核心思路:论文的核心思路是利用大语言模型(LLM)的强大代码生成和理解能力,直接生成或辅助生成充电协议。通过LLM,可以扩展协议的函数形式空间,并融入语言层面的约束,从而在有限的实验预算下,高效地探索更优的充电协议。

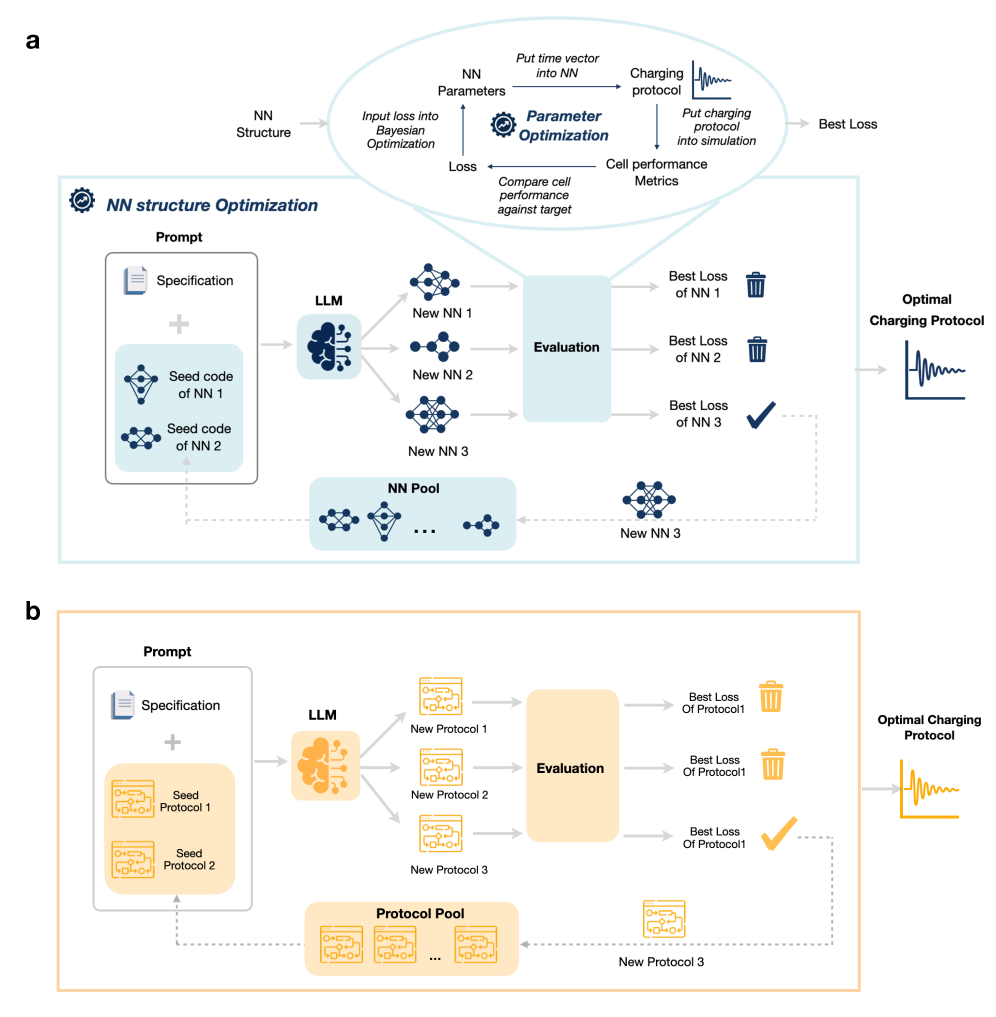

技术框架:论文提出了两种方法:Prompt-to-Optimizer (P2O) 和 Prompt-to-Protocol (P2P)。P2O方法首先使用LLM生成小型神经网络的代码,该神经网络定义了充电协议。然后,通过一个内部优化循环,训练该神经网络,使其能够生成更优的充电协议。P2P方法则直接使用LLM生成一个显式的函数,该函数描述了电流及其标量参数。该函数直接定义了充电协议。两种方法都采用闭环优化,即根据实验结果不断调整LLM的prompt,以生成更好的协议。

关键创新:论文的关键创新在于将大语言模型引入到电池充电协议优化领域。与传统的优化方法相比,LLM能够生成更复杂、更灵活的协议函数形式,并能够利用语言信息进行约束。此外,LLM的无梯度特性使其能够在高成本实验环境中进行优化。

关键设计:P2O方法中,LLM生成的神经网络通常较小,以降低训练成本。内部优化循环可以使用各种无梯度优化算法,如进化算法或贝叶斯优化。P2P方法中,LLM生成的函数需要能够描述电流随时间的变化,并包含可优化的标量参数。Prompt的设计至关重要,需要包含关于电池类型、充电目标和约束条件的信息。

🖼️ 关键图片

📊 实验亮点

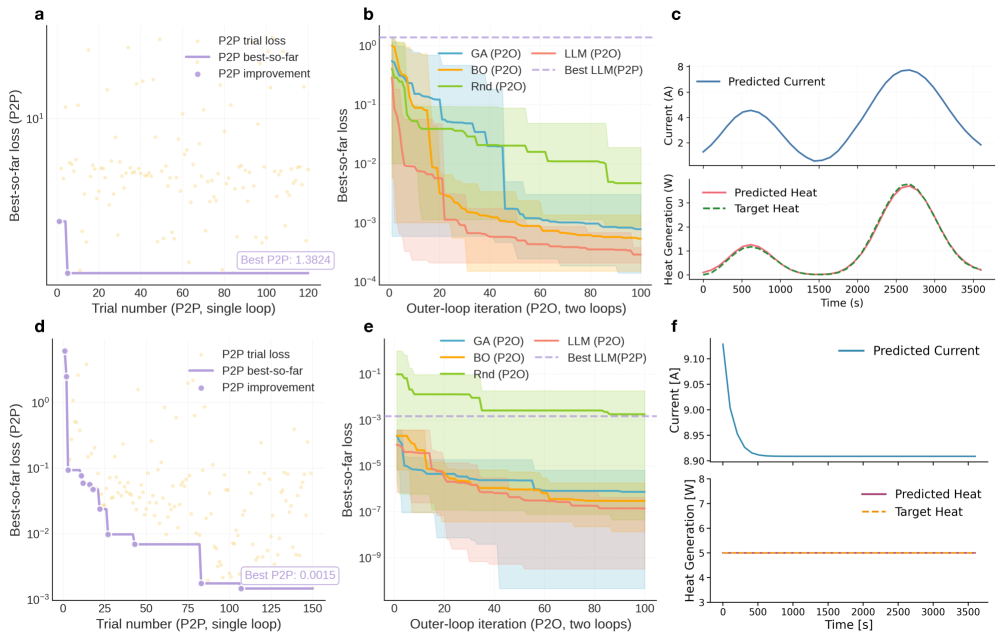

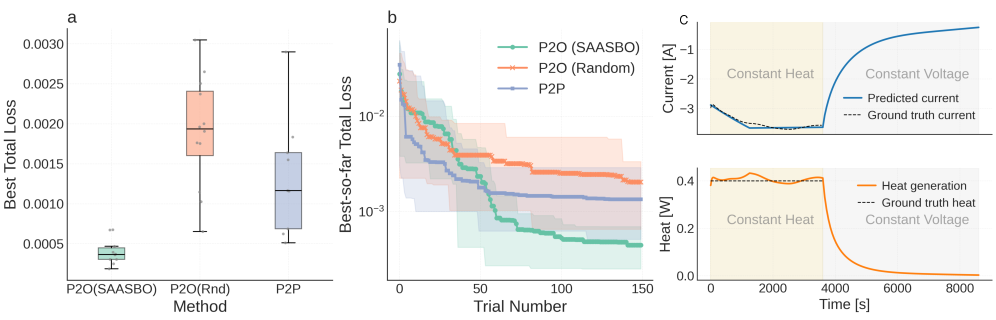

实验结果表明,LLM引导的P2O方法优于贝叶斯优化、进化算法和随机搜索设计的神经网络。在实际的快速充电场景中,P2O和P2P方法在电池健康状态方面比最先进的多步恒流(CC)基线提高了约4.2%,且P2P方法在相同评估预算下实现了这一提升。

🎯 应用场景

该研究成果可应用于电动汽车、储能系统等领域,通过优化电池充电协议,延长电池寿命,提高能量利用率,降低运营成本。此外,该方法也可推广到其他需要优化复杂实验流程的领域,如材料科学、化学反应等。

📄 摘要(原文)

Efficiently optimizing battery charging protocols is challenging because each evaluation is slow, costly, and non-differentiable. Many existing approaches address this difficulty by heavily constraining the protocol search space, which limits the diversity of protocols that can be explored, preventing the discovery of higher-performing solutions. We introduce two gradient-free, LLM-driven closed-loop methods: Prompt-to-Optimizer (P2O), which uses an LLM to propose the code for small neural-network-based protocols, which are then trained by an inner loop, and Prompt-to-Protocol (P2P), which simply writes an explicit function for the current and its scalar parameters. Across our case studies, LLM-guided P2O outperforms neural networks designed by Bayesian optimization, evolutionary algorithms, and random search. In a realistic fast charging scenario, both P2O and P2P yield around a 4.2 percent improvement in state of health (capacity retention based health metric under fast charging cycling) over a state-of-the-art multi-step constant current (CC) baseline, with P2P achieving this under matched evaluation budgets (same number of protocol evaluations). These results demonstrate that LLMs can expand the space of protocol functional forms, incorporate language-based constraints, and enable efficient optimization in high cost experimental settings.