Discrete Solution Operator Learning for Geometry-Dependent PDEs

作者: Jinshuai Bai, Haolin Li, Zahra Sharif Khodaei, M. H. Aliabadi, YuanTong Gu, Xi-Qiao Feng

分类: cs.LG, math.NA, physics.comp-ph

发布日期: 2026-01-14

备注: 15 pages main text, 40 pages SI

💡 一句话要点

提出离散解算子学习DiSOL,解决几何依赖偏微分方程的求解难题。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 神经算子学习 偏微分方程 几何依赖问题 离散求解 科学机器学习

📋 核心要点

- 传统神经算子学习在几何结构变化剧烈时失效,因为其依赖于函数空间的平滑映射假设。

- DiSOL学习离散求解过程,将求解器分解为局部编码、多尺度组装和隐式解重构等可学习阶段。

- 实验表明,DiSOL在各种几何依赖PDE问题上,即使在不连续边界和拓扑变化下,也能保持稳定和准确的预测。

📝 摘要(中文)

神经算子学习通过将算子近似为连续函数空间之间的映射来加速偏微分方程(PDE)的求解。然而,在许多工程环境中,变化的几何形状会导致离散的结构变化,包括拓扑变化、边界条件或边界类型的突变以及有效计算域的变化,这些都打破了平滑变化的假设。本文提出了一种互补的范式——离散解算子学习(DiSOL),它学习离散的求解过程,而不是连续的函数空间算子。DiSOL将求解器分解为可学习的阶段,这些阶段反映了经典的离散化方法:局部贡献编码、多尺度组装和嵌入网格上的隐式解重构,从而在适应几何相关的离散结构的同时,保持了过程级别的连贯性。在几何相关的泊松方程、对流扩散方程、线性弹性方程以及时空热传导问题中,DiSOL在同分布和强烈的异分布几何形状下,包括不连续边界和拓扑变化,都能产生稳定和准确的预测。这些结果突出了在几何主导的领域中对程序算子表示的需求,并将离散解算子学习定位为科学机器学习中一个独特的、互补的方向。

🔬 方法详解

问题定义:论文旨在解决几何形状变化对偏微分方程(PDE)求解带来的挑战。传统神经算子学习方法依赖于连续函数空间的映射,当几何形状发生显著变化(如拓扑变化、边界条件突变)时,其平滑性假设不再成立,导致求解精度下降甚至失效。现有方法难以处理这些几何依赖的离散结构变化。

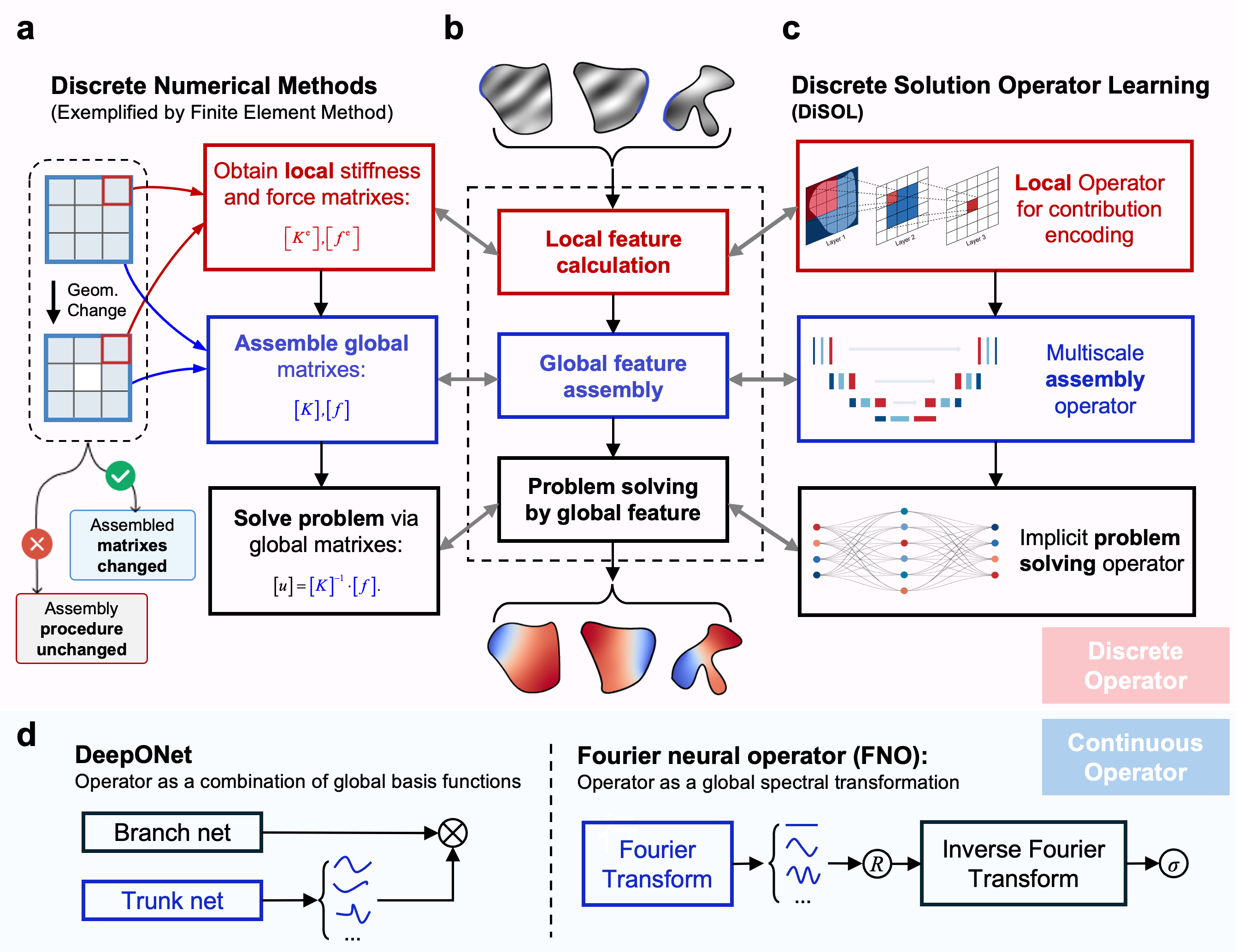

核心思路:DiSOL的核心思路是将PDE求解过程视为一个离散的、程序化的过程,并学习这个过程中的关键步骤。它借鉴了传统数值方法的离散化思想,将求解器分解为多个可学习的阶段,每个阶段对应于数值方法中的一个步骤。通过学习这些离散步骤,DiSOL能够更好地适应几何形状的变化,并保持求解过程的连贯性。

技术框架:DiSOL的整体框架包含三个主要阶段:1) 局部贡献编码:对局部几何信息和物理量进行编码,提取局部特征。2) 多尺度组装:将局部特征在多尺度下进行组装,形成全局表示。3) 隐式解重构:利用全局表示重构PDE的解。这三个阶段通过神经网络进行学习,从而实现对离散求解过程的建模。

关键创新:DiSOL的关键创新在于它将神经算子学习从连续函数空间映射转向了离散求解过程的学习。与传统方法直接学习连续解算子不同,DiSOL学习的是离散求解步骤,从而更好地适应几何形状的变化。这种方法保留了程序级别的连贯性,并能够处理不连续边界和拓扑变化等复杂情况。

关键设计:DiSOL的具体实现细节包括:使用图神经网络(GNN)进行局部贡献编码和多尺度组装,利用卷积神经网络(CNN)进行隐式解重构。损失函数的设计旨在保证求解的精度和稳定性。具体的网络结构和参数设置需要根据具体的PDE问题进行调整。论文中可能使用了特定的激活函数、优化器和正则化方法来提高模型的性能。

🖼️ 关键图片

📊 实验亮点

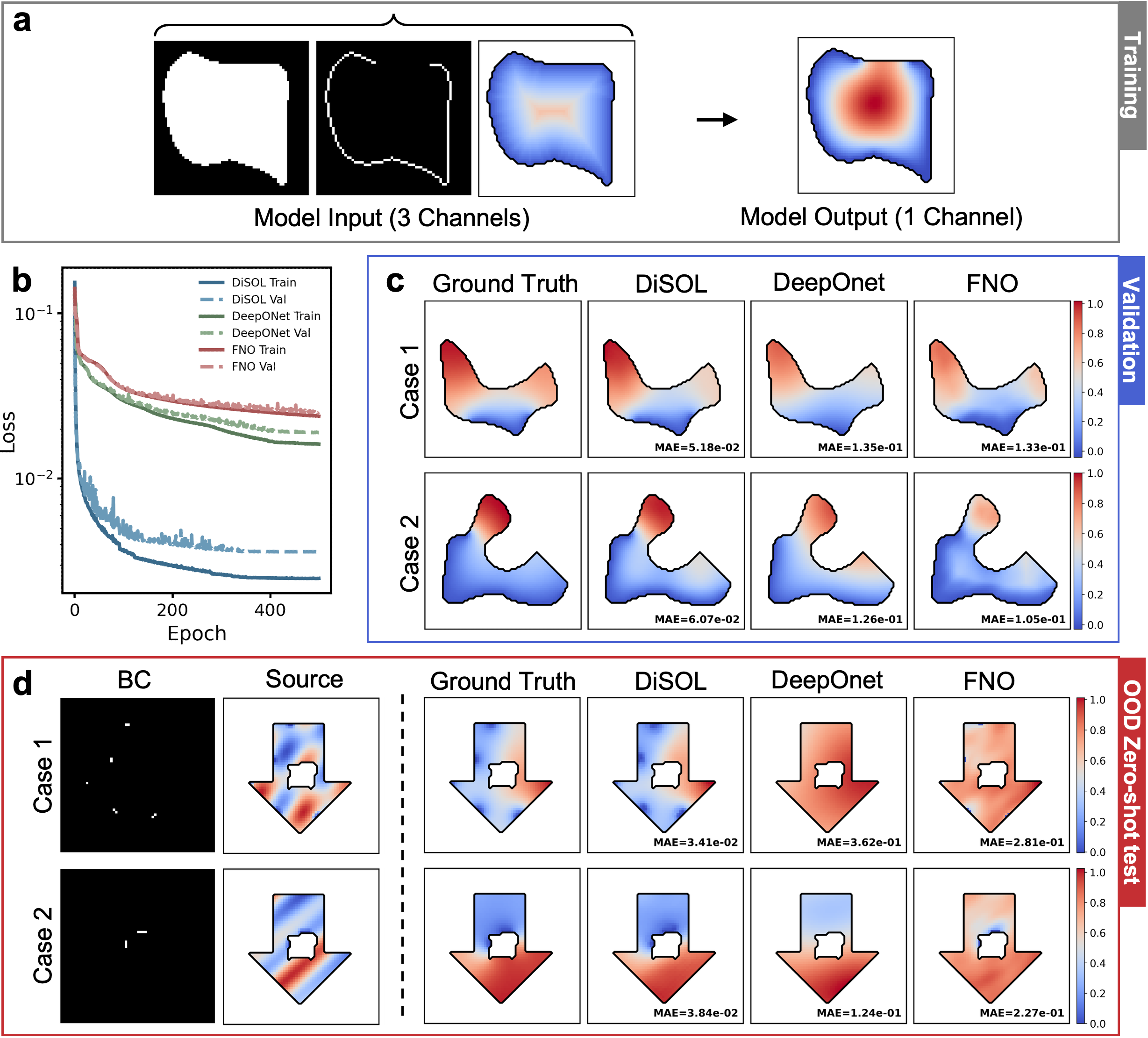

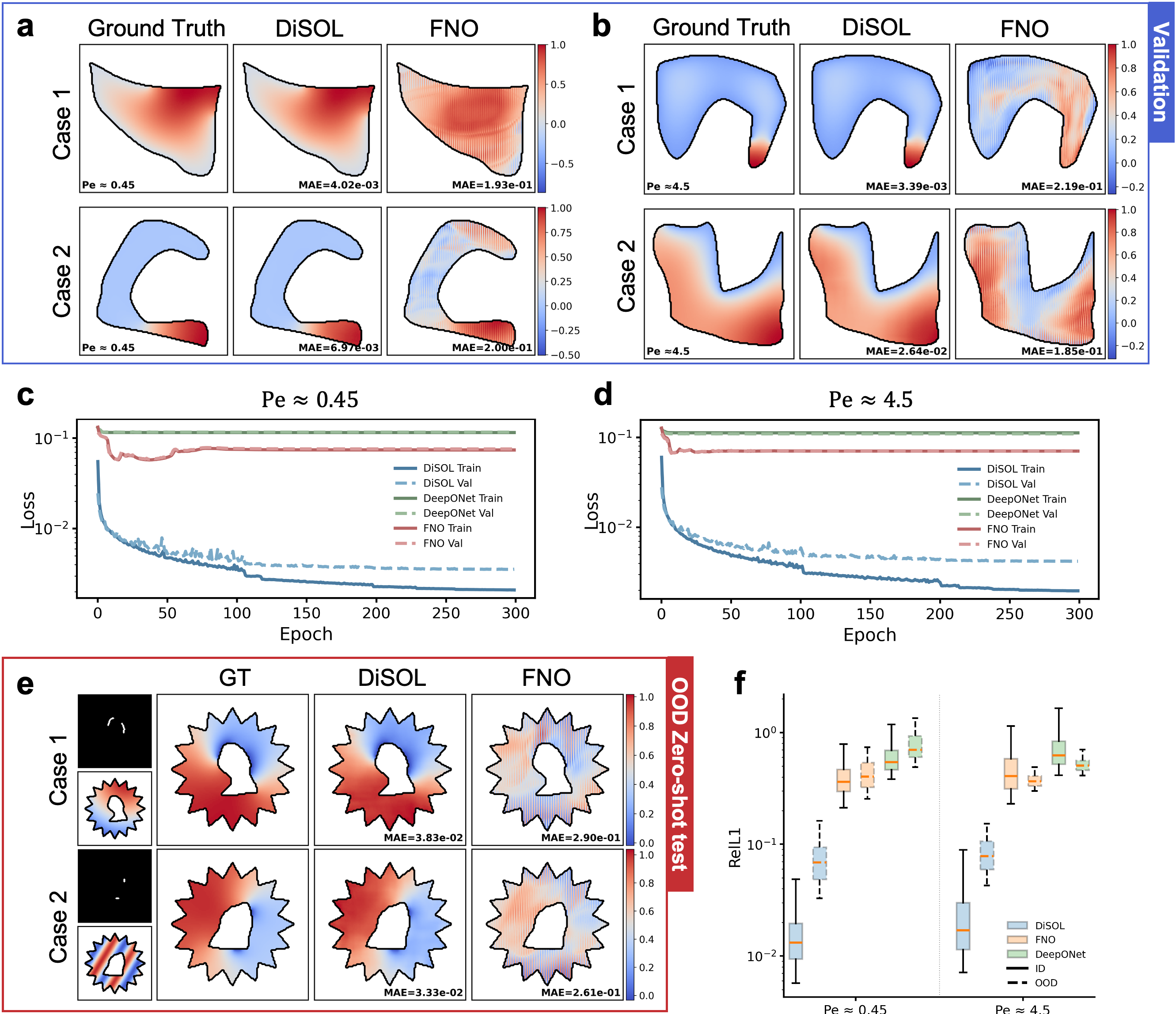

DiSOL在几何依赖的泊松方程、对流扩散方程、线性弹性方程以及时空热传导问题上进行了实验验证。结果表明,DiSOL在同分布和强烈的异分布几何形状下,包括不连续边界和拓扑变化,都能产生稳定和准确的预测。相较于传统神经算子学习方法,DiSOL在处理复杂几何形状问题时具有显著的优势。

🎯 应用场景

DiSOL在工程领域具有广泛的应用前景,例如结构力学分析、流体力学模拟、电磁场计算等。它可以用于快速求解具有复杂几何形状的PDE问题,加速工程设计和优化过程。此外,DiSOL还可以应用于医学图像分析、气候模拟等领域,为科学研究提供新的工具。

📄 摘要(原文)

Neural operator learning accelerates PDE solution by approximating operators as mappings between continuous function spaces. Yet in many engineering settings, varying geometry induces discrete structural changes, including topological changes, abrupt changes in boundary conditions or boundary types, and changes in the effective computational domain, which break the smooth-variation premise. Here we introduce Discrete Solution Operator Learning (DiSOL), a complementary paradigm that learns discrete solution procedures rather than continuous function-space operators. DiSOL factorizes the solver into learnable stages that mirror classical discretizations: local contribution encoding, multiscale assembly, and implicit solution reconstruction on an embedded grid, thereby preserving procedure-level consistency while adapting to geometry-dependent discrete structures. Across geometry-dependent Poisson, advection-diffusion, linear elasticity, as well as spatiotemporal heat-conduction problems, DiSOL produces stable and accurate predictions under both in-distribution and strongly out-of-distribution geometries, including discontinuous boundaries and topological changes. These results highlight the need for procedural operator representations in geometry-dominated regimes and position discrete solution operator learning as a distinct, complementary direction in scientific machine learning.