Deep Exploration of Epoch-wise Double Descent in Noisy Data: Signal Separation, Large Activation, and Benign Overfitting

作者: Tomoki Kubo, Ryuken Uda, Yusuke Iida

分类: cs.LG, cs.CV, stat.ML

发布日期: 2026-01-13

备注: 17 pages, 9 figures

💡 一句话要点

研究噪声数据下epoch-wise双下降现象,揭示泛化能力与内部激活模式关联

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 深度双下降 良性过拟合 噪声数据 泛化能力 大规模激活

📋 核心要点

- 深度学习模型在噪声数据下的泛化能力仍面临挑战,现有方法难以解释epoch-wise双下降现象。

- 论文通过分解损失曲线,分别分析干净数据和噪声数据的内部信号演变,揭示模型泛化与内部激活模式的关联。

- 实验表明,模型在拟合噪声数据后仍能重新泛化,噪声数据激活逐渐分离,浅层出现与输入相关的巨大激活。

📝 摘要(中文)

本研究深入探讨了深度学习模型泛化能力的关键现象之一:epoch-wise双下降。通过在含有30%标签噪声的CIFAR-10数据集上训练三种不同规模的全连接神经网络,研究着重分析了模型内部结构的演变。研究将损失曲线分解为来自干净数据和噪声数据的信号贡献,从而分别分析了内部信号的epoch-wise演变。研究发现了三个主要结论:首先,模型在双下降阶段即使完全拟合了噪声训练数据后,也能在测试数据上实现强大的重新泛化,对应于“良性过拟合”状态。其次,噪声数据在干净数据之后被学习,并且随着学习的进行,它们对应的内部激活在外部层中变得越来越分离,这使得模型能够仅过拟合噪声数据。第三,在所有模型的浅层中都出现了一个非常大的激活,这种现象被称为“异常值”、“大规模激活”和“超级激活”,并且随着重新泛化而演变。大型激活的幅度与输入模式相关,但与输出模式无关。这些经验性发现直接将“深度双下降”、“良性过拟合”和“大型激活”等最新关键现象联系起来,并支持理解深度双下降的新方案。

🔬 方法详解

问题定义:论文旨在解决深度学习模型在噪声数据下训练时出现的epoch-wise双下降现象的内在机制问题。现有方法难以解释模型在过拟合噪声数据后仍能重新泛化的现象,以及内部表征如何演变以实现这种泛化能力。

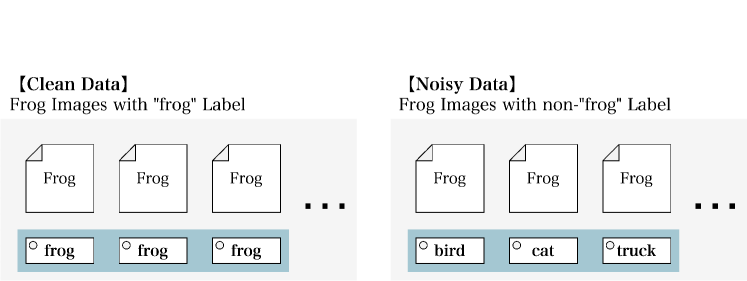

核心思路:论文的核心思路是将损失函数分解为干净数据和噪声数据的贡献,从而分别跟踪模型对这两类数据的学习过程。通过分析内部激活的演变,揭示模型如何区分和处理噪声数据,最终实现良性过拟合。

技术框架:整体框架包括以下步骤:1) 在CIFAR-10数据集上添加30%的标签噪声;2) 训练三种不同大小的全连接神经网络;3) 将损失函数分解为干净数据和噪声数据的贡献;4) 分析每一层网络的激活值随epoch的变化,特别是关注大型激活的出现和演变;5) 分析激活值与输入模式和输出模式的相关性。

关键创新:论文的关键创新在于将损失分解和激活分析相结合,从而能够细粒度地观察模型在训练过程中对干净数据和噪声数据的学习情况。此外,论文还发现了大型激活与重新泛化之间的联系,为理解深度双下降现象提供了新的视角。

关键设计:论文的关键设计包括:1) 使用全连接神经网络,以便更容易分析每一层的激活值;2) 使用CIFAR-10数据集,因为它是一个常用的图像分类数据集,并且可以方便地添加标签噪声;3) 将损失函数分解为干净数据和噪声数据的贡献,这使得可以分别跟踪模型对这两类数据的学习情况;4) 分析激活值与输入模式和输出模式的相关性,这有助于理解大型激活的含义。

🖼️ 关键图片

📊 实验亮点

实验结果表明,模型在完全拟合噪声数据后仍能实现重新泛化,验证了“良性过拟合”现象。研究还发现,噪声数据激活逐渐分离,浅层出现与输入相关的巨大激活,这些发现为理解深度双下降提供了新的证据。

🎯 应用场景

该研究成果有助于提升深度学习模型在噪声环境下的鲁棒性和泛化能力,可应用于自动驾驶、医疗诊断等对数据质量要求较高的领域。理解epoch-wise双下降现象,有助于设计更有效的训练策略和网络结构。

📄 摘要(原文)

Deep double descent is one of the key phenomena underlying the generalization capability of deep learning models. In this study, epoch-wise double descent, which is delayed generalization following overfitting, was empirically investigated by focusing on the evolution of internal structures. Fully connected neural networks of three different sizes were trained on the CIFAR-10 dataset with 30% label noise. By decomposing the loss curves into signal contributions from clean and noisy training data, the epoch-wise evolutions of internal signals were analyzed separately. Three main findings were obtained from this analysis. First, the model achieved strong re-generalization on test data even after perfectly fitting noisy training data during the double descent phase, corresponding to a "benign overfitting" state. Second, noisy data were learned after clean data, and as learning progressed, their corresponding internal activations became increasingly separated in outer layers; this enabled the model to overfit only noisy data. Third, a single, very large activation emerged in the shallow layer across all models; this phenomenon is referred as "outliers," "massive activa-tions," and "super activations" in recent large language models and evolves with re-generalization. The magnitude of large activation correlated with input patterns but not with output patterns. These empirical findings directly link the recent key phenomena of "deep double descent," "benign overfitting," and "large activation", and support the proposal of a novel scenario for understanding deep double descent.