Structure Detection for Contextual Reinforcement Learning

作者: Tianyue Zhou, Jung-Hoon Cho, Cathy Wu

分类: cs.LG

发布日期: 2026-01-13

💡 一句话要点

提出SD-MBTL框架,通过在线结构检测提升上下文强化学习的泛化性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 上下文强化学习 迁移学习 结构检测 模型驱动 泛化性能

📋 核心要点

- 传统上下文强化学习方法在计算成本和负迁移方面存在挑战,而MBTL方法依赖于固定的任务选择策略。

- SD-MBTL框架通过在线检测CMDP的底层泛化结构,动态选择合适的MBTL算法,实现更有效的任务迁移。

- 实验结果表明,M/GP-MBTL在多个CRL基准测试中显著优于现有方法,提升高达12.49%。

📝 摘要(中文)

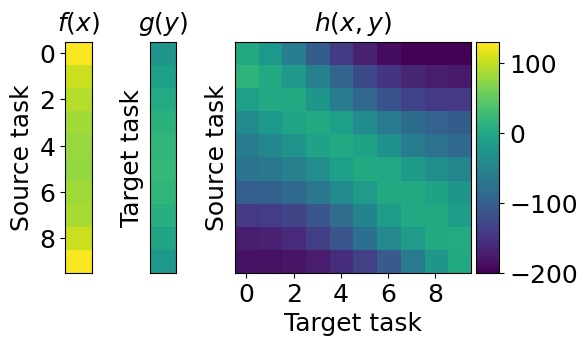

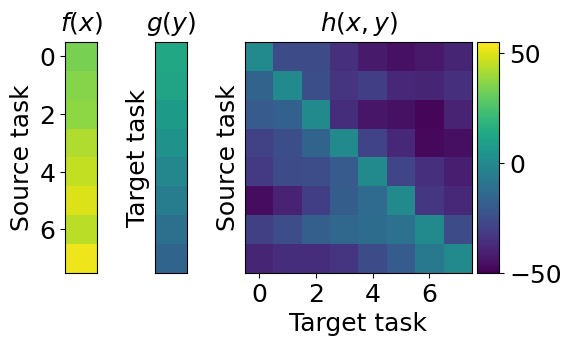

上下文强化学习(CRL)旨在解决一组相关的上下文马尔可夫决策过程(CMDPs),这些过程因不同的上下文变量而异。传统方法,如独立训练和多任务学习,要么计算成本过高,要么存在负迁移问题。最近提出的多策略方法——基于模型的迁移学习(MBTL),通过策略性地选择少量任务进行训练和零样本迁移,展现了有效性。然而,CMDPs包含广泛的问题,其结构属性因问题而异。因此,不同的任务选择策略适用于不同的CMDPs。本文提出了结构检测MBTL(SD-MBTL),一个通用框架,可以动态识别CMDP的底层泛化结构,并选择合适的MBTL算法。例如,我们观察到“山”结构,其中泛化性能随着上下文差异的增加而从目标任务的训练性能下降。因此,我们提出了M/GP-MBTL,它可以检测结构并在基于高斯过程的方法和基于聚类的方法之间自适应切换。在合成数据和CRL基准测试(包括连续控制、交通控制和农业管理)上的大量实验表明,M/GP-MBTL在聚合指标上超过了最强的现有方法12.49%。这些结果突出了在线结构检测在指导复杂CRL环境中源任务选择方面的潜力。

🔬 方法详解

问题定义:论文旨在解决上下文强化学习中,由于不同CMDPs具有不同的结构属性,导致现有MBTL方法采用固定任务选择策略效果不佳的问题。现有方法无法根据CMDP的结构动态调整任务选择策略,限制了泛化性能。

核心思路:论文的核心思路是引入在线结构检测机制,动态识别CMDP的底层泛化结构,并根据检测到的结构自适应地选择合适的MBTL算法。通过这种方式,可以针对不同的CMDP结构,采用最有效的任务选择策略,从而提高泛化性能。

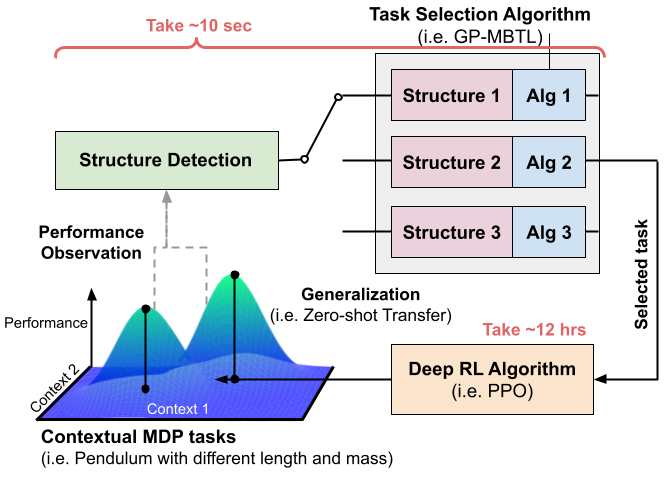

技术框架:SD-MBTL框架包含以下主要模块:1) 上下文编码:将上下文信息编码为特征向量。2) 结构检测:在线检测CMDP的泛化结构,例如“山”结构。3) 策略选择:根据检测到的结构,选择合适的MBTL算法,例如基于高斯过程的方法或基于聚类的方法。4) 任务选择与迁移:根据选择的MBTL算法,选择合适的源任务进行训练,并将学习到的策略迁移到目标任务。

关键创新:最重要的技术创新点在于在线结构检测机制。该机制能够动态识别CMDP的泛化结构,并根据结构自适应地选择合适的MBTL算法。与现有方法相比,SD-MBTL不再依赖于固定的任务选择策略,而是能够根据CMDP的实际情况进行调整,从而提高泛化性能。

关键设计:M/GP-MBTL是SD-MBTL框架的一个具体实现,它使用高斯过程来建模上下文差异与泛化性能之间的关系,并使用聚类方法来选择相似的源任务。M/GP-MBTL的关键设计在于如何有效地检测“山”结构,以及如何在基于高斯过程的方法和基于聚类的方法之间进行自适应切换。具体的切换策略可能涉及到性能指标的阈值判断或贝叶斯推断等方法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,M/GP-MBTL在合成数据和CRL基准测试中均取得了显著的性能提升。在聚合指标上,M/GP-MBTL超过了最强的现有方法12.49%。这些结果验证了在线结构检测在指导源任务选择方面的有效性,并表明SD-MBTL框架具有很强的泛化能力。

🎯 应用场景

该研究成果可应用于各种上下文强化学习场景,例如机器人控制、自动驾驶、智能交通、农业管理等。通过动态识别环境结构并选择合适的迁移策略,可以显著提升智能体在不同环境下的适应性和泛化能力,降低训练成本,提高决策效率。

📄 摘要(原文)

Contextual Reinforcement Learning (CRL) tackles the problem of solving a set of related Contextual Markov Decision Processes (CMDPs) that vary across different context variables. Traditional approaches--independent training and multi-task learning--struggle with either excessive computational costs or negative transfer. A recently proposed multi-policy approach, Model-Based Transfer Learning (MBTL), has demonstrated effectiveness by strategically selecting a few tasks to train and zero-shot transfer. However, CMDPs encompass a wide range of problems, exhibiting structural properties that vary from problem to problem. As such, different task selection strategies are suitable for different CMDPs. In this work, we introduce Structure Detection MBTL (SD-MBTL), a generic framework that dynamically identifies the underlying generalization structure of CMDP and selects an appropriate MBTL algorithm. For instance, we observe Mountain structure in which generalization performance degrades from the training performance of the target task as the context difference increases. We thus propose M/GP-MBTL, which detects the structure and adaptively switches between a Gaussian Process-based approach and a clustering-based approach. Extensive experiments on synthetic data and CRL benchmarks--covering continuous control, traffic control, and agricultural management--show that M/GP-MBTL surpasses the strongest prior method by 12.49% on the aggregated metric. These results highlight the promise of online structure detection for guiding source task selection in complex CRL environments.