Improving Domain Generalization in Contrastive Learning using Adaptive Temperature Control

作者: Robert Lewis, Katie Matton, Rosalind W. Picard, John Guttag

分类: cs.LG, cs.AI

发布日期: 2026-01-12

备注: NeurIPS SSL Workshop 2023

💡 一句话要点

提出自适应温度控制对比学习,提升域泛化能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 对比学习 域泛化 自适应温度控制 InfoNCE损失 域不变特征

📋 核心要点

- 对比学习在域泛化问题中面临挑战,即训练和测试数据分布存在差异导致性能下降。

- 论文提出自适应温度控制方法,利用域标签调整InfoNCE损失,增强模型对域不变特征的关注。

- 实验表明,该方法在分布外泛化能力上优于现有方法,并保持了良好的分布内性能。

📝 摘要(中文)

对比学习的自监督预训练是利用稀疏标注数据进行学习的有效方法。然而,当训练数据和测试数据分布存在偏移时,性能会显著下降。本文研究了训练数据来自多个域,而测试数据来自训练时未见过的、存在显著协变量偏移的域的场景。我们提出了一种新的对比学习方法,该方法结合了域标签以增强学习表征的域不变性,从而提高了分布外泛化能力。我们的方法使用负样本来自与锚点相同域的概率来调整InfoNCE损失中的温度参数,该参数控制负样本对的相对权重。这提高了来自更相似域的样本对的权重,鼓励模型基于域不变属性来区分样本。通过在MNIST数据集的变体上的实验,我们证明了我们的方法比域泛化基线产生更好的分布外性能。此外,我们的方法保持了强大的分布内任务性能,大大优于该指标上的基线。

🔬 方法详解

问题定义:论文旨在解决对比学习在域泛化场景下的性能下降问题。现有方法在训练数据和测试数据分布存在显著差异时,泛化能力不足,尤其是在未见过的域上表现较差。对比学习模型容易受到域特定特征的影响,难以学习到域不变的表征。

核心思路:论文的核心思路是利用域标签信息,在对比学习过程中自适应地调整负样本的权重。通过提高来自相似域的负样本的权重,鼓励模型学习域不变的特征表示,从而提高模型在未见过的域上的泛化能力。这种方法旨在使模型更加关注样本之间本质的、与域无关的差异。

技术框架:整体框架基于对比学习的通用流程,主要包括以下几个阶段:1)数据预处理:对输入数据进行必要的预处理,例如归一化。2)特征提取:使用编码器网络提取样本的特征表示。3)对比学习:使用InfoNCE损失函数进行对比学习,其中温度参数根据负样本的域相似度进行自适应调整。4)模型评估:在分布内和分布外数据集上评估模型的性能。

关键创新:最重要的技术创新点在于自适应温度控制机制。传统的对比学习方法使用固定的温度参数,而本文提出的方法根据负样本与锚点样本来自同一域的概率动态调整温度参数。这种自适应调整使得模型能够更加关注来自相似域的负样本,从而学习到更具鲁棒性的域不变特征。

关键设计:关键设计包括:1)温度参数的自适应调整公式:温度参数的调整基于负样本与锚点样本来自同一域的概率,概率越高,温度参数越低,从而提高该负样本的权重。2)InfoNCE损失函数:使用InfoNCE损失函数作为对比学习的目标函数,通过最大化正样本对的相似度,最小化负样本对的相似度来学习特征表示。3)编码器网络结构:可以使用各种常见的网络结构作为编码器,例如ResNet等。

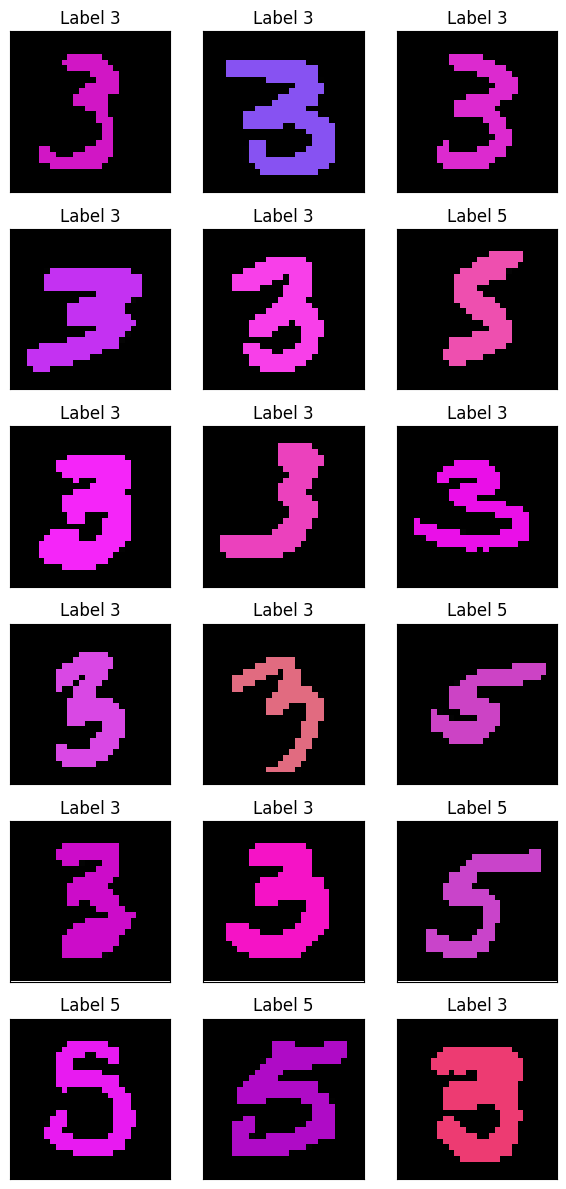

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的自适应温度控制对比学习方法在MNIST数据集的变体上,显著提高了分布外泛化性能,优于现有的域泛化基线方法。同时,该方法保持了良好的分布内性能,在两个指标上均优于基线模型。具体性能提升数据未知,需要在论文中查找。

🎯 应用场景

该研究成果可应用于各种需要域泛化的场景,例如医学图像分析、自动驾驶、机器人等。在这些领域中,训练数据可能来自不同的医院、不同的天气条件或不同的环境,而测试数据可能来自未见过的场景。通过提高模型的域泛化能力,可以提高模型在实际应用中的可靠性和鲁棒性,降低对大量标注数据的依赖。

📄 摘要(原文)

Self-supervised pre-training with contrastive learning is a powerful method for learning from sparsely labeled data. However, performance can drop considerably when there is a shift in the distribution of data from training to test time. We study this phenomenon in a setting in which the training data come from multiple domains, and the test data come from a domain not seen at training that is subject to significant covariate shift. We present a new method for contrastive learning that incorporates domain labels to increase the domain invariance of learned representations, leading to improved out-of-distribution generalization. Our method adjusts the temperature parameter in the InfoNCE loss -- which controls the relative weighting of negative pairs -- using the probability that a negative sample comes from the same domain as the anchor. This upweights pairs from more similar domains, encouraging the model to discriminate samples based on domain-invariant attributes. Through experiments on a variant of the MNIST dataset, we demonstrate that our method yields better out-of-distribution performance than domain generalization baselines. Furthermore, our method maintains strong in-distribution task performance, substantially outperforming baselines on this measure.