CompNO: A Novel Foundation Model approach for solving Partial Differential Equations

作者: Hamda Hmida, Hsiu-Wen Chang Joly, Youssef Mesri

分类: cs.LG

发布日期: 2026-01-12

备注: Under review at MDPI

💡 一句话要点

CompNO:一种用于求解偏微分方程的新型组合式神经算子基础模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 偏微分方程 神经算子 科学基础模型 组合模型 参数化PDE

📋 核心要点

- 求解偏微分方程计算成本高昂,尤其是在需要重复模拟不同参数设置时,现有科学基础模型存在可解释性差和预训练成本高等问题。

- CompNO通过学习基础块库,并使用轻量级自适应块组装成特定任务的求解器,从而近似目标PDE的时间演化算子,实现高效求解。

- 实验表明,CompNO在线性参数化系统上优于现有基线,并在非线性Burgers流上具有竞争力,同时保持精确的边界条件满足和鲁棒的泛化能力。

📝 摘要(中文)

偏微分方程(PDEs)控制着广泛的物理现象,但其数值解在计算上仍然要求很高,尤其是在需要跨多个参数设置进行重复模拟时。最近的科学基础模型(SFMs)旨在通过从大量模拟系统中学习通用替代模型来降低这种成本,但它们通常依赖于具有有限可解释性和高预训练成本的单片架构。在这项工作中,我们介绍了一种用于参数化PDE的组合神经算子框架CompNO。CompNO首先学习一个基础块库,其中每个块都是一个专门用于基本微分算子(例如,对流、扩散、非线性对流)的参数化傅里叶神经算子,而不是在异构数据上预训练单个大型模型。然后,这些块通过轻量级自适应块组装成特定于任务的求解器,以近似目标PDE的时间演化算子。一个专用的边界条件算子进一步在推理时精确地强制执行Dirichlet约束。我们在PDEBench套件中的一维对流、扩散、对流-扩散和Burgers方程上验证了CompNO。所提出的框架在线性参数化系统上实现了比强基线(PFNO、PDEFormer和基于上下文学习的模型)更低的相对L2误差,同时在非线性Burgers流上保持竞争力。该模型保持了在域边界处零损失的精确边界满足,并表现出对各种Peclet数和Reynolds数的鲁棒泛化。这些结果表明,组合神经算子为PDE的基础模型提供了一种可扩展且物理上可解释的途径。

🔬 方法详解

问题定义:论文旨在解决参数化偏微分方程(PDEs)的求解问题,尤其是在需要大量重复计算不同参数设置下的解时。现有方法,如单片架构的科学基础模型(SFMs),存在可解释性差、预训练成本高等问题,难以高效地泛化到不同的PDEs。

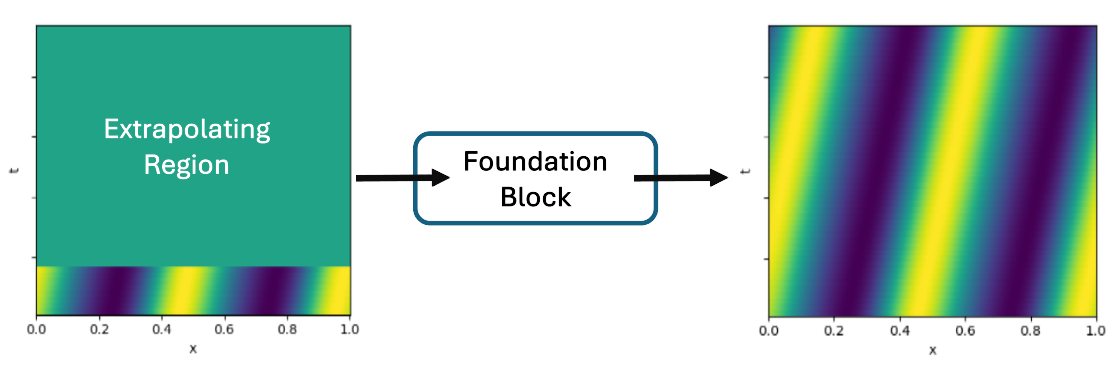

核心思路:论文的核心思路是将复杂的PDE求解过程分解为多个基本微分算子的组合。通过预先学习这些基本算子的表示(即基础块),然后根据特定PDE的结构,将这些基础块组合起来,形成针对该PDE的求解器。这种组合式的思想降低了模型的复杂度和训练成本,提高了可解释性和泛化能力。

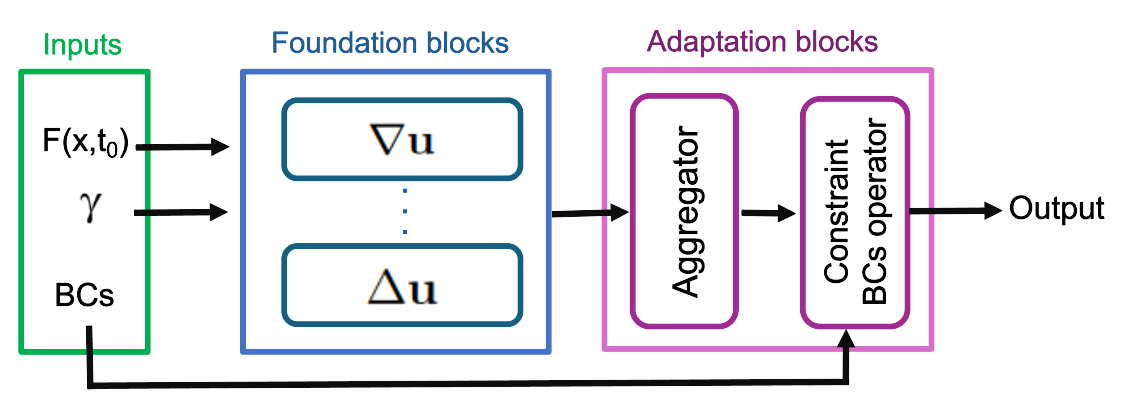

技术框架:CompNO框架包含以下几个主要模块: 1. 基础块库:包含多个参数化的傅里叶神经算子(FNO),每个FNO专门用于学习一种基本微分算子,如对流、扩散、非线性对流等。 2. 自适应块:用于将基础块组装成特定于任务的求解器,近似目标PDE的时间演化算子。这些自适应块通常是轻量级的,以减少额外的计算负担。 3. 边界条件算子:用于在推理时精确地强制执行Dirichlet边界条件,确保解的物理合理性。

关键创新:CompNO的关键创新在于其组合式的架构。与传统的单片模型不同,CompNO通过学习和组合基本算子来构建PDE求解器,从而实现了更好的可解释性、可扩展性和泛化能力。这种方法更符合物理过程的内在结构,也更容易进行调试和优化。

关键设计: * 基础块的选择:选择合适的微分算子作为基础块至关重要,需要根据目标PDE的类型进行选择。 * 自适应块的结构:自适应块的设计需要平衡模型的表达能力和计算效率,通常采用轻量级的神经网络结构。 * 损失函数的设计:损失函数需要考虑PDE的残差、边界条件等因素,以确保模型的准确性和物理合理性。 * 边界条件的处理:采用专门的边界条件算子可以精确地强制执行Dirichlet边界条件,避免了传统方法中需要通过损失函数来约束边界条件的不足。

🖼️ 关键图片

📊 实验亮点

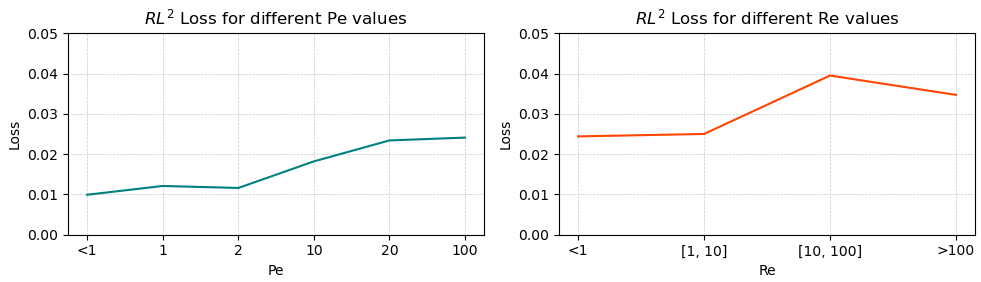

CompNO在PDEBench套件中的一维对流、扩散、对流-扩散和Burgers方程上进行了验证。实验结果表明,CompNO在线性参数化系统上实现了比PFNO、PDEFormer和基于上下文学习的模型更低的相对L2误差。在非线性Burgers流上,CompNO也表现出与现有方法相当的竞争力。此外,CompNO能够精确地满足边界条件,并在不同的Peclet数和Reynolds数下表现出良好的泛化能力。

🎯 应用场景

CompNO在科学计算领域具有广泛的应用前景,例如流体动力学、热传导、材料科学等。它可以用于加速PDE的求解过程,进行快速的参数扫描和优化,以及构建高精度的代理模型。此外,CompNO的组合式架构也为PDE求解器的模块化设计提供了新的思路,有助于开发更加灵活和可定制的科学计算软件。

📄 摘要(原文)

Partial differential equations (PDEs) govern a wide range of physical phenomena, but their numerical solution remains computationally demanding, especially when repeated simulations are required across many parameter settings. Recent Scientific Foundation Models (SFMs) aim to alleviate this cost by learning universal surrogates from large collections of simulated systems, yet they typically rely on monolithic architectures with limited interpretability and high pretraining expense. In this work we introduce Compositional Neural Operators (CompNO), a compositional neural operator framework for parametric PDEs. Instead of pretraining a single large model on heterogeneous data, CompNO first learns a library of Foundation Blocks, where each block is a parametric Fourier neural operator specialized to a fundamental differential operator (e.g. convection, diffusion, nonlinear convection). These blocks are then assembled, via lightweight Adaptation Blocks, into task-specific solvers that approximate the temporal evolution operator for target PDEs. A dedicated boundary-condition operator further enforces Dirichlet constraints exactly at inference time. We validate CompNO on one-dimensional convection, diffusion, convection--diffusion and Burgers' equations from the PDEBench suite. The proposed framework achieves lower relative L2 error than strong baselines (PFNO, PDEFormer and in-context learning based models) on linear parametric systems, while remaining competitive on nonlinear Burgers' flows. The model maintains exact boundary satisfaction with zero loss at domain boundaries, and exhibits robust generalization across a broad range of Peclet and Reynolds numbers. These results demonstrate that compositional neural operators provide a scalable and physically interpretable pathway towards foundation models for PDEs.