Explaining Machine Learning Predictive Models through Conditional Expectation Methods

作者: Silvia Ruiz-España, Laura Arnal, François Signol, Juan-Carlos Perez-Cortes, Joaquim Arlandis

分类: cs.LG, cs.AI

发布日期: 2026-01-12

备注: 24 pages, 15 figures. Silvia Ruiz-España and Laura Arnal contributed equally to this work

💡 一句话要点

提出MUCE方法,通过条件期望解释机器学习模型预测,提升模型透明度和可信度。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 可解释AI 局部解释 条件期望 模型透明度 特征交互 XGBoost 模型验证

📋 核心要点

- 现有机器学习模型因其复杂性,决策过程难以解释,导致模型透明度不足,用户难以信任。

- MUCE方法通过探索特征交互引起的预测变化,扩展了个体条件期望(ICE),提供局部可解释性。

- 实验结果表明,MUCE能有效捕捉复杂局部模型行为,稳定性和不确定性指标能有效评估预测置信度。

📝 摘要(中文)

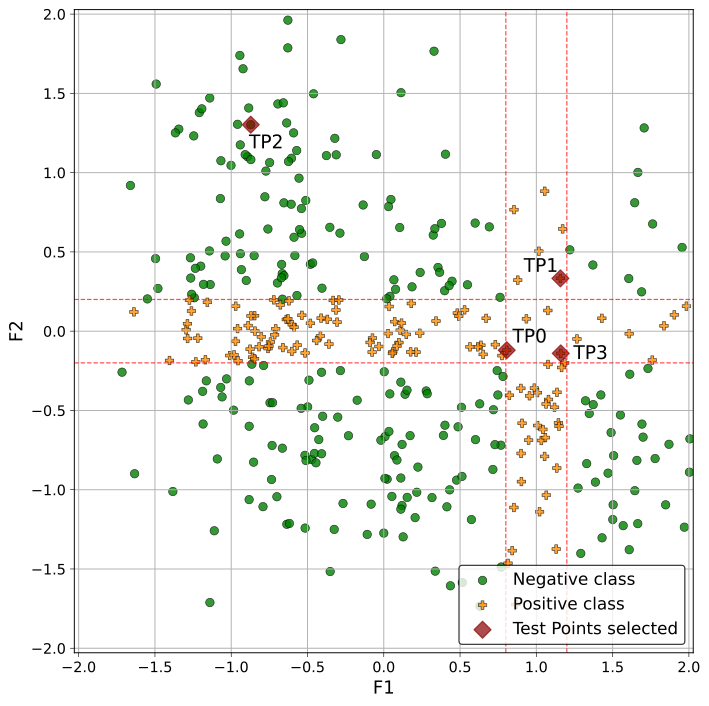

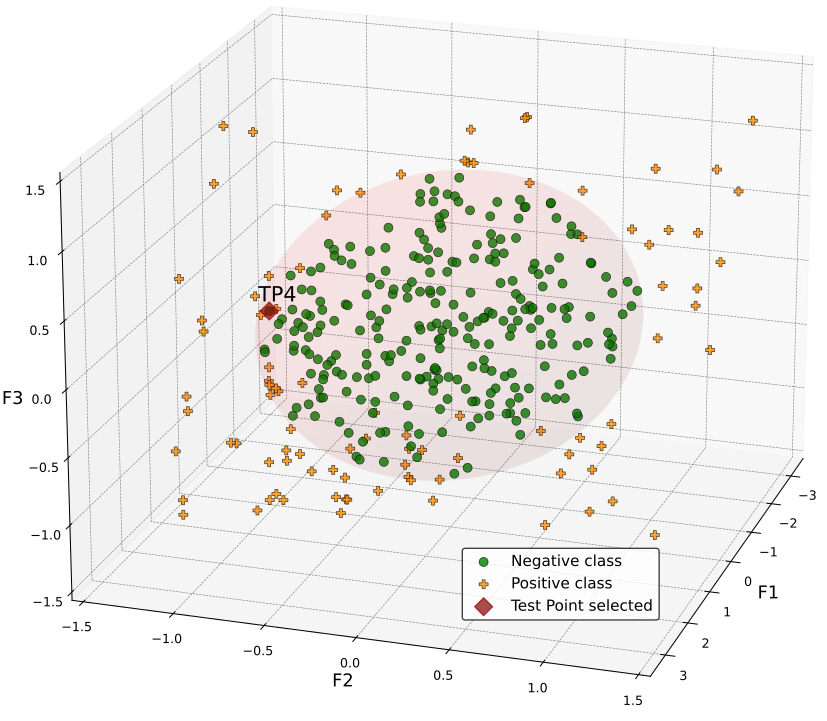

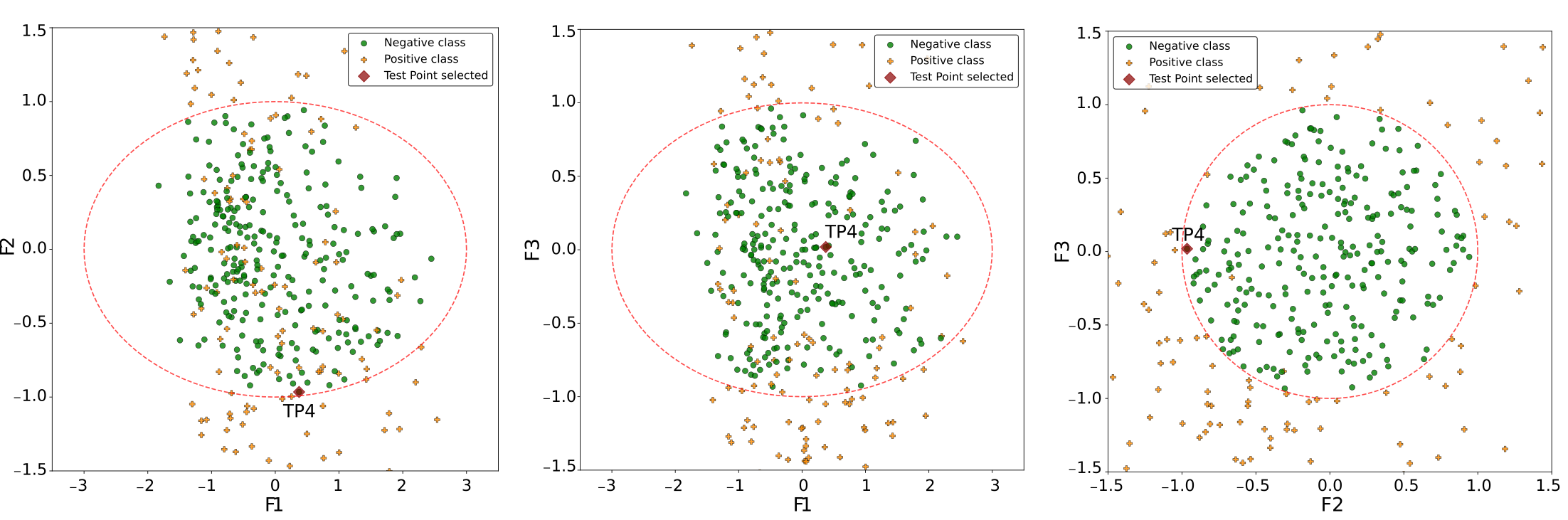

复杂人工智能和机器学习模型的快速应用导致其决策过程难以解释,被视为黑盒。这种缺乏透明性阻碍了用户理解、验证和信任模型行为,尤其是在高风险应用中。尽管可解释AI取得了显著进展,但仍需要通用且有效的方法来处理日益复杂的模型。本文介绍了一种模型无关的局部可解释性方法——多元条件期望(MUCE),旨在捕捉特征交互引起的预测变化。MUCE扩展了个体条件期望(ICE),通过探索推理时给定观测附近的多变量网格值,提供图形化解释,展示模型预测的局部演变。此外,两个定量指标,稳定性和不确定性,总结了局部行为并评估模型可靠性。不确定性进一步分解为不确定性+和不确定性-,以捕捉全局指标可能忽略的不对称效应。该方法使用XGBoost模型在三个数据集上进行了验证:两个合成数据集(2D和3D)用于评估决策边界附近的表现,一个转换后的真实世界数据集用于测试对异构特征类型的适应性。结果表明,MUCE有效地捕捉了复杂的局部模型行为,而稳定性和不确定性指标提供了对预测置信度的有意义的见解。MUCE以及ICE修改和提出的指标,为局部可解释性提供了实际贡献,实现了图形化和定量洞察,增强了预测模型的可解释性,并支持更值得信赖和透明的决策。

🔬 方法详解

问题定义:现有机器学习模型,特别是复杂模型如XGBoost,由于其内部决策过程的复杂性,难以被用户理解和信任。现有的可解释性方法在处理特征交互和提供局部解释方面存在局限性,难以充分揭示模型在特定输入附近的预测行为。因此,需要一种能够有效捕捉特征交互影响,并提供局部、定量和定性解释的方法。

核心思路:MUCE的核心思路是基于条件期望,通过在给定观测点附近探索多变量特征值的网格,来观察模型预测的局部变化。这种方法扩展了传统的个体条件期望(ICE),使其能够捕捉特征之间的交互作用对预测的影响。通过图形化展示这些变化,用户可以直观地理解模型在特定输入附近的决策逻辑。

技术框架:MUCE方法主要包含以下几个阶段:1) 选择需要解释的观测点;2) 在该观测点附近,针对选定的特征构建多变量网格;3) 使用模型对网格中的每个点进行预测;4) 可视化预测结果,生成MUCE图,展示模型预测随特征值变化的趋势;5) 计算稳定性和不确定性指标,对局部模型行为进行定量评估。

关键创新:MUCE的关键创新在于其多变量条件期望的计算方式,能够捕捉特征之间的交互作用。与传统的ICE方法相比,MUCE不仅考虑了单个特征变化对预测的影响,还考虑了多个特征同时变化的影响,从而更全面地揭示了模型的决策逻辑。此外,提出的稳定性和不确定性指标为局部解释提供了定量的评估手段。

关键设计:MUCE的关键设计包括:1) 多变量网格的构建方式,需要合理选择特征和网格密度,以平衡计算复杂度和解释能力;2) 稳定性和不确定性指标的计算方法,需要选择合适的统计量来反映预测的离散程度和变化幅度;3) 不确定性指标分解为正向和负向不确定性,以捕捉模型预测的不对称效应。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MUCE方法在合成数据集上能够准确捕捉决策边界附近的复杂模型行为。在真实数据集上,MUCE能够有效处理异构特征类型,并提供有意义的局部解释。稳定性和不确定性指标能够有效评估预测置信度,并揭示模型预测的不对称效应。相较于传统ICE方法,MUCE能够更好地捕捉特征交互作用,提供更全面的局部解释。

🎯 应用场景

MUCE方法可应用于金融风控、医疗诊断、自动驾驶等高风险领域,帮助用户理解和验证机器学习模型的决策过程,提高模型的可信度和透明度。通过MUCE提供的局部解释,用户可以更好地识别模型的潜在偏差和漏洞,从而做出更明智的决策。此外,MUCE还可以用于模型调试和优化,帮助开发者改进模型性能。

📄 摘要(原文)

The rapid adoption of complex Artificial Intelligence (AI) and Machine Learning (ML) models has led to their characterization as black boxes due to the difficulty of explaining their internal decision-making processes. This lack of transparency hinders users' ability to understand, validate and trust model behavior, particularly in high-risk applications. Although explainable AI (XAI) has made significant progress, there remains a need for versatile and effective techniques to address increasingly complex models. This work introduces Multivariate Conditional Expectation (MUCE), a model-agnostic method for local explainability designed to capture prediction changes from feature interactions. MUCE extends Individual Conditional Expectation (ICE) by exploring a multivariate grid of values in the neighborhood of a given observation at inference time, providing graphical explanations that illustrate the local evolution of model predictions. In addition, two quantitative indices, stability and uncertainty, summarize local behavior and assess model reliability. Uncertainty is further decomposed into uncertainty+ and uncertainty- to capture asymmetric effects that global measures may overlook. The proposed method is validated using XGBoost models trained on three datasets: two synthetic (2D and 3D) to evaluate behavior near decision boundaries, and one transformed real-world dataset to test adaptability to heterogeneous feature types. Results show that MUCE effectively captures complex local model behavior, while the stability and uncertainty indices provide meaningful insight into prediction confidence. MUCE, together with the ICE modification and the proposed indices, offers a practical contribution to local explainability, enabling both graphical and quantitative insights that enhance the interpretability of predictive models and support more trustworthy and transparent decision-making.