Sequential Reservoir Computing for Efficient High-Dimensional Spatiotemporal Forecasting

作者: Ata Akbari Asanjan, Filip Wudarski, Daniel O'Connor, Shaun Geaney, Elena Strbac, P. Aaron Lott, Davide Venturelli

分类: cs.LG, cs.NE

发布日期: 2026-01-01

💡 一句话要点

提出序列化储层计算,高效预测高维时空系统

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 储层计算 时空预测 高维数据 序列模型 循环神经网络

📋 核心要点

- 传统RNN和LSTM在高维时空预测中面临梯度消失和内存瓶颈等挑战。

- Sequential RC将大型储层分解为多个小型互连储层,降低计算和内存需求。

- 实验表明,Sequential RC在预测精度和效率上优于LSTM和传统RNN。

📝 摘要(中文)

由于基于梯度的训练和内存瓶颈,循环神经网络(RNNs)和长短期记忆(LSTM)模型在预测高维时空系统时面临计算挑战。储层计算(RC)通过用固定的循环层和凸读出优化代替反向传播来缓解这些挑战,但传统的RC架构在高输入维度下仍然表现不佳。我们引入了一种序列化储层计算(Sequential RC)架构,该架构将大型储层分解为一系列较小的、相互连接的储层。这种设计降低了内存和计算成本,同时保留了长期的时间依赖性。在使用低维混沌系统(Lorenz63)和高维物理模拟(二维涡度和浅水方程)时,与LSTM和标准RNN基线相比,Sequential RC实现了15-25%的更长有效预测范围,20-30%的更低误差指标(SSIM, RMSE),以及高达三个数量级的更低训练成本。结果表明,Sequential RC保持了传统RC的简单性和效率,同时实现了高维动力系统的卓越可扩展性。这种方法为科学和工程应用中的实时、节能预测提供了一条切实可行的途径。

🔬 方法详解

问题定义:论文旨在解决高维时空系统预测的计算瓶颈问题。传统的RNN和LSTM模型在处理高维数据时,由于梯度消失和内存限制,训练成本高昂且预测精度有限。传统的储层计算虽然避免了梯度消失问题,但其计算和内存需求仍然随着输入维度线性增长,限制了其在高维场景下的应用。

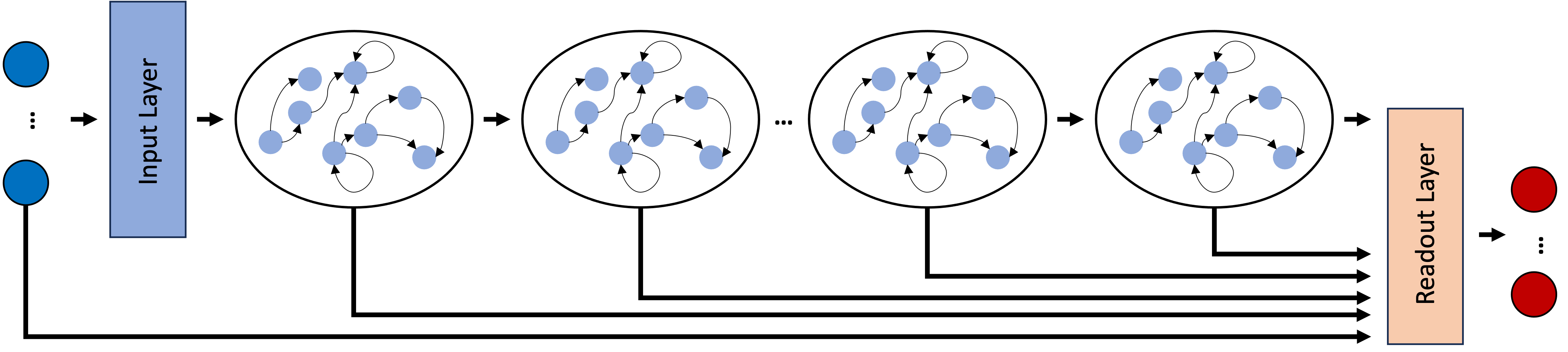

核心思路:论文的核心思路是将一个大型的储层分解为一系列较小的、相互连接的储层,形成序列化的结构。这种分解降低了每个储层的规模,从而减少了计算和内存需求。同时,通过连接多个储层,可以保留长期的时间依赖性,避免信息丢失。

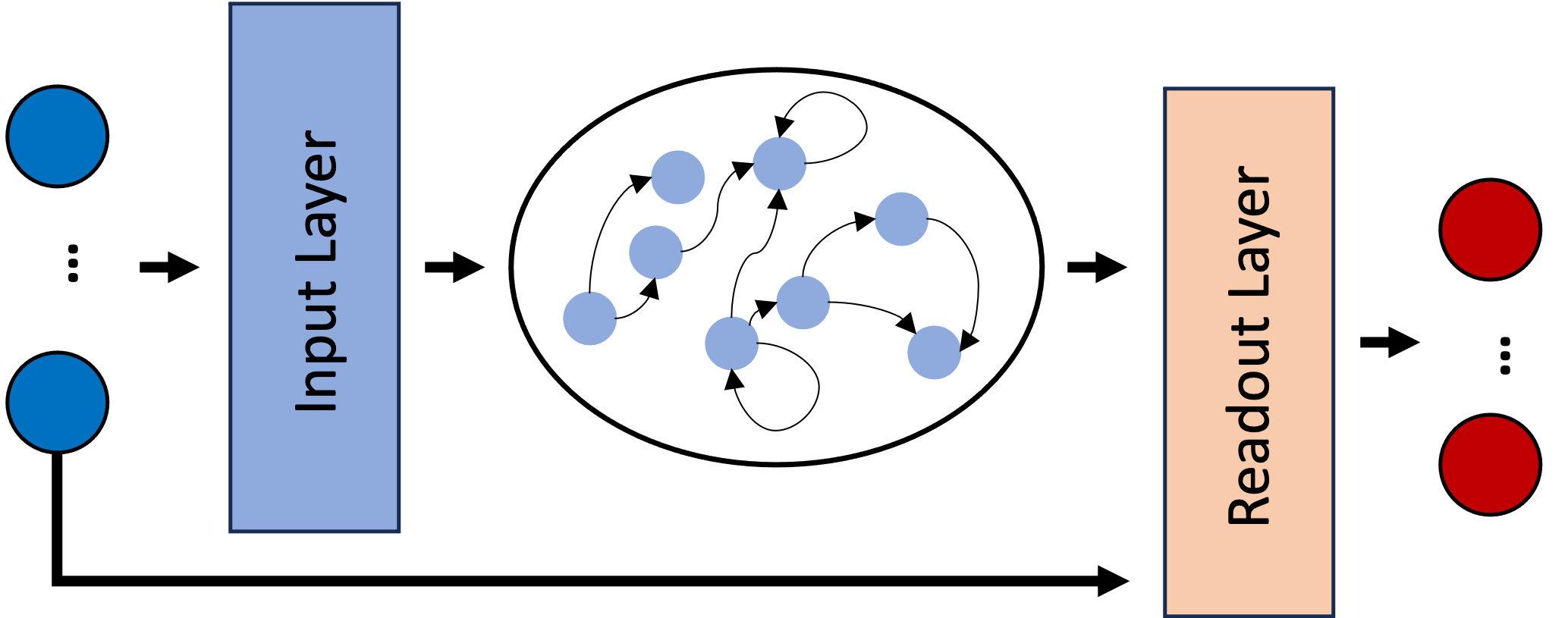

技术框架:Sequential RC的整体架构包含多个串联的储层。输入数据首先进入第一个储层,其输出作为下一个储层的输入,以此类推。每个储层内部的连接权重是随机初始化且固定的,只有最后一个储层的输出权重需要通过凸优化进行训练。整个流程可以分为数据输入、储层状态更新和输出权重训练三个主要阶段。

关键创新:Sequential RC的关键创新在于其序列化的储层结构。与传统的单层储层相比,这种结构能够显著降低计算和内存需求,从而实现对高维时空系统的有效预测。此外,序列化结构允许模型捕获更长的时间依赖性,提高预测精度。

关键设计:每个储层的大小(神经元数量)、储层之间的连接方式、以及输出权重的训练方法是关键的设计参数。论文可能探讨了不同储层大小和连接方式对模型性能的影响。输出权重的训练通常采用岭回归等凸优化方法,以保证训练的稳定性和效率。具体的损失函数通常是预测值与真实值之间的均方误差或类似的度量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Sequential RC在预测Lorenz63混沌系统和高维物理模拟(二维涡度和浅水方程)时,相比LSTM和传统RNN,实现了显著的性能提升。具体而言,Sequential RC的有效预测范围延长了15-25%,误差指标(SSIM, RMSE)降低了20-30%,训练成本降低了高达三个数量级。这些结果验证了Sequential RC在高维时空预测中的有效性和效率。

🎯 应用场景

Sequential RC在多个领域具有广泛的应用前景,例如气候建模、流体动力学、电力系统预测和金融市场分析。该方法能够实现对复杂时空系统的高效预测,为实时决策和控制提供支持。此外,其低计算成本的特性使其适用于资源受限的设备,例如嵌入式系统和边缘计算设备。

📄 摘要(原文)

Forecasting high-dimensional spatiotemporal systems remains computationally challenging for recurrent neural networks (RNNs) and long short-term memory (LSTM) models due to gradient-based training and memory bottlenecks. Reservoir Computing (RC) mitigates these challenges by replacing backpropagation with fixed recurrent layers and a convex readout optimization, yet conventional RC architectures still scale poorly with input dimensionality. We introduce a Sequential Reservoir Computing (Sequential RC) architecture that decomposes a large reservoir into a series of smaller, interconnected reservoirs. This design reduces memory and computational costs while preserving long-term temporal dependencies. Using both low-dimensional chaotic systems (Lorenz63) and high-dimensional physical simulations (2D vorticity and shallow-water equations), Sequential RC achieves 15-25% longer valid forecast horizons, 20-30% lower error metrics (SSIM, RMSE), and up to three orders of magnitude lower training cost compared to LSTM and standard RNN baselines. The results demonstrate that Sequential RC maintains the simplicity and efficiency of conventional RC while achieving superior scalability for high-dimensional dynamical systems. This approach provides a practical path toward real-time, energy-efficient forecasting in scientific and engineering applications.