LLMize: A Framework for Large Language Model-Based Numerical Optimization

作者: M. Rizki Oktavian

分类: cs.LG, cs.AI, physics.comp-ph

发布日期: 2025-12-30

💡 一句话要点

LLMize:基于大语言模型的数值优化开源框架,简化复杂约束问题求解。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 数值优化 自然语言处理 约束优化 元启发式算法

📋 核心要点

- 传统数值优化方法在处理具有复杂约束和领域知识的问题时面临挑战,需要专业的数学建模和算法设计。

- LLMize框架利用大语言模型的推理能力,将优化问题转化为自然语言交互,通过迭代提示和反馈改进候选解。

- 实验表明,LLMize在复杂约束问题上表现出潜力,尤其是在传统方法难以形式化约束和启发式规则的场景下。

📝 摘要(中文)

本文提出了LLMize,一个开源Python框架,通过迭代提示和上下文学习实现基于大语言模型(LLM)的优化。LLMize将优化过程形式化为一个黑盒过程,其中候选解以自然语言生成,由外部目标函数评估,并通过解-得分反馈在后续迭代中改进。该框架支持多种优化策略,包括基于提示的优化(OPRO)以及受进化算法和模拟退火启发的混合LLM方法。LLMize的一个关键优势在于能够通过自然语言描述直接注入约束、规则和领域知识,从而允许从业者定义复杂的优化问题,而无需具备数学规划或元启发式设计的专业知识。LLMize在凸优化、线性规划、旅行商问题、神经网络超参数调整和核燃料格子优化等方面进行了评估。结果表明,虽然基于LLM的优化在简单问题上无法与经典求解器竞争,但它为复杂、特定领域的任务提供了一种实用且易于访问的方法,在这些任务中,约束和启发式方法难以形式化。

🔬 方法详解

问题定义:论文旨在解决传统数值优化方法在处理复杂约束和领域知识时面临的挑战。现有方法通常需要将问题精确地形式化为数学模型,这对于具有复杂规则或难以量化的约束的问题来说非常困难,并且需要专业的数学建模知识。

核心思路:论文的核心思路是利用大语言模型(LLM)的强大推理和自然语言处理能力,将优化问题转化为一个基于自然语言的交互过程。通过迭代地提示LLM生成候选解,并根据外部目标函数的评估结果进行反馈,从而引导LLM逐步优化解的质量。

技术框架:LLMize框架包含以下主要模块:1) 提示生成器:根据当前迭代状态生成提示,引导LLM生成候选解。2) LLM接口:与LLM进行交互,接收提示并生成候选解。3) 解评估器:使用外部目标函数评估候选解的质量。4) 反馈机制:将解的得分反馈给LLM,用于指导后续迭代的解生成。框架支持多种优化策略,包括OPRO和混合LLM方法。

关键创新:LLMize的关键创新在于它提供了一种将领域知识和约束以自然语言形式注入优化过程的方法。这使得用户无需具备专业的数学建模技能,即可定义复杂的优化问题。此外,该框架还探索了多种基于LLM的优化策略,例如OPRO,并结合了进化算法和模拟退火等传统优化方法的思想。

关键设计:LLMize框架的关键设计包括:1) 提示工程:设计有效的提示,引导LLM生成高质量的候选解。2) 反馈机制:设计合适的反馈信号,指导LLM进行迭代优化。3) 优化策略:选择合适的优化策略,例如OPRO或混合方法,以平衡探索和利用。4) 温度参数:在LLM生成过程中使用温度参数来控制解的多样性。

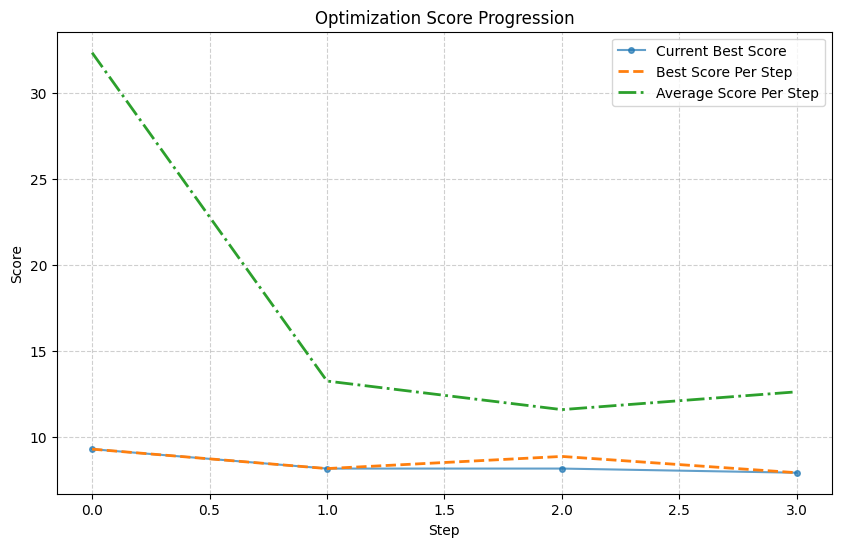

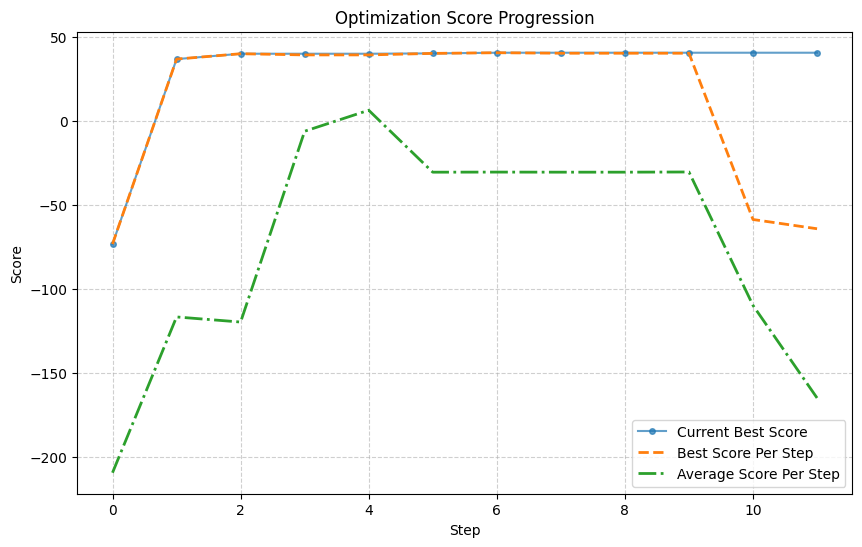

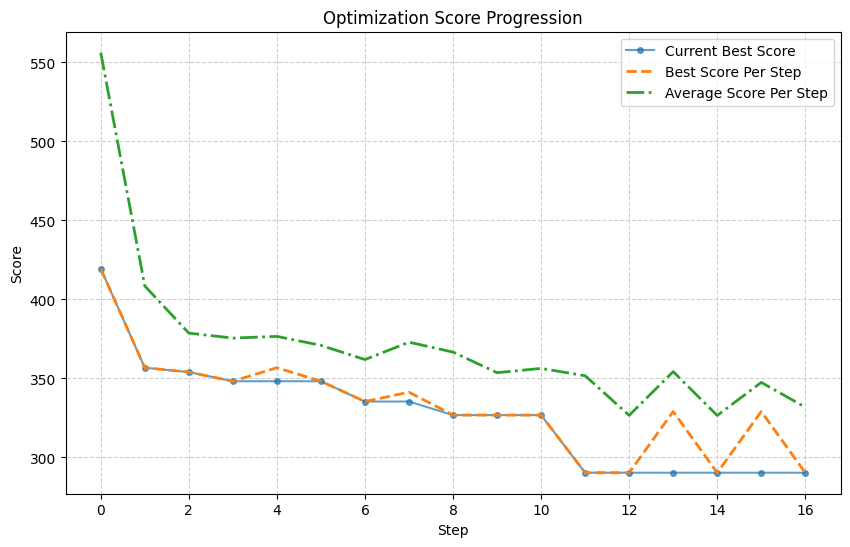

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLMize在凸优化、线性规划、旅行商问题、神经网络超参数调整和核燃料格子优化等问题上均取得了不错的效果。虽然在简单问题上不如传统求解器,但在复杂约束和领域知识难以形式化的问题上,LLMize展现出独特的优势。例如,在核燃料格子优化问题中,LLMize能够有效地处理复杂的物理约束,并找到满足要求的解。

🎯 应用场景

LLMize框架可应用于各种需要处理复杂约束和领域知识的优化问题,例如:工程设计、资源调度、金融建模、科学发现等。它降低了优化问题的建模门槛,使得领域专家能够更方便地利用优化技术解决实际问题。未来,LLMize有望成为一个强大的通用优化工具,推动各领域的发展。

📄 摘要(原文)

Large language models (LLMs) have recently shown strong reasoning capabilities beyond traditional language tasks, motivating their use for numerical optimization. This paper presents LLMize, an open-source Python framework that enables LLM-driven optimization through iterative prompting and in-context learning. LLMize formulates optimization as a black-box process in which candidate solutions are generated in natural language, evaluated by an external objective function, and refined over successive iterations using solution-score feedback. The framework supports multiple optimization strategies, including Optimization by Prompting (OPRO) and hybrid LLM-based methods inspired by evolutionary algorithms and simulated annealing. A key advantage of LLMize is the ability to inject constraints, rules, and domain knowledge directly through natural language descriptions, allowing practitioners to define complex optimization problems without requiring expertise in mathematical programming or metaheuristic design. LLMize is evaluated on convex optimization, linear programming, the Traveling Salesman Problem, neural network hyperparameter tuning, and nuclear fuel lattice optimization. Results show that while LLM-based optimization is not competitive with classical solvers for simple problems, it provides a practical and accessible approach for complex, domain-specific tasks where constraints and heuristics are difficult to formalize.