Hyperspherical Graph Representation Learning via Adaptive Neighbor-Mean Alignment and Uniformity

作者: Rui Chen, Junjun Guo, Hongbin Wang, Yan Xiang, Yantuan Xian, Zhengtao Yu

分类: cs.LG

发布日期: 2025-12-30

备注: Submitted to Pattern Recognition

💡 一句话要点

HyperGRL:基于超球面表示学习的图神经网络统一框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图表示学习 超球面嵌入 对比学习 图神经网络 无采样 邻域均值对齐 均匀性正则化

📋 核心要点

- 现有图表示学习方法依赖对比学习或互信息最大化,存在架构复杂、负采样需求和超参数敏感等问题。

- HyperGRL通过邻域均值对齐和无采样均匀性,在超球面上学习图表示,避免了负采样和复杂超参数调整。

- 实验表明,HyperGRL在节点分类、聚类和链接预测任务上优于现有方法,平均提升1.49%、0.86%和0.74%。

📝 摘要(中文)

图表示学习(GRL)旨在将图结构数据的结构和语义依赖性编码到低维嵌入中。然而,现有的GRL方法通常依赖于替代对比目标或互信息最大化,这通常需要复杂的架构、负采样策略和敏感的超参数调整,可能导致过度平滑、过度挤压和训练不稳定。本文提出了HyperGRL,一个统一的超球面图表示学习框架,通过自适应邻域均值对齐和无采样均匀性实现。HyperGRL通过两个对抗耦合的目标将节点嵌入到单位超球面上:邻域均值对齐和无采样均匀性。对齐目标使用每个节点局部邻域的平均表示来构建语义明确、稳定的目标,以捕获共享的结构和特征模式。均匀性目标通过基于L2的超球面正则化来公式化分散性,鼓励全局均匀的嵌入分布,同时保留判别信息。为了进一步稳定训练,我们引入了一种熵引导的自适应平衡机制,动态调节对齐和均匀性之间的相互作用,而无需手动调整。在节点分类、节点聚类和链接预测上的大量实验表明,HyperGRL在不同的图结构上提供了卓越的表示质量和泛化能力,分别比现有最强方法平均提高了1.49%、0.86%和0.74%。这些发现突出了几何基础的、无采样的对比目标在图表示学习中的有效性。

🔬 方法详解

问题定义:现有图表示学习方法,如基于对比学习或互信息最大化的方法,通常需要复杂的网络结构、负采样策略以及精细的超参数调整。这些设计选择容易导致过平滑、过挤压问题,并且训练过程不稳定,难以获得高质量的图表示。

核心思路:HyperGRL的核心思路是将图节点嵌入到超球面上,并通过两个对抗耦合的目标函数来优化嵌入:邻域均值对齐和无采样均匀性。邻域均值对齐旨在使节点的嵌入与其邻域节点的平均嵌入尽可能接近,从而捕捉局部结构信息。无采样均匀性则鼓励嵌入在超球面上均匀分布,避免聚集,从而保留判别信息。这种设计避免了负采样,简化了训练过程。

技术框架:HyperGRL的整体框架包含以下几个主要步骤:1) 图数据输入;2) 节点特征编码;3) 邻域均值计算;4) 邻域均值对齐损失计算;5) 无采样均匀性损失计算;6) 熵引导的自适应平衡机制调整两个损失函数的权重;7) 梯度更新和模型优化。整个过程在一个统一的框架内完成,无需复杂的预处理或后处理步骤。

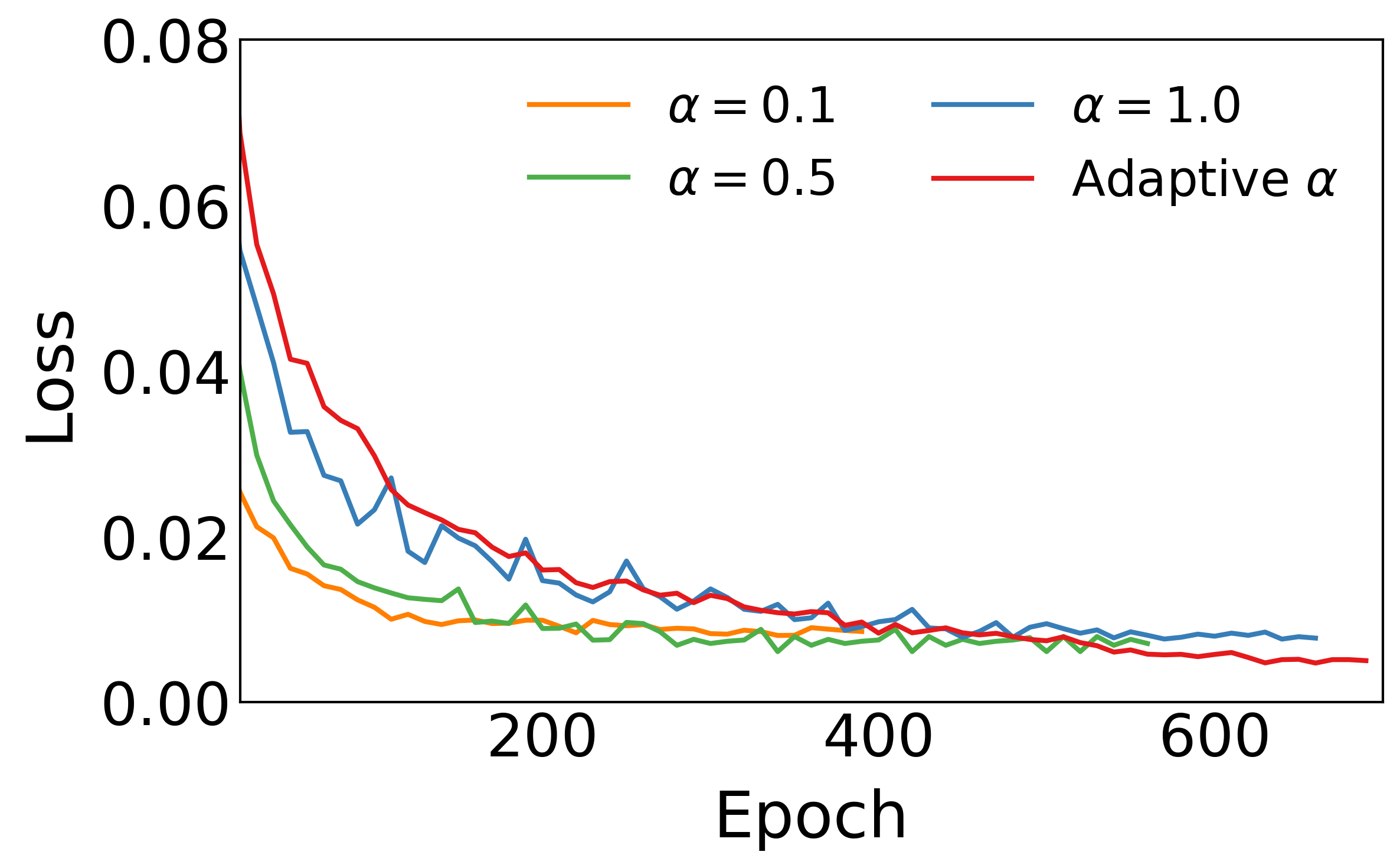

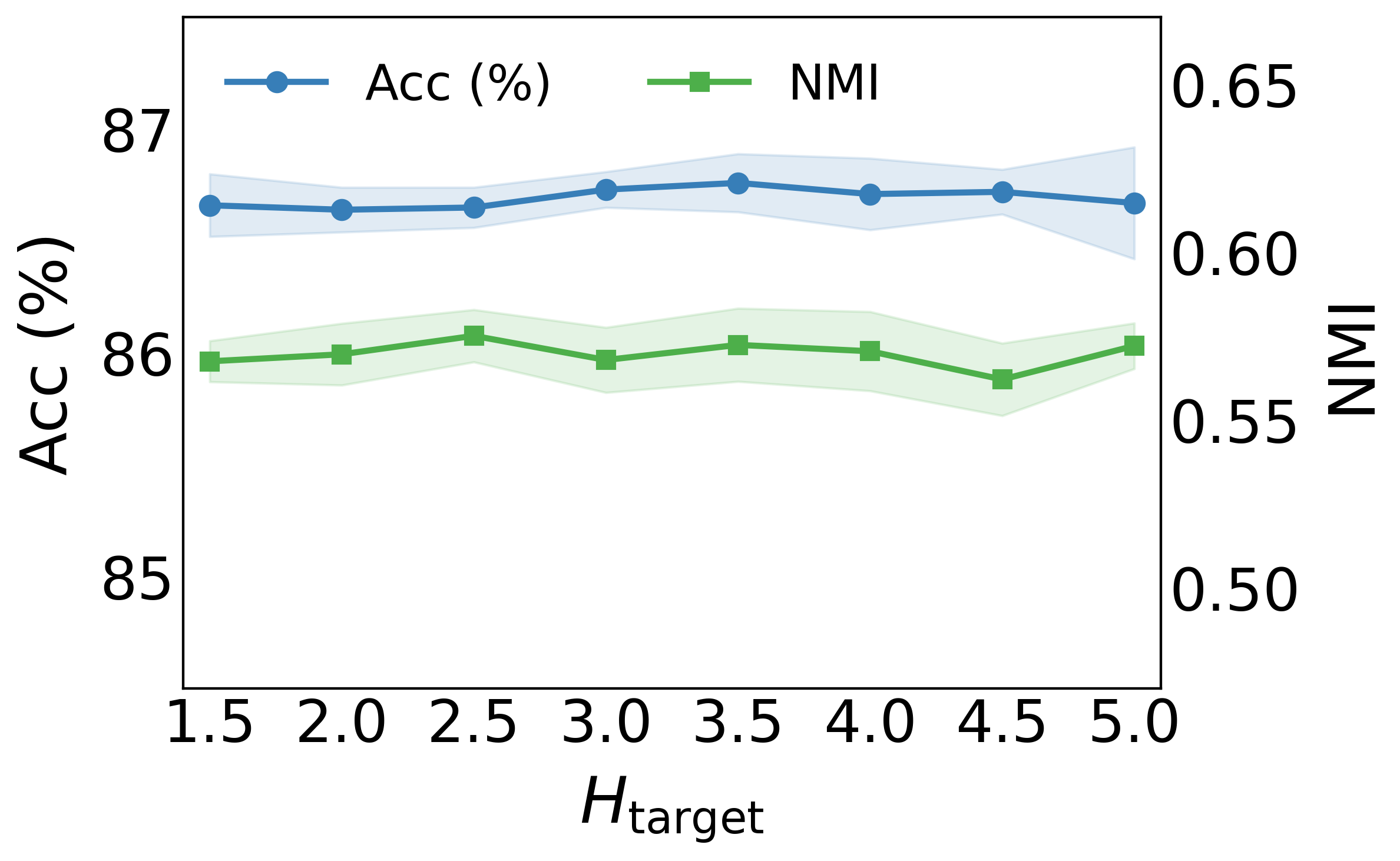

关键创新:HyperGRL的关键创新在于提出了一个基于超球面的图表示学习框架,该框架通过邻域均值对齐和无采样均匀性两个目标函数,实现了高质量的图表示学习。与现有方法相比,HyperGRL避免了负采样,简化了训练过程,并且通过熵引导的自适应平衡机制,动态调整两个目标函数的权重,进一步提高了模型的性能。

关键设计:HyperGRL的关键设计包括:1) 使用单位超球面作为嵌入空间,利用超球面的几何特性来约束嵌入;2) 邻域均值对齐损失采用均方误差损失函数;3) 无采样均匀性损失采用基于L2距离的超球面正则化;4) 熵引导的自适应平衡机制,根据两个损失函数的熵值动态调整其权重,避免手动调整超参数。

🖼️ 关键图片

📊 实验亮点

HyperGRL在节点分类、节点聚类和链接预测三个任务上进行了广泛的实验验证。实验结果表明,HyperGRL在多个数据集上均取得了优于现有方法的性能,平均提升分别为1.49%、0.86%和0.74%。这些结果表明,HyperGRL能够有效地学习图的结构和语义信息,并生成高质量的图表示。

🎯 应用场景

HyperGRL具有广泛的应用前景,包括社交网络分析、知识图谱推理、生物信息学、推荐系统等领域。高质量的图表示可以用于节点分类、链接预测、社区发现等下游任务,从而为实际应用提供更准确、更可靠的支持。该研究的成果有助于推动图神经网络在各个领域的应用和发展。

📄 摘要(原文)

Graph representation learning (GRL) aims to encode structural and semantic dependencies of graph-structured data into low-dimensional embeddings. However, existing GRL methods often rely on surrogate contrastive objectives or mutual information maximization, which typically demand complex architectures, negative sampling strategies, and sensitive hyperparameter tuning. These design choices may induce over-smoothing, over-squashing, and training instability. In this work, we propose HyperGRL, a unified framework for hyperspherical graph representation learning via adaptive neighbor-mean alignment and sampling-free uniformity. HyperGRL embeds nodes on a unit hypersphere through two adversarially coupled objectives: neighbor-mean alignment and sampling-free uniformity. The alignment objective uses the mean representation of each node's local neighborhood to construct semantically grounded, stable targets that capture shared structural and feature patterns. The uniformity objective formulates dispersion via an L2-based hyperspherical regularization, encouraging globally uniform embedding distributions while preserving discriminative information. To further stabilize training, we introduce an entropy-guided adaptive balancing mechanism that dynamically regulates the interplay between alignment and uniformity without requiring manual tuning. Extensive experiments on node classification, node clustering, and link prediction demonstrate that HyperGRL delivers superior representation quality and generalization across diverse graph structures, achieving average improvements of 1.49%, 0.86%, and 0.74% over the strongest existing methods, respectively. These findings highlight the effectiveness of geometrically grounded, sampling-free contrastive objectives for graph representation learning.