Efficient Deep Learning for Short-Term Solar Irradiance Time Series Forecasting: A Benchmark Study in Ho Chi Minh City

作者: Tin Hoang

分类: cs.LG, cs.AI

发布日期: 2025-12-29

备注: preprint, 40 pages

💡 一句话要点

针对短时太阳辐照度预测,论文提出Transformer模型并结合知识蒸馏实现高效部署。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 太阳辐照度预测 时间序列预测 深度学习 Transformer模型 知识蒸馏 边缘计算 能源管理

📋 核心要点

- 精确预测全球水平辐照度(GHI)对于缓解太阳能在电网中的波动至关重要,但现有方法在预测精度和计算效率上存在挑战。

- 该研究探索了多种深度学习架构,并发现Transformer模型在GHI预测中表现出色,同时利用知识蒸馏技术压缩模型大小。

- 实验结果表明,Transformer模型取得了最高的预测精度(R^2=0.9696),并且通过知识蒸馏压缩后,在边缘设备上实现了高效部署。

📝 摘要(中文)

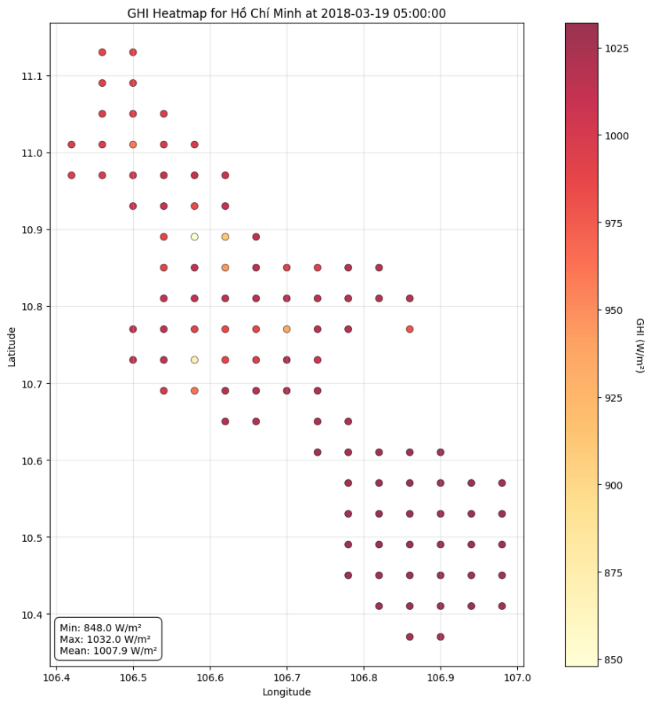

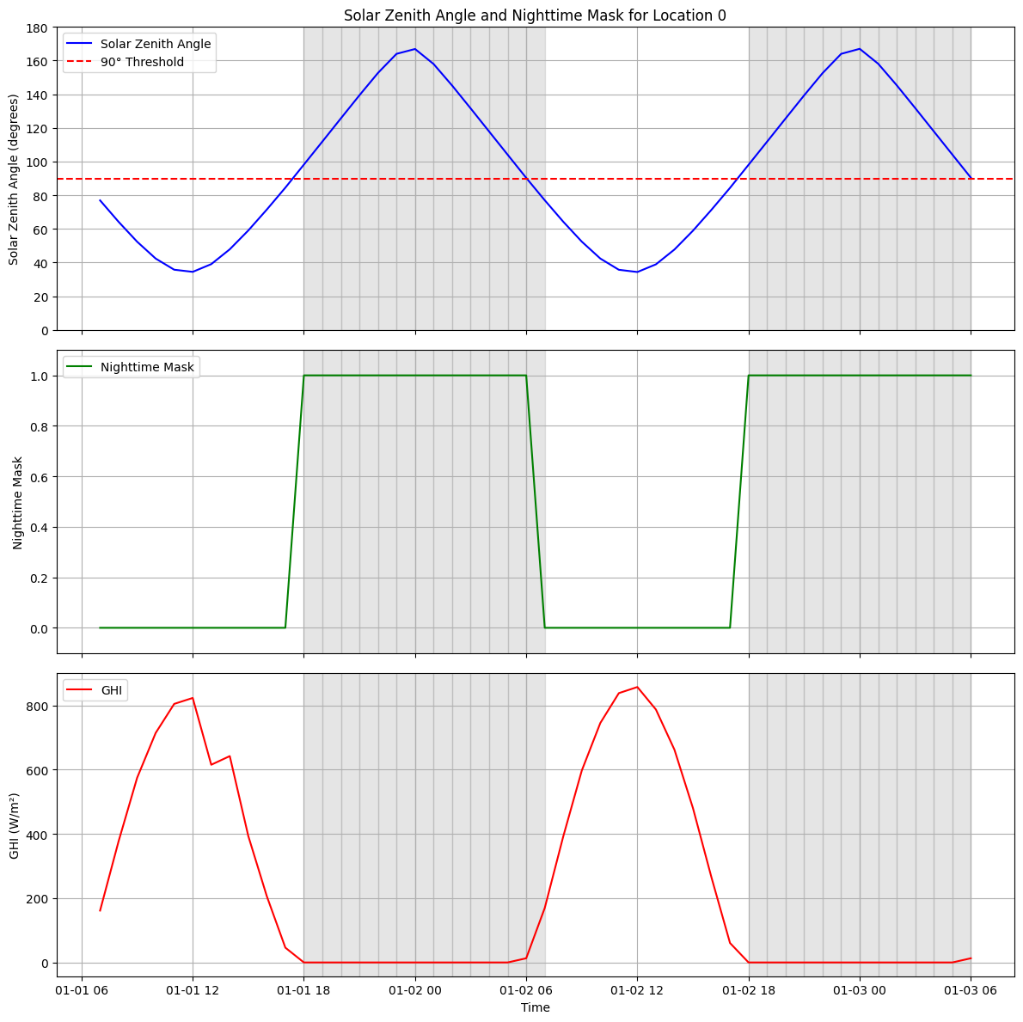

本研究对胡志明市的短时(提前1小时)全球水平辐照度(GHI)时间序列预测进行了全面的深度学习架构基准测试。利用2011-2020年的高分辨率NSRDB卫星数据,比较了包括LSTM、TCN等传统基线模型与Transformer、Informer、iTransformer、TSMixer和Mamba等新兴先进架构。实验结果表明,Transformer架构表现最佳,R^2达到0.9696。通过SHAP分析对比了这些架构的时间推理能力,发现Transformer表现出对近期大气条件的强烈“近因偏好”,而Mamba则明确利用24小时周期依赖性进行预测。此外,研究表明知识蒸馏可以将高性能Transformer压缩23.5%,同时还能降低误差(MAE:23.78 W/m^2),为在资源受限的边缘设备上部署复杂、低延迟的预测模型提供了一条有效途径。

🔬 方法详解

问题定义:论文旨在解决短时太阳辐照度(GHI)时间序列预测问题。现有方法,如LSTM和TCN,可能无法充分捕捉GHI数据中的复杂时间依赖关系,并且计算成本较高,难以在资源受限的边缘设备上部署。

核心思路:论文的核心思路是利用Transformer模型强大的时间序列建模能力来提高GHI预测的准确性,并通过知识蒸馏技术将大型Transformer模型压缩成小型模型,以便在边缘设备上实现低延迟部署。Transformer模型能够并行处理整个时间序列,从而更好地捕捉长期依赖关系。

技术框架:整体框架包括数据预处理、模型训练和模型压缩三个主要阶段。首先,使用NSRDB卫星数据进行预处理,包括数据清洗和标准化。然后,训练包括Transformer在内的多种深度学习模型,并选择性能最佳的模型。最后,使用知识蒸馏技术将大型Transformer模型压缩成小型模型。

关键创新:该研究的关键创新在于将Transformer模型应用于短时太阳辐照度预测,并结合知识蒸馏技术实现了模型压缩和部署。此外,通过SHAP分析深入研究了不同模型的temporal reasoning能力,揭示了Transformer的“近因偏好”和Mamba对周期性依赖的利用。

关键设计:论文使用了标准的Transformer架构,并针对时间序列预测任务进行了优化。知识蒸馏过程使用了教师-学生框架,其中大型Transformer模型作为教师模型,小型模型作为学生模型。损失函数包括预测误差和蒸馏损失,以确保学生模型能够学习到教师模型的知识。具体参数设置和网络结构细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Transformer模型在GHI预测中表现最佳,R^2达到0.9696。通过SHAP分析,揭示了Transformer的“近因偏好”。知识蒸馏可以将Transformer模型压缩23.5%,同时MAE降低至23.78 W/m^2,验证了在资源受限设备上部署高性能预测模型的有效性。

🎯 应用场景

该研究成果可应用于智能电网、太阳能发电厂和能源管理系统等领域。通过准确预测太阳辐照度,可以优化太阳能发电的调度和存储,提高电网的稳定性和可靠性,并降低能源成本。此外,压缩后的模型可以在边缘设备上部署,实现实时的太阳能发电预测和管理。

📄 摘要(原文)

Reliable forecasting of Global Horizontal Irradiance (GHI) is essential for mitigating the variability of solar energy in power grids. This study presents a comprehensive benchmark of ten deep learning architectures for short-term (1-hour ahead) GHI time series forecasting in Ho Chi Minh City, leveraging high-resolution NSRDB satellite data (2011-2020) to compare established baselines (e.g. LSTM, TCN) against emerging state-of-the-art architectures, including Transformer, Informer, iTransformer, TSMixer, and Mamba. Experimental results identify the Transformer as the superior architecture, achieving the highest predictive accuracy with an R^2 of 0.9696. The study further utilizes SHAP analysis to contrast the temporal reasoning of these architectures, revealing that Transformers exhibit a strong "recency bias" focused on immediate atmospheric conditions, whereas Mamba explicitly leverages 24-hour periodic dependencies to inform predictions. Furthermore, we demonstrate that Knowledge Distillation can compress the high-performance Transformer by 23.5% while surprisingly reducing error (MAE: 23.78 W/m^2), offering a proven pathway for deploying sophisticated, low-latency forecasting on resource-constrained edge devices.