MS-SSM: A Multi-Scale State Space Model for Efficient Sequence Modeling

作者: Mahdi Karami, Ali Behrouz, Peilin Zhong, Razvan Pascanu, Vahab Mirrokni

分类: cs.LG

发布日期: 2025-12-29

备注: In Second Conference on Language Modeling (COLM) (2025)

💡 一句话要点

提出MS-SSM,一种用于高效序列建模的多尺度状态空间模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 状态空间模型 序列建模 多尺度表示 长程依赖 时间序列分析

📋 核心要点

- 传统SSM存在有效记忆有限和难以捕捉多尺度依赖关系的问题,限制了其在复杂序列建模任务中的应用。

- MS-SSM通过在多个分辨率上表示序列动态,并使用输入相关的尺度混合器实现跨分辨率的动态信息融合,从而解决上述问题。

- 实验结果表明,MS-SSM在长程序列建模、分层推理、时间序列分类和图像识别等任务中均优于现有SSM模型。

📝 摘要(中文)

状态空间模型(SSM)作为一种高效的序列建模方法,最近受到了广泛关注,它能替代计算成本高昂的基于注意力机制的模型。SSM依赖于线性递归来整合时间信息,从而实现快速推理、可并行训练和对递归稳定性的控制。然而,传统的SSM通常存在有效记忆有限的问题,需要更大的状态尺寸以提高召回率。此外,现有的SSM难以捕捉多尺度依赖关系,而这对于建模时间序列、图像和自然语言中的复杂结构至关重要。本文提出了一种多尺度SSM框架,通过在多个分辨率上表示序列动态,并使用专门的状态空间动态处理每个分辨率,从而解决这些限制。通过捕获细粒度的高频模式和粗粒度的全局趋势,MS-SSM增强了记忆效率和长程建模能力。我们进一步引入了一个输入相关的尺度混合器,从而实现跨分辨率的动态信息融合。所提出的方法显著提高了序列建模能力,特别是在长程和分层任务中,同时保持了计算效率。在包括Long Range Arena、分层推理、时间序列分类和图像识别在内的基准测试中进行的大量实验表明,MS-SSM始终优于先前的基于SSM的模型,突出了多分辨率处理在状态空间架构中的优势。

🔬 方法详解

问题定义:论文旨在解决现有状态空间模型(SSM)在序列建模中存在的两个主要问题:一是有效记忆容量有限,导致无法有效处理长程依赖关系;二是难以捕捉序列数据中存在的多尺度依赖关系,限制了其在复杂任务中的表现。现有SSM模型通常需要增加状态维度来提升记忆能力,但这会显著增加计算成本。

核心思路:MS-SSM的核心思路是通过多尺度表示来提升SSM的记忆效率和长程建模能力。具体来说,它将输入序列分解为多个不同分辨率的表示,每个分辨率对应不同的时间尺度。通过在不同尺度上学习专门的状态空间动态,模型可以同时捕获细粒度的高频模式和粗粒度的全局趋势。此外,引入输入相关的尺度混合器,动态地融合不同分辨率的信息,进一步增强了模型的表达能力。

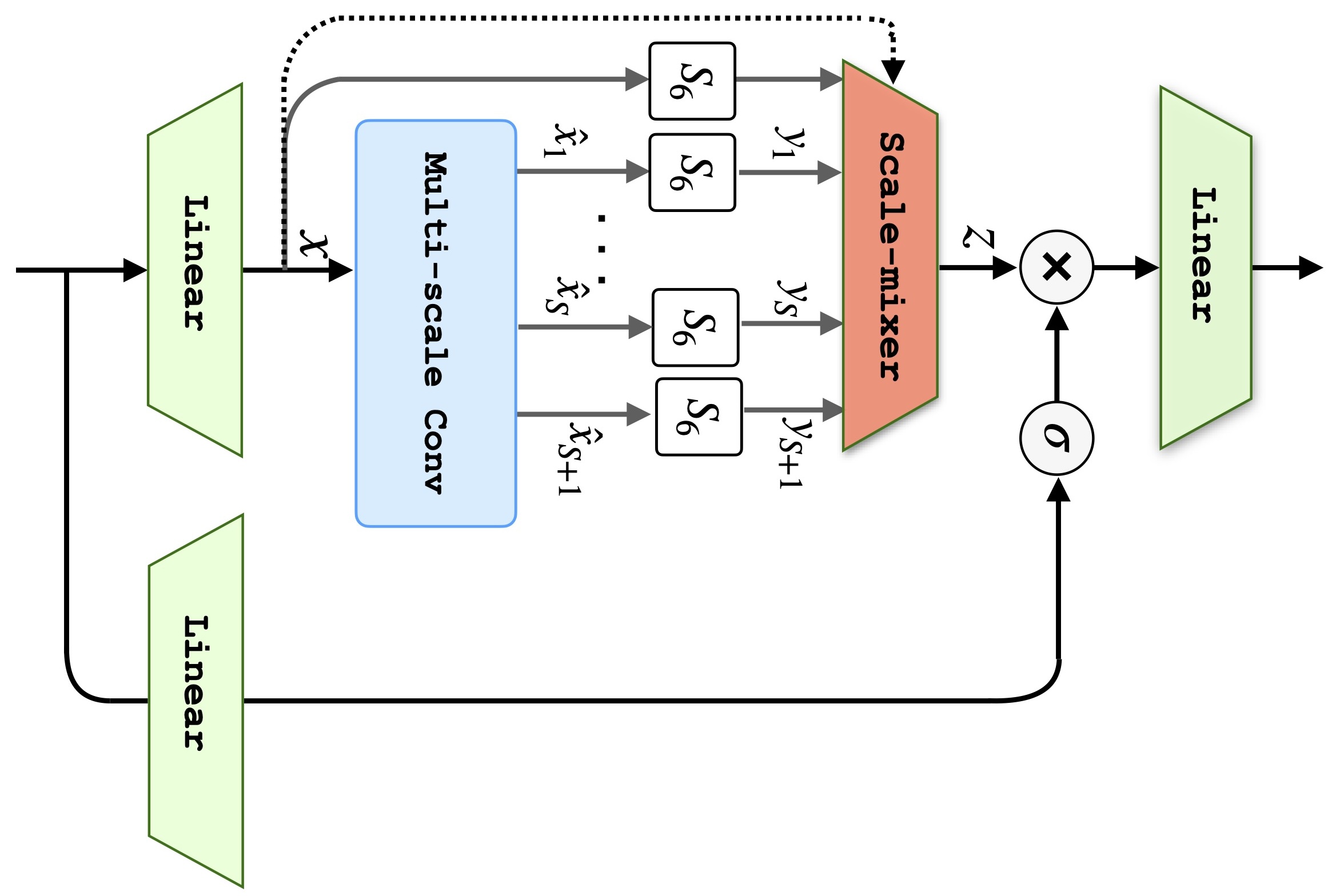

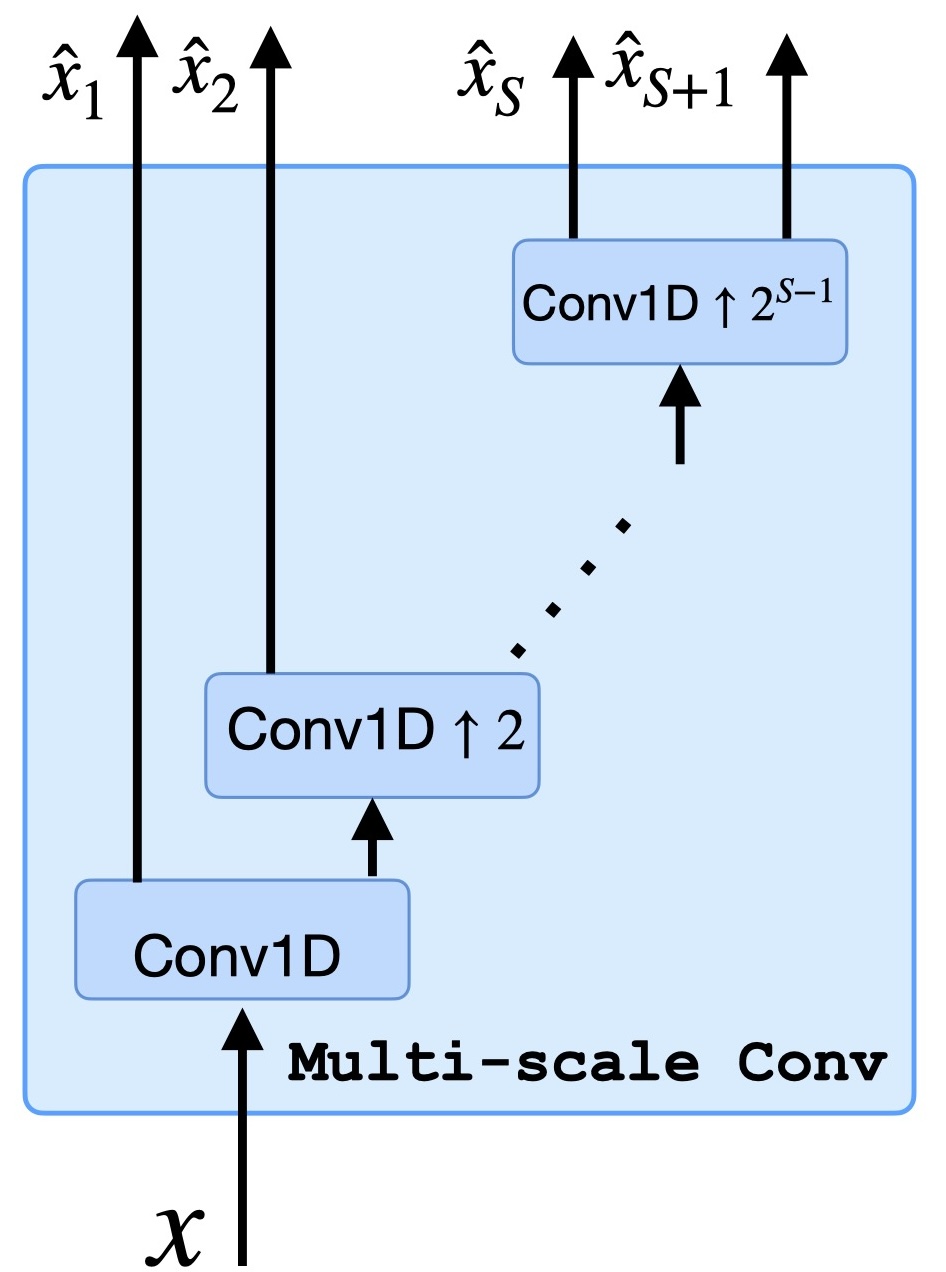

技术框架:MS-SSM的整体架构包含以下几个主要模块:1) 多尺度分解模块:将输入序列分解为多个不同分辨率的表示。2) 多尺度状态空间模型:在每个分辨率上应用专门的状态空间模型,学习该尺度下的序列动态。3) 输入相关的尺度混合器:根据输入动态地融合不同分辨率的信息。整个流程可以概括为:输入序列 -> 多尺度分解 -> 多尺度SSM处理 -> 尺度混合 -> 输出。

关键创新:MS-SSM最关键的创新点在于其多尺度表示和输入相关的尺度混合机制。多尺度表示使得模型能够同时捕获不同时间尺度的信息,从而提升了长程建模能力和记忆效率。输入相关的尺度混合器则允许模型根据输入动态地调整不同分辨率信息的权重,从而更好地适应不同的序列模式。这与传统的单尺度SSM和静态混合方法有本质区别。

关键设计:在多尺度分解模块中,可以使用不同的下采样方法来获得不同分辨率的表示,例如平均池化或可学习的卷积层。尺度混合器可以采用注意力机制或门控机制来实现,根据输入动态地计算不同分辨率的权重。损失函数方面,可以使用标准的序列建模损失函数,例如交叉熵损失或均方误差损失。具体的网络结构和参数设置需要根据具体的任务进行调整。

🖼️ 关键图片

📊 实验亮点

MS-SSM在多个基准测试中取得了显著的性能提升。在Long Range Arena基准测试中,MS-SSM优于现有的SSM模型。在分层推理任务中,MS-SSM能够更好地捕捉层次结构信息,从而提高了推理准确率。在时间序列分类和图像识别任务中,MS-SSM也取得了具有竞争力的结果,证明了其在不同领域的泛化能力。

🎯 应用场景

MS-SSM具有广泛的应用前景,包括时间序列预测、自然语言处理、图像识别和语音识别等领域。其高效的序列建模能力使其特别适用于处理长序列数据,例如长文本理解、视频分析和基因组序列分析等。此外,MS-SSM的多尺度表示能力使其能够更好地捕捉复杂系统中的多尺度依赖关系,例如金融市场分析和气候建模。

📄 摘要(原文)

State-space models (SSMs) have recently attention as an efficient alternative to computationally expensive attention-based models for sequence modeling. They rely on linear recurrences to integrate information over time, enabling fast inference, parallelizable training, and control over recurrence stability. However, traditional SSMs often suffer from limited effective memory, requiring larger state sizes for improved recall. Moreover, existing SSMs struggle to capture multi-scale dependencies, which are essential for modeling complex structures in time series, images, and natural language. This paper introduces a multi-scale SSM framework that addresses these limitations by representing sequence dynamics across multiple resolution and processing each resolution with specialized state-space dynamics. By capturing both fine-grained, high-frequency patterns and coarse, global trends, MS-SSM enhances memory efficiency and long-range modeling. We further introduce an input-dependent scale-mixer, enabling dynamic information fusion across resolutions. The proposed approach significantly improves sequence modeling, particularly in long-range and hierarchical tasks, while maintaining computational efficiency. Extensive experiments on benchmarks, including Long Range Arena, hierarchical reasoning, time series classification, and image recognition, demonstrate that MS-SSM consistently outperforms prior SSM-based models, highlighting the benefits of multi-resolution processing in state-space architectures.