Value-guided action planning with JEPA world models

作者: Matthieu Destrade, Oumayma Bounou, Quentin Le Lidec, Jean Ponce, Yann LeCun

分类: cs.LG, cs.AI, cs.RO

发布日期: 2025-12-28

备注: Presented as a poster at the World Modeling Workshop 2026, Mila

💡 一句话要点

提出基于JEPA世界模型的价值引导动作规划方法,提升控制任务性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: JEPA世界模型 动作规划 价值引导 表征学习 自监督学习

📋 核心要点

- 现有深度学习模型在环境推理方面存在不足,尤其是在有效动作规划方面。

- 论文核心在于通过价值函数引导JEPA世界模型的表征学习,使状态嵌入能反映到达目标的代价。

- 实验表明,在简单控制任务中,该方法显著提升了基于JEPA模型的规划性能。

📝 摘要(中文)

本文提出了一种增强JEPA世界模型规划能力的方法,通过塑造其表征空间,使环境中的目标条件负价值函数近似于状态嵌入之间的距离(或准距离)。具体而言,论文在训练过程中强制执行这一约束,实验结果表明,与标准JEPA模型相比,该方法在简单控制任务上显著提高了规划性能。

🔬 方法详解

问题定义:现有的JEPA(Joint-Embedded Predictive Architectures)世界模型在支持有效的动作规划方面存在局限性。虽然JEPA能够学习环境的动态模型,但其表征空间可能并未针对规划任务进行优化,导致难以直接利用其进行策略搜索和动作选择。因此,如何利用JEPA模型进行高效的动作规划是一个关键问题。

核心思路:论文的核心思路是通过价值函数来引导JEPA模型的表征学习。具体来说,论文的目标是使JEPA模型学习到的状态嵌入,能够反映从当前状态到达目标的代价。理想情况下,状态嵌入之间的距离(或准距离)应该近似于负的目标条件价值函数。通过这种方式,规划问题可以转化为在嵌入空间中寻找距离目标最近的状态序列。

技术框架:该方法主要包含两个阶段:首先,使用自监督学习训练JEPA世界模型,使其能够预测环境的未来状态。其次,在训练过程中,引入一个额外的损失函数,用于约束JEPA模型的表征空间,使其满足价值函数近似的要求。这个损失函数鼓励状态嵌入之间的距离与负的目标条件价值函数相匹配。整体框架是在JEPA的基础上,增加了一个价值引导的正则化项。

关键创新:该方法最重要的创新在于将价值函数的概念融入到JEPA模型的表征学习中。与传统的JEPA模型只关注状态预测不同,该方法同时考虑了状态之间的价值关系,从而使得学习到的表征更适合于动作规划。这种价值引导的表征学习能够显著提高规划的效率和准确性。

关键设计:关键的设计在于如何定义和计算价值函数,以及如何将价值函数的信息融入到JEPA模型的训练过程中。论文提出了一种实用的方法来强制执行价值函数约束。具体来说,可以使用动态规划或其他方法来估计目标条件价值函数,然后将其作为监督信号,用于训练JEPA模型的嵌入层。损失函数可以设计为状态嵌入距离与负价值函数之间的均方误差或其他合适的距离度量。

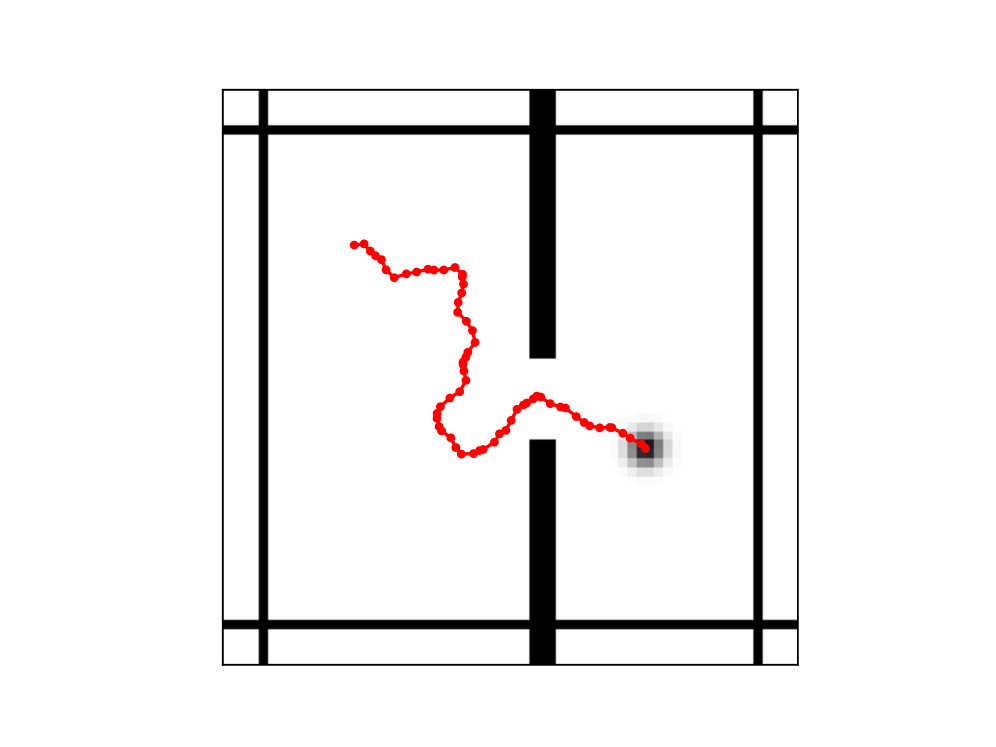

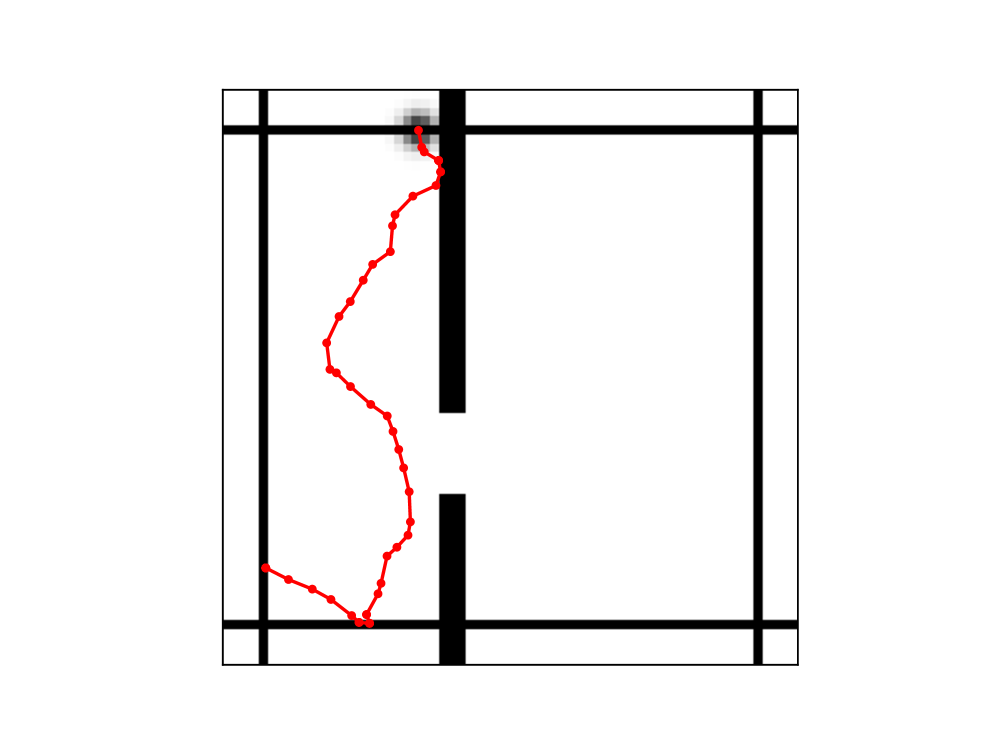

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出方法的有效性。在简单控制任务中,与标准JEPA模型相比,该方法显著提高了规划性能。具体的性能提升数据未知,但摘要强调了“显著提高”,表明该方法具有一定的优势。

🎯 应用场景

该研究成果可应用于机器人导航、游戏AI、自动驾驶等领域。通过学习环境的动态模型和价值函数,智能体可以更有效地规划行动,完成复杂任务。该方法有望提升智能体在复杂环境中的适应性和决策能力,具有重要的实际应用价值。

📄 摘要(原文)

Building deep learning models that can reason about their environment requires capturing its underlying dynamics. Joint-Embedded Predictive Architectures (JEPA) provide a promising framework to model such dynamics by learning representations and predictors through a self-supervised prediction objective. However, their ability to support effective action planning remains limited. We propose an approach to enhance planning with JEPA world models by shaping their representation space so that the negative goal-conditioned value function for a reaching cost in a given environment is approximated by a distance (or quasi-distance) between state embeddings. We introduce a practical method to enforce this constraint during training and show that it leads to significantly improved planning performance compared to standard JEPA models on simple control tasks.