Multimodal Functional Maximum Correlation for Emotion Recognition

作者: Deyang Zheng, Tianyi Zhang, Wenming Zheng, Shujian Yu

分类: cs.LG, cs.AI, cs.HC

发布日期: 2025-12-28

备注: manuscript currently under review at IEEE journals, 20 pages, 6 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出多模态功能最大相关(MFMC)框架,用于提升情感识别的性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感识别 多模态学习 自监督学习 功能最大相关 生理信号 深度学习

📋 核心要点

- 现有情感识别方法难以有效建模多模态数据间的高阶依赖关系,忽略了大脑和自主神经系统协调反应产生的重要交互。

- MFMC通过最大化双重总相关(DTC)目标,直接捕获多模态数据间的高阶依赖,无需依赖成对对比损失。

- 实验表明,MFMC在多个情感计算数据集上取得了显著的性能提升,尤其在受试者无关的设置下表现出更强的鲁棒性。

📝 摘要(中文)

情感状态表现为中枢和自主神经系统中协调但异构的生理反应,这对情感计算中的多模态表征学习提出了根本性的挑战。情感标注的稀缺性和主观性进一步加剧了学习这种联合动态的难度,因此需要使用自监督学习(SSL)。然而,现有的大多数SSL方法依赖于成对对齐目标,这不足以表征两个以上模态之间的依赖关系,并且无法捕捉由协调的大脑和自主反应产生的高阶交互。为了解决这个局限性,我们提出了一种多模态功能最大相关(MFMC)框架,这是一种基于原则的SSL框架,它通过双重总相关(DTC)目标最大化高阶多模态依赖性。通过推导一个严格的夹逼界限并使用基于功能最大相关分析(FMCA)的迹线替代进行优化,MFMC直接捕获联合多模态交互,而无需依赖成对对比损失。在三个公共情感计算基准上的实验表明,MFMC在受试者相关和受试者无关的评估协议下始终如一地实现了最先进或具有竞争力的性能,突出了其对受试者间变异性的鲁棒性。特别是,MFMC将CEAP-360VR上的受试者相关准确率从78.9%提高到86.8%,并且仅使用EDA信号将受试者无关准确率从27.5%提高到33.1%。此外,MFMC在MAHNOB-HCI最具挑战性的EEG受试者无关分割上,与表现最佳的方法的差距保持在0.8个百分点以内。我们的代码可在https://github.com/DY9910/MFMC上找到。

🔬 方法详解

问题定义:情感识别任务需要理解不同生理信号(如脑电、皮肤电等)之间的复杂关系。现有方法,特别是基于自监督学习的方法,通常依赖于成对模态对齐,无法充分捕捉多模态数据之间的高阶依赖关系,导致情感识别精度受限。此外,情感标注数据稀缺,也限制了模型的训练效果。

核心思路:MFMC的核心在于通过最大化多模态数据之间的总相关性来学习更有效的表征。它不依赖于成对的模态对齐,而是直接优化所有模态之间的联合分布,从而捕捉高阶交互信息。这种方法能够更好地利用未标注数据,提升模型的泛化能力。

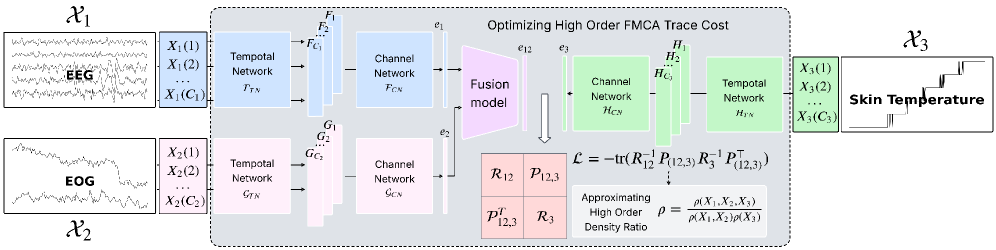

技术框架:MFMC框架主要包含以下几个步骤:1) 数据预处理:对多模态生理信号进行清洗和标准化。2) 特征提取:使用预训练或自定义的网络提取每个模态的特征。3) 双重总相关(DTC)目标优化:构建DTC损失函数,该函数旨在最大化所有模态之间的总相关性。4) 功能最大相关分析(FMCA):使用FMCA方法优化DTC损失函数,找到能够最大化多模态相关性的特征映射。5) 情感分类:使用学习到的多模态表征进行情感分类。

关键创新:MFMC的关键创新在于提出了基于双重总相关(DTC)的自监督学习目标。与传统的成对对比损失不同,DTC能够直接衡量多个模态之间的整体依赖关系,从而更好地捕捉高阶交互信息。此外,使用FMCA优化DTC,避免了直接计算高维相关矩阵的难题。

关键设计:DTC损失函数的设计是关键。论文中采用了一种基于迹线(trace)的替代函数来近似DTC,使其易于优化。具体来说,通过推导一个夹逼界限,将DTC的优化问题转化为一个更容易求解的迹优化问题。此外,FMCA的使用也降低了计算复杂度,使得模型能够处理高维多模态数据。

🖼️ 关键图片

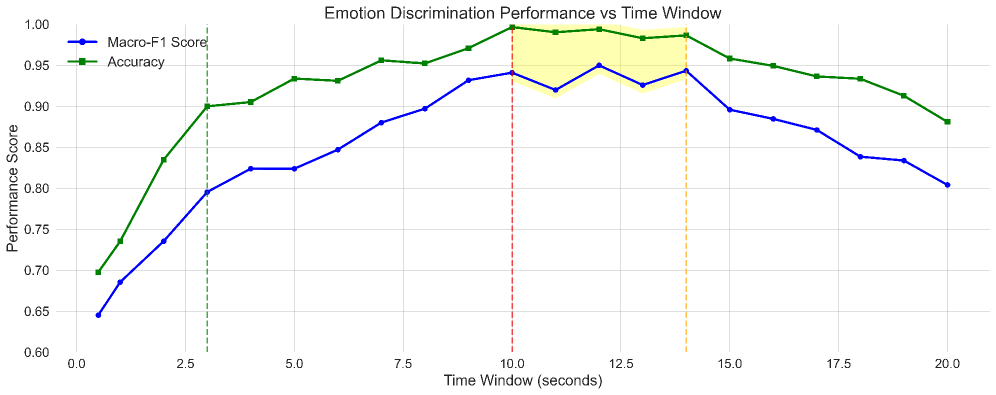

📊 实验亮点

MFMC在三个公开情感计算数据集上取得了显著的性能提升。在CEAP-360VR数据集上,受试者相关的准确率从78.9%提高到86.8%,受试者无关的准确率从27.5%提高到33.1%。在MAHNOB-HCI数据集上,MFMC在最具挑战性的EEG受试者无关分割上,与最佳方法的差距保持在0.8个百分点以内。这些结果表明,MFMC在处理多模态情感数据方面具有很强的竞争力。

🎯 应用场景

MFMC在情感识别领域具有广泛的应用前景,例如人机交互、心理健康监测、智能医疗等。通过准确识别用户的情感状态,可以改善用户体验,提供个性化的服务。此外,该方法还可以应用于其他多模态数据分析任务,例如视频理解、语音识别等。

📄 摘要(原文)

Emotional states manifest as coordinated yet heterogeneous physiological responses across central and autonomic systems, posing a fundamental challenge for multimodal representation learning in affective computing. Learning such joint dynamics is further complicated by the scarcity and subjectivity of affective annotations, which motivates the use of self-supervised learning (SSL). However, most existing SSL approaches rely on pairwise alignment objectives, which are insufficient to characterize dependencies among more than two modalities and fail to capture higher-order interactions arising from coordinated brain and autonomic responses. To address this limitation, we propose Multimodal Functional Maximum Correlation (MFMC), a principled SSL framework that maximizes higher-order multimodal dependence through a Dual Total Correlation (DTC) objective. By deriving a tight sandwich bound and optimizing it using a functional maximum correlation analysis (FMCA) based trace surrogate, MFMC captures joint multimodal interactions directly, without relying on pairwise contrastive losses. Experiments on three public affective computing benchmarks demonstrate that MFMC consistently achieves state-of-the-art or competitive performance under both subject-dependent and subject-independent evaluation protocols, highlighting its robustness to inter-subject variability. In particular, MFMC improves subject-dependent accuracy on CEAP-360VR from 78.9% to 86.8%, and subject-independent accuracy from 27.5% to 33.1% using the EDA signal alone. Moreover, MFMC remains within 0.8 percentage points of the best-performing method on the most challenging EEG subject-independent split of MAHNOB-HCI. Our code is available at https://github.com/DY9910/MFMC.