Unifying Learning Dynamics and Generalization in Transformers Scaling Law

作者: Chiwun Yang

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-12-26 (更新: 2026-01-31)

备注: 52 pages, 6 figures, 1 table

💡 一句话要点

提出统一学习动态与变换器缩放法则以优化模型性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 变换器模型 学习动态 缩放法则 随机梯度下降 泛化性能 理论分析 机器学习

📋 核心要点

- 现有的缩放法则虽然在经验上有效,但其理论基础尚不明确,导致对模型性能提升的理解不足。

- 本文通过将变换器模型的学习动态形式化为常微分方程,提供了对随机梯度下降训练过程的深入分析。

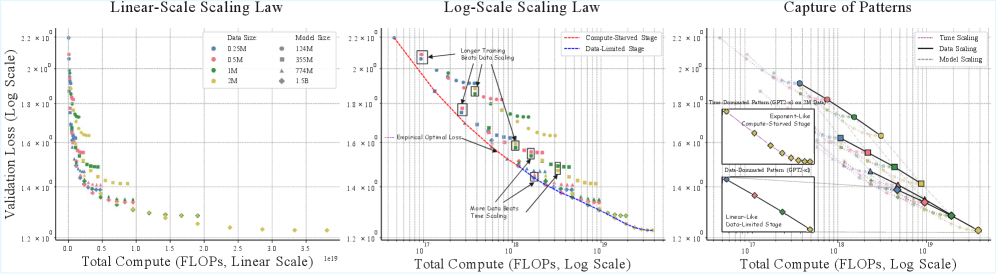

- 研究结果表明,过度风险在初始阶段以指数方式衰减,随后进入统计阶段,泛化误差遵循幂律衰减,揭示了资源配置的影响。

📝 摘要(中文)

缩放法则是大型语言模型(LLM)发展的基石,预测随着计算资源的增加,模型性能将得到提升。然而,尽管这一法则在经验上得到了验证,其理论基础仍然不够清晰。本文将基于变换器的语言模型的学习动态形式化为常微分方程(ODE)系统,并将其过程近似为核行为。与以往的玩具模型分析不同,我们严格分析了多层变换器在任意数据分布下的序列到序列数据的随机梯度下降(SGD)训练。我们的分析表征了在计算资源与数据规模增加时,泛化误差的收敛特性,尤其是在优化过程中。我们建立了一个关于过度风险的理论上限,特征为明显的相变。在初始优化阶段,过度风险相对于计算成本以指数方式衰减;而一旦跨越特定资源配置阈值,系统进入统计阶段,泛化误差则遵循幂律衰减。我们的理论还推导出模型规模、训练时间和数据集规模的独立缩放法则,阐明了每个变量如何独立地控制泛化的上限。

🔬 方法详解

问题定义:本文旨在解决现有缩放法则理论基础不明确的问题,尤其是在多层变换器模型的训练过程中,如何更好地理解学习动态与泛化性能之间的关系。

核心思路:通过将变换器模型的学习动态形式化为常微分方程(ODE)系统,论文提供了一种新的视角来分析随机梯度下降(SGD)训练过程,特别是在复杂数据分布下的表现。

技术框架:整体架构包括将学习动态建模为ODE系统,分析SGD训练过程中的收敛特性,以及在不同资源配置下的泛化误差表现。主要模块包括学习动态建模、收敛分析和缩放法则推导。

关键创新:论文的主要创新在于建立了一个理论上限,揭示了过度风险的相变特性,并推导出模型规模、训练时间和数据集规模的独立缩放法则,这在现有研究中尚未被充分探讨。

关键设计:在模型训练中,关键参数设置包括计算资源的分配和数据分布的选择,损失函数设计上考虑了泛化误差的特性,确保了理论分析与实际训练过程的紧密结合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在初始优化阶段,过度风险以指数方式衰减,随后在特定资源阈值后,泛化误差遵循幂律衰减,提供了理论与实践的有力支持。相较于传统方法,本研究在理解模型性能提升的机制上具有显著进展。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理、机器翻译和对话系统等,能够为大型语言模型的设计与优化提供理论指导。通过深入理解学习动态与泛化性能的关系,未来可以更有效地配置计算资源,从而提升模型的实际应用效果。

📄 摘要(原文)

The scaling law, a cornerstone of Large Language Model (LLM) development, predicts improvements in model performance with increasing computational resources. Yet, while empirically validated, its theoretical underpinnings remain poorly understood. This work formalizes the learning dynamics of transformer-based language models as an ordinary differential equation (ODE) system, then approximates this process to kernel behaviors. Departing from prior toy-model analyses, we rigorously analyze stochastic gradient descent (SGD) training for multi-layer transformers on sequence-to-sequence data with arbitrary data distribution, closely mirroring real-world conditions. Our analysis characterizes the convergence of generalization error to the irreducible risk as computational resources scale with data, especially during the optimization process. We establish a theoretical upper bound on excess risk characterized by a distinct phase transition. In the initial optimization phase, the excess risk decays exponentially relative to the computational cost ${\sf C}$. However, once a specific resource allocation threshold is crossed, the system enters a statistical phase, where the generalization error follows a power-law decay of $Θ(\mathsf{C}^{-1/6})$. Beyond this unified framework, our theory derives isolated scaling laws for model size, training time, and dataset size, elucidating how each variable independently governs the upper bounds of generalization.