Towards Guided Descent: Optimization Algorithms for Training Neural Networks At Scale

作者: Ansh Nagwekar

分类: cs.LG, math.OC, stat.ML

发布日期: 2025-12-20

备注: Master's Thesis at the University of Pennsylvania

💡 一句话要点

探索引导下降:面向大规模神经网络训练的优化算法研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经网络优化 随机梯度下降 二阶优化 自适应学习率 深度学习 曲率信息 各向异性

📋 核心要点

- 现有SGD及其变体在训练深度网络时,面对真实世界数据的各向异性表现出局限性,缺乏理论支撑。

- 论文核心在于探索基于曲率信息的优化算法,如二阶近似、逐层预处理和自适应学习率,以提升训练效果。

- 论文旨在弥合理论与实践的差距,为将这些优化方法集成到现代深度学习工作流程中提供实用指导。

📝 摘要(中文)

神经网络优化是现代人工智能研究中至关重要但理解不足的挑战之一。训练算法的改进可以增强基础模型中的特征学习,大幅缩短训练时间,并提高网络学习过程的可解释性。虽然随机梯度下降(SGD)及其变体已成为训练深度网络的实际标准,但它们在过度参数化机制中的成功通常更偏向于经验而非理论。本论文通过追溯优化算法从经典一阶方法到现代高阶技术的演变,研究了这种明显的悖论,揭示了有原则的算法设计如何能够揭开训练过程的神秘面纱。从SGD和自适应梯度方法的第一性原理出发,分析逐步揭示了这些传统方法在面对代表真实世界数据的各向异性时的局限性。这些问题促使人们探索基于曲率信息的复杂替代方案:二阶近似技术、逐层预处理、自适应学习率等。此外,这些优化算法与更广泛的神经网络训练工具包(包括先前和最近的进展,如最大更新参数化、学习率调度和指数移动平均)之间的相互作用对于经验上的成功同样至关重要。为了弥合理论理解和实际部署之间的差距,本文为将这些方法集成到现代深度学习工作流程中提供了实用的指导和实施策略。

🔬 方法详解

问题定义:论文旨在解决神经网络训练中优化算法的局限性问题,特别是SGD及其变体在处理具有各向异性的真实世界数据时表现出的不足。现有方法的痛点在于对超参数的敏感性、收敛速度慢以及难以处理复杂的损失函数曲面。

核心思路:论文的核心思路是探索和利用曲率信息来指导优化过程,从而克服传统一阶方法的局限性。通过引入二阶近似、逐层预处理和自适应学习率等技术,更精确地估计损失函数的局部结构,并据此调整优化方向和步长。这种方法旨在实现更快的收敛速度、更好的泛化性能以及对超参数更低的敏感性。

技术框架:论文首先回顾了经典的SGD和自适应梯度方法,然后逐步引入基于曲率信息的优化技术。整体框架包括:1) 分析现有方法的局限性;2) 提出基于曲率信息的优化算法;3) 研究优化算法与神经网络训练工具包(如学习率调度、EMA等)的相互作用;4) 提供将这些方法集成到现代深度学习工作流程中的实用指导和实施策略。

关键创新:论文的关键创新在于系统性地探索和整合了多种基于曲率信息的优化技术,并将其与现代神经网络训练技巧相结合。与现有方法相比,该研究更注重利用损失函数的二阶信息来指导优化过程,从而更有效地克服各向异性带来的挑战。

关键设计:论文的关键设计包括:1) 采用二阶近似方法来估计损失函数的局部曲率;2) 使用逐层预处理技术来调整每一层的学习率,以适应不同层的梯度尺度;3) 设计自适应学习率策略,根据优化过程中的曲率信息动态调整学习率;4) 研究这些优化技术与最大更新参数化、学习率调度和指数移动平均等训练技巧的协同作用。

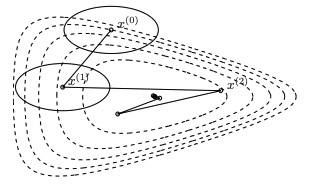

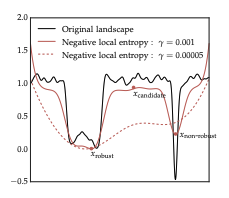

🖼️ 关键图片

📊 实验亮点

论文深入分析了现有优化算法的局限性,并提出了基于曲率信息的优化策略,为解决大规模神经网络训练难题提供了新思路。虽然具体实验数据未在摘要中体现,但其提出的优化框架和实施策略具有重要的实际应用价值。

🎯 应用场景

该研究成果可广泛应用于各种深度学习任务,尤其是在训练大规模神经网络和处理复杂数据集时。例如,可以应用于自然语言处理、计算机视觉、推荐系统等领域,提升模型训练效率和性能,加速AI技术的落地和应用。

📄 摘要(原文)

Neural network optimization remains one of the most consequential yet poorly understood challenges in modern AI research, where improvements in training algorithms can lead to enhanced feature learning in foundation models, order-of-magnitude reductions in training time, and improved interpretability into how networks learn. While stochastic gradient descent (SGD) and its variants have become the de facto standard for training deep networks, their success in these over-parameterized regimes often appears more empirical than principled. This thesis investigates this apparent paradox by tracing the evolution of optimization algorithms from classical first-order methods to modern higher-order techniques, revealing how principled algorithmic design can demystify the training process. Starting from first principles with SGD and adaptive gradient methods, the analysis progressively uncovers the limitations of these conventional approaches when confronted with anisotropy that is representative of real-world data. These breakdowns motivate the exploration of sophisticated alternatives rooted in curvature information: second-order approximation techniques, layer-wise preconditioning, adaptive learning rates, and more. Next, the interplay between these optimization algorithms and the broader neural network training toolkit, which includes prior and recent developments such as maximal update parametrization, learning rate schedules, and exponential moving averages, emerges as equally essential to empirical success. To bridge the gap between theoretical understanding and practical deployment, this paper offers practical prescriptions and implementation strategies for integrating these methods into modern deep learning workflows.