Trustworthy and Explainable Deep Reinforcement Learning for Safe and Energy-Efficient Process Control: A Use Case in Industrial Compressed Air Systems

作者: Vincent Bezold, Patrick Wagner, Jakob Hofmann, Marco Huber, Alexander Sauer

分类: cs.LG, cs.AI, eess.SY

发布日期: 2025-12-20

💡 一句话要点

提出可信赖且可解释的深度强化学习方法,用于安全节能的工业压缩空气系统控制

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion)

关键词: 深度强化学习 可解释性AI 工业控制 压缩空气系统 节能优化

📋 核心要点

- 工业压缩空气系统控制面临安全、节能和可解释性挑战,现有控制器难以兼顾多目标优化。

- 论文提出基于深度强化学习的控制框架,结合多层次可解释性分析,提升策略的可信赖度。

- 实验表明,该方法在节能约4%的同时,保证系统安全,并提供策略决策的透明解释。

📝 摘要(中文)

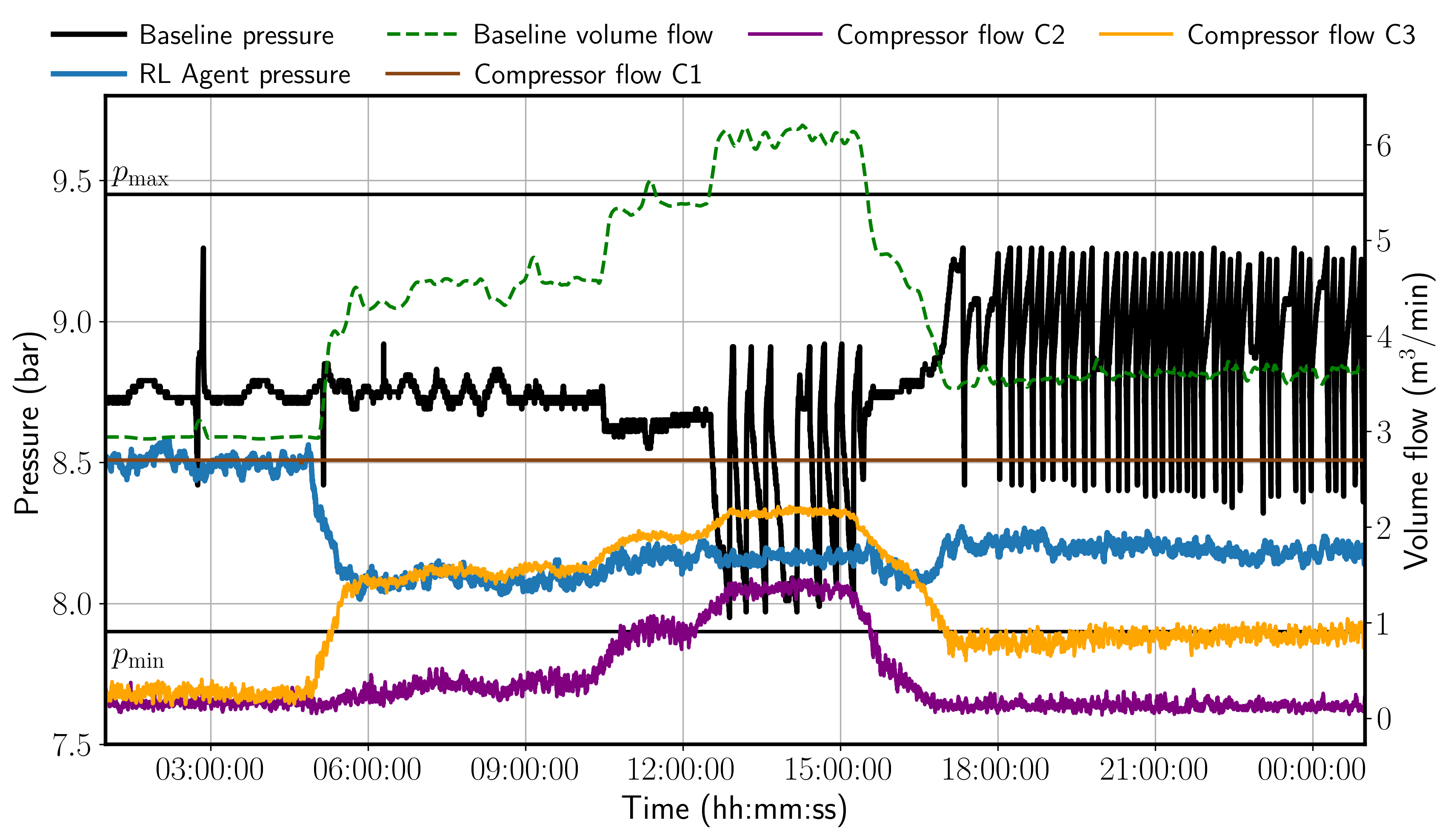

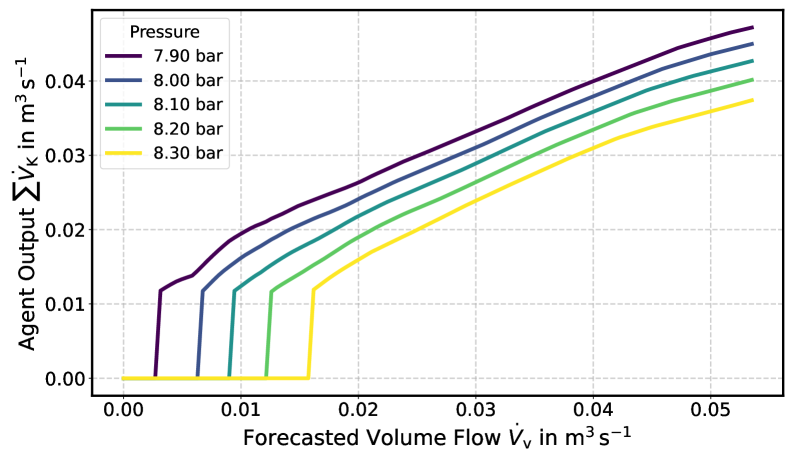

本文提出了一种可信赖的强化学习方法,用于控制工业压缩空气系统。我们开发了一个框架,该框架能够在实际边界条件下实现安全和节能运行,并引入了一个多层次的可解释性流程,结合了输入扰动测试、基于梯度的敏感性分析和SHAP(SHapley Additive exPlanations)特征归因。对多种压缩机配置的实证评估表明,学习到的策略在物理上是合理的,可以预测未来需求,并始终遵守系统边界。与已安装的工业控制器相比,所提出的方法减少了不必要的超压,并在不依赖显式物理模型的情况下实现了约4%的节能。结果进一步表明,系统压力和预测信息在策略决策中占主导地位,而压缩机级别的输入则起次要作用。总而言之,效率提升、预测行为和透明验证的结合支持了强化学习在工业能源系统中可信赖的部署。

🔬 方法详解

问题定义:工业压缩空气系统需要高效且安全地运行,同时满足变化的空气需求。传统的控制方法通常依赖于人工设计的规则或PID控制器,难以适应复杂的系统动态和优化多个目标(如节能和安全)。此外,这些方法缺乏可解释性,难以验证其行为的合理性。

核心思路:利用深度强化学习(DRL)自动学习最优控制策略,无需显式的物理模型。通过设计合适的状态空间、动作空间和奖励函数,引导智能体学习安全节能的控制策略。同时,引入多层次的可解释性分析方法,增强策略的可信赖度。

技术框架:该框架包含以下主要模块:1) 强化学习智能体,负责学习控制策略;2) 压缩空气系统环境模拟器,用于训练和评估智能体;3) 多层次可解释性分析模块,包括输入扰动测试、基于梯度的敏感性分析和SHAP特征归因。智能体与环境交互,根据环境状态选择动作,并接收奖励信号。可解释性分析模块用于理解智能体的决策过程。

关键创新:该论文的关键创新在于将深度强化学习与多层次可解释性分析相结合,应用于工业压缩空气系统的控制。这种结合使得学习到的控制策略不仅高效,而且可信赖,便于工业界接受和部署。此外,该方法无需依赖显式的物理模型,降低了建模成本。

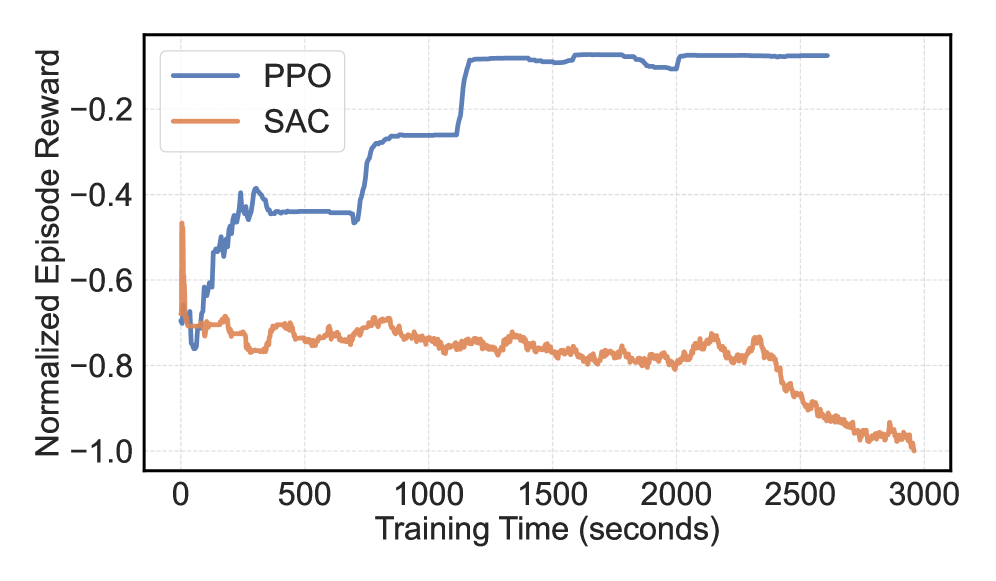

关键设计:状态空间包括系统压力、压缩机状态、未来需求预测等信息。动作空间包括压缩机的启停控制。奖励函数设计为节能和安全目标的加权和,其中节能目标鼓励降低能耗,安全目标惩罚违反系统边界的行为。使用深度神经网络作为策略网络,采用Actor-Critic算法进行训练。可解释性分析采用输入扰动测试评估输入特征对策略的影响,使用梯度敏感性分析识别关键输入特征,并使用SHAP值量化每个特征对策略决策的贡献。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的方法与已安装的工业控制器相比,能够减少不必要的超压,并实现约4%的节能,而无需依赖显式的物理模型。此外,可解释性分析表明,系统压力和预测信息在策略决策中起主导作用,验证了学习到的策略的合理性。

🎯 应用场景

该研究成果可应用于各种工业压缩空气系统的节能控制,降低能源消耗和运营成本。此外,所提出的可信赖强化学习框架可以推广到其他工业能源系统,如冷却系统、供热系统等,促进工业领域的智能化和绿色化转型。该方法的可解释性也增强了其在实际工业场景中的应用潜力。

📄 摘要(原文)

This paper presents a trustworthy reinforcement learning approach for the control of industrial compressed air systems. We develop a framework that enables safe and energy-efficient operation under realistic boundary conditions and introduce a multi-level explainability pipeline combining input perturbation tests, gradient-based sensitivity analysis, and SHAP (SHapley Additive exPlanations) feature attribution. An empirical evaluation across multiple compressor configurations shows that the learned policy is physically plausible, anticipates future demand, and consistently respects system boundaries. Compared to the installed industrial controller, the proposed approach reduces unnecessary overpressure and achieves energy savings of approximately 4\,\% without relying on explicit physics models. The results further indicate that system pressure and forecast information dominate policy decisions, while compressor-level inputs play a secondary role. Overall, the combination of efficiency gains, predictive behavior, and transparent validation supports the trustworthy deployment of reinforcement learning in industrial energy systems.