Stable and Efficient Single-Rollout RL for Multimodal Reasoning

作者: Rui Liu, Dian Yu, Lei Ke, Haolin Liu, Yujun Zhou, Zhenwen Liang, Haitao Mi, Pratap Tokekar, Dong Yu

分类: cs.LG, cs.AI, cs.CL, cs.CV

发布日期: 2025-12-20

💡 一句话要点

提出MSSR,稳定高效地进行多模态大语言模型的单次rollout强化学习推理。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态推理 强化学习 单次Rollout 熵正则化 优势塑造 大语言模型 训练稳定性

📋 核心要点

- 多模态大语言模型推理能力提升面临效率与稳定性的挑战,现有基于分组的强化学习方法计算成本高昂。

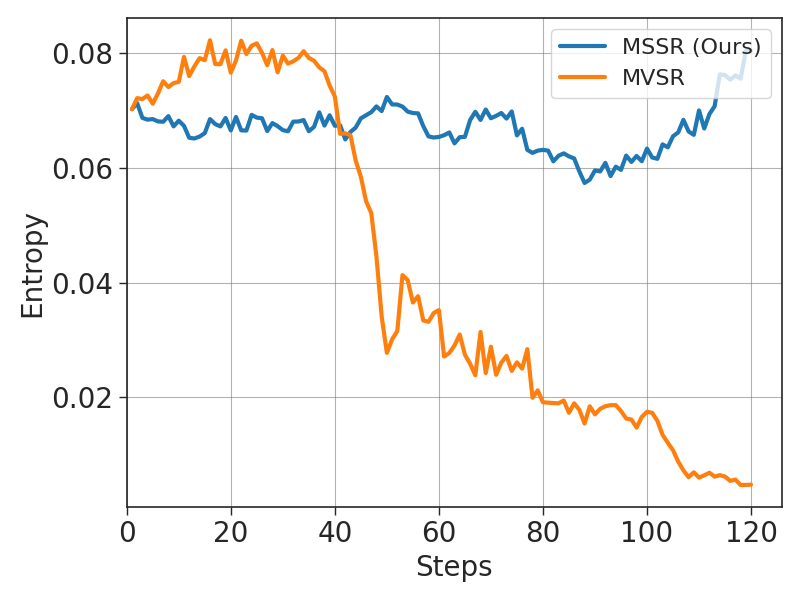

- 论文提出MSSR框架,通过熵正则化的优势塑造机制,自适应调整优势幅度,保证单次rollout训练的稳定性。

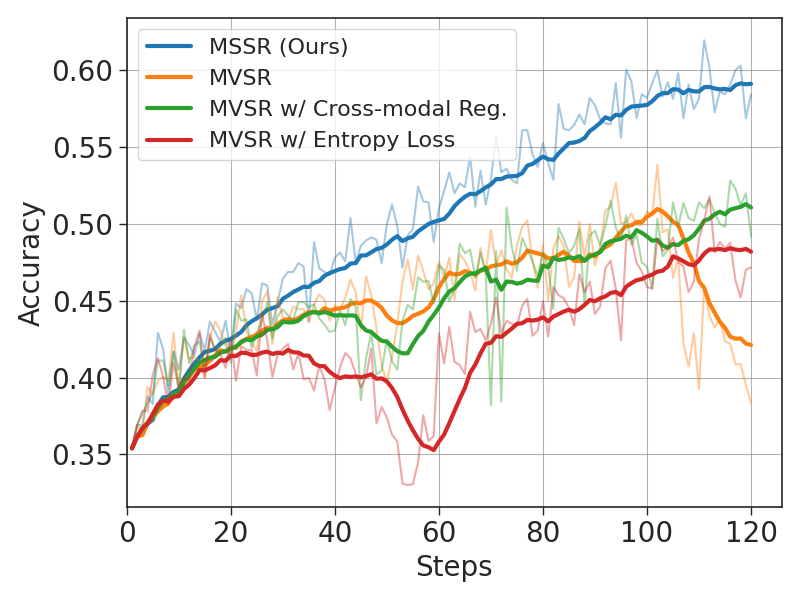

- 实验表明,MSSR在训练效率上优于分组基线,且在多个推理基准测试中表现出更好的泛化能力。

📝 摘要(中文)

基于可验证奖励的强化学习(RLVR)已成为提升多模态大语言模型(MLLM)推理能力的关键范式。然而,诸如GRPO等流行的基于分组的算法需要为每个提示进行多次rollout采样。虽然最近在纯文本设置中探索了更高效的单次rollout变体,但我们发现它们在多模态环境中存在严重的不稳定性,经常导致训练崩溃。为了解决这种训练效率-稳定性之间的权衡,我们引入了MSSR(Multimodal Stabilized Single-Rollout),这是一个无分组的RLVR框架,它实现了稳定的优化和有效的多模态推理性能。MSSR通过基于熵的优势塑造机制来实现这一点,该机制自适应地正则化优势幅度,防止崩溃并保持训练稳定性。虽然这种机制已在基于分组的RLVR中使用,但我们表明,在多模态单次rollout设置中,它们不仅有益,而且对于稳定性至关重要。在同分布评估中,MSSR展示了卓越的训练计算效率,以一半的训练步骤实现了与基于分组的基线相似的验证准确率。当训练相同数量的步骤时,MSSR的性能超过了基于分组的基线,并在五个不同的推理密集型基准测试中显示出一致的泛化改进。总而言之,这些结果表明,MSSR能够为复杂的多模态推理任务实现稳定、计算高效且有效的RLVR。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLM)在强化学习微调过程中,使用单次rollout策略时训练不稳定,容易崩溃的问题。现有基于分组的强化学习方法,如GRPO,虽然训练稳定,但需要多次rollout采样,计算成本高昂,限制了其在复杂多模态任务中的应用。

核心思路:论文的核心思路是通过引入基于熵的优势塑造机制,自适应地正则化优势函数的幅度。这种方法能够有效地控制策略更新的步长,防止因单次rollout带来的高方差梯度更新导致训练崩溃。通过稳定训练过程,使得单次rollout强化学习能够有效地应用于多模态推理任务。

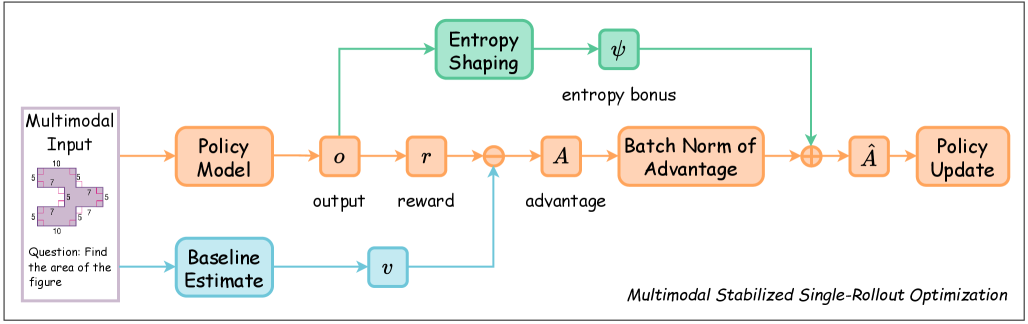

技术框架:MSSR框架是一个无分组的RLVR框架,主要包含以下几个阶段:1. MLLM接收多模态输入并生成动作序列;2. 环境根据动作序列给出奖励信号;3. 基于奖励信号计算优势函数;4. 使用基于熵的优势塑造机制正则化优势函数;5. 使用正则化后的优势函数更新MLLM的策略。

关键创新:论文最重要的技术创新点在于将基于熵的优势塑造机制应用于多模态单次rollout强化学习中。虽然该机制在基于分组的RLVR中已有应用,但论文证明了其在多模态单次rollout设置中对于稳定训练至关重要。通过自适应地调整优势幅度,MSSR能够有效地平衡探索与利用,防止训练崩溃,并提高训练效率。

关键设计:MSSR的关键设计在于熵正则化系数的自适应调整。具体来说,该系数根据当前策略的熵值动态变化,当策略熵较低时,增大正则化强度,鼓励探索;当策略熵较高时,减小正则化强度,允许更激进的策略更新。此外,损失函数采用标准的策略梯度损失,并结合正则化后的优势函数进行优化。

🖼️ 关键图片

📊 实验亮点

MSSR在同分布评估中,以一半的训练步骤实现了与基于分组的基线相似的验证准确率。在相同训练步骤下,MSSR的性能超越了分组基线,并在五个不同的推理基准测试中显示出一致的泛化改进。这些结果表明,MSSR在训练效率、稳定性和泛化能力方面均优于现有方法。

🎯 应用场景

该研究成果可应用于各种需要多模态推理能力的场景,例如视觉问答、图像描述生成、机器人导航等。通过提高训练效率和稳定性,MSSR能够降低多模态大语言模型在实际应用中的部署成本,并提升其在复杂任务中的性能表现,具有广泛的应用前景。

📄 摘要(原文)

Reinforcement Learning with Verifiable Rewards (RLVR) has become a key paradigm to improve the reasoning capabilities of Multimodal Large Language Models (MLLMs). However, prevalent group-based algorithms such as GRPO require multi-rollout sampling for each prompt. While more efficient single-rollout variants have recently been explored in text-only settings, we find that they suffer from severe instability in multimodal contexts, often leading to training collapse. To address this training efficiency-stability trade-off, we introduce $\textbf{MSSR}$ (Multimodal Stabilized Single-Rollout), a group-free RLVR framework that achieves both stable optimization and effective multimodal reasoning performance. MSSR achieves this via an entropy-based advantage-shaping mechanism that adaptively regularizes advantage magnitudes, preventing collapse and maintaining training stability. While such mechanisms have been used in group-based RLVR, we show that in the multimodal single-rollout setting they are not merely beneficial but essential for stability. In in-distribution evaluations, MSSR demonstrates superior training compute efficiency, achieving similar validation accuracy to the group-based baseline with half the training steps. When trained for the same number of steps, MSSR's performance surpasses the group-based baseline and shows consistent generalization improvements across five diverse reasoning-intensive benchmarks. Together, these results demonstrate that MSSR enables stable, compute-efficient, and effective RLVR for complex multimodal reasoning tasks.