Dynamic Tool Dependency Retrieval for Efficient Function Calling

作者: Bhrij Patel, Davide Belli, Amir Jalalirad, Maximilian Arnold, Aleksandr Ermolov, Bence Major

分类: cs.LG

发布日期: 2025-12-18 (更新: 2025-12-23)

备注: 18 pages, 5 figures, 6 tables

💡 一句话要点

提出动态工具依赖检索(DTDR),提升函数调用Agent效率与准确率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 函数调用 工具检索 动态检索 依赖关系建模 大型语言模型

📋 核心要点

- 现有函数调用Agent的工具检索方法依赖静态输入,无法捕捉复杂任务中工具间的依赖关系和动态变化的任务上下文。

- DTDR方法通过建模工具依赖关系,并结合初始查询和动态执行上下文,实现更精准的工具检索。

- 实验表明,DTDR显著提升了函数调用Agent的成功率,最高可达104%,优于现有静态检索方法。

📝 摘要(中文)

本文提出了一种名为动态工具依赖检索(DTDR)的轻量级检索方法,旨在提高函数调用Agent的效率和准确性。现有的检索方法依赖于静态且有限的输入,无法捕捉多步骤工具依赖关系和不断演进的任务上下文,导致检索到不相关的工具,误导Agent。DTDR通过对初始查询和不断演进的执行上下文进行条件建模,从函数调用演示中学习工具依赖关系,从而实现自适应检索。实验结果表明,与最先进的静态检索方法相比,DTDR在函数调用成功率方面提高了23%到104%。此外,本文还探讨了将检索到的工具集成到提示中的策略。

🔬 方法详解

问题定义:现有函数调用Agent在选择工具时,依赖静态的检索方法,无法有效捕捉工具之间的依赖关系以及任务上下文的动态变化。这导致检索结果中包含大量不相关的工具,降低了Agent的效率和准确性,阻碍了复杂任务的自动化执行。

核心思路:DTDR的核心思路是利用函数调用演示数据学习工具之间的依赖关系,并结合初始查询和执行上下文的动态变化,进行自适应的工具检索。通过这种方式,DTDR能够更准确地预测下一步可能需要的工具,从而提高Agent的效率和准确性。

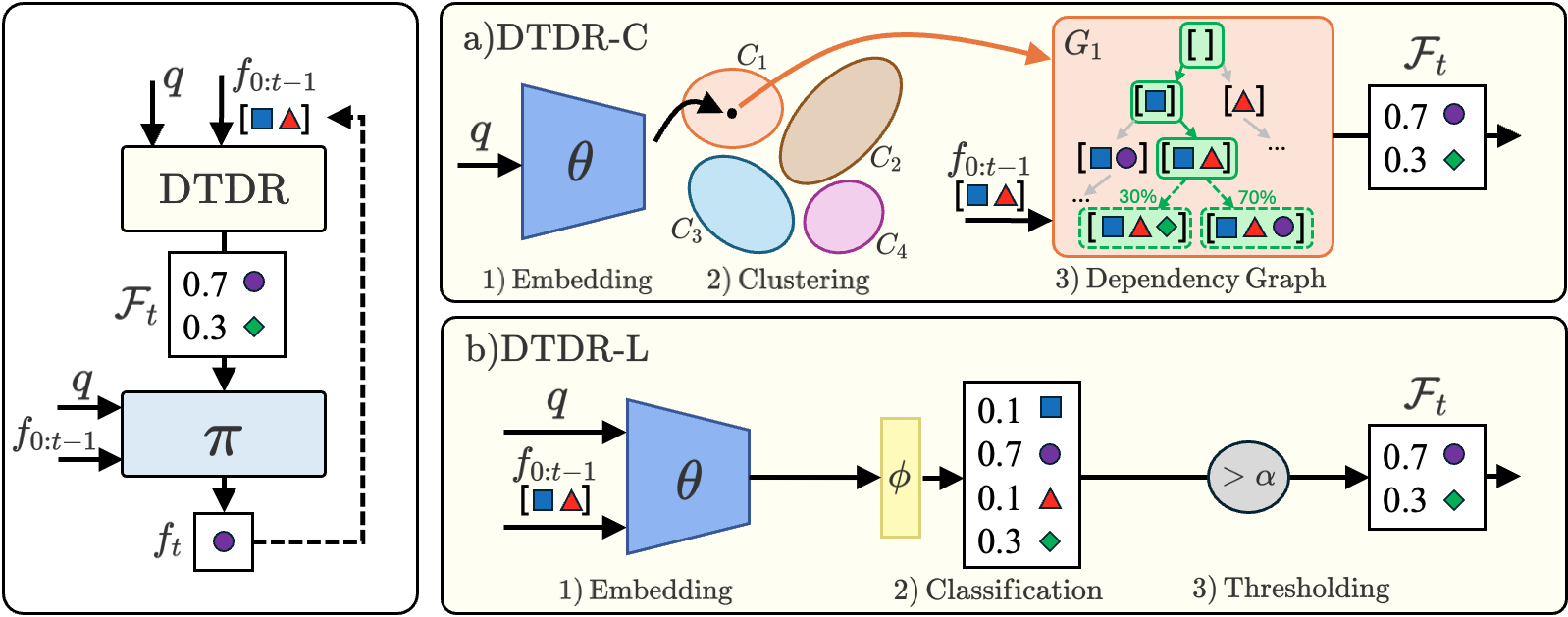

技术框架:DTDR主要包含以下几个模块:1) 依赖关系建模:从函数调用演示数据中学习工具之间的依赖关系,例如,工具A被调用后,工具B更有可能被调用。2) 上下文编码:对初始查询和执行上下文进行编码,提取关键信息。3) 动态检索:结合依赖关系模型和上下文编码,动态地检索最相关的工具。4) 工具集成:将检索到的工具集成到提示中,供Agent使用。

关键创新:DTDR的关键创新在于其动态性。与传统的静态检索方法不同,DTDR能够根据任务的执行进度和上下文的变化,自适应地调整检索策略,从而更准确地预测下一步可能需要的工具。这种动态性使得DTDR能够更好地处理复杂任务,并提高Agent的效率和准确性。

关键设计:DTDR的具体实现细节可能包括:使用Transformer等神经网络模型进行上下文编码;使用图神经网络或知识图谱来表示工具之间的依赖关系;使用强化学习等方法来优化检索策略。具体的损失函数和网络结构等细节在论文中可能有所描述,但此处无法得知具体细节。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DTDR在多个数据集和LLM backbones上均优于现有的静态检索方法。具体而言,DTDR在函数调用成功率方面提高了23%到104%。这些结果表明,DTDR能够显著提升函数调用Agent的性能,使其能够更好地完成复杂任务。

🎯 应用场景

DTDR技术可广泛应用于各种需要函数调用Agent的场景,例如智能助手、自动化运维、机器人控制等。通过提高工具检索的准确性和效率,DTDR能够显著提升这些Agent的性能,使其能够更好地完成复杂任务,并降低人工干预的需求。未来,DTDR还可以与其他技术相结合,例如知识图谱、强化学习等,进一步提升Agent的智能化水平。

📄 摘要(原文)

Function calling agents powered by Large Language Models (LLMs) select external tools to automate complex tasks. On-device agents typically use a retrieval module to select relevant tools, improving performance and reducing context length. However, existing retrieval methods rely on static and limited inputs, failing to capture multi-step tool dependencies and evolving task context. This limitation often introduces irrelevant tools that mislead the agent, degrading efficiency and accuracy. We propose Dynamic Tool Dependency Retrieval (DTDR), a lightweight retrieval method that conditions on both the initial query and the evolving execution context. DTDR models tool dependencies from function calling demonstrations, enabling adaptive retrieval as plans unfold. We benchmark DTDR against state-of-the-art retrieval methods across multiple datasets and LLM backbones, evaluating retrieval precision, downstream task accuracy, and computational efficiency. Additionally, we explore strategies to integrate retrieved tools into prompts. Our results show that dynamic tool retrieval improves function calling success rates between $23\%$ and $104\%$ compared to state-of-the-art static retrievers.