COBRA: Catastrophic Bit-flip Reliability Analysis of State-Space Models

作者: Sanjay Das, Swastik Bhattacharya, Shamik Kundu, Arnab Raha, Souvik Kundu, Kanad Basu

分类: cs.CR, cs.LG

发布日期: 2025-12-14 (更新: 2025-12-22)

💡 一句话要点

COBRA:针对状态空间模型的灾难性位翻转可靠性分析框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 状态空间模型 Mamba架构 位翻转攻击 硬件安全 可靠性分析

📋 核心要点

- Transformer模型在长序列建模中面临计算和内存成本的挑战,而状态空间模型(SSM)作为一种高效替代方案备受关注。

- 论文提出RAMBO框架,专门用于评估Mamba架构在硬件位翻转攻击下的脆弱性,旨在揭示SSM的可靠性问题。

- 实验表明,Mamba模型对位翻转攻击非常敏感,单个关键位的翻转可能导致模型性能急剧下降,甚至完全失效。

📝 摘要(中文)

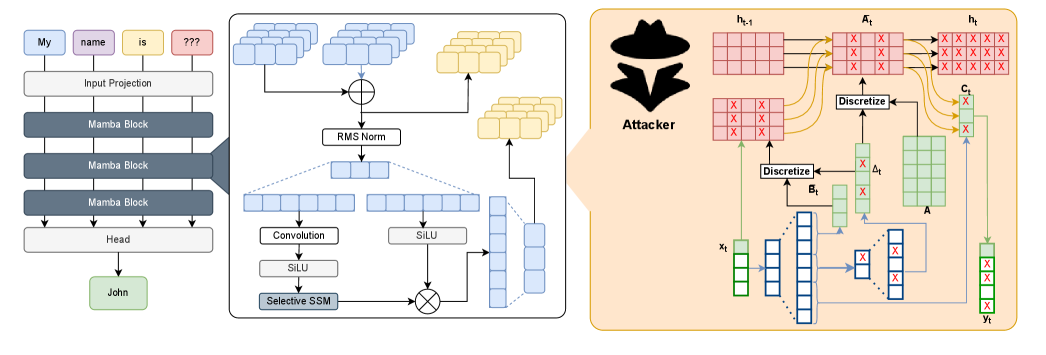

状态空间模型(SSM),以Mamba架构为例,已成为最先进的序列建模框架,在长上下文环境中提供线性时间复杂度的可扩展性和强大的性能。由于其效率、可扩展性和表达能力的独特结合,SSM已成为基于Transformer模型的引人注目的替代方案,后者受困于注意力机制的二次计算和内存成本。随着SSM越来越多地部署在实际应用中,评估它们对软件和硬件层面威胁的敏感性至关重要,以确保安全可靠的运行。在这些威胁中,硬件引起的位翻转攻击(BFA)通过内存故障破坏模型参数,从而损害模型准确性和功能完整性,构成特别严重的风险。为了研究这种脆弱性,我们引入了RAMBO,这是第一个专门为针对基于Mamba的架构而设计的BFA框架。通过在具有LAMBADA基准的Mamba-1.4b模型上进行的实验(一种完形填空式单词预测任务),我们证明了仅仅翻转一个关键位就可以灾难性地将准确率从74.64%降低到0%,并将困惑度从18.94增加到3.75 x 10^6。这些结果表明了SSM对对抗性扰动的显著脆弱性。

🔬 方法详解

问题定义:论文旨在解决状态空间模型(SSM),特别是Mamba架构,在硬件层面上面临的位翻转攻击(BFA)脆弱性问题。现有的深度学习模型安全性研究较少关注SSM,且缺乏专门针对SSM的BFA分析框架。现有方法无法有效评估和缓解SSM在实际部署中可能遇到的硬件安全风险。

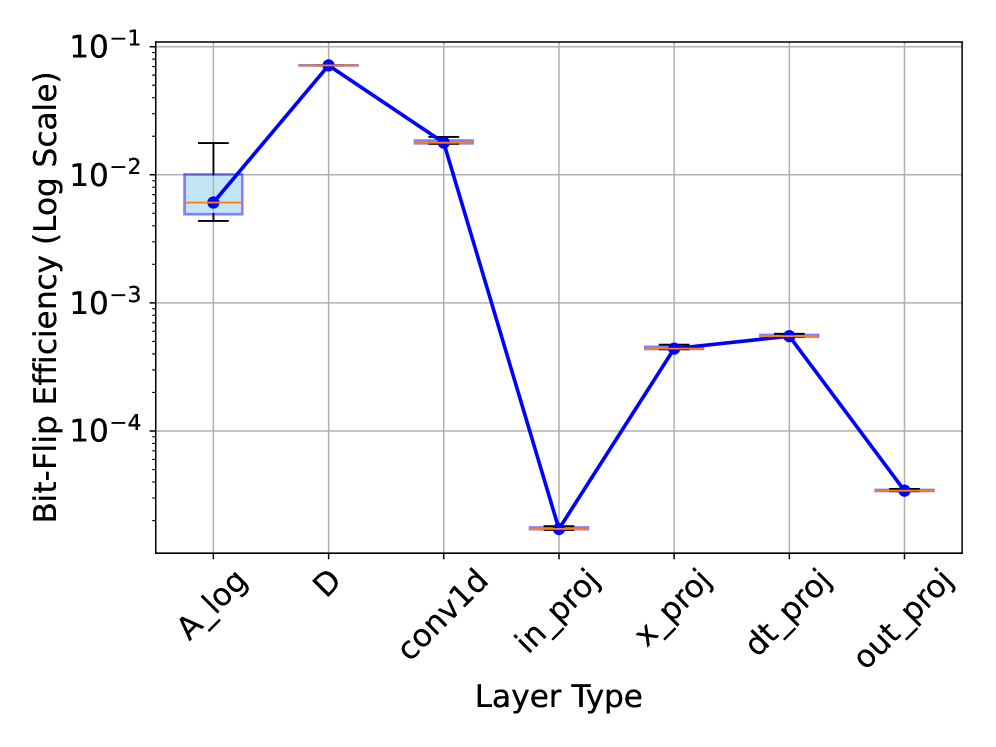

核心思路:论文的核心思路是通过模拟硬件故障,即位翻转,来评估SSM的鲁棒性。通过有针对性地翻转模型参数中的特定位,观察模型性能的变化,从而识别出对BFA最敏感的关键位。这种方法能够量化BFA对SSM的影响,并为后续的防御策略提供指导。

技术框架:论文提出的RAMBO框架主要包含以下几个阶段:1) 选择目标Mamba模型及其参数;2) 确定要进行位翻转的位置(模型参数的特定位);3) 执行位翻转操作,模拟硬件故障;4) 使用修改后的模型在LAMBADA基准数据集上进行评估,测量准确率和困惑度等指标;5) 分析实验结果,确定关键位和BFA对模型性能的影响。

关键创新:该论文最重要的技术创新点在于提出了RAMBO,这是第一个专门针对Mamba架构的BFA分析框架。与通用的BFA分析方法不同,RAMBO针对SSM的特殊结构进行了优化,能够更准确地评估SSM的硬件安全性。此外,该研究揭示了SSM对BFA的极高敏感性,这在之前的研究中未被充分认识。

关键设计:RAMBO框架的关键设计包括:1) 精确的位翻转模拟,确保能够准确模拟硬件故障;2) 使用LAMBADA基准数据集进行评估,该数据集能够有效衡量模型在长上下文建模方面的能力;3) 详细的性能指标测量,包括准确率和困惑度,能够全面反映BFA对模型性能的影响;4) 针对Mamba-1.4b模型进行实验,该模型是当前最先进的SSM之一。

🖼️ 关键图片

📊 实验亮点

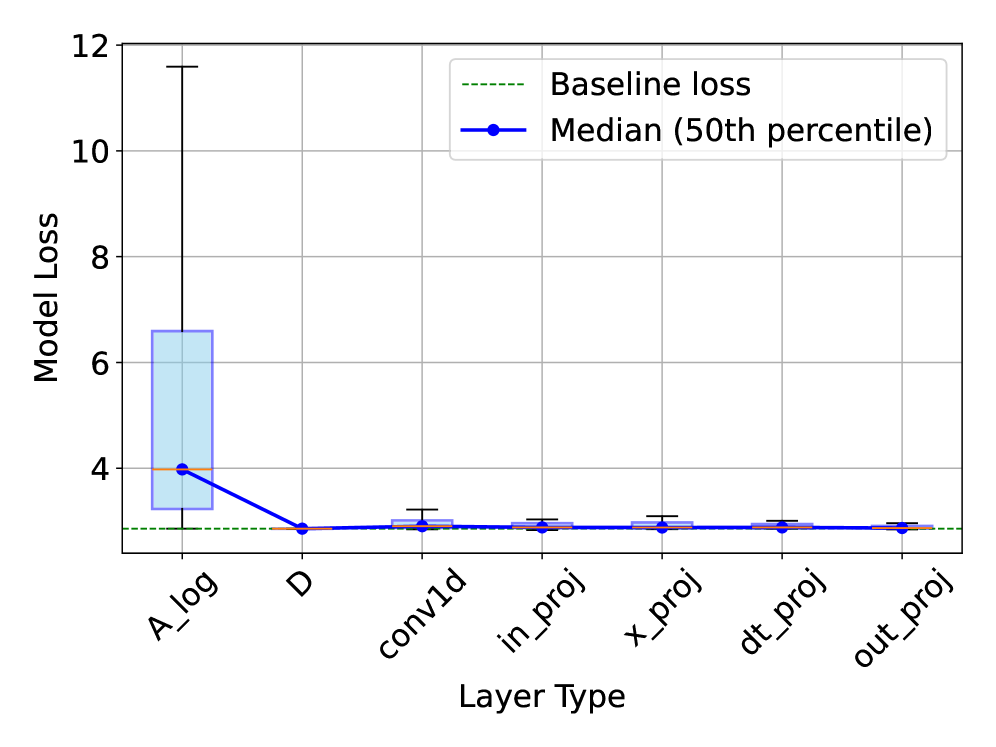

实验结果表明,在Mamba-1.4b模型上,仅仅翻转一个关键位,就可以导致模型在LAMBADA基准测试中的准确率从74.64%骤降至0%,困惑度从18.94飙升至3.75 x 10^6。这一结果突显了SSM对硬件位翻转攻击的极高敏感性,远超预期,为后续的安全性研究敲响了警钟。

🎯 应用场景

该研究成果可应用于评估和增强状态空间模型在边缘设备、自动驾驶系统、金融预测等领域的安全性。通过识别模型中的关键位,可以开发相应的硬件或软件防御机制,例如冗余备份、错误检测和纠正码等,从而提高SSM在实际应用中的可靠性和安全性,避免因硬件故障导致的模型失效和潜在风险。

📄 摘要(原文)

State-space models (SSMs), exemplified by the Mamba architecture, have recently emerged as state-of-the-art sequence-modeling frameworks, offering linear-time scalability together with strong performance in long-context settings. Owing to their unique combination of efficiency, scalability, and expressive capacity, SSMs have become compelling alternatives to transformer-based models, which suffer from the quadratic computational and memory costs of attention mechanisms. As SSMs are increasingly deployed in real-world applications, it is critical to assess their susceptibility to both software- and hardware-level threats to ensure secure and reliable operation. Among such threats, hardware-induced bit-flip attacks (BFAs) pose a particularly severe risk by corrupting model parameters through memory faults, thereby undermining model accuracy and functional integrity. To investigate this vulnerability, we introduce RAMBO, the first BFA framework specifically designed to target Mamba-based architectures. Through experiments on the Mamba-1.4b model with LAMBADA benchmark, a cloze-style word-prediction task, we demonstrate that flipping merely a single critical bit can catastrophically reduce accuracy from 74.64% to 0% and increase perplexity from 18.94 to 3.75 x 10^6. These results demonstrate the pronounced fragility of SSMs to adversarial perturbations.