Self-Motivated Growing Neural Network for Adaptive Architecture via Local Structural Plasticity

作者: Yiyang Jia, Chengxu Zhou

分类: cs.NE, cs.LG

发布日期: 2025-12-14

💡 一句话要点

提出自驱动增长神经网络SMGrNN,通过局部结构可塑性实现自适应架构

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 自驱动增长神经网络 结构可塑性 深度强化学习 自适应架构 局部学习

📋 核心要点

- 传统深度强化学习控制器缺乏结构可塑性,依赖全局误差信号,难以适应复杂任务。

- SMGrNN通过局部结构可塑性模块SPM,根据神经元激活和权重更新动态调整网络拓扑。

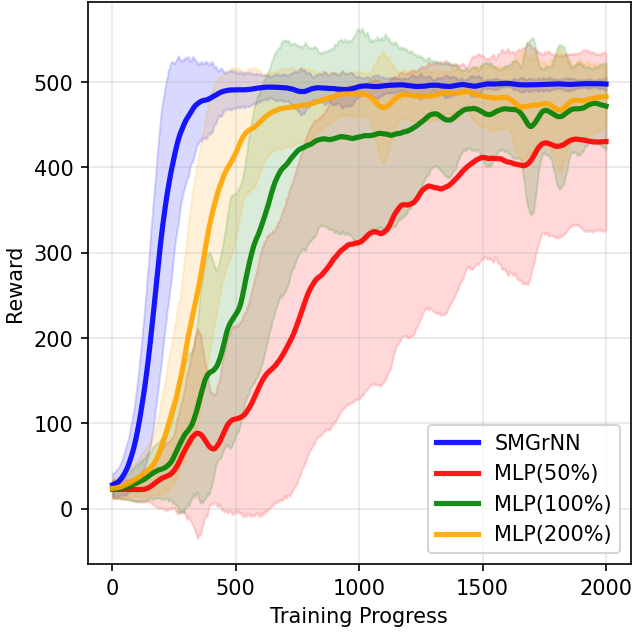

- 实验表明,SMGrNN在控制任务中表现出与MLP相当或更优的性能,且网络规模更适应任务需求。

📝 摘要(中文)

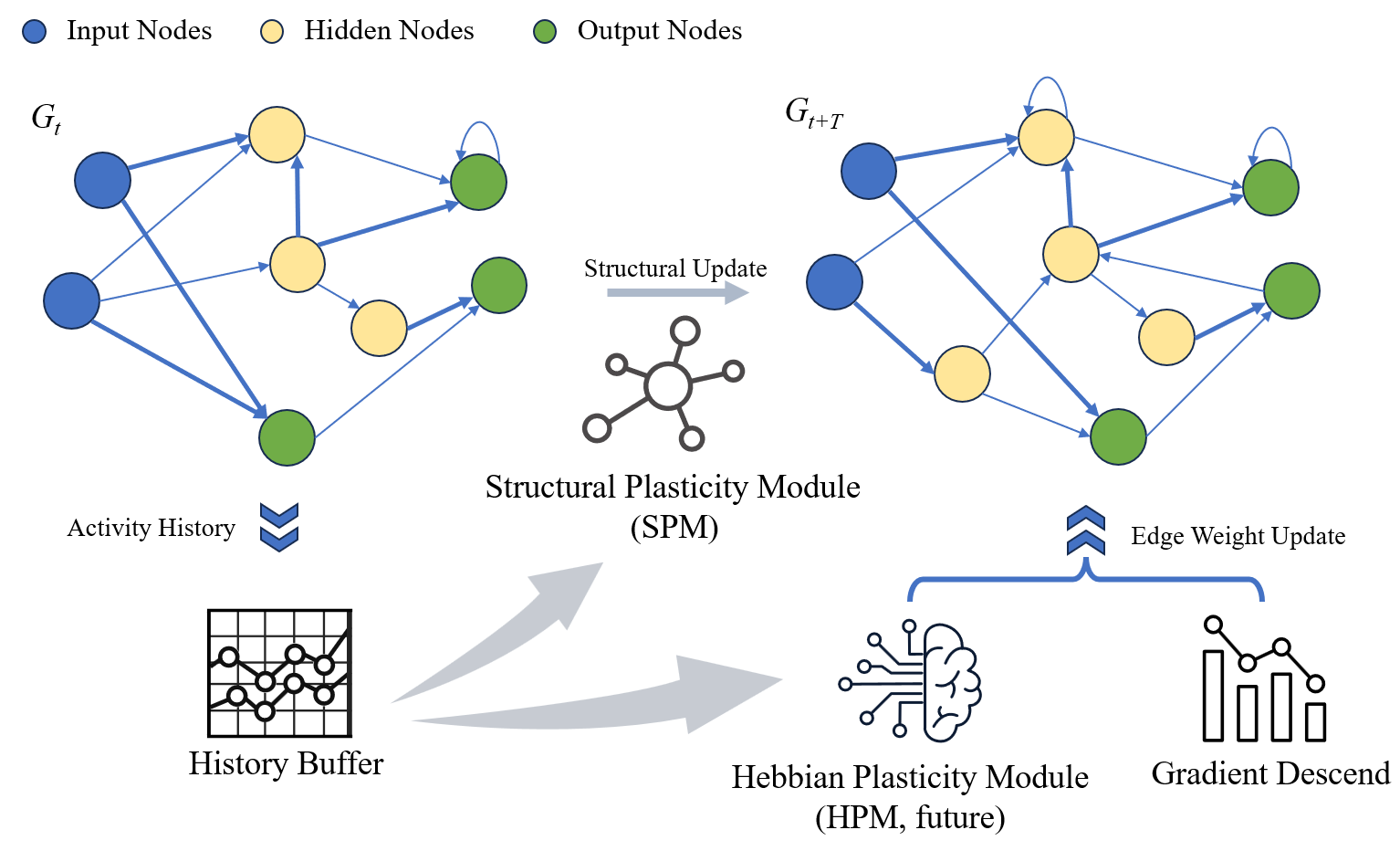

深度强化学习中的控制策略通常采用固定容量的多层感知机实现,并通过反向传播进行训练,这种方法缺乏结构可塑性,并且依赖于全局误差信号。本文提出了一种自驱动增长神经网络(SMGrNN),该控制器通过局部结构可塑性模块(SPM)在线演化其拓扑结构。SPM监测短时间窗口内的神经元激活和边权重的更新统计信息,并使用这些信号来触发神经元的插入和修剪,而突触权重则通过标准的基于梯度的优化器进行更新。这使得网络容量可以在学习过程中进行调节,而无需手动调整架构。通过策略蒸馏,在控制基准上评估了SMGrNN。与多层感知机基线相比,它实现了相似或更高的回报、更低的方差以及任务适当的网络大小。禁用增长和仅增长变体的消融研究隔离了结构可塑性的作用,表明自适应拓扑结构提高了奖励稳定性。SPM的局部和模块化设计使得未来可以集成赫布可塑性模块和尖峰时间依赖可塑性,从而使SMGrNN能够支持由局部规则驱动的人工和脉冲神经实现。

🔬 方法详解

问题定义:现有深度强化学习方法通常使用固定结构的多层感知机作为控制器,这种静态结构难以适应不同复杂度的任务,需要手动调整网络结构。此外,反向传播算法依赖全局误差信号,不利于生物可解释性和在线学习。

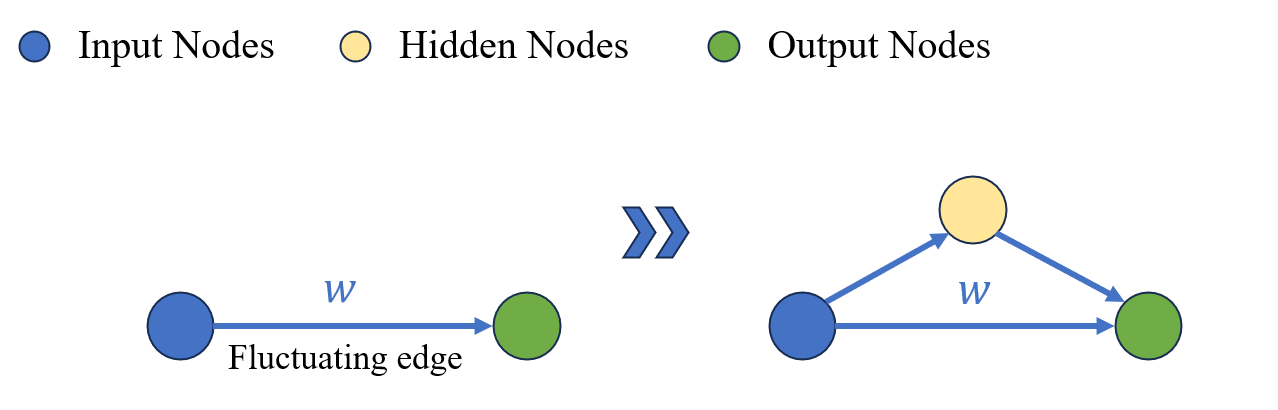

核心思路:SMGrNN的核心思路是通过局部结构可塑性模块(SPM)赋予网络动态调整拓扑结构的能力。SPM基于局部信息(神经元激活和权重更新)来决定何时插入或删除神经元,从而使网络能够根据任务需求自适应地增长或收缩。

技术框架:SMGrNN的整体架构包含一个标准的前馈神经网络和一个SPM。前馈神经网络负责执行控制策略,SPM则负责监控网络状态并调整其拓扑结构。具体流程如下:1. 前馈神经网络接收环境状态作为输入,输出动作。2. SPM监控神经元的激活和权重更新统计信息。3. SPM根据这些信息决定是否插入或删除神经元。4. 使用基于梯度的优化器更新网络权重。

关键创新:SMGrNN的关键创新在于SPM的局部结构可塑性机制。与传统的全局结构搜索方法不同,SPM仅依赖于局部信息进行决策,这使得网络能够更高效地适应环境变化,并且更具生物可解释性。此外,SPM的模块化设计使得未来可以方便地集成其他类型的可塑性机制,如赫布可塑性和尖峰时间依赖可塑性。

关键设计:SPM的关键设计包括:1. 神经元插入策略:当神经元的激活值持续较低时,插入新的神经元以增加网络的表达能力。2. 神经元删除策略:当神经元的权重更新幅度持续较小时,删除该神经元以降低网络的复杂度。3. 权重更新:使用标准的基于梯度的优化器(如Adam)更新网络权重。4. 激活函数:使用ReLU等非线性激活函数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SMGrNN在多个控制基准测试中取得了与多层感知机(MLP)相当或更优的性能,同时具有更低的方差和更适应任务的网络规模。消融实验证明,结构可塑性对提高奖励稳定性至关重要。例如,在某个控制任务中,SMGrNN实现了比MLP高5%的回报,并且网络规模减少了20%。

🎯 应用场景

SMGrNN具有广泛的应用前景,包括机器人控制、游戏AI、自适应控制系统等。其自适应结构特性使其能够更好地适应动态变化的环境,降低人工干预的需求。未来,SMGrNN有望应用于资源受限的边缘设备,实现高效的在线学习和推理。

📄 摘要(原文)

Control policies in deep reinforcement learning are often implemented with fixed-capacity multilayer perceptrons trained by backpropagation, which lack structural plasticity and depend on global error signals. This paper introduces the Self-Motivated Growing Neural Network (SMGrNN), a controller whose topology evolves online through a local Structural Plasticity Module (SPM). The SPM monitors neuron activations and edge-wise weight update statistics over short temporal windows and uses these signals to trigger neuron insertion and pruning, while synaptic weights are updated by a standard gradient-based optimizer. This allows network capacity to be regulated during learning without manual architectural tuning. SMGrNN is evaluated on control benchmarks via policy distillation. Compared with multilayer perceptron baselines, it achieves similar or higher returns, lower variance, and task-appropriate network sizes. Ablation studies with growth disabled and growth-only variants isolate the role of structural plasticity, showing that adaptive topology improves reward stability. The local and modular design of SPM enables future integration of a Hebbian plasticity module and spike-timing-dependent plasticity, so that SMGrNN can support both artificial and spiking neural implementations driven by local rules.