The Data Efficiency Frontier of Financial Foundation Models: Scaling Laws from Continued Pretraining

作者: Jesse Ponnock

分类: cs.LG, cs.CL

发布日期: 2025-12-13

备注: 8 pages, 4 figures, 1 table

💡 一句话要点

通过持续预训练提升金融领域大语言模型的数据效率,揭示模型规模扩展规律。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 金融领域 大语言模型 持续预训练 领域自适应 扩展规律

📋 核心要点

- 现有方法难以高效地将通用大语言模型应用于金融等专业领域,需要耗费大量资源进行完全重新训练。

- 本文提出通过领域自适应预训练(DAPT)方法,在通用模型基础上,利用金融领域数据进行持续预训练,实现高效的模型专业化。

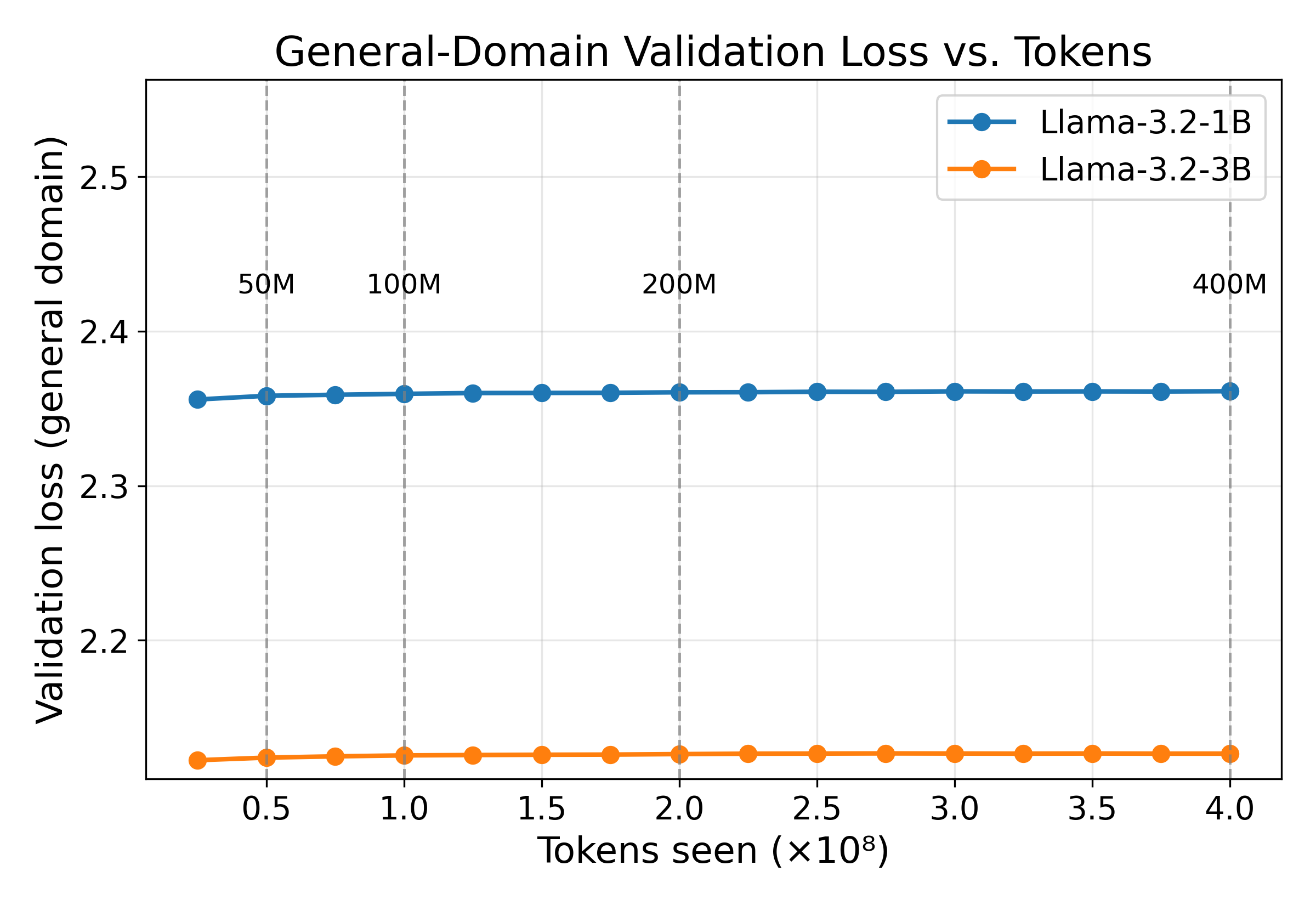

- 实验结果表明,该方法在金融领域验证损失上取得显著改善,且通用领域性能几乎不受影响,验证了其数据效率和领域适应性。

📝 摘要(中文)

本文研究了领域自适应预训练(DAPT)在金融领域大语言模型中的应用,旨在通过持续预训练,在不完全重新训练的情况下,为高价值领域定制大型语言模型。研究人员在包含4亿token的美国SEC文件中,对10亿和30亿参数的Llama-3.2模型进行了持续预训练,并在50M、100M、200M和400M token处设置了验证检查点。结果表明,两种模型在SEC领域的验证损失均得到持续改善,其中最大的收益出现在前2亿token内,之后收益递减。幂律拟合显示出较浅的指数,表明金融语言具有高度的规律性,并且在持续预训练下可以有效地学习。通用领域的验证损失在所有token预算中基本保持不变,表明漂移最小,没有灾难性遗忘的迹象。数据效率前沿进一步表明,两种模型都朝着改进的专业化方向发展,而混合领域退化可以忽略不计。这些发现为扩展金融基础模型提供了早期的经验指导,表明可以通过相对适度的token预算来实现有意义的领域自适应,并且在预计的数据需求下,更大的模型规模(7B-70B)仍然是可行的。

🔬 方法详解

问题定义:现有的大型语言模型在应用于特定领域(如金融)时,通常需要从头开始进行训练,这需要大量的领域数据和计算资源。领域自适应预训练旨在解决这个问题,即如何利用已有的通用语言模型,通过较少的领域数据,快速有效地将其适应到特定领域。

核心思路:本文的核心思路是利用持续预训练(Continued Pretraining)的方法,在通用语言模型(Llama-3.2)的基础上,使用金融领域的特定数据(美国SEC filings)进行进一步的训练。这种方法避免了从头开始训练的巨大成本,同时能够使模型更好地理解和处理金融领域的文本。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 选择预训练模型:选择Llama-3.2作为基础模型,分别使用1B和3B参数的版本。2) 构建金融领域数据集:收集美国SEC filings作为金融领域的数据集,总共包含4亿token。3) 持续预训练:使用金融领域数据集对Llama-3.2模型进行持续预训练,分别在50M、100M、200M和400M token处设置验证检查点。4) 评估:在金融领域和通用领域数据集上评估模型的性能,包括验证损失等指标。

关键创新:该研究的关键创新在于对金融领域大语言模型的数据效率进行了早期阶段的扩展规律分析。通过实验验证了持续预训练在金融领域的有效性,并揭示了金融语言具有高度的规律性,可以通过相对较少的数据进行有效学习。此外,该研究还表明,持续预训练对通用领域的性能影响很小,避免了灾难性遗忘。

关键设计:关键设计包括:1) 模型选择:选择Meta的Llama-3.2作为基础模型,因为它是一个开源的、性能良好的通用语言模型。2) 数据集构建:使用美国SEC filings作为金融领域的数据集,保证了数据的质量和相关性。3) 训练策略:使用标准的语言模型训练目标,并设置了多个验证检查点,以便观察模型在不同训练阶段的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过持续预训练,Llama-3.2模型在SEC领域的验证损失得到持续改善,尤其是在前2亿token内收益最大。幂律拟合显示金融语言具有高度规律性,易于学习。同时,通用领域验证损失几乎不变,表明模型未发生灾难性遗忘。数据效率前沿分析表明,模型在专业化提升的同时,混合领域性能退化可忽略不计。

🎯 应用场景

该研究成果可应用于金融领域的各种自然语言处理任务,如财务报告分析、风险评估、欺诈检测等。通过高效地构建金融领域大语言模型,可以提升相关应用的性能和效率,为金融机构和投资者提供更好的决策支持。未来,该方法可以推广到其他专业领域,加速领域知识与大语言模型的融合。

📄 摘要(原文)

Domain-adaptive pretraining (DAPT) offers a practical path to specializing large language models for high-value domains without full retraining. We conduct an early-stage scaling-law analysis of continued pretraining on U.S. SEC filings, training 1B and 3B-parameter Llama-3.2 models on a 400M-token financial corpus with validation checkpoints at 50M, 100M, 200M, and 400M tokens. Results show consistent improvements in SEC-domain validation loss for both models, with the largest gains occurring within the first 200M tokens and diminishing returns thereafter. Power-law fits reveal shallow exponents, indicating that financial language is highly regular and efficiently learnable under continued pretraining. General-domain validation loss remains effectively unchanged across all token budgets, suggesting minimal drift and no signs of catastrophic forgetting. A data-efficiency frontier further shows that both models move toward improved specialization with negligible mixed-domain degradation. Together, these findings provide early empirical guidance for scaling financial foundation models, suggesting that meaningful domain adaptation can be achieved with comparatively modest token budgets and that larger model scales (7B-70B) remain tractable under projected data requirements.