AdaGradSelect: An adaptive gradient-guided layer selection method for efficient fine-tuning of SLMs

作者: Anshul Kumar, Gagan Raj Gupta, Manisha Chawla

分类: cs.LG, cs.AI, cs.PF

发布日期: 2025-12-12

💡 一句话要点

AdaGradSelect:一种自适应梯度引导的层选择方法,用于高效微调小型语言模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 小型语言模型 参数高效微调 自适应层选择 梯度引导 Dirichlet采样

📋 核心要点

- 完全微调大型语言模型成本高昂,而现有参数高效微调方法可能限制模型性能。

- AdaGradSelect 提出一种自适应方法,根据梯度选择性地更新Transformer块,以提高微调效率。

- 实验表明,AdaGradSelect 在保证性能的同时,显著减少了训练时间和 GPU 内存占用。

📝 摘要(中文)

大型语言模型(LLMs)在许多NLP任务中表现出色,但完全微调它们成本高昂且需要大量内存。参数高效微调(PEFT)方法,如LoRA,通过向冻结的模型权重添加小的低秩更新来降低这种成本。然而,这些方法将训练限制在有限的子空间内,有时会降低性能。对于小型语言模型(SLMs),效率提升更为重要,我们引入了AdaGradSelect,这是一种自适应方法,它根据梯度选择要更新的Transformer块。早期观察表明,仅更新具有最高梯度范数的Transformer块可以实现接近完全微调的性能。基于这一洞察,AdaGradSelect自适应地选择要训练的块。它结合了基于Dirichlet的采样(取决于块过去被更新的频率)和epsilon-greedy探索策略。这使得该方法可以在早期训练中探索不同的块,并在后来的epoch中逐渐关注最重要的块。实验表明,AdaGradSelect训练速度提高了约12%,使用的GPU内存减少了35%,同时提供了非常接近完全微调的性能。在GSM8K数据集上,它在Qwen2.5-0.5B、LLaMA3.2-1B和Phi4-mini-3.8B等模型上,平均优于LoRA(rank 256)约3%。它还在MATH数据集上实现了类似的准确性。总的来说,AdaGradSelect提供了一种比传统微调方法更有效和资源高效的替代方案。

🔬 方法详解

问题定义:论文旨在解决小型语言模型(SLMs)微调过程中计算资源消耗大的问题。现有参数高效微调方法(如LoRA)虽然降低了计算成本,但可能限制模型的表达能力,导致性能下降。因此,如何在保证模型性能的前提下,进一步提高SLMs微调的效率是一个关键问题。

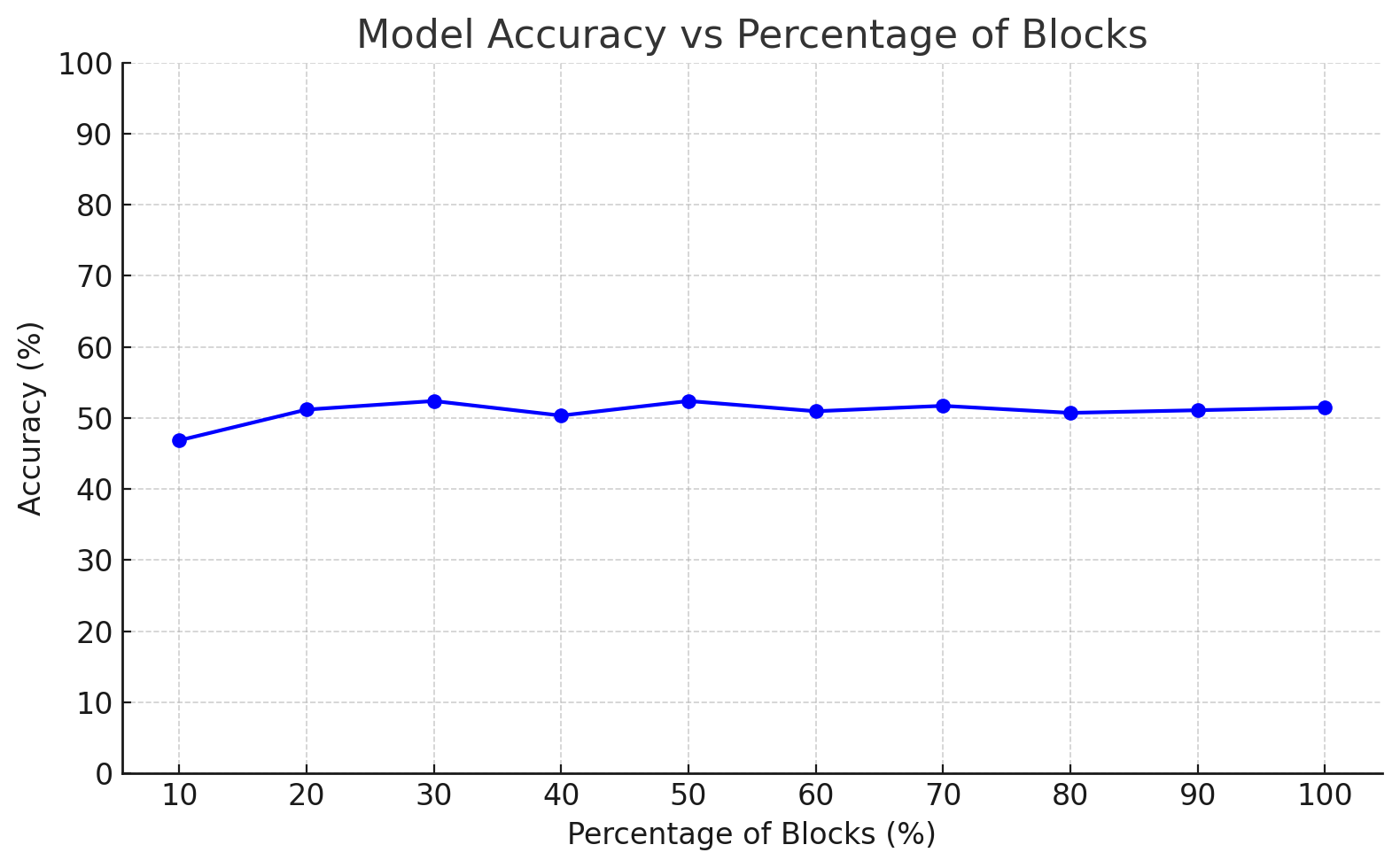

核心思路:AdaGradSelect的核心思路是自适应地选择Transformer块进行更新,而不是像LoRA那样更新所有块的低秩矩阵。通过观察发现,只有少数Transformer块对模型的性能提升起着关键作用。因此,AdaGradSelect根据梯度信息动态地选择需要更新的块,从而减少了计算量,提高了微调效率。

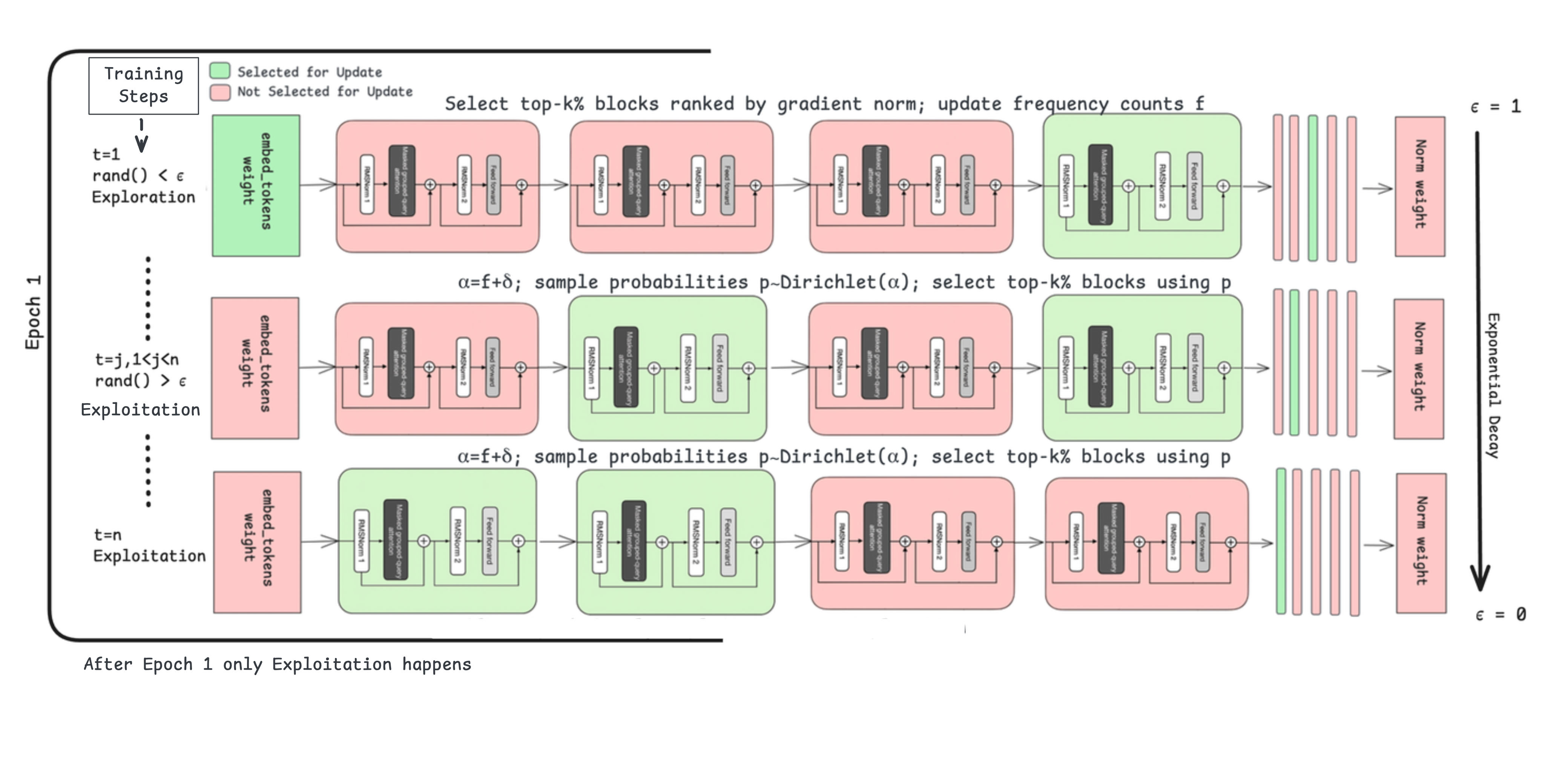

技术框架:AdaGradSelect的整体框架包括以下几个步骤:1. 计算每个Transformer块的梯度范数;2. 使用Dirichlet分布对Transformer块进行采样,采样概率与块的更新频率相关;3. 采用epsilon-greedy策略进行探索,以避免过早收敛到局部最优;4. 根据采样结果和探索策略,选择需要更新的Transformer块;5. 使用选择的Transformer块进行微调。

关键创新:AdaGradSelect的关键创新在于其自适应的层选择机制。与传统的参数高效微调方法相比,AdaGradSelect能够根据梯度信息动态地选择需要更新的层,从而更加高效地利用计算资源。此外,AdaGradSelect结合了Dirichlet采样和epsilon-greedy探索策略,能够在探索不同层的同时,逐渐关注最重要的层。

关键设计:AdaGradSelect的关键设计包括:1. 使用梯度范数作为选择Transformer块的依据;2. 使用Dirichlet分布对Transformer块进行采样,其中Dirichlet分布的参数与块的更新频率相关;3. 使用epsilon-greedy策略进行探索,其中epsilon是一个超参数,用于控制探索的程度。论文中没有明确给出损失函数和网络结构的具体细节,但可以推断其使用了标准的交叉熵损失函数和Transformer网络结构。

🖼️ 关键图片

📊 实验亮点

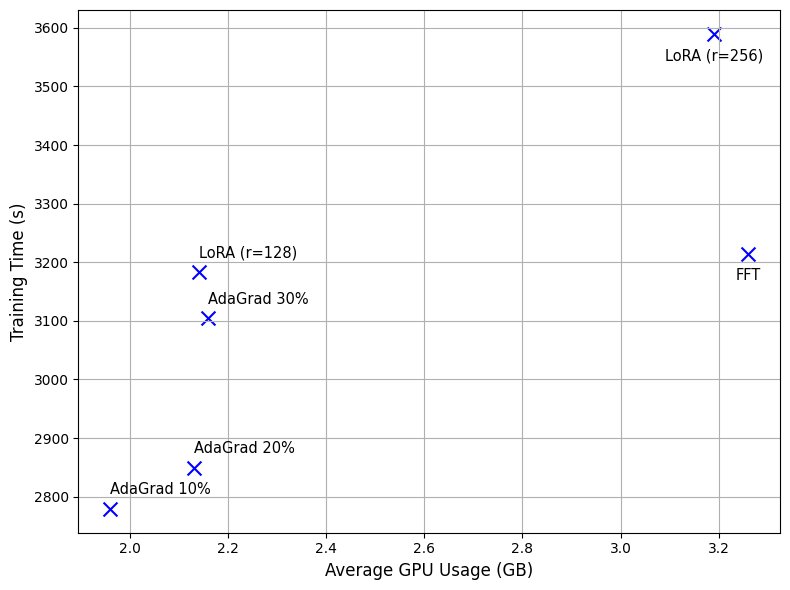

实验结果表明,AdaGradSelect 在 GSM8K 数据集上优于 LoRA(rank 256)约 3%,同时训练速度提高了约 12%,GPU 内存占用减少了 35%。在 MATH 数据集上,AdaGradSelect 也取得了与完全微调相似的准确率。这些结果表明,AdaGradSelect 是一种高效且有效的 SLMs 微调方法。

🎯 应用场景

AdaGradSelect 可应用于资源受限场景下的小型语言模型微调,例如移动设备、嵌入式系统等。该方法能够显著降低计算成本和内存占用,使得在这些设备上部署和微调SLMs成为可能。此外,该方法还可以应用于对微调效率有较高要求的场景,例如快速原型设计、在线学习等。

📄 摘要(原文)

Large Language Models (LLMs) can perform many NLP tasks well, but fully fine-tuning them is expensive and requires a lot of memory. Parameter-Efficient Fine-Tuning (PEFT) methods such as LoRA reduce this cost by adding small low-rank updates to frozen model weights. However, these methods restrict the training to a limited subspace, which can sometimes reduce performance. For Small Language Models (SLMs), where efficiency gains matter even more, we introduce AdaGradSelect, an adaptive method that selects which transformer blocks to update based on gradients. Early observations showed that updating only the transformer blocks with the highest gradient norms can achieve performance close to full fine-tuning. Building on this insight, AdaGradSelect adaptively chooses which blocks to train. It uses a combination of Dirichlet-based sampling, which depends on how frequently blocks were updated in the past, and an epsilon-greedy exploration strategy. This lets the method explore different blocks in early training and gradually focus on the most important ones in later epochs. Experiments show that AdaGradSelect trains about 12 percent faster and uses 35 percent less GPU memory while delivering performance very close to full fine-tuning. On the GSM8K dataset, it outperforms LoRA (rank 256) by about 3 percent on average across models such as Qwen2.5-0.5B, LLaMA3.2-1B, and Phi4-mini-3.8B. It also achieves similar accuracy on the MATH dataset. Overall, AdaGradSelect provides a more effective and resource-efficient alternative to traditional fine-tuning methods.