High-Dimensional Surrogate Modeling for Closed-Loop Learning of Neural-Network-Parameterized Model Predictive Control

作者: Sebastian Hirt, Valentinus Suwanto, Hendrik Alsmeier, Maik Pfefferkorn, Rolf Findeisen

分类: cs.LG, eess.SY

发布日期: 2025-12-12

备注: 7 pages, 2 figures

💡 一句话要点

提出贝叶斯神经网络作为代理模型以优化高维控制器参数

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 贝叶斯优化 神经网络 高维参数优化 闭环控制 模型预测控制 自动控制 机器人技术

📋 核心要点

- 现有的贝叶斯优化方法在高维控制器参数化中表现不佳,无法有效捕捉复杂的参数空间结构。

- 本文提出使用贝叶斯神经网络作为代理模型,旨在提高高维控制器参数的学习效率和性能。

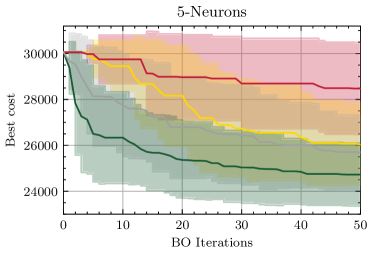

- 实验结果表明,贝叶斯神经网络代理模型在闭环成本收敛速度和可靠性上显著优于传统的高斯过程模型。

📝 摘要(中文)

从闭环数据中学习控制器参数已被证明可以提高闭环性能。贝叶斯优化作为一种广泛使用的黑箱学习方法,能够从少量实验中构建闭环性能的概率代理,并利用其选择有信息量的控制器参数。然而,在高维控制器参数化中,标准代理模型往往无法有效捕捉这些空间的结构。本文建议使用贝叶斯神经网络作为代理模型,以缓解这一限制。通过在倒立摆任务上的比较,发现贝叶斯神经网络代理模型能够实现更快、更可靠的闭环成本收敛,并成功优化数百维的参数化。无限宽的贝叶斯神经网络在超过一千个参数的设置中也保持了性能,而Matern核的高斯过程则迅速失效。这些结果表明,贝叶斯神经网络代理模型适合学习高维控制器参数化,并为基于学习的控制器设计中的代理模型选择提供了实用指导。

🔬 方法详解

问题定义:本文旨在解决在高维控制器参数化中,现有贝叶斯优化方法因标准代理模型无法有效捕捉参数空间结构而导致的性能不足问题。

核心思路:论文提出使用贝叶斯神经网络作为代理模型,以更好地适应高维参数空间的复杂性,从而提高闭环控制器的优化效率。

技术框架:研究首先通过少量实验数据构建贝叶斯神经网络代理模型,然后利用该模型进行控制器参数的选择与优化,最终评估闭环性能。

关键创新:最重要的创新在于引入贝叶斯神经网络作为代理模型,克服了传统高斯过程在高维空间中的局限性,显著提升了优化效果。

关键设计:在设计中,采用了有限宽和无限宽的贝叶斯神经网络结构,并通过实验验证了不同网络宽度对性能的影响,特别是在参数维度超过一千时的表现。

🖼️ 关键图片

📊 实验亮点

实验结果显示,贝叶斯神经网络代理模型在闭环成本收敛上比Matern核高斯过程快,且在数百维参数化中实现了成功优化。在参数维度超过一千时,无限宽贝叶斯神经网络仍保持良好性能,而传统方法则迅速失效。

🎯 应用场景

该研究的潜在应用领域包括自动控制系统、机器人技术和智能制造等领域,尤其是在需要高维控制器参数优化的场景中。通过提高控制器的学习效率和性能,能够显著提升系统的整体表现,具有重要的实际价值和未来影响。

📄 摘要(原文)

Learning controller parameters from closed-loop data has been shown to improve closed-loop performance. Bayesian optimization, a widely used black-box and sample-efficient learning method, constructs a probabilistic surrogate of the closed-loop performance from few experiments and uses it to select informative controller parameters. However, it typically struggles with dense high-dimensional controller parameterizations, as they may appear, for example, in tuning model predictive controllers, because standard surrogate models fail to capture the structure of such spaces. This work suggests that the use of Bayesian neural networks as surrogate models may help to mitigate this limitation. Through a comparison between Gaussian processes with Matern kernels, finite-width Bayesian neural networks, and infinite-width Bayesian neural networks on a cart-pole task, we find that Bayesian neural network surrogate models achieve faster and more reliable convergence of the closed-loop cost and enable successful optimization of parameterizations with hundreds of dimensions. Infinite-width Bayesian neural networks also maintain performance in settings with more than one thousand parameters, whereas Matern-kernel Gaussian processes rapidly lose effectiveness. These results indicate that Bayesian neural network surrogate models may be suitable for learning dense high-dimensional controller parameterizations and offer practical guidance for selecting surrogate models in learning-based controller design.