Encoder-Free Knowledge-Graph Reasoning with LLMs via Hyperdimensional Path Retrieval

作者: Yezi Liu, William Youngwoo Chung, Hanning Chen, Calvin Yeung, Mohsen Imani

分类: cs.LG, cs.CL

发布日期: 2025-12-10 (更新: 2026-02-02)

💡 一句话要点

PathHD:利用超维路径检索,实现无编码器的LLM知识图谱推理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱问答 大型语言模型 超维计算 路径检索 无编码器 可解释性 GHRR超向量

📋 核心要点

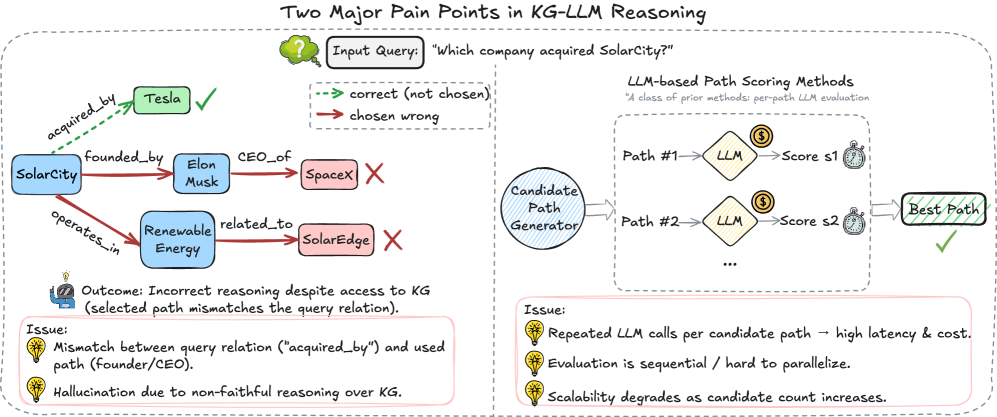

- 现有知识图谱问答系统依赖神经编码器或多次LLM重排序,导致高延迟、高GPU成本和决策过程不透明。

- PathHD利用超维计算表示关系路径,通过校准的相似度检索候选路径,并使用单次LLM调用进行裁决,无需编码器。

- 实验表明,PathHD在多个数据集上匹配或提升了Hits@1,同时显著降低了延迟和GPU内存占用,提升了效率和可解释性。

📝 摘要(中文)

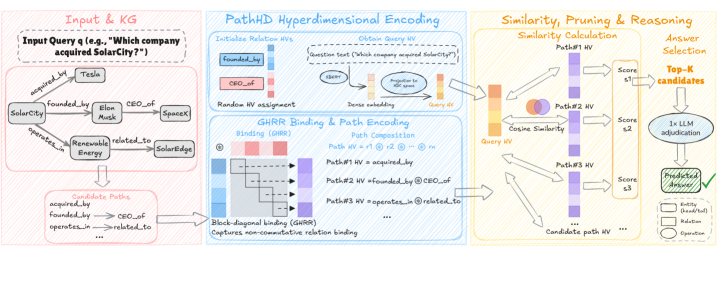

本文提出PathHD,一个无编码器的知识图谱推理框架,它将超维计算(HDC)与单次LLM调用相结合。给定查询,PathHD将关系路径表示为分块对角GHRR超向量,使用校准的分块余弦相似度检索候选路径,并通过Top-K剪枝,然后执行一次性LLM裁决,输出最终答案和可引用的支持路径。该设计得益于三个技术组件:(i)用于组合多跳路径的顺序敏感的非交换绑定算子,(ii)稳定超向量检索的鲁棒相似度校准,以及(iii)在避免每个路径LLM评分的同时保持可解释性的裁决阶段。在WebQSP、CWQ和GrailQA上,PathHD在Hits@1方面与强大的神经基线相匹配或有所改进,同时每个查询仅使用一次LLM调用,由于无编码器检索,端到端延迟降低了40-60%,GPU内存降低了3-5倍。总体而言,结果表明,精心设计的HDC路径表示可以作为高效且忠实的KG-LLM推理的有效基础,从而实现强大的准确性-效率-可解释性权衡。

🔬 方法详解

问题定义:论文旨在解决知识图谱问答(KG-QA)系统中,现有方法效率低、成本高、可解释性差的问题。传统的基于知识图谱的问答系统通常依赖于神经编码器对路径进行编码和排序,或者多次调用大型语言模型(LLM)进行重排序,这导致了较高的计算成本和延迟,同时也使得决策过程难以理解和审计。

核心思路:论文的核心思路是利用超维计算(Hyperdimensional Computing, HDC)来表示知识图谱中的关系路径,并使用高效的相似度检索方法来找到候选路径,最后通过一次LLM调用来裁决并生成答案。这种方法避免了使用神经编码器,从而降低了计算成本和延迟,同时提高了可解释性。

技术框架:PathHD框架主要包含三个阶段:1) 路径表示:将知识图谱中的关系路径表示为超维向量,具体使用分块对角GHRR(Generalized Holographic Reduced Representation)超向量。2) 路径检索:使用校准的分块余弦相似度来检索候选路径,并使用Top-K剪枝来减少计算量。3) LLM裁决:使用单次LLM调用来对候选路径进行裁决,并生成最终答案和支持路径。

关键创新:该论文的关键创新在于:1) 提出了一个无编码器的知识图谱推理框架,避免了使用神经编码器,从而降低了计算成本和延迟。2) 利用超维计算来表示关系路径,并使用高效的相似度检索方法来找到候选路径。3) 使用单次LLM调用来裁决并生成答案,从而提高了效率和可解释性。

关键设计:在路径表示方面,使用了顺序敏感的非交换绑定算子来组合多跳路径,保证了路径的顺序信息能够被保留。在相似度检索方面,使用了鲁棒的相似度校准来稳定超向量检索。在LLM裁决方面,避免了每个路径的LLM评分,而是使用单次LLM调用来对候选路径进行裁决,从而提高了效率。

🖼️ 关键图片

📊 实验亮点

PathHD在WebQSP、CWQ和GrailQA等数据集上进行了评估,实验结果表明,PathHD在Hits@1指标上与强大的神经基线相匹配或有所改进,同时端到端延迟降低了40-60%,GPU内存降低了3-5倍。这些结果表明,PathHD在准确性、效率和可解释性之间取得了良好的平衡。

🎯 应用场景

PathHD具有广泛的应用前景,可用于构建高效、低成本、可解释的知识图谱问答系统。例如,可以应用于智能客服、医疗诊断、金融风控等领域,帮助用户快速准确地获取知识图谱中的信息,并提供可信的推理依据。未来,该方法有望进一步扩展到其他知识密集型任务,如信息抽取、知识图谱补全等。

📄 摘要(原文)

Recent progress in large language models (LLMs) has made knowledge-grounded reasoning increasingly practical, yet KG-based QA systems often pay a steep price in efficiency and transparency. In typical pipelines, symbolic paths are scored by neural encoders or repeatedly re-ranked by multiple LLM calls, which inflates latency and GPU cost and makes the decision process hard to audit. We introduce PathHD, an encoder-free framework for knowledge-graph reasoning that couples hyperdimensional computing (HDC) with a single LLM call per query. Given a query, PathHD represents relation paths as block-diagonal GHRR hypervectors, retrieves candidate paths using a calibrated blockwise cosine similarity with Top-K pruning, and then performs a one-shot LLM adjudication that outputs the final answer together with supporting, citeable paths. The design is enabled by three technical components: (i) an order-sensitive, non-commutative binding operator for composing multi-hop paths, (ii) a robust similarity calibration that stabilizes hypervector retrieval, and (iii) an adjudication stage that preserves interpretability while avoiding per-path LLM scoring. Across WebQSP, CWQ, and GrailQA, PathHD matches or improves Hits@1 compared to strong neural baselines while using only one LLM call per query, reduces end-to-end latency by $40-60\%$, and lowers GPU memory by $3-5\times$ due to encoder-free retrieval. Overall, the results suggest that carefully engineered HDC path representations can serve as an effective substrate for efficient and faithful KG-LLM reasoning, achieving a strong accuracy-efficiency-interpretability trade-off.