Adaptive Normalization Mamba with Multi Scale Trend Decomposition and Patch MoE Encoding

作者: MinCheol Jeon

分类: cs.LG, cs.AI

发布日期: 2025-12-07

💡 一句话要点

提出AdaMamba,通过自适应归一化和多尺度趋势分解增强时间序列预测的稳定性和准确性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 时间序列预测 自适应归一化 多尺度分析 Mamba Transformer 专家混合 非平稳性 上下文建模

📋 核心要点

- 现实时间序列预测面临非平稳性、多尺度模式和分布偏移等挑战,导致模型性能下降。

- AdaMamba通过自适应归一化消除非平稳性,利用多尺度趋势提取和Mamba增强Transformer建模时序动态。

- 实验表明,AdaMamba在稳定性和准确性上优于传统Transformer基线,提升了预测可靠性。

📝 摘要(中文)

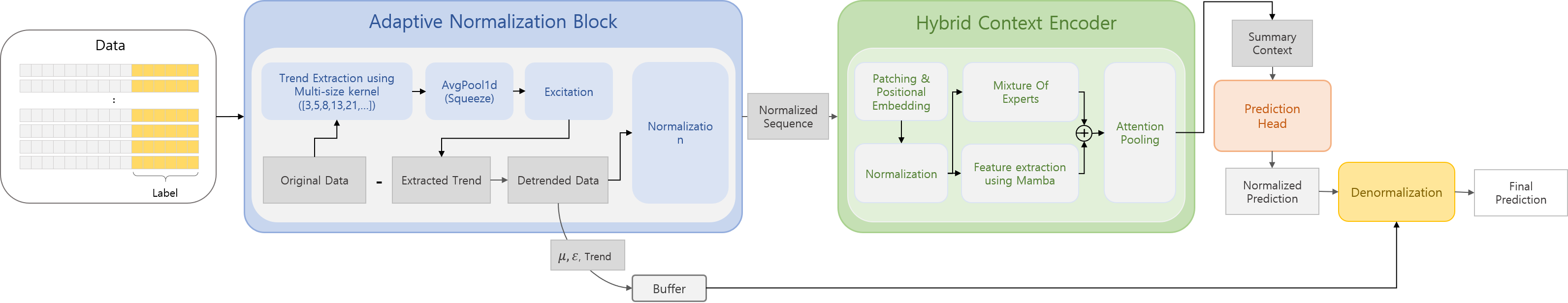

本研究提出了一种统一的预测架构AdaMamba,旨在解决现实环境中时间序列预测所面临的非平稳性、多尺度时间模式和分布偏移等挑战,这些挑战会降低模型的稳定性和准确性。AdaMamba首先采用自适应归一化块,通过多尺度卷积趋势提取和通道级重新校准来消除非平稳分量,从而实现一致的去趋势化和方差稳定化。然后,归一化后的序列由上下文编码器处理,该编码器结合了分块嵌入、位置编码和一个Mamba增强的Transformer层以及专家混合前馈模块,从而能够有效地建模长程依赖关系和局部时间动态。一个轻量级的预测头生成多步预测,并通过重新整合局部趋势的反归一化机制来重建输出,以确保在不同的时间条件下具有鲁棒性。AdaMamba提供了强大的表示能力和模块化可扩展性,支持确定性预测并与概率扩展兼容。其设计有效地缓解了协变量偏移,并提高了异构数据集上的预测可靠性。实验评估表明,AdaMamba的自适应归一化和专家增强的上下文建模相结合,在稳定性和准确性方面均优于传统的基于Transformer的基线。

🔬 方法详解

问题定义:现实世界的时间序列预测任务面临着数据非平稳性、多尺度时间模式以及分布偏移等问题,这些问题会导致现有模型,特别是基于Transformer的模型,在预测精度和稳定性方面表现不佳。现有方法难以有效处理这些挑战,尤其是在异构数据集上。

核心思路:AdaMamba的核心思路是通过自适应归一化来消除时间序列的非平稳性,并利用多尺度趋势分解来捕捉不同时间尺度上的模式。同时,采用Mamba增强的Transformer架构,结合专家混合模块,以高效地建模长程依赖关系和局部时间动态。这种设计旨在提高模型在各种时间条件下的鲁棒性和预测准确性。

技术框架:AdaMamba的整体架构包含以下几个主要模块:1) 自适应归一化块:通过多尺度卷积趋势提取和通道级重新校准来消除非平稳分量。2) 上下文编码器:结合分块嵌入、位置编码和Mamba增强的Transformer层,以及专家混合前馈模块。3) 预测头:生成多步预测。4) 反归一化机制:通过重新整合局部趋势来重建输出。

关键创新:AdaMamba的关键创新在于其自适应归一化方法和Mamba增强的Transformer架构。自适应归一化能够有效地消除非平稳性,而Mamba增强的Transformer则能够高效地建模长程依赖关系和局部时间动态。与传统的Transformer相比,AdaMamba在处理时间序列数据时更加高效和鲁棒。

关键设计:AdaMamba的关键设计包括:1) 多尺度卷积核的设计,用于提取不同时间尺度上的趋势。2) 通道级重新校准机制,用于调整不同通道的重要性。3) Mamba增强的Transformer层,利用Mamba的序列选择机制来提高建模效率。4) 专家混合前馈模块,用于增强模型的表示能力。具体的参数设置和损失函数细节在论文中未明确给出,属于未知信息。

🖼️ 关键图片

📊 实验亮点

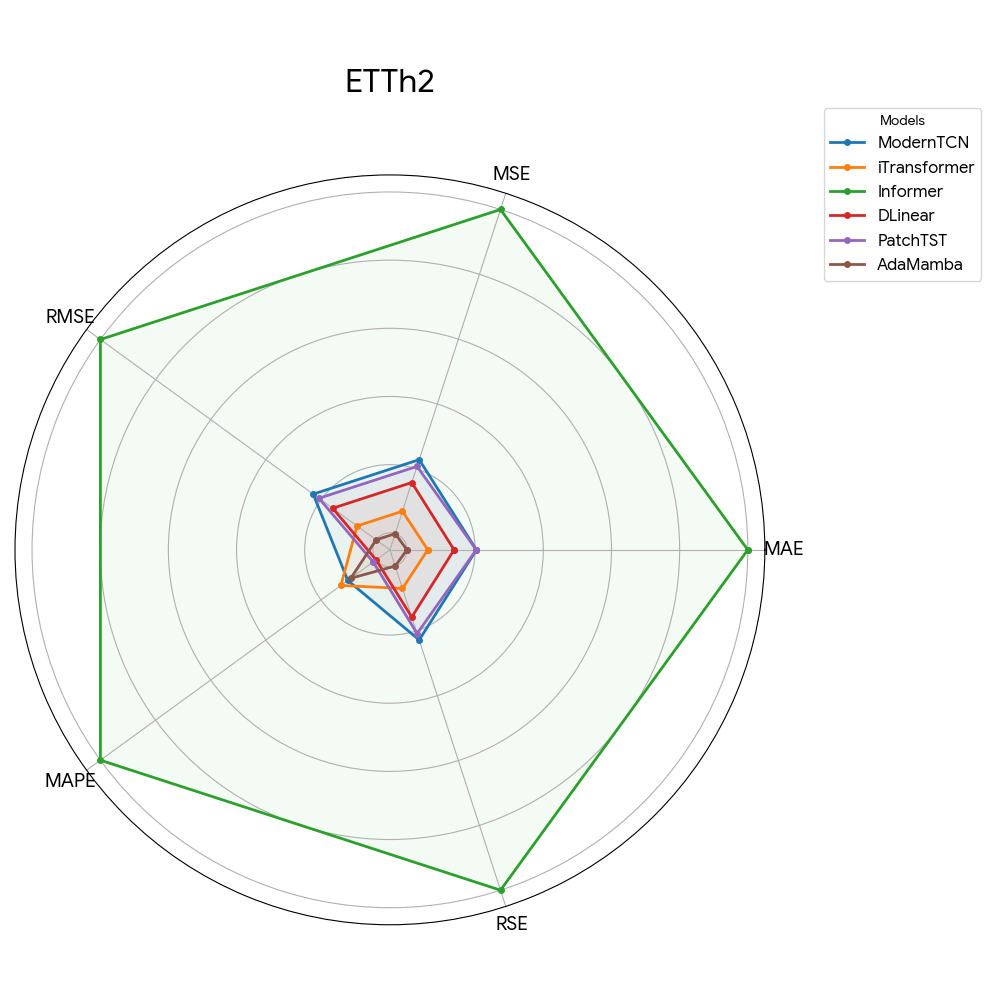

实验结果表明,AdaMamba在多个时间序列数据集上均取得了优于传统Transformer基线的性能。通过自适应归一化和专家增强的上下文建模,AdaMamba在稳定性和准确性方面均有显著提升。具体的性能数据和提升幅度在摘要中未明确给出,属于未知信息。

🎯 应用场景

AdaMamba可应用于金融时间序列预测、能源需求预测、供应链管理、医疗健康监测等领域。通过提高预测的准确性和稳定性,可以帮助企业和机构做出更明智的决策,优化资源配置,降低风险,并提升运营效率。该研究的成果对于推动时间序列预测技术在实际应用中的发展具有重要意义。

📄 摘要(原文)

Time series forecasting in real world environments faces significant challenges non stationarity, multi scale temporal patterns, and distributional shifts that degrade model stability and accuracy. This study propose AdaMamba, a unified forecasting architecture that integrates adaptive normalization, multi scale trend extraction, and contextual sequence modeling to address these challenges. AdaMamba begins with an Adaptive Normalization Block that removes non stationary components through multi scale convolutional trend extraction and channel wise recalibration, enabling consistent detrending and variance stabilization. The normalized sequence is then processed by a Context Encoder that combines patch wise embeddings, positional encoding, and a Mamba enhanced Transformer layer with a mixture of experts feed forward module, allowing efficient modeling of both long range dependencies and local temporal dynamics. A lightweight prediction head generates multi horizon forecasts, and a denormalization mechanism reconstructs outputs by reintegrating local trends to ensure robustness under varying temporal conditions. AdaMamba provides strong representational capacity with modular extensibility, supporting deterministic prediction and compatibility with probabilistic extensions. Its design effectively mitigates covariate shift and enhances predictive reliability across heterogeneous datasets. Experimental evaluations demonstrate that AdaMamba's combination of adaptive normalization and expert augmented contextual modeling yields consistent improvements in stability and accuracy over conventional Transformer based baselines.