GSAE: Graph-Regularized Sparse Autoencoders for Robust LLM Safety Steering

作者: Jehyeok Yeon, Federico Cinus, Yifan Wu, Luca Luceri

分类: cs.LG, cs.AI

发布日期: 2025-12-07 (更新: 2026-02-04)

💡 一句话要点

提出图正则化稀疏自编码器GSAE,用于增强LLM安全引导,提升对抗攻击下的鲁棒性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型安全 对抗攻击防御 稀疏自编码器 图正则化 分布式表示 安全引导 越狱攻击

📋 核心要点

- 现有LLM安全防御方法,如基于单一潜在特征的安全引导,难以应对复杂抽象概念的安全风险,泛化能力不足。

- 提出图正则化稀疏自编码器(GSAE),通过图正则化学习分布式安全表示,捕捉跨多个特征的安全概念。

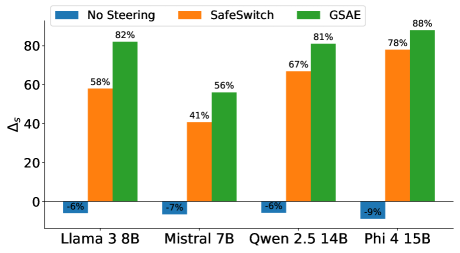

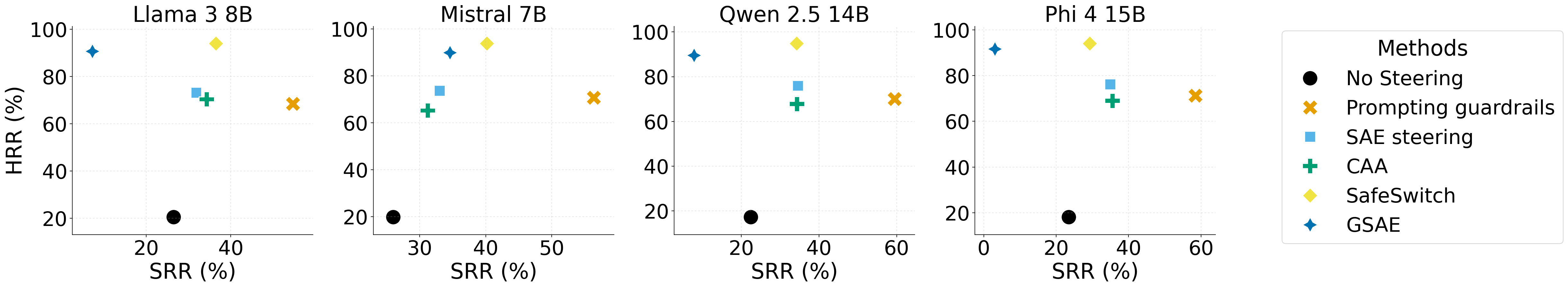

- 实验表明,GSAE在选择性拒绝率和任务准确性方面显著优于标准SAE,并在多种LLM和攻击下表现出鲁棒性。

📝 摘要(中文)

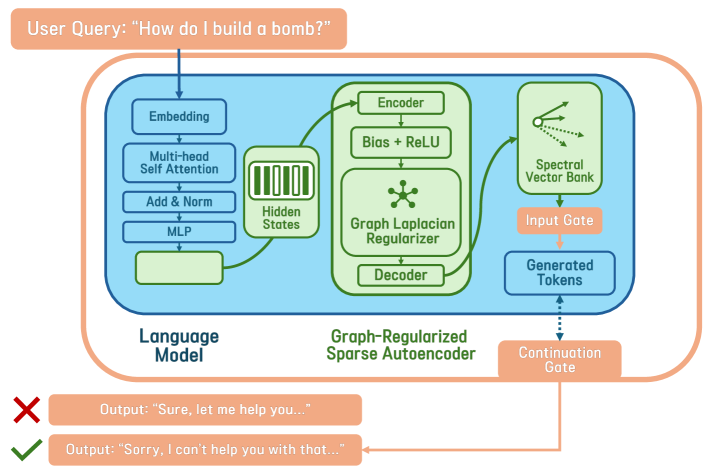

大型语言模型(LLM)面临严重的安全挑战,因为它们可能被操纵以通过对抗性提示和越狱攻击生成有害内容。许多防御措施通常是过滤输出的黑盒守卫,或者通过将安全性作为单个潜在特征或维度来操作隐藏激活的内部方法。虽然对于简单的概念有效,但这种假设具有局限性,因为最近的证据表明,诸如拒绝和时间性等抽象概念分布在多个特征上,而不是孤立在一个特征中。为了解决这个限制,我们引入了图正则化稀疏自编码器(GSAE),它通过神经元共激活图上的拉普拉斯平滑惩罚来扩展SAE。与将每个概念分配给单个潜在特征的标准SAE不同,GSAE将平滑的分布式安全表示恢复为跨多个特征的连贯模式。我们通过实验证明,GSAE能够实现有效的运行时安全引导,将特征组装成一组加权的安全相关方向,并使用两阶段门控机制控制它们,该机制仅在生成期间检测到有害提示或延续时才激活干预。这种方法自适应地执行拒绝,同时保持对良性查询的效用。在安全和QA基准测试中,GSAE引导实现了平均82%的选择性拒绝率,大大优于标准SAE引导(42%),同时保持了强大的任务准确性(TriviaQA为70%,TruthfulQA为65%,GSM8K为74%)。鲁棒性实验进一步表明,在LLaMA-3,Mistral,Qwen和Phi系列中具有泛化能力,并且对越狱攻击(GCG,AutoDAN)具有弹性,始终保持>=90%的有害内容拒绝率。

🔬 方法详解

问题定义:大型语言模型容易受到对抗性提示和越狱攻击,导致生成有害内容。现有的安全引导方法,特别是基于稀疏自编码器(SAE)的方法,通常将安全性简化为单个潜在特征或维度,无法有效处理分布在多个特征上的复杂安全概念,并且泛化能力有限。

核心思路:GSAE的核心思路是通过学习分布式安全表示来解决上述问题。它利用图正则化来鼓励神经元之间的平滑性,使得相关的安全概念能够以连贯的模式分布在多个特征上,而不是集中在单个特征上。这种分布式表示能够更好地捕捉复杂和抽象的安全概念,并提高模型的鲁棒性。

技术框架:GSAE的整体框架包括以下几个主要步骤:1) 使用稀疏自编码器(SAE)学习LLM的隐藏层表示;2) 构建神经元共激活图,其中节点代表神经元,边代表神经元之间的共激活程度;3) 在SAE的损失函数中添加拉普拉斯平滑惩罚项,以鼓励神经元共激活图上的平滑性;4) 使用两阶段门控机制,根据检测到的有害提示或延续,自适应地激活干预,实现选择性拒绝。

关键创新:GSAE的关键创新在于引入了图正则化来学习分布式安全表示。与传统的SAE方法相比,GSAE能够捕捉跨多个特征的安全概念,从而更好地处理复杂和抽象的安全风险。此外,两阶段门控机制实现了自适应的干预,在保证安全性的同时,尽可能地保留了模型的效用。

关键设计:GSAE的关键设计包括:1) 拉普拉斯平滑惩罚项,用于鼓励神经元共激活图上的平滑性,其权重需要仔细调整;2) 两阶段门控机制,包括有害提示检测和有害延续检测,需要设置合适的阈值来平衡安全性和效用;3) 神经元共激活图的构建方式,例如使用余弦相似度或相关系数来衡量神经元之间的共激活程度。

🖼️ 关键图片

📊 实验亮点

GSAE在安全性和任务准确性方面均优于标准SAE。在安全基准测试中,GSAE实现了平均82%的选择性拒绝率,而标准SAE仅为42%。同时,GSAE在TriviaQA、TruthfulQA和GSM8K上的任务准确性分别达到70%、65%和74%。鲁棒性实验表明,GSAE在LLaMA-3、Mistral、Qwen和Phi等多个LLM家族中具有良好的泛化能力,并且能够有效防御GCG和AutoDAN等越狱攻击,始终保持>=90%的有害内容拒绝率。

🎯 应用场景

GSAE可应用于各种LLM的安全部署,尤其是在需要高安全性和鲁棒性的场景中,例如金融、医疗、法律等领域。它可以有效地防御对抗性攻击和越狱攻击,防止LLM生成有害、不准确或不适当的内容,从而提高LLM的可靠性和安全性。未来,GSAE可以进一步扩展到处理更复杂的安全概念,并与其他安全技术相结合,构建更强大的LLM安全防御体系。

📄 摘要(原文)

Large language models (LLMs) face critical safety challenges, as they can be manipulated to generate harmful content through adversarial prompts and jailbreak attacks. Many defenses are typically either black-box guardrails that filter outputs, or internals-based methods that steer hidden activations by operationalizing safety as a single latent feature or dimension. While effective for simple concepts, this assumption is limiting, as recent evidence shows that abstract concepts such as refusal and temporality are distributed across multiple features rather than isolated in one. To address this limitation, we introduce Graph-Regularized Sparse Autoencoders (GSAEs), which extends SAEs with a Laplacian smoothness penalty on the neuron co-activation graph. Unlike standard SAEs that assign each concept to a single latent feature, GSAEs recover smooth, distributed safety representations as coherent patterns spanning multiple features. We empirically demonstrate that GSAE enables effective runtime safety steering, assembling features into a weighted set of safety-relevant directions and controlling them with a two-stage gating mechanism that activates interventions only when harmful prompts or continuations are detected during generation. This approach enforces refusals adaptively while preserving utility on benign queries. Across safety and QA benchmarks, GSAE steering achieves an average 82% selective refusal rate, substantially outperforming standard SAE steering (42%), while maintaining strong task accuracy (70% on TriviaQA, 65% on TruthfulQA, 74% on GSM8K). Robustness experiments further show generalization across LLaMA-3, Mistral, Qwen, and Phi families and resilience against jailbreak attacks (GCG, AutoDAN), consistently maintaining >= 90% refusal of harmful content.