A Latent Variable Framework for Scaling Laws in Large Language Models

作者: Peiyao Cai, Chengyu Cui, Felipe Maia Polo, Seamus Somerstep, Leshem Choshen, Mikhail Yurochkin, Moulinath Banerjee, Yuekai Sun, Kean Ming Tan, Gongjun Xu

分类: stat.AP, cs.LG

发布日期: 2025-12-06

💡 一句话要点

提出基于隐变量建模的框架,解决大语言模型异构性下的性能评估与泛化问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 缩放定律 隐变量模型 性能评估 模型异构性

📋 核心要点

- 现有LLM缩放定律研究难以有效处理不同架构和训练策略带来的模型异构性,导致性能评估不准确。

- 论文提出基于隐变量的模型框架,将每个LLM家族与一个隐变量关联,捕捉其潜在的共同特征。

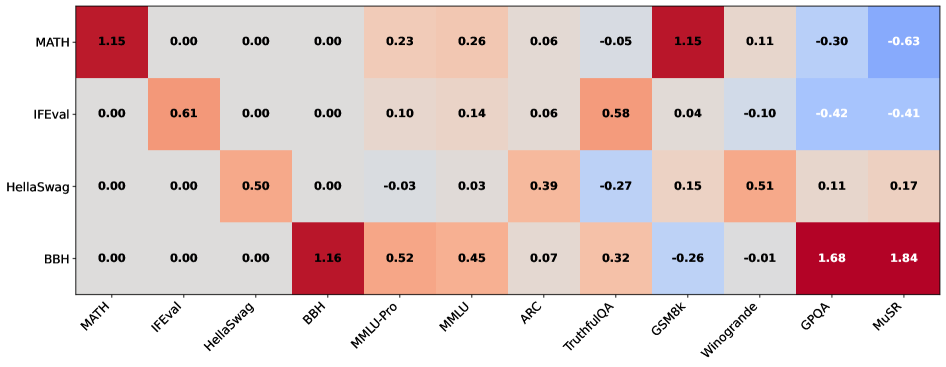

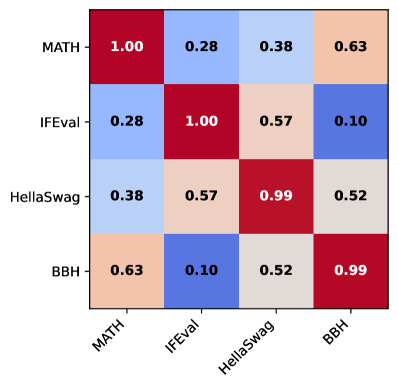

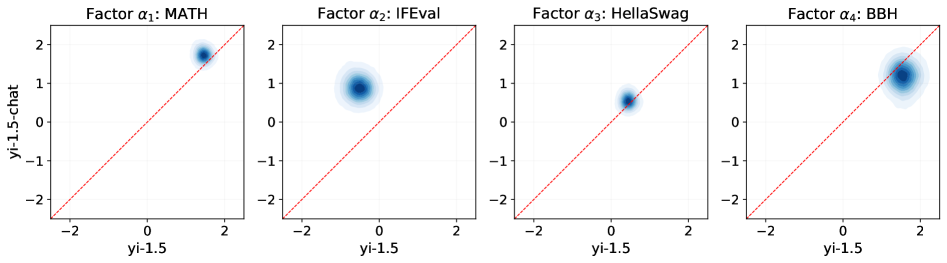

- 通过在Open LLM Leaderboard的12个基准测试上的实验,验证了该方法在性能评估和泛化能力上的有效性。

📝 摘要(中文)

本文提出了一个基于隐变量建模的统计框架,用于研究大型语言模型(LLM)的缩放定律。动机来源于大量具有不同架构和训练策略的新LLM家族的快速涌现,以及在越来越多的基准测试上的评估。这种异构性使得单一的全局缩放曲线不足以捕捉跨家族和基准测试的性能变化。为了解决这个问题,我们提出了一个隐变量建模框架,其中每个LLM家族都与一个隐变量相关联,该隐变量捕捉了该家族中共同的潜在特征。LLM在不同基准测试上的性能由其潜在技能驱动,这些技能由隐变量和模型自身的可观察特征共同决定。我们为这个隐变量模型开发了一个估计程序,并建立了它的统计特性。我们还设计了高效的数值算法,支持估计和各种下游任务。在经验上,我们在Open LLM Leaderboard(v1/v2)中的12个广泛使用的基准测试上评估了该方法。

🔬 方法详解

问题定义:现有的大语言模型缩放定律研究通常假设一个全局的缩放曲线,忽略了不同模型家族之间架构和训练策略的差异。这种异构性导致单一缩放曲线无法准确捕捉不同模型在不同基准测试上的性能表现,限制了模型性能的预测和泛化能力。现有方法难以有效处理这种模型异构性,导致性能评估和预测的偏差。

核心思路:论文的核心思路是将每个LLM家族与一个隐变量关联起来,该隐变量代表了该家族模型共有的、未被直接观察到的潜在特征。模型的性能不仅取决于其自身的可观察特征(如模型大小、训练数据量),还受到其所属家族的隐变量的影响。通过学习这些隐变量,可以更好地理解不同模型家族之间的差异,并更准确地预测模型在不同任务上的性能。

技术框架:该框架包含以下主要模块:1) 数据收集:收集不同LLM家族在多个基准测试上的性能数据;2) 隐变量建模:构建一个隐变量模型,将每个LLM家族与一个隐变量关联,并建立模型性能与隐变量、可观察特征之间的关系;3) 参数估计:开发高效的数值算法,估计隐变量模型的参数,包括隐变量的值、模型特征的权重等;4) 性能预测:利用估计的隐变量模型,预测LLM在未见过的基准测试上的性能。

关键创新:该论文最重要的技术创新在于引入了隐变量来建模LLM家族之间的异构性。与传统的全局缩放曲线方法相比,该方法能够更好地捕捉不同模型家族之间的差异,从而提高性能预测的准确性。此外,该方法还提供了一种理解不同模型家族之间潜在差异的工具,有助于指导模型设计和训练。

关键设计:论文中关键的设计包括:1) 隐变量模型的具体形式,例如可以使用高斯过程或神经网络来建模隐变量与模型性能之间的关系;2) 参数估计方法,例如可以使用期望最大化(EM)算法或变分推断来估计隐变量模型的参数;3) 正则化策略,为了防止过拟合,可以引入正则化项来约束隐变量的值或模型参数。

🖼️ 关键图片

📊 实验亮点

该论文在Open LLM Leaderboard (v1/v2) 的12个广泛使用的基准测试上进行了实验验证。实验结果表明,所提出的基于隐变量的建模框架能够更准确地预测LLM在不同基准测试上的性能,优于传统的全局缩放曲线方法。具体的性能提升数据未知,但摘要强调了该方法在捕捉模型异构性方面的优势。

🎯 应用场景

该研究成果可应用于大语言模型的性能评估、模型选择和模型设计。通过学习不同模型家族的隐变量,可以更准确地预测模型在不同任务上的性能,从而帮助用户选择最适合其需求的模型。此外,该方法还可以用于指导模型设计,例如通过分析不同模型家族的隐变量,可以发现影响模型性能的关键因素,从而指导模型架构的改进。

📄 摘要(原文)

We propose a statistical framework built on latent variable modeling for scaling laws of large language models (LLMs). Our work is motivated by the rapid emergence of numerous new LLM families with distinct architectures and training strategies, evaluated on an increasing number of benchmarks. This heterogeneity makes a single global scaling curve inadequate for capturing how performance varies across families and benchmarks. To address this, we propose a latent variable modeling framework in which each LLM family is associated with a latent variable that captures the common underlying features in that family. An LLM's performance on different benchmarks is then driven by its latent skills, which are jointly determined by the latent variable and the model's own observable features. We develop an estimation procedure for this latent variable model and establish its statistical properties. We also design efficient numerical algorithms that support estimation and various downstream tasks. Empirically, we evaluate the approach on 12 widely used benchmarks from the Open LLM Leaderboard (v1/v2).