RevoNAD: Reflective Evolutionary Exploration for Neural Architecture Design

作者: Gyusam Chang, Jeongyoon Yoon, Shin han yi, JaeHyeok Lee, Sujin Jang, Sangpil Kim

分类: cs.LG

发布日期: 2025-12-05

💡 一句话要点

RevoNAD:一种反射式进化探索的神经架构设计方法,提升架构搜索的可靠性和部署性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经架构设计 大型语言模型 进化算法 反射式学习 架构搜索

📋 核心要点

- 现有基于LLM的神经架构设计方法,由于token级别设计的离散性和不可微性,难以有效利用反馈信息指导架构改进。

- RevoNAD通过反射式进化协调器,桥接了LLM推理与反馈对齐的架构搜索,从而实现更有效的架构设计。

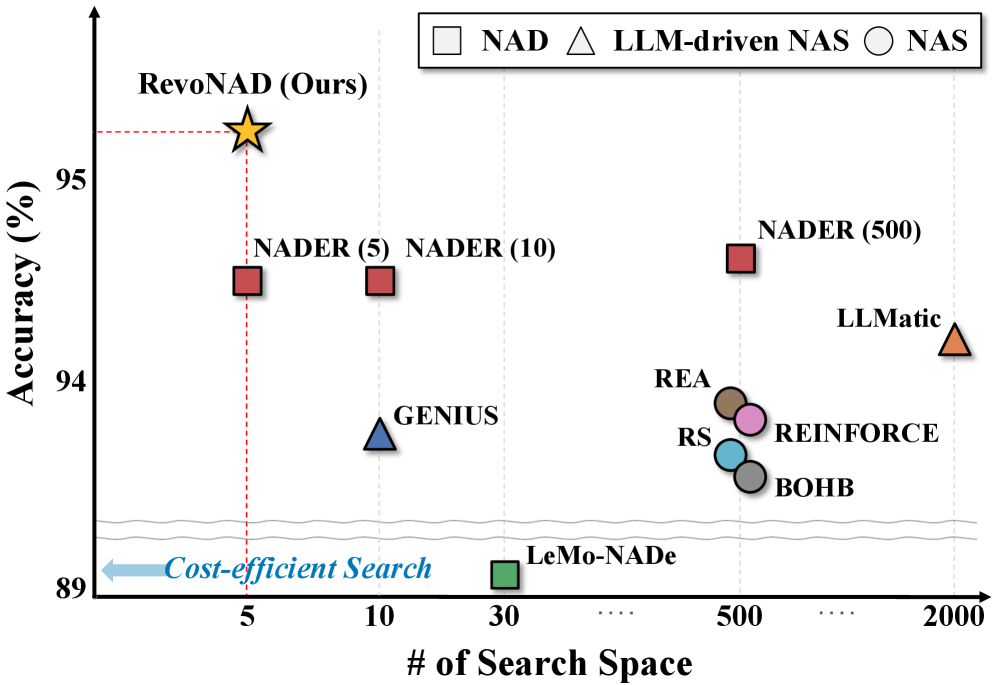

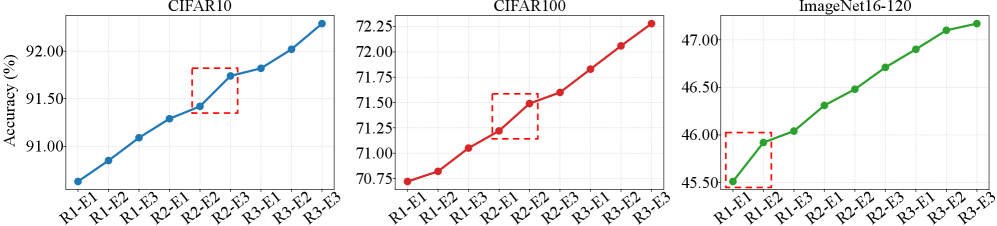

- RevoNAD在多个数据集上取得了SOTA性能,并通过消融实验和迁移学习验证了其有效性和可靠性。

📝 摘要(中文)

利用大型语言模型(LLM)的最新进展推动了神经架构设计(NAD)系统的发展,使其能够生成不受手动预定义搜索空间限制的新架构。然而,LLM驱动的生成仍然具有挑战性:token级别的设计循环是离散且不可微的,阻碍了反馈平滑地指导架构改进。因此,这些方法通常会遭受模式崩溃,陷入冗余结构,或者在建设性推理没有充分依据时漂移到不可行的设计。我们引入了RevoNAD,一种反射式进化协调器,它有效地将基于LLM的推理与反馈对齐的架构搜索连接起来。首先,RevoNAD提出了一种多轮多专家共识,将孤立的设计规则转化为有意义的架构线索。然后,自适应反射探索利用奖励方差来调整探索程度;当反馈不确定时进行探索,当达到稳定性时进行细化。最后,Pareto引导的进化选择有效地促进了联合优化精度、效率、延迟、置信度和结构多样性的架构。在CIFAR10、CIFAR100、ImageNet16-120、COCO-5K和Cityscape上,RevoNAD实现了最先进的性能。消融和迁移研究进一步验证了RevoNAD在实现实际可靠且可部署的神经架构设计方面的有效性。

🔬 方法详解

问题定义:现有基于大型语言模型(LLM)的神经架构设计(NAD)方法,在生成新架构时,由于token级别的设计循环是离散且不可微的,导致难以利用反馈信息平滑地指导架构改进。这使得这些方法容易陷入模式崩溃,产生冗余结构,或者漂移到不可行的设计。

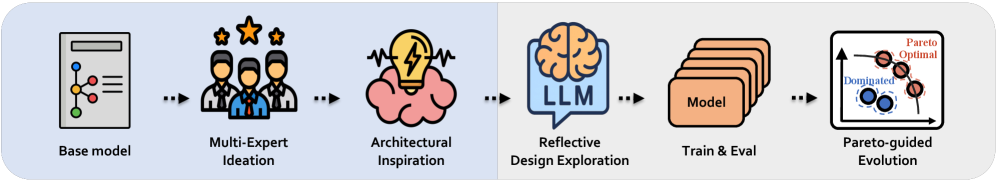

核心思路:RevoNAD的核心思路是引入一个反射式进化协调器,将基于LLM的推理与反馈对齐的架构搜索连接起来。通过多轮多专家共识提取有意义的架构线索,并利用自适应反射探索调整探索程度,最终通过Pareto引导的进化选择优化架构。

技术框架:RevoNAD的整体框架包含三个主要模块:1) 多轮多专家共识:将孤立的设计规则转化为有意义的架构线索。2) 自适应反射探索:根据奖励方差调整探索程度,在不确定时探索,稳定时细化。3) Pareto引导的进化选择:促进联合优化精度、效率、延迟、置信度和结构多样性的架构。

关键创新:RevoNAD的关键创新在于其反射式进化协调器,它能够有效地利用反馈信息指导架构搜索,避免了传统LLM驱动方法中的模式崩溃和漂移问题。自适应反射探索机制能够根据反馈的置信度动态调整探索策略,提高了搜索效率。

关键设计:多轮多专家共识模块的具体实现方式(例如,专家模型的选择、共识算法的设计),自适应反射探索中奖励方差的计算方法和探索程度的调整策略,以及Pareto引导的进化选择中使用的具体指标和选择算法,这些都是影响RevoNAD性能的关键设计细节。论文中可能还涉及到特定的损失函数设计,以鼓励架构的多样性和可行性。

🖼️ 关键图片

📊 实验亮点

RevoNAD在CIFAR10、CIFAR100、ImageNet16-120、COCO-5K和Cityscape等多个数据集上取得了最先进的性能(SOTA)。消融实验验证了各个模块的有效性,迁移学习实验表明RevoNAD具有良好的泛化能力,能够设计出实际可靠且可部署的神经架构。

🎯 应用场景

RevoNAD具有广泛的应用前景,可用于自动设计各种神经网络架构,从而加速深度学习模型的开发和部署。它可以应用于图像识别、自然语言处理、语音识别等多个领域,并能够根据特定任务的需求,自动优化模型的性能、效率和延迟,降低人工设计成本。

📄 摘要(原文)

Recent progress in leveraging large language models (LLMs) has enabled Neural Architecture Design (NAD) systems to generate new architecture not limited from manually predefined search space. Nevertheless, LLM-driven generation remains challenging: the token-level design loop is discrete and non-differentiable, preventing feedback from smoothly guiding architectural improvement. These methods, in turn, commonly suffer from mode collapse into redundant structures or drift toward infeasible designs when constructive reasoning is not well grounded. We introduce RevoNAD, a reflective evolutionary orchestrator that effectively bridges LLM-based reasoning with feedback-aligned architectural search. First, RevoNAD presents a Multi-round Multi-expert Consensus to transfer isolated design rules into meaningful architectural clues. Then, Adaptive Reflective Exploration adjusts the degree of exploration leveraging reward variance; it explores when feedback is uncertain and refines when stability is reached. Finally, Pareto-guided Evolutionary Selection effectively promotes architectures that jointly optimize accuracy, efficiency, latency, confidence, and structural diversity. Across CIFAR10, CIFAR100, ImageNet16-120, COCO-5K, and Cityscape, RevoNAD achieves state-of-the-art performance. Ablation and transfer studies further validate the effectiveness of RevoNAD in allowing practically reliable, and deployable neural architecture design.