Hierarchical Reinforcement Learning for the Dynamic VNE with Alternatives Problem

作者: Ali Al Housseini, Cristina Rottondi, Omran Ayoub

分类: cs.NI, cs.LG, cs.MA

发布日期: 2025-12-04

备注: Submitted to IEEE International Conference on Machine Learning for Communication and Networking (ICMLCN) 2026

💡 一句话要点

提出HRL-VNEAP,利用分层强化学习解决具有替代拓扑的动态VNE问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 虚拟网络嵌入 网络切片 分层强化学习 动态资源分配 替代拓扑

📋 核心要点

- 传统VNE方法假设VNR拓扑固定,忽略了VNR的可塑性,导致资源利用率受限。

- HRL-VNEAP采用分层强化学习,高层策略选择拓扑,低层策略进行嵌入,从而优化资源分配。

- 实验表明,HRL-VNEAP在接受率、总收入和收入成本比方面均优于现有方法,提升显著。

📝 摘要(中文)

虚拟网络嵌入(VNE)是网络切片的一项关键技术,但大多数方案假设每个虚拟网络请求(VNR)都具有固定的拓扑结构。最近,具有替代拓扑的VNE(VNEAP)被提出,用于捕获可塑性的VNR,其中每个请求可以使用几种功能等效但资源消耗不同的拓扑结构来实例化。这种灵活性扩大了可行空间,但也引入了一个额外的决策层,使得动态嵌入更具挑战性。本文提出了一种用于动态到达情况下VNEAP的分层强化学习方法HRL-VNEAP。一个高层策略选择最合适的替代拓扑(或拒绝请求),一个低层策略将选择的拓扑嵌入到基底网络上。在多个流量负载下,对真实基底拓扑的实验表明,简单的利用策略只能提供适度的收益,而HRL-VNEAP在所有指标上始终取得最佳性能。与最强的测试基线相比,HRL-VNEAP的接受率提高了高达20.7%,总收入提高了高达36.2%,收入成本比提高了高达22.1%。最后,我们针对可处理的实例,以MILP公式为基准进行测试,以量化与最优解之间的剩余差距,并推动未来基于学习和优化的VNEAP解决方案的研究。

🔬 方法详解

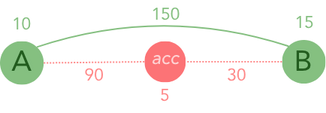

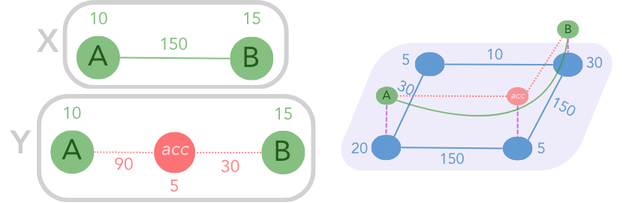

问题定义:论文旨在解决具有替代拓扑的动态虚拟网络嵌入(VNEAP)问题。传统的VNE方法假设每个虚拟网络请求(VNR)都具有固定的拓扑结构,这限制了资源利用率和灵活性。VNEAP允许每个VNR选择多个功能等效但资源需求不同的拓扑结构,从而增加了决策的复杂性,使得动态嵌入更具挑战性。现有方法难以有效地利用VNEAP提供的灵活性,导致性能提升有限。

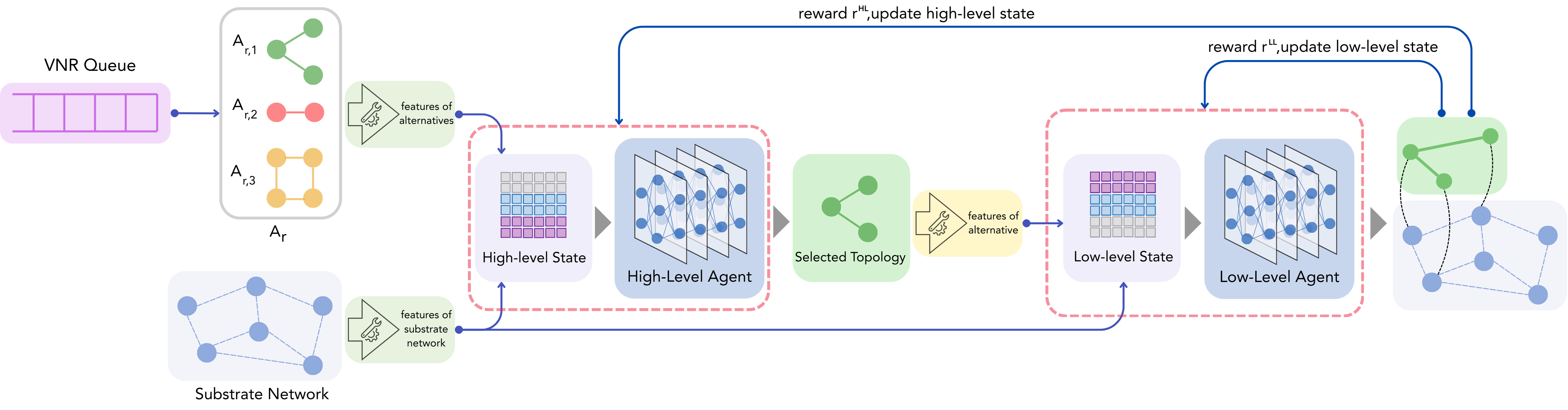

核心思路:论文的核心思路是利用分层强化学习(HRL)将VNEAP问题分解为两个层次的决策过程。高层策略负责选择最合适的替代拓扑(或拒绝请求),低层策略负责将选择的拓扑嵌入到基底网络上。这种分层结构能够有效地探索VNEAP提供的更大可行空间,并优化资源分配。

技术框架:HRL-VNEAP框架包含两个主要模块:高层策略和低层策略。高层策略接收基底网络状态和VNR信息作为输入,输出选择的拓扑结构(或拒绝)。低层策略接收基底网络状态和选定的VNR拓扑结构作为输入,输出节点和链路的嵌入位置。两个策略都使用深度神经网络进行建模,并通过强化学习算法进行训练。整体流程是:VNR到达后,高层策略做出拓扑选择决策,然后低层策略尝试嵌入选定的拓扑。如果嵌入成功,则更新两个策略;如果嵌入失败,则高层策略受到惩罚,并可能尝试其他拓扑或拒绝请求。

关键创新:HRL-VNEAP的关键创新在于将分层强化学习应用于VNEAP问题。通过将拓扑选择和嵌入过程分解为两个层次,HRL-VNEAP能够更有效地探索VNEAP提供的更大可行空间,并学习到更优的嵌入策略。与传统的单层强化学习方法相比,HRL-VNEAP能够更好地处理VNEAP的复杂性,并取得更好的性能。

关键设计:高层策略和低层策略都使用深度Q网络(DQN)进行建模。高层策略的状态空间包括基底网络的资源利用率、VNR的资源需求等信息。动作空间包括所有可用的替代拓扑以及拒绝选项。低层策略的状态空间包括基底网络的资源利用率、VNR的拓扑结构等信息。动作空间包括所有可能的节点和链路嵌入位置。奖励函数的设计旨在最大化接受率、总收入和收入成本比。使用了经验回放和目标网络等技术来稳定训练过程。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HRL-VNEAP在多个流量负载下,对真实基底拓扑的测试中,始终优于其他基线方法。与最强的测试基线相比,HRL-VNEAP的接受率提高了高达20.7%,总收入提高了高达36.2%,收入成本比提高了高达22.1%。此外,与MILP最优解的对比分析,揭示了HRL-VNEAP与最优解之间的差距,为未来的研究方向提供了指导。

🎯 应用场景

该研究成果可应用于云计算、边缘计算、5G网络切片等领域,通过更灵活的资源分配策略,提高网络资源利用率,降低运营成本,并为用户提供更好的服务质量。未来,该方法可以进一步扩展到更复杂的网络环境,例如支持多域VNE、考虑网络安全等。

📄 摘要(原文)

Virtual Network Embedding (VNE) is a key enabler of network slicing, yet most formulations assume that each Virtual Network Request (VNR) has a fixed topology. Recently, VNE with Alternative topologies (VNEAP) was introduced to capture malleable VNRs, where each request can be instantiated using one of several functionally equivalent topologies that trade resources differently. While this flexibility enlarges the feasible space, it also introduces an additional decision layer, making dynamic embedding more challenging. This paper proposes HRL-VNEAP, a hierarchical reinforcement learning approach for VNEAP under dynamic arrivals. A high-level policy selects the most suitable alternative topology (or rejects the request), and a low-level policy embeds the chosen topology onto the substrate network. Experiments on realistic substrate topologies under multiple traffic loads show that naive exploitation strategies provide only modest gains, whereas HRL-VNEAP consistently achieves the best performance across all metrics. Compared to the strongest tested baselines, HRL-VNEAP improves acceptance ratio by up to \textbf{20.7\%}, total revenue by up to \textbf{36.2\%}, and revenue-over-cost by up to \textbf{22.1\%}. Finally, we benchmark against an MILP formulation on tractable instances to quantify the remaining gap to optimality and motivate future work on learning- and optimization-based VNEAP solutions.