ASTRO: Adaptive Stitching via Dynamics-Guided Trajectory Rollouts

作者: Hang Yu, Di Zhang, Qiwei Du, Yanping Zhao, Hai Zhang, Guang Chen, Eduardo E. Veas, Junqiao Zhao

分类: cs.LG, cs.AI

发布日期: 2025-11-28 (更新: 2025-12-16)

💡 一句话要点

ASTRO:通过动态引导的轨迹展开实现自适应拼接,提升离线强化学习性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 离线强化学习 数据增强 轨迹拼接 动态引导 Rollout Deviation Feedback

📋 核心要点

- 离线强化学习面临次优和碎片化轨迹数据集的挑战,导致奖励传播不准确和策略性能下降。

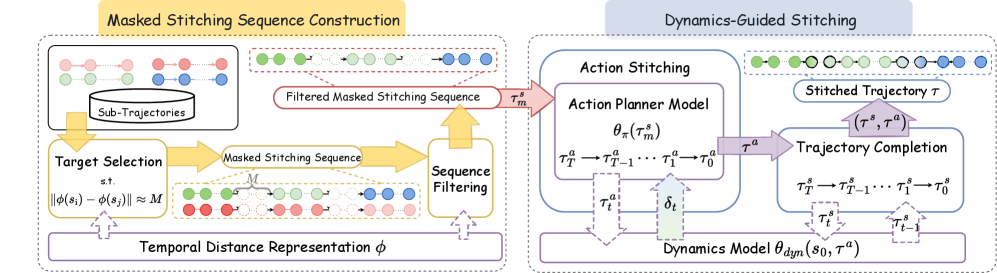

- ASTRO通过学习时间距离表示来识别拼接目标,并使用动态引导的拼接规划器生成连接动作序列,从而生成新颖且动态一致的轨迹。

- ASTRO在OGBench和D4RL等基准测试中,显著优于现有的离线RL增强方法,实现了性能提升。

📝 摘要(中文)

离线强化学习(RL)使智能体能够从预先收集的数据集中学习最优策略。然而,包含次优和碎片化轨迹的数据集给奖励传播带来了挑战,导致不准确的价值估计和降低的策略性能。虽然通过生成模型进行轨迹拼接提供了一个有希望的解决方案,但现有的增强方法经常产生要么局限于行为策略支持范围内的轨迹,要么违反底层动态的轨迹,从而限制了它们在策略改进方面的有效性。我们提出了ASTRO,一个数据增强框架,为离线RL生成分布上新颖且动态一致的轨迹。ASTRO首先学习一个时间距离表示,以识别不同的和可到达的拼接目标。然后,我们采用一个动态引导的拼接规划器,通过Rollout Deviation Feedback自适应地生成连接动作序列,Rollout Deviation Feedback被定义为目标状态序列与执行预测动作后实际到达的状态序列之间的差距,以提高轨迹拼接的可行性和可达性。这种方法通过拼接促进了有效的增强,并最终增强了策略学习。ASTRO在各种算法中优于先前的离线RL增强方法,在具有挑战性的OGBench套件上实现了显著的性能提升,并在标准的离线RL基准(如D4RL)上展示了一致的改进。

🔬 方法详解

问题定义:离线强化学习中,数据集通常包含次优甚至失败的轨迹,这些轨迹会阻碍奖励的有效传播,导致价值估计偏差,最终影响策略学习的效果。现有的轨迹拼接方法要么生成的轨迹与原始数据分布过于接近,缺乏探索性,要么生成的轨迹违反环境动力学规律,导致不可行。

核心思路:ASTRO的核心思路是通过生成既新颖又符合环境动力学的轨迹来增强离线数据集。它通过学习时间距离表示来寻找合适的拼接目标,并利用动态引导的拼接规划器来生成连接这些目标的动作序列。这种方法旨在克服现有轨迹拼接方法的局限性,提高数据增强的有效性。

技术框架:ASTRO框架主要包含两个阶段:1) 拼接目标识别:学习一个时间距离表示,用于识别数据集中不同的、可到达的拼接目标。2) 动态引导的拼接规划:利用Rollout Deviation Feedback,自适应地生成连接动作序列,以实现从当前状态到目标状态的平滑过渡。Rollout Deviation Feedback衡量了预测动作执行后的实际状态与目标状态之间的差距,用于指导动作序列的生成。

关键创新:ASTRO的关键创新在于其动态引导的拼接规划器,它通过Rollout Deviation Feedback来确保生成的轨迹既能到达目标状态,又符合环境的动力学规律。这与现有方法不同,现有方法要么忽略环境动力学,要么生成的轨迹过于保守,缺乏探索性。

关键设计:ASTRO使用一个神经网络来学习时间距离表示,该网络以状态作为输入,输出一个表示到达目标状态所需时间距离的向量。拼接规划器使用一个循环神经网络(RNN)来生成动作序列,并使用Rollout Deviation Feedback作为奖励信号来训练该RNN。Rollout Deviation Feedback被定义为目标状态序列与实际到达状态序列之间的差距,可以使用L2距离或其他合适的距离度量来计算。

🖼️ 关键图片

📊 实验亮点

ASTRO在OGBench套件上取得了显著的性能提升,证明了其在复杂环境中的有效性。此外,ASTRO在D4RL等标准离线RL基准测试中也表现出一致的改进,超越了现有的离线RL增强方法。实验结果表明,ASTRO能够有效地生成新颖且动态一致的轨迹,从而提高策略学习的性能。

🎯 应用场景

ASTRO可应用于各种离线强化学习场景,例如机器人控制、自动驾驶、游戏AI等。通过增强离线数据集,ASTRO可以提高智能体的学习效率和性能,使其能够更好地适应复杂和动态的环境。该方法还可以用于从历史数据中学习最优策略,而无需进行在线探索,从而降低了试错成本和风险。

📄 摘要(原文)

Offline reinforcement learning (RL) enables agents to learn optimal policies from pre-collected datasets. However, datasets containing suboptimal and fragmented trajectories present challenges for reward propagation, resulting in inaccurate value estimation and degraded policy performance. While trajectory stitching via generative models offers a promising solution, existing augmentation methods frequently produce trajectories that are either confined to the support of the behavior policy or violate the underlying dynamics, thereby limiting their effectiveness for policy improvement. We propose ASTRO, a data augmentation framework that generates distributionally novel and dynamics-consistent trajectories for offline RL. ASTRO first learns a temporal-distance representation to identify distinct and reachable stitch targets. We then employ a dynamics-guided stitch planner that adaptively generates connecting action sequences via Rollout Deviation Feedback, defined as the gap between target state sequence and the actual arrived state sequence by executing predicted actions, to improve trajectory stitching's feasibility and reachability. This approach facilitates effective augmentation through stitching and ultimately enhances policy learning. ASTRO outperforms prior offline RL augmentation methods across various algorithms, achieving notable performance gain on the challenging OGBench suite and demonstrating consistent improvements on standard offline RL benchmarks such as D4RL.