CRAwDAD: Causal Reasoning Augmentation with Dual-Agent Debate

作者: Finn G. Vamosi, Nils D. Forkert

分类: cs.LG, cs.MA

发布日期: 2025-11-28

备注: 12 pages, 8 figures. Code available at https://github.com/finnvamosi/CRAwDAD

💡 一句话要点

提出CRAwDAD:利用双智能体辩论增强因果推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 因果推理 多智能体系统 辩论框架 语言模型 反事实推理

📋 核心要点

- 现有因果推理方法缺乏对多种假设的充分探索和批判性评估,导致推理结果可能存在偏差。

- CRAwDAD框架通过引入双智能体辩论机制,模拟人类的内部对话过程,从而更全面地评估因果关系。

- 实验表明,CRAwDAD显著提升了DeepSeek-R1和Qwen3在CLadder数据集上的因果推理准确率,尤其是在反事实推理方面。

📝 摘要(中文)

人们在进行因果推理时,通常会考虑多种竞争性的“如果...会怎样”情景,然后决定哪种解释最合适。类似地,能够进行因果推理的先进语言模型可以考虑多种干预和反事实情况,以判断因果主张的有效性。重要的是,这种推理不像单一计算,而更像是替代假设之间的内部对话。本文通过双智能体辩论框架,将这种对话显式化,其中一个模型提供结构化的因果推理,另一个模型批判性地检查这种推理是否存在逻辑缺陷。当出现分歧时,智能体会试图说服对方,挑战彼此的逻辑并修改其结论,直到它们达成相互同意的答案。为了利用这种审议过程,我们专门使用推理语言模型,其在因果推理和对抗性辩论方面的优势相对于标准大型语言模型而言仍未得到充分探索。我们在CLadder数据集上评估了我们的方法,该基准将自然语言问题与Pearl因果阶梯的所有三个层级上的正式定义的因果图联系起来。使用Qwen3和DeepSeek-R1作为辩论智能体,我们证明了多智能体辩论将DeepSeek-R1在因果推理中的总体准确率从78.03%提高到87.45%,其中反事实类别的准确率从67.94%提高到80.04%。同样,Qwen3的总体准确率从84.16%提高到89.41%,反事实问题的准确率从71.53%提高到80.35%,表明强大的模型仍然可以从与较弱智能体的辩论中受益匪浅。我们的结果突出了推理模型作为因果推理中多智能体系统的构建块的潜力,并证明了因果问题解决中不同视角的重要性。

🔬 方法详解

问题定义:论文旨在提高语言模型在因果推理任务中的准确性和可靠性。现有方法,特别是单智能体方法,在处理复杂的因果关系时,容易受到自身偏见的影响,缺乏对多种可能解释的充分探索和批判性评估。这导致模型可能得出错误的结论,尤其是在反事实推理等需要深入思考的场景下。

核心思路:论文的核心思路是引入双智能体辩论机制,模拟人类在进行因果推理时进行的内部对话过程。通过让两个智能体分别提出不同的因果解释,并相互挑战和辩论,可以更全面地评估各种假设,从而减少偏见,提高推理的准确性。这种方法借鉴了人类认知过程中的批判性思维和多角度思考的优势。

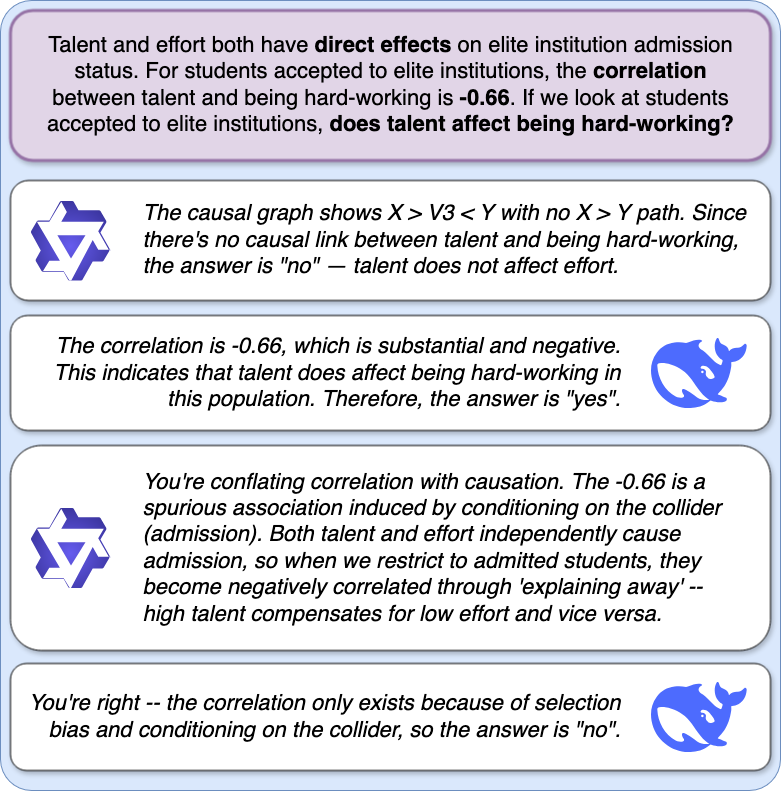

技术框架:CRAwDAD框架包含两个主要智能体:一个负责提出因果推理,另一个负责批判性地审查该推理。整体流程如下: 1. 问题输入:将因果推理问题输入到两个智能体。 2. 初始推理:第一个智能体(Proponent)提出一个初始的因果推理。 3. 批判性审查:第二个智能体(Opponent)审查Proponent的推理,寻找逻辑缺陷或提出替代解释。 4. 辩论:如果两个智能体存在分歧,它们会进行辩论,互相挑战对方的逻辑,并尝试说服对方。 5. 结论修订:根据辩论的结果,两个智能体可能会修改自己的结论。 6. 达成共识:重复辩论和修订过程,直到两个智能体达成共识。 7. 输出结果:输出最终的因果推理结果。

关键创新:CRAwDAD的关键创新在于将多智能体辩论引入到因果推理任务中。与传统的单智能体方法相比,CRAwDAD能够更全面地探索各种可能的因果解释,并减少模型自身的偏见。此外,该框架利用推理语言模型作为智能体,充分发挥了这些模型在因果推理和对抗性辩论方面的优势。

关键设计:论文的关键设计包括: * 智能体选择:选择具有较强推理能力的语言模型(如Qwen3和DeepSeek-R1)作为智能体。 * 辩论策略:设计有效的辩论策略,例如,Opponent可以提出反例、质疑假设或提供替代解释。 * 共识机制:采用合适的共识机制,例如,当两个智能体的结论一致时,或经过一定轮数的辩论后,停止辩论并输出结果。 * 数据集选择:使用CLadder数据集进行评估,该数据集涵盖了Pearl因果阶梯的所有三个层级,能够全面评估模型的因果推理能力。

🖼️ 关键图片

📊 实验亮点

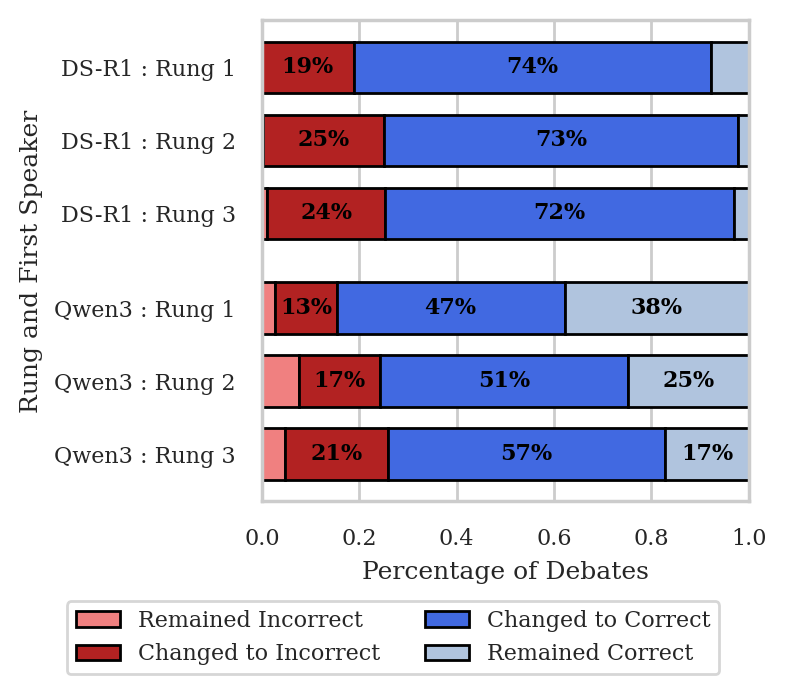

实验结果表明,CRAwDAD框架显著提升了DeepSeek-R1和Qwen3在CLadder数据集上的因果推理准确率。具体而言,DeepSeek-R1的总体准确率从78.03%提高到87.45%,反事实类别的准确率从67.94%提高到80.04%。Qwen3的总体准确率从84.16%提高到89.41%,反事实问题的准确率从71.53%提高到80.35%。

🎯 应用场景

CRAwDAD框架具有广泛的应用前景,例如在医疗诊断、金融风险评估、政策制定等领域,可以帮助人们更准确地理解因果关系,做出更明智的决策。此外,该框架还可以用于提高AI系统的可解释性和可靠性,使其能够更好地与人类协作。

📄 摘要(原文)

When people reason about cause and effect, they often consider many competing "what if" scenarios before deciding which explanation fits best. Analogously, advanced language models capable of causal inference can consider multiple interventions and counterfactuals to judge the validity of causal claims. Crucially, this type of reasoning is less like a single calculation and more like an internal dialogue between alternative hypotheses. In this paper, we make this dialogue explicit through a dual-agent debate framework where one model provides a structured causal inference, and the other critically examines this reasoning for logical flaws. When disagreements arise, agents attempt to persuade each other, challenging each other's logic and revising their conclusions until they converge on a mutually agreed answer. To take advantage of this deliberative process, we specifically use reasoning language models, whose strengths in both causal inference and adversarial debate remain under-explored relative to standard large language models. We evaluate our approach on the CLadder dataset, a benchmark linking natural language questions to formally defined causal graphs across all three rungs of Pearl's ladder of causation. With Qwen3 and DeepSeek-R1 as debater agents, we demonstrate that multi-agent debate improves DeepSeek-R1's overall accuracy in causal inference from 78.03% to 87.45%, with the counterfactual category specifically improving from 67.94% to 80.04% accuracy. Similarly, Qwen3's overall accuracy improves from 84.16% to 89.41%, and counterfactual questions from 71.53% to 80.35%, showing that strong models can still benefit greatly from debate with weaker agents. Our results highlight the potential of reasoning models as building blocks for multi-agent systems in causal inference, and demonstrate the importance of diverse perspectives in causal problem-solving.